01性能炸裂

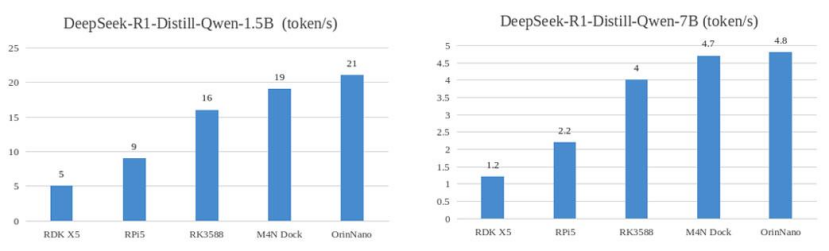

速度领先RK358815%,性能直逼OrinNano!

久等了!矽速 M4N Dock(爱芯派Pro,AX650N) 已支持部署 DeepSeek R1 大模型,实测运行速度超越 RK3588 达15% ,距离 40TOPS 算力的 Nvidia Orin Nano 8G版仅差10% !

图1:DeepSeek-R1 Distill Qwen 运行速度对比

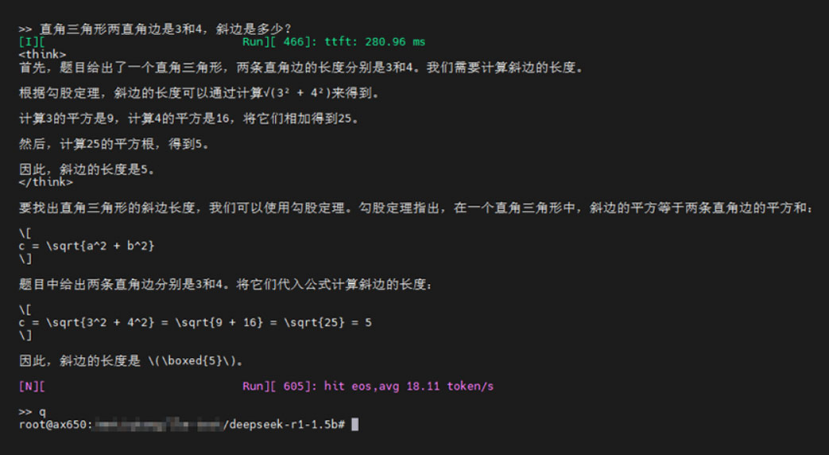

图2:运行实测图

02开发者福利

开源模型+一键部署!

为助力开发者快速上手,现已开源 DeepSeek-R1-Distill-Qwen-1.5B 轻量化模型,支持 GPTQ-Int4 高效推理!

模型下载:Huggingface仓库直达 镜像支持:基于Ubuntu系统的最新镜像 AX650_pipro_box_ubuntu_rootfs_desktop_V1.45.0内置预装环境,用户root,密码1234566,

03

即刻入手

M4N Dock,体验极致性能!

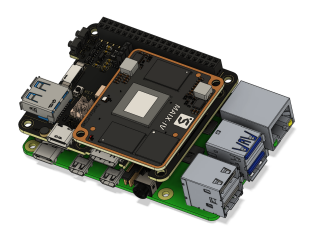

图3:M4N Dock产品图

超高性价比,AI推理性能比肩旗舰支持多模态大模型部署即插即用,开发板+算法一站式体验立即购买:Sipeed官方店

04

新品剧透

百元级LLM硬件即将登场!

2025年矽速科技将推出 MaixHAT —— 百元级端侧大模型硬件平台!

图4:MaixHAT产品预览图

核心优势

支持串口LLM推理,可独立运行或作为开发模块

高性价比,加速AIoT产品落地

发布日期:未来2个月内,敬请期待!

-

RK3588

+关注

关注

8文章

585浏览量

7539 -

大模型

+关注

关注

2文章

3747浏览量

5268 -

DeepSeek

+关注

关注

2文章

837浏览量

3392

发布评论请先 登录

DeepSeek模型如何在云服务器上部署?

广和通成功部署DeepSeek-R1-0528-Qwen3-8B模型

DeepSeek R1 MTP在TensorRT-LLM中的实现与优化

如何在NVIDIA Blackwell GPU上优化DeepSeek R1吞吐量

WAIC 2025|深圳矽速科技携新品亮相展区,解锁端侧大模型新纪元

速看!EASY-EAI教你离线部署Deepseek R1大模型

【VisionFive 2单板计算机试用体验】3、开源大语言模型部署

【「DeepSeek 核心技术揭秘」阅读体验】书籍介绍+第一章读后心得

Arm Neoverse N2平台实现DeepSeek-R1满血版部署

重磅发布 | 矽速 M4N Dock 支持 DeepSeek R1,端侧大模型部署新标杆!

重磅发布 | 矽速 M4N Dock 支持 DeepSeek R1,端侧大模型部署新标杆!

评论