随着 DeepSeek R1 模型的发布,其强大的思维链能力让开发者为之兴奋。然而,Spring AI 等主流框架对其支持不足,导致很多开发者无法充分发挥模型潜力。本文将为您带来一个完美的解决方案 - deepseek4j。

一、为什么需要 deepseek4j?

1.1 现有框架的局限性

思维链内容丢失:R1 最核心的推理过程完全被忽略

响应模式不兼容:无法处理"思考在前、结论在后"的输出模式

参数限制:temperature、top_p 等关键参数设置失效

流式处理不完善:用户体验欠佳

虽然笔者上篇博客介绍了如何使用 WebFlux 直接调用 DeepSeek API,但这种方式存在一些问题:开发成本高:直接调用 API 或改造现有框架需要处理大量细节,包括请求构建、响应解析、错误处理等。

一不做二不休,为了彻底解决这些问题,笔者基于 OpenAI4J[1] 项目的优秀架构,打造了一个专门面向 DeepSeek 的开箱即用方案 DeepSeek4J[2]

增强支持 DeepSeek 独有的思维链和账单特性

增加 Project Reactor 的全面响应式支持

提供集成 Spring Boot Starter,提供自动配置

二、核心特性

完整保留思维链能力、账单

响应式流式处理

简单优雅的 API 设计

开箱即用的 Spring Boot 集成,同时支持2.x / 3.x

内置调试页面

详细的请求响应日志

灵活的代理配置

响应式编程支持

三、快速开始

3.1 添加依赖

io.github.pig-mesh.ai deepseek-spring-boot-starter 1.1.0

3.2 配置参数

deepseek: api-key:your-api-key-here base-url:https://api.deepseek.com/v1#可选,默认为官方API地址,支持火山、gitee、硅基流动

3.3 基础使用

@Autowired privateDeepSeekClientdeepSeekClient; //sse流式返回 @GetMapping(value="/chat",produces=MediaType.TEXT_EVENT_STREAM_VALUE) publicFluxchat(Stringprompt){ returndeepSeekClient.chatFluxCompletion(prompt); }

3.4 进阶配置

publicFluxchat(Stringprompt){ ChatCompletionRequestrequest=ChatCompletionRequest.builder() //模型选择,支持DEEPSEEK_CHAT、DEEPSEEK_REASONER等 .model(ChatCompletionModel.DEEPSEEK_CHAT) //添加用户消息 .addUserMessage(prompt) //添加助手消息,用于多轮对话 .addAssistantMessage("上轮结果") //添加系统消息,用于设置角色和行为 .addSystemMessage("你是一个专业的助手") //设置最大生成token数,默认2048 .maxTokens(1000) //设置响应格式,支持JSON结构化输出 .responseFormat() .tools()//functioncalling .build(); returndeepSeekClient.chatFluxCompletion(request); }

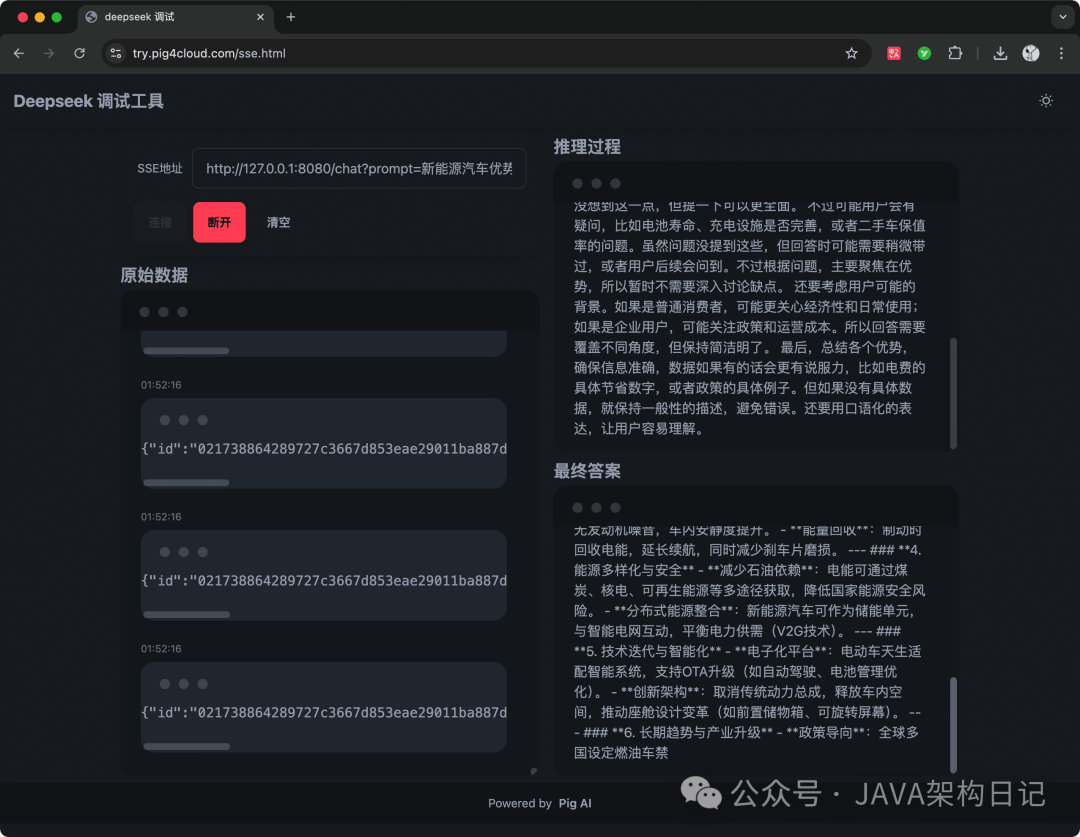

3.5 开发者专享彩蛋:

内置可视化调试页面,双击 sse.html 即可开启实时对话监控,完整呈现思维链演进过程!页面提供了完整的前端实现代码,可作为集成参考。

点击「阅读原文」直达项目仓库,开启你的智能开发新纪元!

参考资料

DeepSeek4J:https://github.com/pig-mesh/deepseek4j

-

AI

+关注

关注

91文章

42161浏览量

303154 -

DeepSeek

+关注

关注

2文章

862浏览量

3485

原文标题:deepseek4j已开源——完美解决DeepSeek R1集成难题

文章出处:【微信号:OSC开源社区,微信公众号:OSC开源社区】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

百度腾讯抢滩布局!DeepSeek-R1升级和开源背后,国产AI的逆袭之路

使用NVIDIA Blackwell和GPU加速端点构建DeepSeek V4大模型

登临科技GPU+架构深度适配DeepSeek-V4大模型

海光信息DCU平台完成对DeepSeek V4模型极速适配

DeepSeek爆火一周年的寂静

黄仁勋新年第一场演讲提了DeepSeek 黄仁勋:机器人领域迎来ChatGPT时刻

DeepSeek R1 MTP在TensorRT-LLM中的实现与优化

如何在NVIDIA Blackwell GPU上优化DeepSeek R1吞吐量

速看!EASY-EAI教你离线部署Deepseek R1大模型

【「DeepSeek 核心技术揭秘」阅读体验】+混合专家

【「DeepSeek 核心技术揭秘」阅读体验】--全书概览

【「DeepSeek 核心技术揭秘」阅读体验】书籍介绍+第一章读后心得

Arm Neoverse N2平台实现DeepSeek-R1满血版部署

DeepSeek4J开源:高效解决DeepSeek R1集成挑战

DeepSeek4J开源:高效解决DeepSeek R1集成挑战

评论