近期,“国产之光”DeepSeek系列大模型发展迅猛,领跑开源大模型技术与生态,为中国人工智能行业带来了前所未有的变革动力,对全球科技竞争格局产生积极影响。

1稀疏计算

助力DeepSeek R1模型高效部署

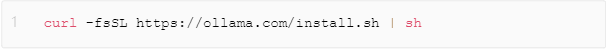

日前,墨芯人工智能(Moffett AI)已完成与DeepSeek R1全系列蒸馏模型的推理部署。凭借自研的双稀疏算法技术,墨芯S40计算卡性能得到充分释放,为DeepSeek R1的高效部署提供了强劲的算力后盾,并在较短时间内完成DeepSeek-R1-70B* 和DeepSeek-R1-32B* 等中、大模型部署,且成功实现单卡支持DeepSeek-R1-32B*部署。

墨芯S40计算卡支持DeepSeek R1-70B和DeepSeek R1-32B推理部署

2软硬件协同

提升DeepSeek R1模型推理效率

DeepSeek-R1蒸馏模型是DeepSeek在模型压缩与优化领域的重要创新,通过蒸馏技术实现了高效、低成本的AI推理,适合企业内部实施部署,实现降本增效。

DeepSeek-R1-70B* 和DeepSeek-R1-32B*是DeepSeek-R1蒸馏模型的中大规模和大规模模型。DeepSeek-R1-32B*推理速度较快,实时性要求高的场景,擅长处理日常对话、文档生成和基础代码辅助;DeepSeek-R1-70B*侧重复杂逻辑推理、科研分析、高质量内容创作。

墨芯的稀疏计算技术则是通过算法与硬件的协同设计,有效地减少蒸馏模型部署所需的资源,其中稀疏化技术将模型中的稠密张量转换为等效的稀疏张量,使张量中产生大量的零元素,通过剪枝,有效消减模型冗余,以显著加快计算速度,实现了大模型的高效稀疏化,显著提升DeepSeek-R1系列蒸馏模型的推理速度并降低能耗。

此外,相较于传统推理平台,墨芯S40算力卡能够实现“单卡推理大模型”,简化了多卡分布式处理大模型的复杂部署流程,降低了时间、功耗和成本。这一优势在DeepSeek-R1蒸馏模型的部署中得到了充分体现,墨芯的S40计算卡满足了高算力需求,降低了总拥有成本(TCO),为 AI大模型在各行业的应用提供了支持。

墨芯人工智能与DeepSeek-R1蒸馏模型的成功部署,实现了国产AI算力基座和国产大模型在应用层面的“双向奔赴”,展示了稀疏计算技术在大模型领域的实践成果,也为企业部署“高性能”且“用得起”的大模型提供新思路。

备注:

DeepSeek-R1-70B*:指DeepSeek-R1-Distill-Llama-70B模型

DeepSeek-R1-32B*:指DeepSeek-R1-Distill-Qwen-32B模型

关于墨芯人工智能

墨芯人工智能是稀疏计算引领者,致力于提供云端和终端AI计算平台和服务。通过全球领先的稀疏计算技术优势,打造软硬协同的新一代智能计算平台。产品性能位居行业领先,相较行业主流产品,在算力、能效比与成本等方面均实现数量级优化。面向互联网、运营商、金融、制造、医疗、交通、能源、生命科学、自动驾驶等众多行业与场景,提供高算力、低功耗、高性价比的AI算力服务,赋能前沿科技的进步与社会的智能化升级。

-

墨芯

+关注

关注

0文章

22浏览量

1332 -

大模型

+关注

关注

2文章

3771浏览量

5273 -

DeepSeek

+关注

关注

2文章

839浏览量

3406

原文标题:墨芯S40计算卡完成DeepSeek大模型部署, 支持单卡推理大模型

文章出处:【微信号:墨芯人工智能,微信公众号:墨芯人工智能】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

墨芯人工智能千卡集群正式签约入驻新疆算力中心

DeepSeek模型如何在云服务器上部署?

广和通成功部署DeepSeek-R1-0528-Qwen3-8B模型

墨芯人工智能亮相2025外滩大会

本地部署openWebUI + ollama+DeepSeek 打造智能知识库并实现远程访问

【「DeepSeek 核心技术揭秘」阅读体验】+混合专家

【VisionFive 2单板计算机试用体验】3、开源大语言模型部署

【「DeepSeek 核心技术揭秘」阅读体验】书籍介绍+第一章读后心得

Arm Neoverse N2平台实现DeepSeek-R1满血版部署

墨芯S40计算卡实现DeepSeek大模型部署

墨芯S40计算卡实现DeepSeek大模型部署

评论