英伟达在3月18日GTC 2024年盛会上推出了搭载自家创新结构Blackwell的B200 GPU芯片,选用了台积电最先进的N4P制程工艺,性能较之前翻番。然而,Meta公司在次日披露称,预计今年无法获得这款最新的AI芯片,至少在2025年后才能用上。

英伟达宣称,B200在性能上比以往最好的GPU快30倍不止。由它构成的服务器集群相比上一代,运算能力飞跃性提升,甚至能使大语言模型的训练速度翻番。

财务长科莱特•克雷斯于同日向财经分析人士保证,“我们确信新款GPU产品将在今年内面世。”新款GPU的规模生产预计需等到2025年。

脸书(即Meta)作为英伟达的主要买家之一,已经购买了数十万块英伟达AI芯片,用以训练生成式AI和强化内容推荐功能。首席执行官马克•扎克伯格曾在年初表示,今年底将拥有约35万个H100芯片。这些芯片与其他型号GPU结合使用,总共将提供60万个H100所代表的运算力。

在英伟达发布B200后不久,Meta宣布将利用该芯片训练公司的LIama大型模型。据悉,Meta正在动用两个包含约2.4万个H100GPU的GPU集群来训练第三代LIama模型。Meta公司发言人表示,他们打算继续使用这两座集群训练LIama 3,并期待未来用Blackwell硬件训练更多世代的大型模型。

声明:本文内容及配图由入驻作者撰写或者入驻合作网站授权转载。文章观点仅代表作者本人,不代表电子发烧友网立场。文章及其配图仅供工程师学习之用,如有内容侵权或者其他违规问题,请联系本站处理。

举报投诉

-

服务器

+关注

关注

14文章

10364浏览量

91761 -

语言模型

+关注

关注

0文章

575浏览量

11343 -

英伟达

+关注

关注

23文章

4116浏览量

99634

发布评论请先 登录

相关推荐

热点推荐

豪言自家芯片比英伟达GPU强10倍,这家AI公司再获融资

的 “复仇者联盟” 正在硅谷悄然集结,他们创立的 MatX 公司刚刚完成 5 亿美元 B 轮融资,豪言要打造性能 10 倍于英伟达 GPU

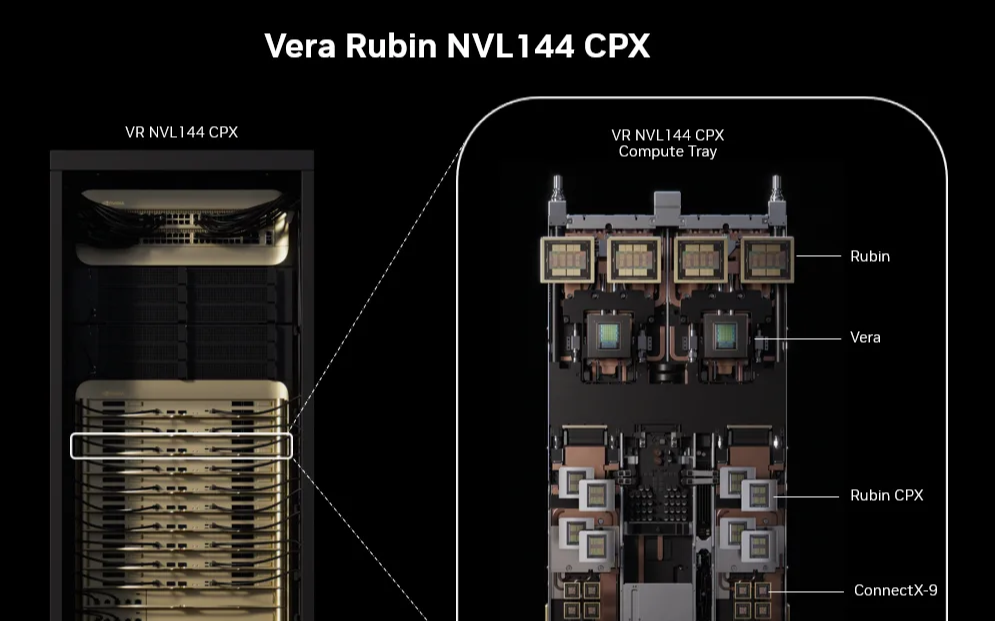

堪称史上最强推理芯片!英伟达发布 Rubin CPX,实现50倍ROI

电子发烧友网报道(文/梁浩斌)近日,英伟达在AI infra峰会上发布了专为大规模上下文推理设计的全新GPU系列Rubin CPX,

从英伟达电话会看Agentic AI推理与FPGA价值

2026年2月,英伟达发布2026财年Q4财报:营收681亿美元,同比增长73%,数据中心业务增长75%——预期中的超预期。更值得关注的,是电话会中反复出现的几个关键词:Agentic AI

每块GPU对应16TB SSD,英伟达KV缓存虹吸高性能TLC SSD

作者:黄晶晶 不久前,英伟达宣布其Vera Rubin平台将采用搭载BlueField-4芯片的ICMS架构,通过卸载KV Cache突破内存瓶颈、提升AI推理

亚马逊发布新一代AI芯片Trainium3,性能提升4倍

Trainium 4的开发计划。亚马逊表示,这款芯片能够比英伟达市场领先的图形处理单元(GPU)更便宜、更高效地驱动AI模型背后的密集计算。 作为亚马逊首款3纳米工艺

英伟达 Q3 狂揽 308 亿

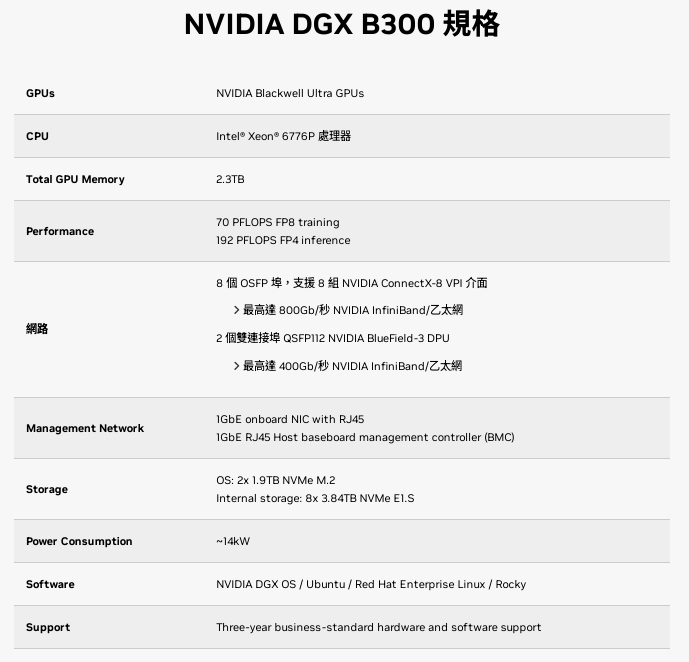

厂商季度合计 500 亿美元资本支出中,约 30% 流向了英伟达。 新一代 Blackwell 芯片已全面投产,Q3 交付 1.3 万个 GPU 样品,H200

英伟达发布 NVQLink 开放系统架构;国内首个汽车芯片标准验证平台投入使用

英伟达发布 NVQLink 开放系统架构 在华盛顿特区举行的英伟达全球技术大会上,英伟

发表于 10-29 10:33

•1342次阅读

英伟达最新B30A芯片曝光:算力角逐中的新变数

在全球AI芯片市场风云变幻之际,英伟达再次成为焦点。据路透社8月19日报道,两位知情人士透露,英伟达正在为中国市场开发一款基于其最新Blac

传英伟达自研HBM基础裸片

"后的下一代AI GPU "Feynman"。 有分析指出,英伟达此举或是将部分GPU功能集成到基础裸片中,旨在提高HBM和

外媒:英伟达正开发新款中国特供芯片B30A 或为旗舰AI芯品B300的阉割版

30A ;或为旗舰AI芯品B300的阉割版 ;估计性能只有B300的50%--70%。 据外媒路透社报道,为了中国市场;英伟

GPU 维修干货 | 英伟达 GPU H100 常见故障有哪些?

上涨,英伟达H100GPU凭借其强大的算力,成为AI训练、高性能计算领域的核心硬件。然而,随着使用场景的复杂化,H100服务器故障率也逐渐攀

英伟达发布性能大幅提升的新款B200 AI GPU

英伟达发布性能大幅提升的新款B200 AI GPU

评论