一位微软员工在github公开开源ai训练数据时,有38 TB的个人数据被泄露,安全研究员发现了这个泄露账户,并向windows大企业进行了报告。

网络安全负责人声称泄露的数据桶包含私人密钥、密码、超过30,000条微软内部团队消息和来自两名员工工作站的备份数据。

微软安全应对中心(msrc)小组表示:“没有任何客户数据外泄,也没有其他内部服务因该问题陷入危险。顾客不需要对这个问题采取任何措施。为了了解对客户和/或业务连续性的潜在影响,进行了进一步的调查。因此次曝光,得出了顾客完全没有危险的结论。”

这并不是微软在最近几个月里唯一遇到密钥认证问题的问题,7月有消息称,微软窃取秘密密钥是为了侵入美国政府的电子邮件账户。

声明:本文内容及配图由入驻作者撰写或者入驻合作网站授权转载。文章观点仅代表作者本人,不代表电子发烧友网立场。文章及其配图仅供工程师学习之用,如有内容侵权或者其他违规问题,请联系本站处理。

举报投诉

-

微软

+关注

关注

4文章

6766浏览量

108178 -

网络安全

+关注

关注

11文章

3542浏览量

63648 -

AI

+关注

关注

91文章

42211浏览量

303212

发布评论请先 登录

相关推荐

热点推荐

在RT1010 上使用 OTFAD 和 HAB 时,是否有任何闪锁或保护功能?

如前所述,我们发现瑞萨 AT25SF321B 闪存在使用过程中意外锁定。

启用 HAB 和 OTFAD 后,某些作(例如错误的闪存刻录)是否会导致

闪存进入锁定状态(非易失性保护)?

发表于 04-27 06:23

Keil Studio现已支持在GitHub Codespaces中运行

Keil Studio 现已支持在 GitHub Codespaces 中运行,通过你的浏览器即可将 Arm 量产级、兼容 CMSIS 的开发工作流,融入全托管、容器化的云端工作空间。数秒内即可搭建纯净且可复用的开发环境,让构建、代码评审与自动化流程与代码深度协同。

DAC38RF82和DAC38RF89:高性能射频采样DAC的详细解析

DAC38RF82和DAC38RF89:高性能射频采样DAC的详细解析 在电子工程领域,高性能的数模转换器(DAC)对于实现各种复杂的射频应用至关重要。今天我们就来深入了解一下德州仪器(TI

海光信息全球首发机密Token技术

全民“养虾”热潮翻涌,用户对云端大模型的依赖日益加深。用AI写方案、分析病历、辅助决策……效率确实上去了,但商业机密、患者隐私、敏感数据都“喂”给了大模型,怎么保证这些明文不被看见、留存、泄露?

屏幕安全的“零信任”革命:自连 AiKits系列智能屏幕防御系统解决方案深度解析

AiKits@C38 专用 AI 摄像头 屏幕安全的“零信任”革命 在数字化办公与数据安全高度敏感的今天,企业往往在网络防火墙、数据加密和终端管理上投入重金,却忽略了信息

数据安全:守护敏感数据,防范传输风险

V2X系统运行过程中,会产生海量敏感数据,包括车辆位置、行驶速度、制动状态等车辆运行数据,行人动态、交通流量等交通环境数据,以及用户出行轨迹、车辆身份信息等隐私数据。这些

GitHub王炸:AI编程进入"多智能体时代",1.8亿人彻夜未眠

微软旗下代码托管平台GitHub正式集成Claude与Codex,开发者可在统一工作流中自由切换顶级AI助手 2026年2月5日,微软旗下GitHub宣布重大战略升级:正式将Anthr

传音控股荣获CES 2026微软AI创新奖

近日,在 CES 2026 国际消费类电子产品展览会期间,微软大中华区举办了以“驾驭前沿,共赢全球”为主题的专场活动,聚焦中国企业的创新实践与技术应用成果。作为深耕全球新兴市场的科技企业,传音控股凭借

探索TB3R1与TB3R2:四通道差分PECL接收器的卓越性能

探索TB3R1与TB3R2:四通道差分PECL接收器的卓越性能 在电子设计领域,差分线接收器是实现高速数据传输和信号处理的关键组件。今天,我们将深入探讨

如何保障远程运维过程中的数据安全和隐私?

LZ-DZ100背面 在分布式光伏集群的远程运维中,数据安全和隐私保护面临多重风险,包括 传输过程中的窃听 / 篡改、未授权访问控制指令、设备固件被恶意植入、敏感数据(如站点位置、运行参数)泄

今日看点丨台积电开除多名违规获取2纳米芯片信息的员工,苹果脑控实机视频曝光

违规获取2纳米芯片信息,台积电开除多名员工 据《日经亚洲》报道,台积电已开除多名违反尖端芯片技术敏感信息获取规定的员工,并就此启动法律程序。多位知情人士透露,多名台积电前员工涉

发表于 08-06 09:34

•1934次阅读

电商API合规性:确保数据隐私与法规遵守

在当今数字化电商时代,API(应用程序编程接口)作为连接平台、商家和用户的核心枢纽,处理着海量敏感数据,如用户个人信息、交易记录和行为偏好。然而,随着全球数据隐私法规的日益严格,电商API的合规

电商API安全最佳实践:保护用户数据免受攻击

在电商领域,API(应用程序编程接口)是连接用户、商家和支付系统的核心枢纽。它们处理敏感数据,如用户个人信息、支付详情和交易记录。然而,API也常成为黑客攻击的目标,导致数据泄露、

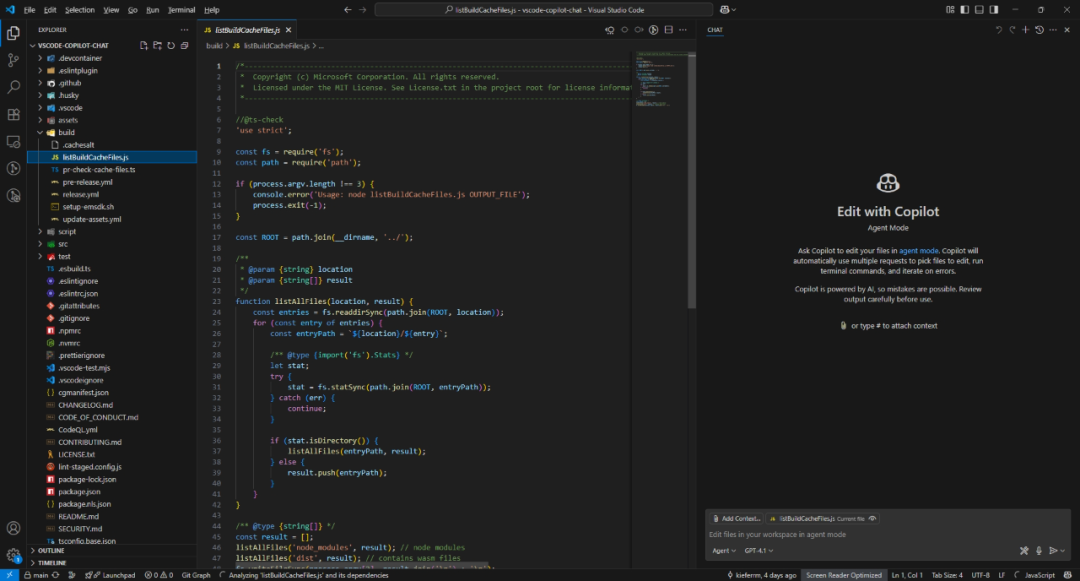

微软开源GitHub Copilot Chat,AI编程迎来新突破

GitHub Copilot + vscode的组合我已经用了很久,我的代码开发效率完全提升了一个level。帮我代码提示,代码不全,注释理解生成代码等等,这些我是我经常用到的功能。 在今天凌晨4点

传微软员工在GitHub失误中意外泄露38TB敏感数据

传微软员工在GitHub失误中意外泄露38TB敏感数据

评论