6月,在第五届智源大会AI系统分论坛上,上海天数智芯半导体有限公司(以下简称“天数智芯”)对外宣布,在天垓100加速卡的算力集群,基于北京智源人工智能研究院(以下简称“智源研究院”)70亿参数的Aquila语言基础模型,使用代码数据进行继续训练,稳定运行19天,模型收敛效果符合预期,证明天数智芯有支持百亿级参数大模型训练的能力。

在北京市海淀区的大力支持下,智源研究院、天数智芯与爱特云翔共同合作,联手开展基于自主通用GPU的大模型CodeGen(高效编码)项目,通过中文描述来生成可用的C、Java、Python代码以实现高效编码。智源研究院负责算法设计、训练框架开发、大模型的训练与调优,天数智芯负责提供天垓100加速卡、构建算力集群及全程技术支持,爱特云翔负责提供算存网基础硬件及智能化运维服务。

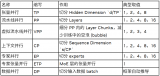

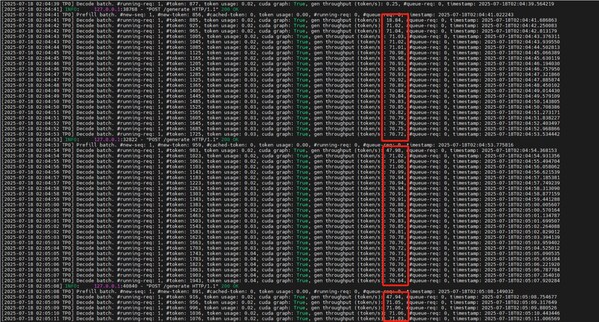

在三方的共同努力下,在基于天垓100加速卡的算力集群上,100B Tokens编程语料、70亿参数量的AquilaCode大模型参数优化工作结果显示,1个Epoch后loss下降到0.8,训练速度达到87K Tokens/s,线性加速比高达95%以上。与国际主流的A100加速卡集群相比,天垓100加速卡集群的收敛效果、训练速度、线性加速比相当,稳定性更优。在HumanEval基准数据集上,以Pass@1作为评估指标,自主算力集群训练出来的模型测试结果达到相近参数级别大模型的SOAT水平,在AI编程能力与国际主流GPU产品训练结果相近。

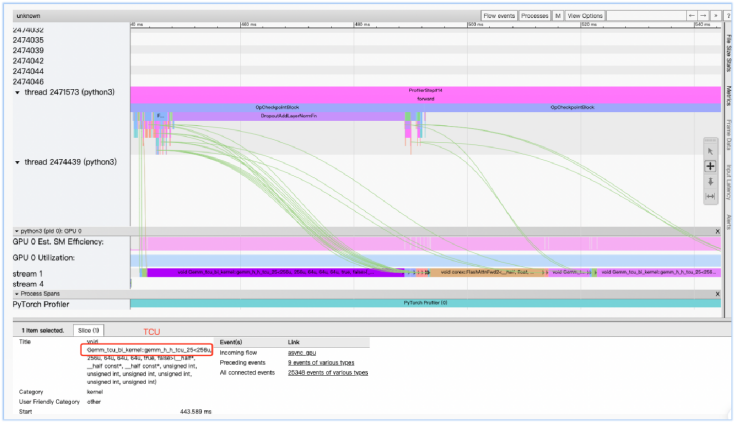

图 基于天垓100算力集群的AquilaCode大模型训练性能采样

天垓100率先完成百亿级参数大模型训练,迈出了自主通用GPU大模型应用的重要的一步。这一成果充分证明了天垓产品可以支持大模型训练,打通了国内大模型创新发展的关键“堵点”,对于我国大模型自主生态建设、产业链安全保障具有十分重大的意义。

接下来,天数智芯将与合作伙伴们继续深入合作,建设更大规模的天垓100算力集群,完成更大参数规模的大模型训练,以自主通用GPU产品更好支持国内大模型创新应用,进一步夯实我国算力基础,助力人工智能产业自主生态建设。

责任编辑:彭菁

-

编程

+关注

关注

90文章

3723浏览量

97430 -

模型

+关注

关注

1文章

3813浏览量

52261 -

天数智芯

+关注

关注

0文章

111浏览量

6671

原文标题:天垓100率先完成百亿级参数大模型训练,天数智芯迎来新的里程碑

文章出处:【微信号:IluvatarCoreX,微信公众号:天数智芯】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

天数智芯Day 0适配MiniMax最新开源M2.7大模型

昆仑芯率先完成智谱新一代旗舰模型GLM-5.1深度支持

天数智芯通用GPU产品Day 0适配GLM-5.1开源模型

天数智芯深度参编的超节点技术体系白皮书正式发布

天数智芯完成阿里云通义千问Qwen3.5系列多模态模型全量适配

欣旺达第100万颗684Ah叠片电芯顺利下线

在Ubuntu20.04系统中训练神经网络模型的一些经验

借助NVIDIA Megatron-Core大模型训练框架提高显存使用效率

万亿参数!元脑企智一体机率先支持Kimi K2大模型

兆芯率先展开文心系列模型深度技术合作

Say Hi to ERNIE!Imagination GPU率先完成文心大模型的端侧部署

天数智芯天垓100率先完成百亿级参数大模型训练

天数智芯天垓100率先完成百亿级参数大模型训练

评论