1 引言

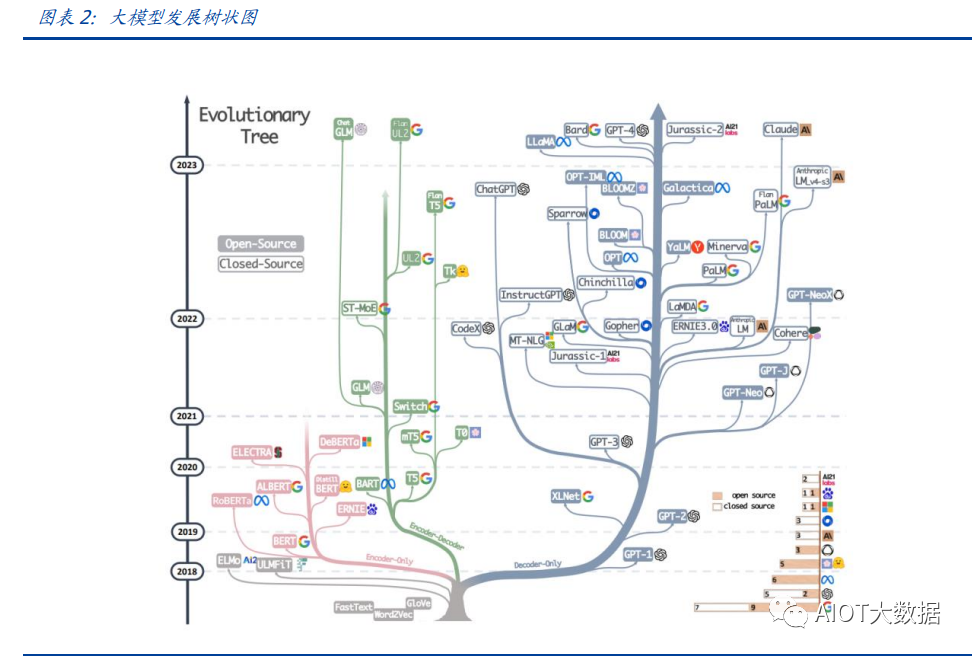

1.1 “谷歌和 OpenAI 都没有护城河,大模型门槛正被开源踏破”

“除非谷歌和 OpenAI 改变态度,选择和开源社区合作,否则将被后者替代”,据彭博 和 SemiAnalysis 报道,4 月初,谷歌工程师 Luke Sernau 发文称,在人工智能大语言模 型(Large Language Models,LLM,以下简称“大模型”)赛道,谷歌和 ChatGPT 的推 出方 OpenAI 都没有护城河,开源社区正在赢得竞赛。 这一论调让公众对“年初 Meta 开源大模型 LLaMA 后,大模型大量出现”现象的关注推 向了高潮,资本市场也在关注大公司闭源超大模型和开源大模型谁能赢得竞争,在“模 型”“算力”“数据”三大关键要素中,大模型未来竞争格局如何,模型小了是否就不再 需要大量算力,数据在其中又扮演了什么角色?……本报告试图剖析这波开源大模型风 潮的共同点,回顾开源标杆 Linux 的发展史,回答以上问题,展望大模型的未来。

1.2 开源大模型集中出现,堪称风潮

2 月 24 日,Meta 发布 LLaMA 开源大模型,此后,市场集中涌现出一批大模型,大致可 以分为三类。

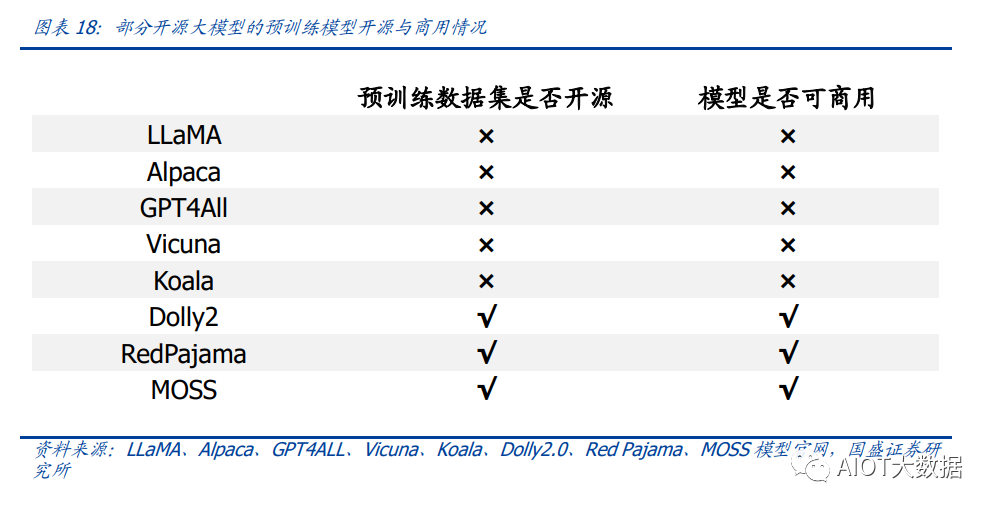

1.2.1 “LLaMA 系”:表现好,但商用化程度低

LLaMA 包括四个不同的参数版本(70 亿/130 亿/330 亿/650 亿),不支持商用,指令数 据集基于 OpenAI,模型表现可与 GPT-3 持平或优于 GPT-3。其中,70 亿和 130 亿参数 版拥有包含 1 万亿个标识符(Token)的预训练数据集;330 亿和 650 亿参数版拥有包 含 1.4 万亿个标识符的预训练数据集。在与 GPT-3 的对比中,LLaMA-70 亿参数版在常 识推理任务、零样本任务、自然问题和阅读理解中的表现与 GPT-3 水平相当,而 130 亿 参数及更高参数的版本模型在以上领域的表现均优于 GPT-3。

LLaMA 模型本身没有使用指令数据集,但考虑到效果优于 GPT-3 的 ChatGPT 使用了人 类指令数据集,一批开源大模型在 LLaMA 模型基础上,使用了 OpenAI 指令数据集来优 化模型的表现,包括 Alpaca、GPT4All、Vicuna、Koala、Open Assistant 和 Hugging Chat。 由于 OpenAI 指令数据集不可商用,因此这批基于 LLaMA 的开源大模型也都不可商用。

1.2.2 Dolly2.0、RedPajama、StableLM 等:商用化程度高

这些大模型没有使用 OpenAI 指令数据集,因此可以商用,但大多数还在持续开发中。

1.2.3 中文双子星:ChatGLM-6B 和 MOSS

ChatGLM-6B 和 MOSS 分别由清华大学和复旦大学相关研究团体推出,在中文社区知名 度较高。

2 共同点一:始于开源

2.1 为什么要开源?

市场对开源大模型的重要问题是,为什么要开源,这是否会损伤大模型行业的商业模式。 我们梳理了部分大模型对开源原因的自述,总结如下。

2.1.1 模型视角:防止大公司垄断,破除商业禁用限制

为了使人工智能研究民主化,弥合开放模型和封闭模型之间的质量差距,破除商业化禁 用限制,开源大模型的蓬勃发展有望促进以上目标。

2.1.2 数据视角:保护企业机密,使定制化数据训练成为可能

保障数据隐私,允许企业定制化开发。对于许多行业而言,数据是企业的命脉,大模型 的开源使得企业可以将自己的数据集在大模型上进行训练,同时做到对数据的控制,保 护企业数据隐私。同时,开源大模型允许企业的开发人员在模型的基础上进行定制化开 发,定向训练数据,也可以针对某些主题进行过滤,减少模型体量和数据的训练成本。

2.1.3 算力视角:降低算力成本,使大模型的使用“普惠化”

开源大模型节省了训练阶段的算力消耗,为企业降低算力成本,推动大模型使用“普惠 化”。算力总需求=场景数*单场景算力需求。在大模型的训练和使用中,算力消耗分为两 部分场景,即训练成本消耗及推理成本消耗。 就训练成本而言,大模型的训练成本高,普通企业的算力资源难以承受,而开源大 模型主要节省了企业预训练阶段的算力。但由于不同垂类的训练场景更加丰富,所 以整体训练需求是增长的。 就推理成本而言,大模型在参数体量庞大的情况下,其推理成本也很高,普通公司 难以维持其日常开销,因此,降低模型参数体量可进而降低企业在使用模型时的推 理成本。

2.2 开源,需要什么土壤?

开源大模型的蓬勃发展并非没有先例,全球规模最大的开源软件项目——Linux 有类似 的故事。研究 Linux 的发展史,对展望开源大模型的未来,有借鉴意义。

2.2.1 从开源标杆 Linux 说开去

Linux 是一款基于 GNU 通用公共许可证(GPL)发布的免费开源操作系统。所有人都 能运行、研究、分享和修改这个软件。经过修改后的代码还能重新分发,甚至出售,但 必须基于同一个许可证。而诸如 Unix 和 Windows 等传统操作系统是锁定供应商、以原 样交付且无法修改的专有系统。 许多全球规模最大的行业和企业都仰赖于 Linux。时至今日,从维基百科等知识共享网 站,到纽约证券交易所,再到运行安卓(一个包含免费软件的 Linux 内核专用发行版) 的移动设备,Linux 无处不在。当前,Linux 不仅是公共互联网服务器上最常用的操作系 统,还是速度排名前 500 的超级电脑上使用的唯一一款操作系统。

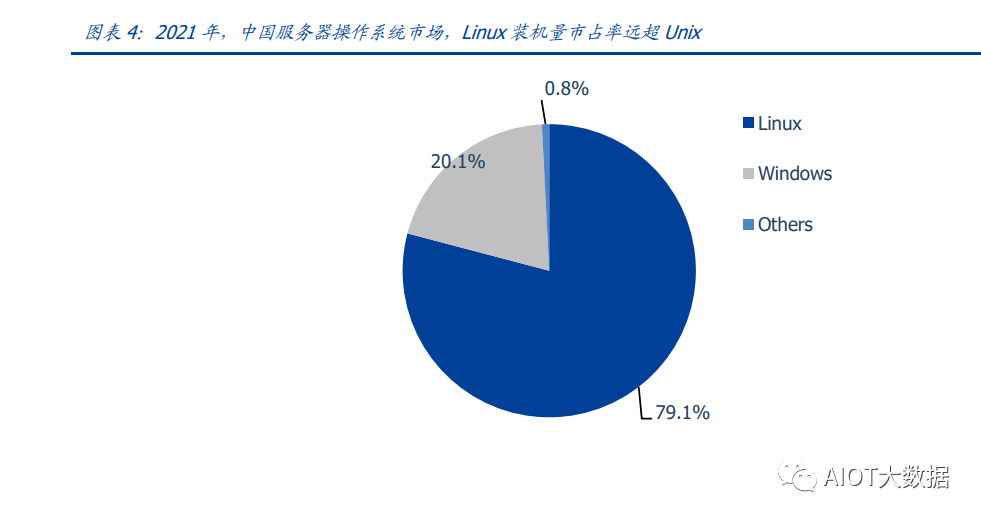

服务器市场,Linux 市占率已经远超操作系统“鼻祖”Unix,“Linux 时刻”发生。以 中国市场为例,根据赛迪顾问数据,按照装机量统计,在服务器架构上,Linux 是市场主 流,占据绝对领先地位,市场占有率达到 79.1%。Windows 市场占有率降至 20.1%, Unix 市场占有率仅剩 0.8%。

2.2.2 Linux 并非一己之作,借力于社区深厚的开源历史

Unix 开源过,为 Linux 提供了火种

Unix,现代操作系统的鼻祖。操作系统是指直接管理系统硬件和资源(如 CPU、内存和 存储空间)的软件,它位于应用与硬件之间,负责在所有软件与相关的物理资源之间建 立连接。而 Unix 被许多观点认为是现代操作系统的鼻祖。 Unix 曾开源。世界上第一台通用型计算机诞生于 1946 年,而 Unix 开发于 1969 年。在 长达十年的时间中,UNIX 拥有者 AT&T 公司以低廉甚至免费的许可将 Unix 源码授权给 学术机构做研究或教学之用,许多机构在此源码基础上加以扩展和改进,形成了所谓的 “Unix 变种”。后来 AT&T 意识到了 Unix 的商业价值,不再将 Unix 源码授权给学术机 构,并对之前的 Unix 及其变种声明了著作权权利。

Unix 回归闭源之后太贵,促成了 Linux 的开发

Linux 由 Linux Torvalds 于 1991 年设计推出,当时他还在读大学,认为当时流行的商业 操作系统 Unix 太贵了,于是基于类 Unix 操作系统 Minix 开发出了 Linux,并将其开放给 像自己这样负担不起的团队。

仅用于教学的 Minix,启发了 Linux 的开发

在 AT&T 将源码私有化后,荷兰阿姆斯特丹自由大学教授塔能鲍姆为了能在课堂上教授 学生操作系统运作的实务细节,决定在不使用任何AT&T的源码前提下,自行开发与UNIX 相容的作业系统,以避免版权上的争议。他以小型 UNIX(mini-UNIX)之意,将它称为 MINIX。第一版 MINIX 于 1987 年释出,只需要购买它的磁片,就能使用。在 Linux 系统 还没有自己的原生档案系统之前,曾采用 Minix 的档案系统。

开源社区、许可证与标准助力

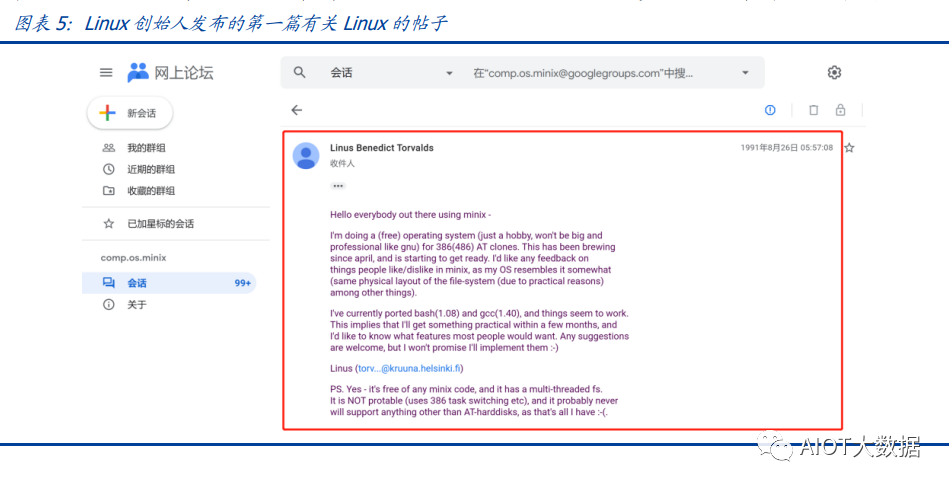

从开始就开源。1991 年 8 月,Linux 创始人 Linus Torvalds 将 Linux 发到 Minix Usenet 新闻组。随后他将 Linux 发布到 FTP 网站上,因为他想让更多人一起来开发这个内核。

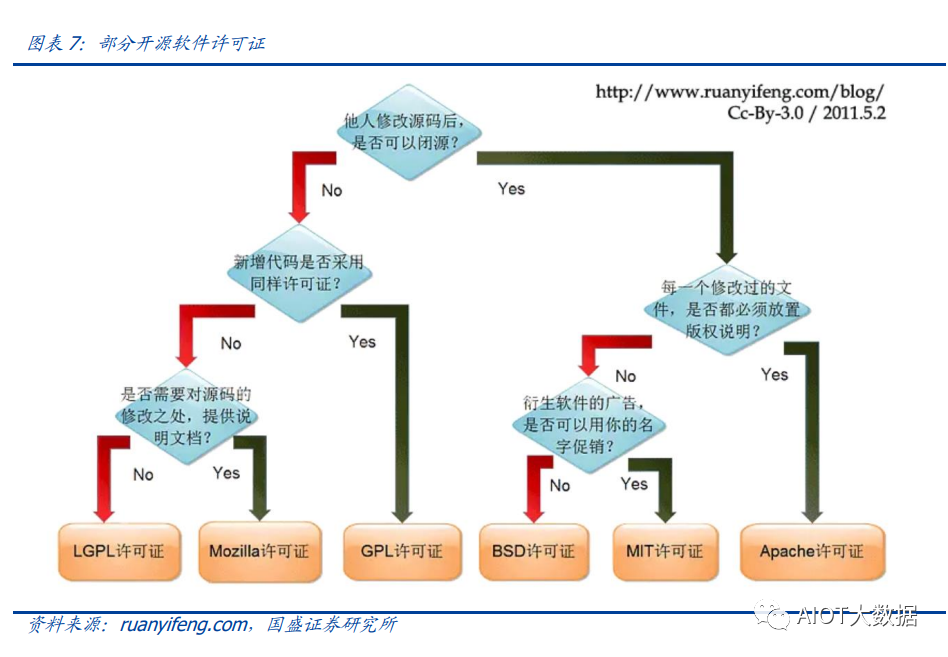

许可证助力生态开枝散叶、生生不息。Linux 基于 GNU GPL 许可证(GNU’s Not Unix General Public License,革奴计划通用公共许可证)模式。GPL 许可证赋予“自由软件” 赋予用户的四种自由,或称“Copyleft(公共版权)”: 自由之零:不论目的为何,有“使用”该软件的自由。 自由之一:有“研究该软件如何运作”的自由,并且得以“修改”该软件来符合用 户自身的需求。可访问源代码是此项自由的前提。 自由之二:有“分发软件副本”的自由,所以每个人都可以借由散布自由软件来敦 亲睦邻。 自由之三:有将“公布修订后的版本”的自由,如此一来,整个社群都可以受惠。 可访问源代码是此项自由的前提。 GPL 许可证要求 GPL 程序的派生作品也要在遵循 GPL 许可证模式。相反,BSD 式等许可 证并不禁止派生作品变成专有软件。GPL 是自由软件和开源软件的最流行许可证。遵循 GPL 许可证使得 Linux 生态能生生不息,不至于走进无法继续发展的“死胡同”。

标准对内使生态“形散而神不散”,对内拥抱“巨鲸”。 对内统一标准。Linux 制定了标准 LSB(Linux Standard Base,Linux 标准基础)来 规范开发,以免各团队的开发结果差异太大。因此,各 Linux 衍生开发工具只在套 件管理工具和模式等方面有所不同。我们认为,这使得 Linux 开源社区的发展“形 散而神不散”,使 Linux 生态的发展不至于分崩离析。 对外兼容 Unix。为了让 Linux 能兼容 Unix 软件,Linus Torvalds 参考 POSIX(Portable Operating System Interface,可携带式操作系统接口)标准修改了 Linux,这使得 Linux 使用率大增。该标准由 IEEE(Institue of Electrical and Electronics Engineers, 电气和电子工程师协会)于 20 世纪 90 年代开发,正是 Linux 的起步阶段,它致力 于提高 Unix 操作系统环境与类 Unix 操作系统环境下应用程序的可移植性,为 Linux 的推广提供了有利环境。

2.3 开源了,还怎么赚钱?

市场对“开源”的核心疑问是商业模式。“开源”本身免费,但“开源”作为土壤,“开 源社区”孕育出了各种商业模式,从 Linux 的生态中可以学习到这一点。

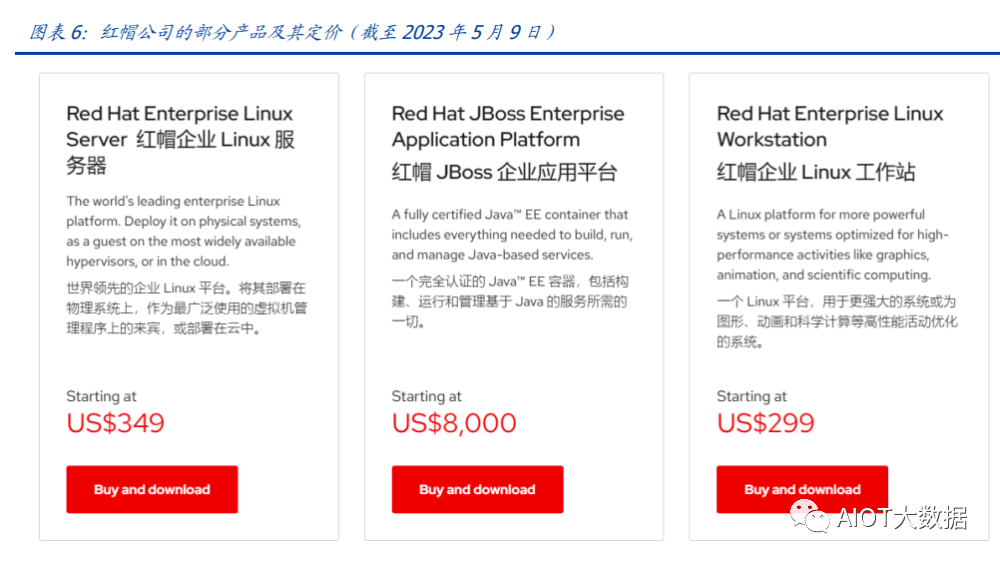

2.3.1 红帽公司(Red Hat):服务至上

红帽公司(Red Hat)是 Linux 生态的领军企业,超过 90%的《财富》500 强公司信赖红 帽公司,红帽作为公司的商业价值巨大。1993 年,红帽成立,1999 年,红帽即在纳斯 达克上市,红帽招股书援引 IDC 的数据称,截止到 1998 年所有经授权的新安装 Linux 操 作系统中,有 56%来自红帽;2012 年,红帽成为第一家收入超过 10 亿美元的开源技术 公司;2019 年,IBM 以约 340 亿美元的价格收购了红帽。 关于 Linux 和红帽的商业模式,就像好奇心日报打的比方,某种意义上,开源的 Linux 内 核像免费、公开的菜谱,红帽们像餐厅,人们仍然愿意去餐厅品尝加工好的菜肴和享受 贴心的服务。红帽面向企业提供 Linux 操作系统及订阅式服务,主要服务内容包括:1、 24*7 技术支持;2、与上游社区和硬件厂商合作,支持广泛的硬件架构,如 x86、ARM、 IBM Power 等;3、持续的漏洞警报、定向指导和自动修复服务;4、跨多个云的部署; 5、实时内核修补、安全标准认证等安全防护功能;6、检测性能异常、构建系统性能综 合视图,并通过预设调优配置文件应用等。

2.3.2 安卓系统(Android):背靠谷歌,靠广告变现

根据 Statcounter 数据,截至 2023 年 4 月,安卓系统(Android)是全球第一手机操作 系统,市占率高达 69%,远超第二名(iOS,31%)。安卓基于 Linux 内核开发,2005 年 被谷歌收购。随后,谷歌以 Apache 免费开放源代码许可证的授权方式,发布了安卓的 源代码,使生产商可以快速推出搭载安卓的智能手机,这加速了安卓的普及。 而关于商业模式,安卓手机预装的诸多服务由谷歌私有产品提供,例如地图、Google Play 应用商店、搜索、谷歌邮箱(Gmail)……因此,尽管安卓免费、开源,但谷歌仍能通过 其在移动市场“攻城略地”,将用户流量变现。

谷歌还直接向安卓手机厂商收取授权费,从 2018 年 10 月 29 日开始,使用安卓系统的 手机、平板电脑的欧盟厂商使用谷歌应用程序套件,必须向谷歌支付许可费,每台设备 费用最高达 40 美元(约 277 元)。

2.4 开源大模型主流许可证支持商用

开源社区已经有 GPL、BSD、Apache 等知名许可证。大模型方面,我们注意到,2023 年 2 月发布的、引领了大模型开源浪潮的 LLaMA 禁止商用,仅可用于研究,MetaAI 将根据 具体情况,授予公务员、社会团体成员、学术人员和行业研究实验室,访问该模型的权 限。其中,LLaMA 的推理代码基于 GPL3.0 许可证,这意味着:1)他人修改 LLaMA 的推 理代码后,不能闭源;2)新增代码也必须采用 GPL 许可证。不过,我们注意到,部分开 发人员在 LLaMA 基础之上开发的变体模型,有不同类型的许可证。例如,基于 nanoGPT 的LLaMA实现Lit-LLaMA新增了部分模型权重,这部分模型采用的许可证是Apache2.0。 开源大模型采用的协议主要是 Apache 2.0 和 MIT 许可证。Alpaca、Vicuna、Dolly、 OpenAssistant 和 MOSS 均采用 Apache 2.0 许可证,Koala 和 GPT4all 采用 MIT 许可证。 这两个许可证均允许商用。但令人惋惜的是,Alpaca、Vicuna、Koala 和 GPT4all 因 OpenAI 或 LLaMA 限制无法商用。同时,值得注意的是,Apache2.0 和 MIT 许可证均允许再修改 源码后闭源,公司可以在开源大模型基础上开发自己的模型,或对公司更有吸引力。

3 共同点二:开源大模型参数少、小型化

3.1 超大模型和大模型分别多大?

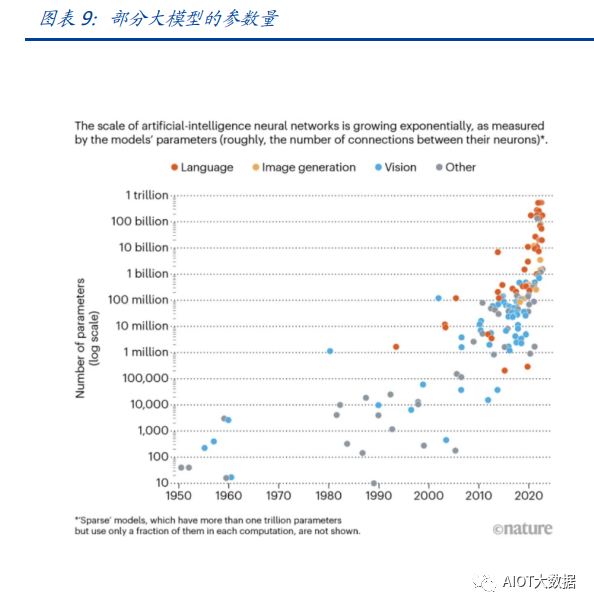

预训练赋予模型基本能力。在自然语言处理(NLP)中,预训练是指在特定任务微调之 前,将语言模型在大量文本语料库上训练,为模型赋予基本的语言理解能力。在预训练 过程中,模型被训练以根据前面的上下文预测句子中的下一个单词。这可以通过掩盖一 些输入中的单词并要求模型预测它们的方式进行,也可以采用自回归的方法(例如 GPT), 即根据句子中的前面单词预测下一个单词。 预训练模型通常包括大量的参数和对应的预训练数据(通常用标识符即 Token 的数量衡 量)。2017 年谷歌大脑团队 Transformer(变换器)模型的出现,彻底改变了 NLP 的面 貌,使得模型可以更好地理解和处理语言,提高 NLP 任务的效果和准确性。

超大模型和大模型分别多大?语言模型的大小是根据其参数量来衡量的,参数量主要描 述了神经元之间连接强度的可调值。目前一般大语言模型参数量在几十到几百亿之间, 超过千亿参数的我们称为“超大模型”,例如 GPT-3(1750 亿参数)。

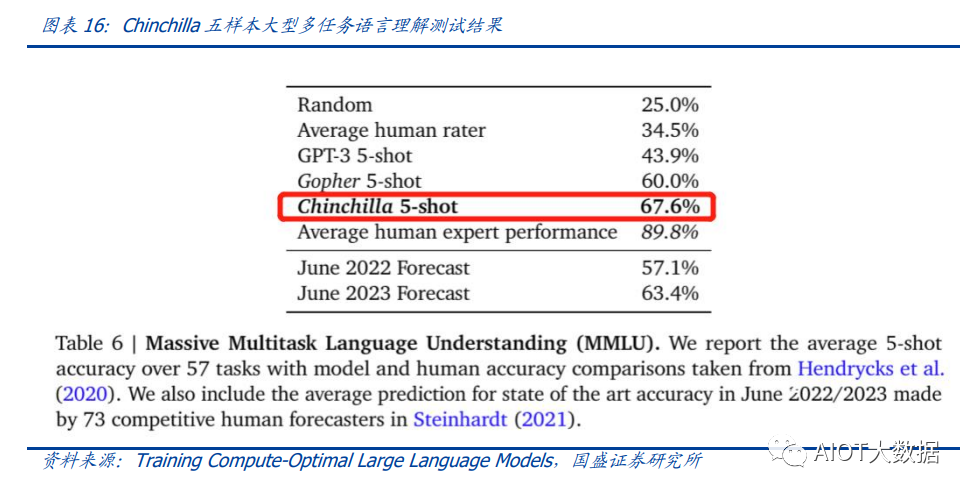

3.2 GPT 系超大模型能力最强,但难复现

大模型的性能评价标准并没有统一。一个重要原因是大模型生成内容的任务种类多,不 同的应用场景和任务可能需要不同的指标和方法去评估模型的表现。其中部分任务可能 有公信力较强的评分标准,如机器翻译中的 BLEU,但大部分任务缺乏类似标准。 模糊共识是超大模型性能好。大语言模型目前的发展趋势是越来越大,原因 是大模型在预训练后就具有较好通用性和稳定性。例如,谷歌团队的超大模型 PaLM (5400 亿参数),在零样本和少量样本测试中均有良好的成绩,并且随着其训练标识符数量的上升,性能仍能提升。这也不难理解,简单来说,模型见得多了,自 然会的也多了。

“同行评议”,GPT 系大模型“风华绝代”。当前,OpenAI GPT 系的超大模型拥有着强 大的能力和广泛的应用,在处理自然语言任务时具有高准确性和强大的表达能力,其在 文本生成、问答系统、机器翻译等多个领域都取得了出色效果,成为了当前自然语言处 理领域的标杆之一,被各类大模型当作比较基准。复现 ChatGPT 的门槛并没有降低,开 源大模型大部分仅在某些方面有较好的表现,整体质量与 ChatGPT 仍不可比,尚需观望。

3.2.1 Vicuna:利用 GPT-4 评估

目前大部分开源大模型性能未进行系统评价,更多处在起步试验阶段。在对性能进行评 价的开源大模型中,Vicuna 的报告中利用 GPT-4 进行的评估相对较为系统,结果也最令 人瞩目。

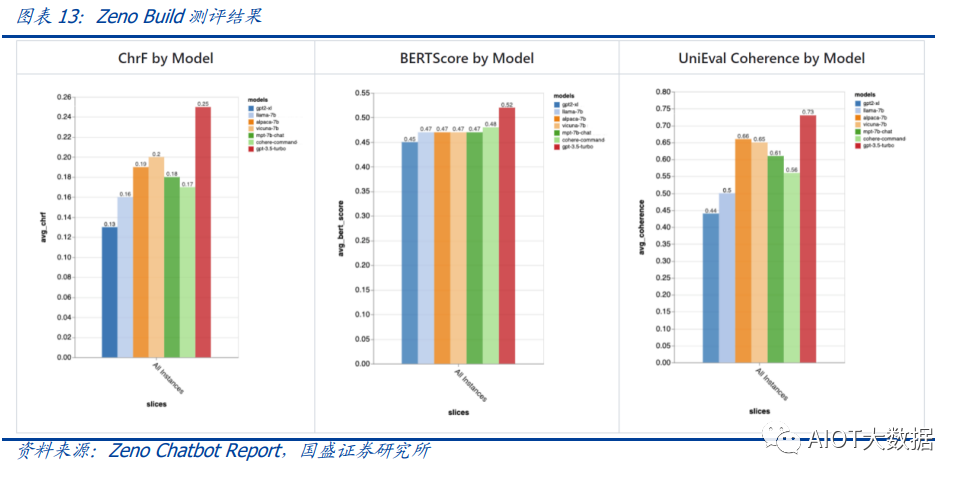

3.2.2 Zeno Build 测评:较新,较全面

Zeno Build 对 GPT-2、LLaMA、Alpaca、Vicuna、MPT-Chat、Cohere Command、ChatGPT (gpt-3.5-turbo)七个模型测评,结果与 GPT-4 评价结果相近。ChatGPT 有明显优势, Vicuna 在开源模型中表现最佳。

3.2.3 C-Eval:全面的中文基础模型评估套件

C-Eval 评估结果显示,即便是在中文能力上,GPT-4 也是一骑绝尘,但 GPT-4 也仅能达 到 67%的正确率,目前大模型的中文处理能力尚有很大提升空间。

3.2.4 GPT 系超大模型训练成本高,短期内难复现

ChatGPT 所需算力和训练成本可观。不考虑与日活高度相关的推理过程所需的算力,仅 考虑训练过程,根据论文《Language Models are Few-Shot Learners》的测算,ChatGPT 的上一代 GPT-3(1750 亿参数版)所需的算力高达 3640PF-days(即假如每秒做一千万 亿次浮点运算,需要计算 3640 天),已知单张英伟达 A100 显卡的算力约为 0.6PFLOPS, 则训练一次 GPT-3(1750 亿参数版),大约需要 6000 张英伟达 A100 显卡,如果考虑互 联损失,大约需要上万张 A100,按单张 A100 芯片价格约为 10 万元,则大规模训练就 需要投入约 10 亿元。OpenAI 在 GPT-3(1750 亿参数)的训练上花费了超过 400 万美 元,而为了维持 ChatGPT 和 GPT4(参数量未公布,预计更高)的运转,每个月理论上 更高。

3.3 开源大模型性价比高,超大模型以下大模型的壁垒正在消失

开源大模型小型化趋势明显,参数约为百亿级别,成本降低乃题中之义。开源大模型通 常具有较少的参数,在设计、训练和部署上,需要的资源和成本都相对较低。这波开源 大模型的参数普遍较小,均在十亿~百亿级别左右。

“船小好调头”,基于已有的开源预训练模型进行微调也是开源大模型的优势之一。在预 训练模型基础上进行微调和优化,以适应不同的任务和应用场景,这种方法不仅可以大 大缩短模型的训练时间和成本,而且还可以提高模型的性能和效率。 更多标识符训练数据和新技术,让超大模型以下的大模型壁垒趋于消失。LLaMA 被“开 源”,让大家都有了一个可上手的大模型,并且随着 DeepSpeed、RLHF 等技术的发展, 几百亿的模型可以部署在消费级 GPU 上。

4 共同点三:开源大模型数据集重视人类指令,并自立门户

4.1 学习 ChatGPT 方法论,引入人类指令数据集

微调是提升特定性能的捷径。微调是指在已经预训练的模型上,使用具有标注数据的特 定任务数据集,进一步小规模训练。微调可以以较小的算力代价,使模型更加适应特定 任务的数据和场景,从而提高模型的性能和准确性。目前微调多为指令微调,指令数据 集逐渐成为开源大模型的标配。 RLHF(Reinforcement Learning from Human Feedback,基于人类反馈的强化学习),是 一种新兴的微调方法,它使用强化学习技术来训练语言模型,并依据人类反馈来调整模 型的输出结果。RLHF(基于人类反馈的强化学习)是 ChatGPT 早期版本 GPT3 所不具备 的功能,它使得只有 13 亿参数的 InstructGPT 表现出了比 1750 亿参数 GPT-3 更好的真 实性、无害性和人类指令遵循度,更被标注员认可,同时不会折损 GPT-3 在学术评估维 度上的效果。

RLHF(基于人类反馈的强化学习)分为三个步骤:1)监督微调(SFT):让标注员回答 人类提问,用这一标注数据训练 GPT;2)奖励模型(RM)训练:让标注员对机器的回 答排序,相较于第一步由标注员直接撰写回答的生成式标注,排序作为判别式标注的成 本更低,用这一标注训练模型,让它模拟人类排序;3)无人类标注,用近端策略优化算 法(PPO)微调模型。 这三个步骤对应的数据集的大小分别为 1.3 万个、3.3 万个、3.1 万个。

对于具有大量数据和一定算力的公司来说,使用自己的数据进行微调可以展现出模型的 特化能力,并且用较小的算力达成接近大模型的效果。如多校联合开发的 Vicuna 语言模 型,基于 Meta 的 LLaMA-130 亿参数版模型,对 7 万条用户分享的 ChatGPT 对话指令微调,部分任务上,达到了 92%的 GPT4 的效果。在通用性和稳定性上无法超过超大模型, 但可以通过微调强化其某些方面的能力,性价比要更高,更适合中小公司应用。

4.2 数据集走向商用

数据集是语言模型发展的重要基础和支撑,通常是由公司或组织自主收集、整理或直接 购买获得。相比之下,开源数据集大多由社区或学术界共同维护的,其数据量和种类更 加丰富,但可能存在一定的数据质量问题和适用性差异。

4.2.1 预训练数据集少量可商用

预训练数据集开源对模型商用至关重要。在后 LLaMA 时代,开源大模型犹如雨后春笋般 涌现,但很快大家便发现由于 LLaMA 和 OpenAI 的限制,基于其开发的模型无法商用 (Alpaca、Koala、GPT4All、Vicuna),为了打破这一局面,Dolly2.0 率先出手,“为了解 决这个难题,我们开始寻找方法来创建一个新的,未被“污染”的数据集以用于商业用 途。”随后 Red Pajama 和 MOSS 接踵而至。

4.2.2 指令数据集部分可商用

打造开源生态,各取所需。在早期开源项目中,因其指令数据及多来自 ChatGPT 生成 或对话内容,受 OpenAI 限制无法商用。除去研究用途微调外,目前越来越多模型选择 自己构建指令数据集来绕开这一限制。 指令数据集多样化,部分模型的指令数据集可商用化。按照上文对此批集中出现的大模 型的分类,除去 LLaMA、基于 LLaMA 开发出的模型以及 StableLM 使用 OpenAI 的指令 数据集外,其余大模型的指令数据集均不基于 OpenAI,也因此这些大模型的指令数据集 可商用化,这会加快推动使用且重视 RLHF(基于人类反馈的强化学习)训练范式的此类 大模型的更迭与发展。

5 展望

5.1 多模态化:助力通用人工智能(AGI)发展

多模态开源大模型开始出现,将大模型推向新高潮,助力人类走向通用人工智能。多模 态即图像、声音、文字等多种模态的融合。多模态模型基于机器学习技术,能够处理和 分析多种输入类型,可以让大模型更具有通用性。基于多领域知识,构建统一、跨场景、 多任务的模型,推动人类走向通用人工智能(Artificial General Intelligence,AGI)时代。

5.1.1 ImageBind 闪亮登场,用图像打通 6 种模态

ImageBind 开源大模型可超越单一感官体验,让机器拥有“联想”能力。5 月 9 日, Meta 公司宣布开源多模态大模型 ImageBind。该模型以图像为核心,可打通 6 种模态, 包括图像(图片/视频)、温度(红外图像)、文本、音频、深度信息(3D)、动作捕捉传 感(IMU)。相关源代码已托管至 GitHub。该团队表示未来还将加入触觉、嗅觉、大脑磁 共振信号等模态。 从技术上讲,ImageBind 利用网络数据(如图像、文本),并将其与自然存在的配对数据 (如音频、深度信息等)相结合,以学习单个联合嵌入空间,使得 ImageBind 隐式地将 文本嵌入与其他模态对齐,从而在没有显式语义或文本配对的情况下,能在这些模态上 实现零样本识别功能。 目前 ImageBind 的典型用例包括:向模型输入狗叫声,模型输出狗的图片,反之亦可; 向模型输入鸟的图片和海浪声,模型输出鸟在海边的图片,反之亦可。

5.1.2 开源大模型的多模态探索集中于图片,但进展飞快

当前开源大模型在多模态的探索仍处于初级阶段,除 ImageBind 打通了六种模态外,多 数仍在探索文本与图像的融合,但速度相当快,我们梳理了其中部分。

VisualGLM-6B:可在消费级显卡上本地部署

团队:VisualGLM-6B 是开源大语言模型 ChatGLM-6B 的多模态升级版模型,支 持图像、中文和英文,由清华大学知识工程和数据挖掘小组发布。 技术:VisualGLM-6B 是由语言模型 ChatGLM-6B 与图像模型 BLP2-Qformer 结 合,二者结合后的参数为 78 亿(62 亿+16 亿)。该模型使用的预训练数据集是 CogView 数据集中 3000 万个高质量的“中文图像-文本”和 3 亿个“英文图像 -文本”对。在微调阶段,该模型在长视觉问答数据集上进行训练,以生成符合 人类偏好的答案。 性能:根据 DataLearner,VisualGLM-6B 集成了模型量化技术,用户可以在消 费级显卡上本地部署模型,INT4 量化级别只需要 8.7G 的显存。这意味着即使 是拥有游戏笔记本的用户也可以快速且私密地部署这个模型,这在此类大小的 ChatGPT 类模型中尚属首次。

UniDiffuser:为多模态设计的概率建模框架 UniDiffuser

团队:清华大学计算机系朱军教授带领的 TSAIL 团队于 3 月 12 日公开的一篇 论文《One Transformer Fits All Distributions in Multi-Modal Diffusion at Scale》, 进行了一些多模态的探索。 技术:UniDiffuser 采用该团队提出的基于 Transformer 的网络架构 U-ViT,在开 源的大规模图文数据集 LAION 的 50 亿参数版上,训练了一个十亿参数量的模 型,使得其能够高质量地完成多种生成任务。 功能:简单来讲,该模型除了单向文生图,还能实现图生文、图文联合生成、 无条件图文生成、图文改写等多种功能,实现了任意模态之间的相互转化。

LLaVA:部分指令表现可比肩 GPT-4

团队:由威斯康星大学麦迪逊分校,微软研究院和哥伦比亚大学共同出品的 LLaVA,在 GitHub 上开源了代码、模型和数据集。 技术:LLaVA 是一个端到端的多模态大模型,它连接了一个视觉编码器和大语 言模型,用于通用的视觉和语言理解。 功能: 以文本为基础的任务:LLaVA 可以处理并分析文本,允许用户问问题,可以 和用户交谈,或者完成用户输入的任务,比如提炼文件概要、情感分析、实 体识别等。 以图像为基础的任务:LLaVA 可以分析图像,描述图像,进行物体识别,分 析理解场景。 性能:早期实验表明,LLaVA 的多模态聊天能力有时在未见过的图像/指令上都 能输出比肩 GPT-4 的表现,在合成的多模态指令跟随数据集上与 GPT-4 相比, 获得了 85.1%的相对分数。

MiniGPT-4:脱胎于 LLaMA 的多模态开源大模型,个人用户的 GPT-4“平替”

团队:多模态 GPT-4 大模型的发布,将大众对于大模型的热情推到了一个新的高潮。但是 GPT-4 并没有完全免费开放给个人,要想使用 GPT-4,要么需要通 过官方的邀请,要么需要升级到付费账号。但即使付费,一些地区也无法进行 相关服务的购买。在这种环境下,阿布杜拉国王科技大学的 Deyao Zhu、Jun Chen 等人于 4 月 23 日发布了 MiniGPT-4,旨在将来自预训练视觉编码器的视 觉信息与先进的大语言模型结合。 技术:具体来说,MiniGPT-4 采用了与 BLIP-2 相同的预训练视觉组件,其中该 组件由 EVA-CLIP 的 ViT-G/14 和 Q-Former 组成,同时使用大语言模型 Vicuna 调优,可以执行各种复杂的语言任务。 功能:MiniGPT-4 可实现许多玩法,如上传一张海鲜大餐照片,即可得到菜谱; 上传一张商品效果图,即可获得一篇带货文案;手绘一个网页,即可得到对应 的 HTML 代码。据使用过的人士反馈,MiniGPT-4 整体效果不错,但目前对中文 支持还有待提高。

mPLUG-Owl:模块化多模态大模型

团队:mPLUG-Owl 是阿里巴巴达摩院 mPLUG 系列的最新工作,延续 mPLUG 系列的模块化训练思想,将语言大模型迁移为多模态大模型。 技术:mPLUG-Owl 采用 CLIP ViT-L/14 作为视觉基础模块,采用 LLaMA 初始化 的结构作为文本解码器,采用类似 Flamingo 的 Perceiver Resampler 结构对视 觉特征进行重组。此外,mPLUG-Owl 第一次针对视觉相关的指令评测提出了全 面的测试集 OwlEval。 功能:mPLUG-Owl 具有很强的多轮对话能力、推理能力及笑话解释能力。此外, 研究团队还观察到 mPLUG-Owl 初显一些意想不到的能力,比如多图关联、多 语言、文字识别和文档理解等能力。 性能:实验证明 mPLUG-Owl 在视觉相关的指令回复任务上优于 BLIP2、LLaVA、 MiniGPT4。

5.2 专业化:下游生态发力,针对特定任务微调模型

大模型开源化为下游生态的蓬勃生长提供了绝佳机会,在细分产业的开发下,大模型开 始在特定任务上深化开发,改变人类生活。自开源大模型 LLaMA 推出后,基于 LLaMA 预 训练模型微调的下游专业化模型开始浮现,例如医疗问诊领域中的华驼。

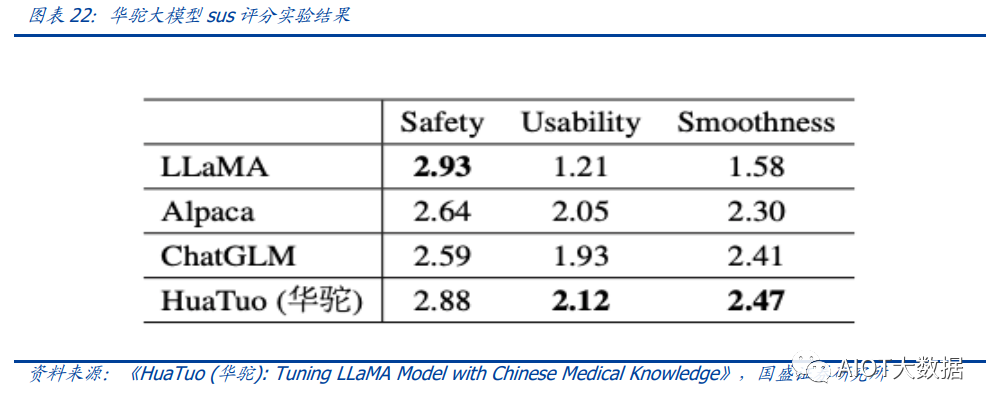

团队:华驼是基于中文医学知识的 LLaMa 指令微调模型,在智能问诊层面表现出色, 可生成一些更为可靠的医学知识回答。在生物医学领域,已发布的大语言模型模型 因为缺乏一定的医学专业知识语料而表现不佳。4 月 14 日,哈尔滨工业大学一团队 发布了其对 LLaMa 模型进行指令微调后得到的、针对医学领域的、开源智能问诊模 型 Hua Tuo。

技术:LLaMA 拥有 70 亿~650 亿参数等多个版本,为了更快速、高效地训练,节约 训练成本,华驼采用了 LLaMA70 亿参数版本作为基础模型。为了保证模型在医学领 域回答问题的准确性,研究人员通过从中文医学知识图谱 CMeKG 中提取相关的医 学知识,生成多样的指令数据,并收集了超过 8000 条指令数据进行监督微调,以 确保模型回答问题的事实正确性。

性能:在模型效果上,华驼与其他三个基准模型进行了比较。为了评估模型性能, 研究人员招募了五名具有医学背景的专业医师,在安全性、可用性、平稳性(SUS) 三个维度上进行评估。SUS 刻度从 1(不可接受)到 3(好),其中 2 表示可接受的 响应。平均 SUS 得分如下图所示。结果表明,华驼模型显著提高了知识可用性,同 时没有太多地牺牲安全性。

华驼或将是未来开源大模型下游的特定任务模型发展的范式,即采用低参数体量的小型 开源大模型作为基础模型,加之以特定专业领域的数据进行训练,得到表现更好的细分 领域模型。

6 投资分析

6.1 微软:与 OpenAI 深度合作

我们认为,短期内,ChatGPT 系仍是能力最强的大模型,与其深度合作的微软将受益。 股权上,根据《财富》杂志报道,在 OpenAI 的第一批投资者收回初始资本后,微 软将有权获得 OpenAI 75%利润,直到微软收回投资成本(130 亿美元);当 OpenAI 实现 920 亿美元的利润后,微软的份额将降至 49%。与此同时,其他风险投资者和 OpenAI 的员工,也将有权获得 OpenAI 49%的利润,直到他们赚取约 1500 亿美元。 如果达到这些上限,微软和投资者的股份将归还给 OpenAI 非营利基金会。 产品上,除了让搜索引擎必应(Bing)整合 ChatGPT,2023 年 1 月,微软宣布推出 Azure OpenAI 服务,Azure全球版企业客户可以在云平台上直接调用OpenAI模型, 包括 GPT3.5、Codex 和 DALL.E 模型,其后不久,微软宣布将 GPT4 整合到了新必 应和 Office 升级版 Copilot 上。

6.2 英伟达:开源大模型带动应用风起,算力需求狂飙

算力服务是开源大模型浪潮中受益确定性较强的方向,在软硬件一体化方面具有明显的 领先优势,是当前 AI 算力的领头羊。

6.2.1 超大模型对算力的需求将保持高增长

超大模型质量优势突出,市场将持续追捧,其对算力的需求会一直增长。超大型模型具 有强大的表达能力和高准确性,在质量上具有优势,市场将持续追捧这种模型。超大模 型规模、数据集和日活持续扩大,所需算力将持续增多。

6.2.2 开源大模型的快速追赶也将利好算力

短期内,市场对开源大模型持观望态度。开源大模型在通用性上表现较差,短时间内无 法与大型模型抗衡,加之目前难以系统评价模型的具体性能,市场对开源大模型持观望 态度,等待它们证明自己的性能和优势。 中长期看,开源大模型有望进一步提高性能,从而在市场上占据更大的份额。相较于超 大模型,开源大模型具有更低的算力需求和更易于部署的特点,还可以通过快速微调等 方式,针对某些专业领域优化,具备一定吸引力和实用性。在中长期内,如果有开源大 模型能够接近或超越 ChatGPT 在质量上的表现,那么市场对这类模型的需求可能会迅速 上升。相应地,这类算力需求会很快起量。

6.2.3 催化剂:开源大模型许可证、标准和能力评价体系的发展

许可证:我们认为,开源社区发展已久的许可证体系,丰富了开发者的选择,有助 于大模型选择适合自己的许可证,从而推动商业应用。大模型的繁荣发展,显然将 带动市场对算力的需求。

标准:我们预计,大模型社区或许还将产生类似于 Linux 开发标准 LSB 的标准,适 当的标准化将使得大模型的生态不至于过于分散。我们看好开源社区源源不断的生命力对英伟达等算力服务商业绩的推动。

大模型能力评价体系:有公信力的大模型能力评价体系将有助于市场快速分辨大模 型的能力,有助于大模型赛道的发展。

6.3 Meta:开源“急先锋”,受益于开源生态

回顾安卓的发展史,我们看好“谷歌-安卓”体系中的类谷歌角色,在该体系中,谷歌作 为开源操作系统安卓的开发商,将开源作为激励生态上下游发展的工具,增强自身专有 服务在终端客户的曝光度。 映射到大模型,我们认为,开源了 LLaMA 的 Meta,可能通过 LLaMA,加深与下游大模 型开发厂商的合作,将自身体系中的专有产品,绑定销售给客户。

审核编辑 :李倩

-

Linux

+关注

关注

88文章

11817浏览量

219555 -

AI

+关注

关注

91文章

41118浏览量

302608 -

人工智能

+关注

关注

1820文章

50325浏览量

266967 -

模型

+关注

关注

1文章

3818浏览量

52269 -

数据集

+关注

关注

4文章

1240浏览量

26261

原文标题:技术与市场:AI大模型的“Linux时刻”降临

文章出处:【微信号:AIOT大数据,微信公众号:AIOT大数据】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

AI大模型微调企业项目实战课

技术与市场:AI大模型的“Linux时刻”降临

技术与市场:AI大模型的“Linux时刻”降临

评论