还在为图像加载犯愁吗? 最新的好消息是,谷歌团队采用了一种GANs与基于神经网络的压缩算法相结合的图像压缩方式HiFiC,在码率高度压缩的情况下,仍能对图像高保真还原。

GAN(Generative Adversarial Networks,生成式对抗网络)顾名思义,系统让两个神经网络相互「磨炼」,一个神经网络负责生成接近真实的数据,另一个神经网络负责区分真实数据与生成的数据。

简单来说,就是一个神经网络「造假」,另一个神经网络「打假」,而当系统达到平衡时,生成的数据看起来便会非常接近真实数据,达到「以假乱真」的效果。

下面是这种算法展现出来的图像与JPG格式图像的对比。 可见,在图像大小接近的情况下(HiFiC大小74kB,JPG图像大小78kB),算法所展现出来的图像压缩效果要好得多。

而在与原图进行对比时,HiFiC所展现出来的还原效果仍然非常优秀。(真的不是在原图中间画了条线吗?)

目前处于特殊时期,大量国外网友仍在家中隔离,Netflix和油管的播放量暴增,一些视频网站甚至不得不被迫降低视频在线播放的清晰度,以适应激增的数据量。

但看惯了高清视频的网友们,面对突如其来的「模糊打击」自然怨声载道。

用一位网友的话来说,如果视频行业也能被应用类似的技术,相信Netflix和油管会特别高兴,毕竟这种高清低码率的图像复原实在太诱惑。

哇,如果他们可以对视频做同样的事情的话,我相信Netflix和YouTube会很高兴的。

事实上,在了解HiFiC算法的原理后,会发现它的确不难实现。

接近原图的图像重构算法

此前,相关研究已有采用神经网络进行图像压缩的算法,而随着近年来生成式对抗网络兴起,采用GANs生成以假乱真图像的算法也不在少数。

如果能有办法将二者结合,图像压缩的效果是不是会更好、更接近于人类的感知?

这次图像压缩的模型便是基于二者的特性设计,在基于神经网络的压缩图像算法基础上,采用GANs进一步让生成的图片更接近于人类视觉,在图像大小和视觉感知间达到一个平衡。

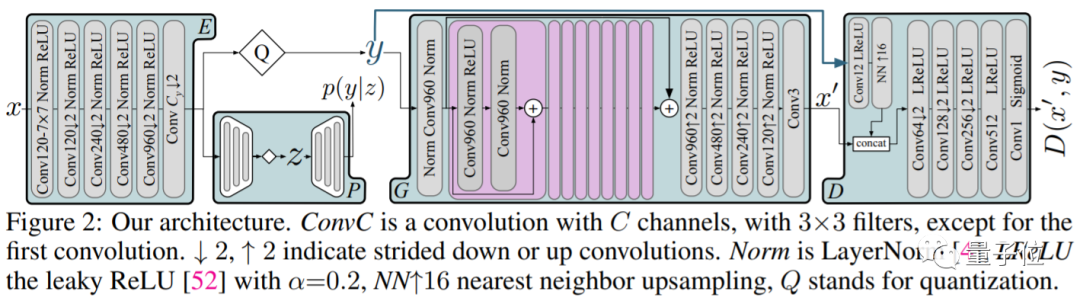

可以看见,HiFiC的架构被分成了4个主要部分,其中E为编码器,G为生成器,D为判别器,而P则是E的输出E(x)的概率模型(这里用y表示),也就是P用于模拟y的概率分布。

GANs运作的核心思想在于,需要让架构中的生成器G通过某种方法,「欺骗」判别器D判定样本为真。

而概率模型P,则是达成这步操作的条件。

然后,将E、G、P参数化为卷积神经网络,这样就可以通过率失真优化的条件,对这些网络进行共同训练。

同时,研究者也对已有的几种GANs算法架构进行了微调,使其更适于HiFiC架构。

研究发现,将GANs与深度学习相结合的HiFiC算法取得了意想不到的效果。

模型评估

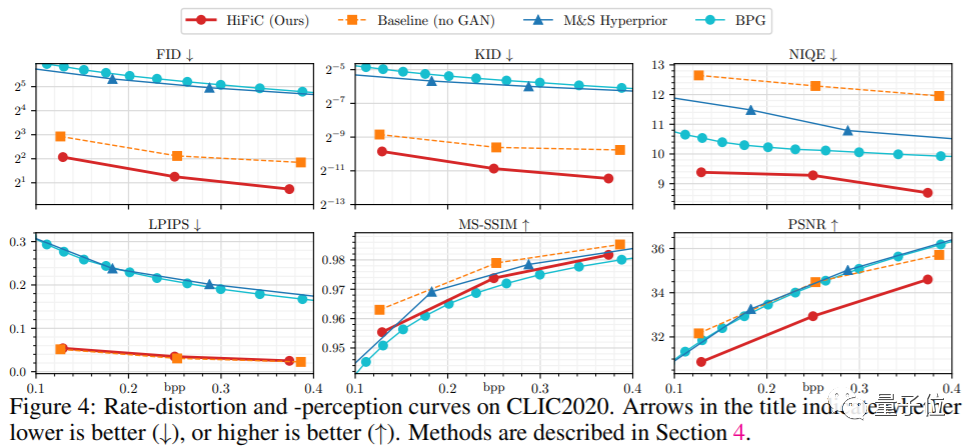

下图是采用目前几种主流图像质量评估标准,对几种前沿的图像压缩算法与HiFiC算法进行比较的结果。

在图中,评估标准后面自带的箭头,表示数据更低(↓)或数据更高(↑)表示图像质量更好。

为了更好地对比,结果分别采用了HiFiC算法(图中红点连线)、不带GANs的对比算法(图中橙方连线)、目前较为前沿的M&S算法(图中蓝方连线)和BPG算法(图中蓝点连线)。

从结果来看,HiFiC算法在FID、KID、NIQE、LPIPS几种评估标准均为最优,而在MS-SSIM和PSNR标准中表现一般。

由评估标准间的差异可见,各项图像质量标准不一定是判断压缩技术的最好办法。

用户评测对比

毕竟,图像是用来看的,最终的判断权还得交回用户手里。

图像究竟是否「清晰」,某种程度上得通过人眼的判断来决定。

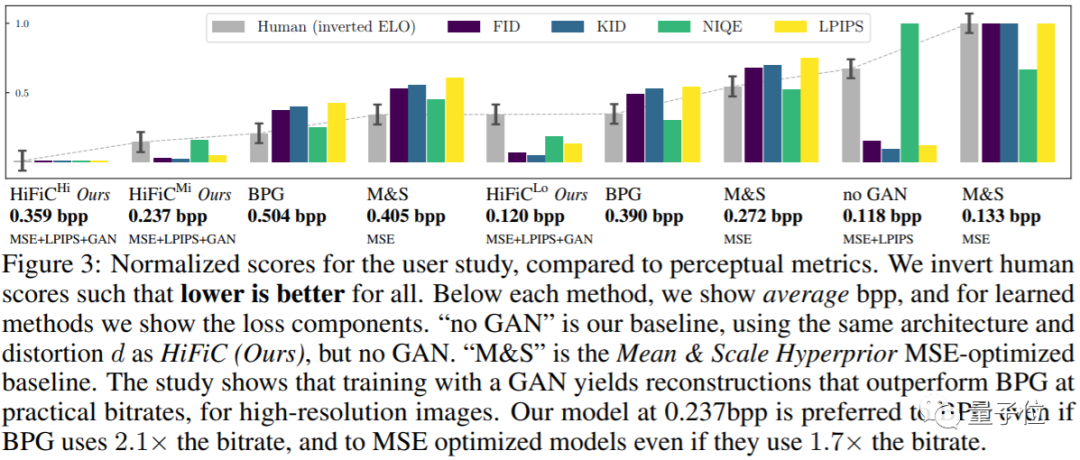

出于这个考虑,团队采取了调研模式,让一部分志愿者参与算法的比较。

他们先展示一张测试图片的随机裁切图样,当志愿者对其中某张裁切图样感兴趣时,便用这一部分来进行所有算法的对比。

志愿者将原图与经过算法处理后的图像对比后,选出他们认为「视觉上」更接近于原图的压缩算法。

在所有算法经过选取后,将会出现一个排名,以衡量HiFiC的实际效果。(其中,HiFiC的角标Hi、Mi和Lo分别为设置由高至低3种不同码率阈值时的算法)

上图中,评分越低,则代表图像在用户眼中「越清晰」。从图中来看,HiFiC(Mi)在0.237bpp的压缩效果下,甚至比两倍码率的0.504bpp的BPG算法在用户眼里还要更好。

即使压缩效果达到了0.120bpp,也比0.390bpp的BPG算法更好。

这项研究再次推动了图像压缩技术的发展,正如网友所说,随着图像压缩技术的发展,在线看4k电影也许真能实现。

-

谷歌

+关注

关注

27文章

6259浏览量

112002 -

神经网络

+关注

关注

42文章

4844浏览量

108203

发布评论请先 登录

为什么 VisionFive V1 板上的 JH7100 中并存 NVDLA 引擎和神经网络引擎?

面向嵌入式部署的神经网络优化:模型压缩深度解析

CNN卷积神经网络设计原理及在MCU200T上仿真测试

NMSIS神经网络库使用介绍

在Ubuntu20.04系统中训练神经网络模型的一些经验

CICC2033神经网络部署相关操作

液态神经网络(LNN):时间连续性与动态适应性的神经网络

神经网络的并行计算与加速技术

无刷电机小波神经网络转子位置检测方法的研究

神经网络专家系统在电机故障诊断中的应用

神经网络RAS在异步电机转速估计中的仿真研究

基于FPGA搭建神经网络的步骤解析

AI神经网络降噪算法在语音通话产品中的应用优势与前景分析

谷歌采用GANs与神经网络打造图像压缩新算法

谷歌采用GANs与神经网络打造图像压缩新算法

评论