机器学习的发展历程

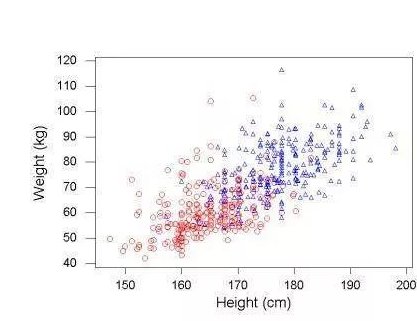

对于20世纪90年代以前的发展历程,我认识不够,了解不深,觉得当时机器学习处于发展的相对平淡期。而20世纪90年代中期到21世纪00年代中期是机器学习发展的黄金时期,主要标志是学术界涌现出一批重要成果,比如,基于统计学习理论的支持向量机、随机森林和Boosting等集成分类方法,概率图模型,基于再生核理论的非线性数据分析与处理方法,非参数贝叶斯方法,基于正则化理论的稀疏学习模型及应用等等。这些成果奠定了统计学习的理论基础和框架。

然而,机器学习在21世纪00年代末也经历了一个短暂的徘徊期。那时我在加州大学伯克利分校的博士后工作结束,正面临找工作,导师乔丹教授和我进行了多次交流,他一方面认为机器学习正处于困难期,工作职位已趋于饱满,另一方面他向我一再强调,把统计学引入到机器学习的思路是对的,因为以统计学为基础的机器学习作为一个学科其地位已经被奠定。主要问题是机器学习是一门应用学科,它需要在工业界发挥作用,能为他们解决实际问题。幸运的是,这个时期很快就过去了。

现在我们可以理直气壮地说机器学习已经成为计算机科学和人工智能的主流学科。这主要体现在下面三个标志性的事件。

第一,2010年2月,加州大学伯克利分校教授乔丹和卡内基梅隆大学教授米歇尔同时当选美国工程院院士,同年5月份,乔丹教授又当选为美国科学院院士。随后几年,概率图模型专家科勒(Daphne Koller)当选为美国工程院院士,理论计算机学家和机器学习专家、Boosting的主要建立者之一夏皮尔(Robert Schapire)当选为美国工程院院士和科学院院士。期间,斯坦福大学的统计学家弗莱德曼和提布施瓦尼(Robert Tibshirani)、伯克利分校的华裔统计学家郁彬,以及卡内基梅隆大学统计学家沃塞曼也先后被选为美国科学院院士。这是一个非常有趣的现象,因为这些学者都在机器学习领域做出了非常重要的贡献,比如弗莱德曼的工作包括分类回归树、多元自适应回归(Multivariate Adaptive Regression Splines, MARS)和梯度推进机(Gradient Boosting Machines, GBM)等经典机器学习算法,而提布施瓦尼是最小绝对收缩和选择算子(Least Absolute Shrinkage and Selection Operator, LASSO)的提出者。此外,优化算法专家鲍德(Stephen Boyd)当选美国工程院院士,他和范登贝格(Lieven Vandenberghe)的合著《凸优化》(Convex Optimization)可以说风靡机器学习界。今年,机器学习专家、深度学习的领袖、多伦多大学教授辛顿以及该校统计学习专家瑞德(Nancy Reid)分别被选为美国工程院和科学院的外籍院士。

乔丹教授在当时我祝贺他当选为院士时的回信中说,如果以他当选院士这种方式来看待机器学习获得学术界的认同会更有意义。因此,我理解在美国一个学科能否被接纳为主流学科的一个重要标志是,其代表科学家能否被选为院士。我们知道米歇尔是机器学习早期建立者之一,而乔丹是统计机器学习的主要奠基者之一。

第二,2011年的图灵奖授予了加州大学洛杉矶分校教授珀尔(Judea Pearl),他主要的研究领域是概率图模型和因果推理,这是机器学习的基础问题。图灵奖通常颁给纯理论计算机学者,或者早期建立计算机架构或框架的学者。而把图灵奖授予珀尔教授具有方向标的意义。此外,去年《科学》和《自然》杂志连续发表了4篇关于机器学习的综述论文。而且,近几年在这两个杂志上发表的计算机学科论文几乎都来自机器学习领域。

第三,机器学习切实能被用来帮助工业界解决问题。特别是当下的热点,比如说深度学习、AlphaGo、无人驾驶汽车、人工智能助理等对工业界的巨大影响。当今IT的发展已从传统的微软模式转变到谷歌模式。传统的微软模式可以理解为制造业,而谷歌模式则是服务业。谷歌搜索完全是免费的,服务社会,他们的搜索做得越来越极致,同时创造的财富也越来越丰厚。

财富蕴藏在数据中,而挖掘财富的核心技术则是机器学习,因此谷歌认为自己是一家机器学习公司。深度学习作为当今最有活力的机器学习方向,在计算机视觉、自然语言理解、语音识别、智力游戏等领域的颠覆性成就,造就了一批新兴的创业公司。工业界对机器学习领域的人才有大量的需求。不仅仅需要代码能力强的工程师,也需要有数学建模和解决问题的科学家。

最近有一本尚未出版的书《数据科学基础》(Foundation of Data Science),作者之一霍普克洛夫特(John Hopcroft)是图灵奖得主。在这本书前沿部分,提到了计算机科学的发展可以分为三个阶段:早期、中期和当今。早期就是让计算机可以运行起来,其重点在于开发程序语言、编译技术、操作系统,以及研究支撑它们的数学理论。中期是让计算机变得有用,变得高效,重点在于研究算法和数据结构。第三个阶段是让计算机具有更广泛的应用,发展重点从离散类数学转到概率和统计。我曾经和霍普克洛夫特交谈过几次,他认为计算机科学发展到今天,机器学习是核心。他正在读机器学习和深度学习方面的书,并计划为本科生讲授机器学习课程。

现在计算机界戏称机器学习为“全能学科”,它无所不在。除了有其自身的学科体系外,机器学习还有两个重要的辐射功能。一是为应用学科提供解决问题的方法与途径。对于一个应用学科来说,机器学习的目的就是把一些难懂的数学翻译成让工程师能够写出程序的伪代码。二是为一些传统学科,比如统计、理论计算机科学、运筹优化等找到新的研究问题。因此,大多数世界著名大学的计算机学科把机器学习或人工智能列为核心方向,扩大机器学习领域的教师规模,而且至少要保持两三个机器学习研究方向具有一流竞争力。有些计算机专业有1/3甚至1/2的研究生选修机器学习或人工智能。

机器学习现在已成为统计学的一个主流方向,许多著名大学的统计系纷纷从机器学习领域招聘教授,比如斯坦福大学统计系新进的两位助理教授来自机器学习专业。计算在统计领域已经变得越来越重要,传统多元统计分析是以矩阵分解为计算工具,现代高维统计则是以优化为计算工具。

机器学习发展的启示

机器学习的发展历程告诉我们:发展一个学科需要一个务实的态度。时髦的概念和名字无疑对学科的普及有一定的推动作用,但学科的根本还是所研究的问题、方法、技术和支撑的基础等,以及为社会产生的价值。

“机器学习”是个很酷的名字,简单地按照字面理解,它的目的是让机器能像人一样具有学习能力。但在其十年的黄金发展期,机器学习界并没有过多地炒作“智能”或者“认知”,而是关注于引入统计学等来建立学科的理论基础,面向数据分析与处理,以无监督学习和有监督学习为两大主要的研究问题,提出和开发了一系列模型、方法和计算算法等,切实地解决了工业界所面临的一些实际问题。近几年,因为大数据的驱动和计算能力的极大提升,一批面向机器学习的底层架构先后被开发出来。神经网络其实在20世纪80年代末或90年代初就被广泛研究,但后来沉寂了。近几年,基于深度学习的神经网络强势崛起,给工业界带来了深刻的变革和机遇。深度学习的成功不是源自脑科学或认知科学的进展,而是因为大数据的驱动和计算能力的极大提升。

机器学习的发展诠释了多学科交叉的重要性和必要性。然而这种交叉不是简单地彼此知道几个名词或概念就可以的,是需要真正的融会贯通。统计学家弗莱德曼早期从事物理学研究,他是优化算法大师,而且他的编程能力同样令人赞叹。乔丹教授既是一流的计算机学家,又是一流的统计学家,而他的博士专业为心理学,他能够承担起建立统计机器学习的重任。辛顿教授是世界最著名的认知心理学家和计算机科学家。虽然他很早就成就斐然,在学术界声名鹊起,但他依然始终活跃在一线,自己写代码。他提出的许多想法简单、可行又非常有效,被称为伟大的思想家。正是由于他的睿智和身体力行,深度学习技术迎来了革命性的突破。这些学者非常务实,从不提那些空洞无物的概念和框架。他们遵循自下而上的方式,从具体问题、模型、方法、算法等着手,一步一步实现系统化。

可以说机器学习是由学术界、工业界、创业界(或竞赛界)等合力造就的。学术界是引擎,工业界是驱动,创业界是活力和未来。学术界和工业界应该有各自的职责和分工。学术界的职责在于建立和发展机器学习学科,培养机器学习领域的专门人才;而大项目、大工程更应该由市场来驱动,由工业界来实施和完成。

电子发烧友App

电子发烧友App

评论