电子发烧友网报道(文/李弯弯)近日消息,AI企业Anthropic将直接从博通采购近100万颗TPU v7pIronwood AI芯片,本地部署在其控制的数据中心中。也就是说,博通将直接向 Anthropic供应基于TPU v7p的机架级 AI 系统,绕过TPU芯片的另一开发参与方谷歌。不过谷歌预计仍可从 Anthropic 同博通的交易中取得 IP授权收入。

博通CEO陈福阳此前在 2025年12月确认,Anthropic 已累计向博通下达了价值210亿美元的AI系统订单。在Anthropic的自有TPU算力系统中,TeraWulf 等三家企业供应基础设施,Fluidstack 则将负责现场部署服务。

Anthropic的AI理想与博通的新赛道

成立于2021年的Anthropic,由OpenAI前高管达里奥·阿莫迪(Dario Amodei)及其妹妹丹妮拉·阿莫迪(Daniela Amodei)创立。核心团队成员多来自Google DeepMind和OpenAI,包括GPT-2/3早期安全评估负责人。公司创立初衷源于对AI发展速度与安全监管脱节的担忧,其使命是构建“可靠、可解释、可操纵”的AI系统。

Anthropic独创的宪法AI框架通过RLAIF(基于AI反馈的强化学习)技术,使模型在生成内容前自动对照预设的AI宪法进行自我审查。该框架包含诚实、无害、公平等价值原则,显著降低有害输出风险。例如,其医疗诊断模型在置信度不足时会主动提示“请咨询专业医生”,而非冒险输出结论。

与OpenAI押注C端不同,Anthropic 80%收入来自企业客户,重点服务金融、医疗、法律等高敏感行业。其承诺不使用客户数据训练模型,并提供Slack、Notion等工具集成服务。2024年Claude系列模型市场份额达25%,2025年初已超52%,成为开发者首选。

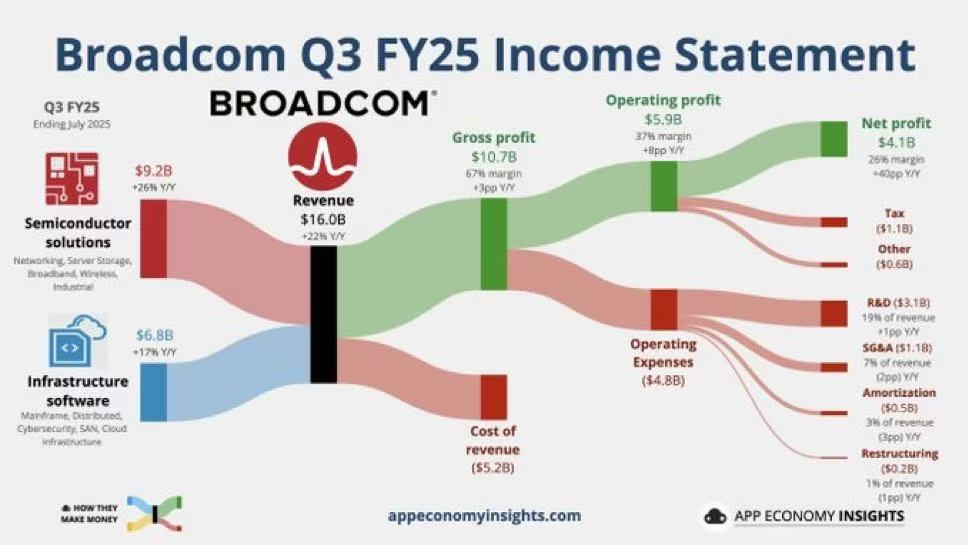

与Anthropic的合作中,博通确认将提供基于TPU v7p的机架级AI系统,涵盖芯片封装、机架设计及系统集成服务,这一转型标志着博通正突破传统芯片供应的角色。

博通利用其先进封装技术,将谷歌的TPU IP转化为标准化产品,同时,其2023年收购VMware的经验,也有助于提供更全面的云基础设施解决方案。通过与Anthropic的合作,博通不仅开辟了新的收入赛道,更在TPU生态上实现了突破。此前,TPU生态完全由谷歌控制,如今博通可向第三方销售标准化系统,形成了“芯片+系统+服务”的全栈能力。

这一变化也引起了行业内的广泛关注,Meta等科技巨头已考虑在2027年将核心AI工作负载转向TPU v7p,若计划落地,博通将吸引更多企业级客户,加速打破AI芯片市场单一主导的格局。

谷歌第七代AI芯片TPU v7pIronwood

作为谷歌第七代AI芯片的TPU v7pIronwood,在2025年11月的Google Cloud Next大会上发布时,其核心参数就引发了行业的震动。

这款芯片在算力密度上实现了单芯片4614 TFLOPS的惊人表现,较前代提升了量级,FP8算力更使训练吞吐量翻倍。在能效比方面,它超越了NVIDIA B200两倍,显著降低了大规模部署的能耗与散热成本。同时,TPU v7p还支持9216颗液冷芯片集群,通过ICI网络实现Pod间的高效互联。作为首款专为AI推理设计的TPU,它精准匹配了生成式AI从训练为主转向推理规模化落地的需求。

在技术突破点上,TPU v7p提供了双模式配置,既有256计算引擎的推理Pod规格,也有9216计算引擎的训练Pod规格。其内存也进行了升级,HBM3E内存容量提升2倍,带宽提高2.7倍。此外,互连优化也是一大亮点,ICI链路带宽提升12%,延迟降低三分之一。

Anthropic的百亿级采购具有多重战略意义,首先体现在数据主权的掌控上。Claude系列模型涉及大量企业敏感数据,本地部署可避免第三方云平台处理的风险。例如,金融行业客户要求数据完全隔离,自主算力因此成为刚需。

其次,在成本结构优化方面,直接采购系统解决方案可规避云服务溢价。据测算,长期运营成本较租用TPU Pod可降低40%以上。

再者,技术栈的深度定制也是一大优势。掌握底层算力后,Anthropic可优化芯片驱动、通信协议及调度系统,使模型训练效率提升30%。

最后,这一举措还引发了生态级的变革,加速了AI公司“去云化”的进程。未来,OpenAI、xAI、Meta等企业可能效仿,推动AI芯片从“云内专属”走向“企业私有”。芯片、云服务、模型的三层关系将被重新定义,全球AI基础设施的权力版图面临重塑。

小结

当大型模型成为国家战略资产,算力控制权已上升至企业生死存亡的高度。Anthropic的采购决策不仅是商业选择,更是AI时代计算主权意识的集中体现。随着博通从芯片供应商升级为系统集成商,谷歌TPU生态的开放性增强,一场围绕算力、数据、技术的全方位竞争正在展开。这场变革或将决定谁能主导通用人工智能(AGI)的未来话语权。

博通CEO陈福阳此前在 2025年12月确认,Anthropic 已累计向博通下达了价值210亿美元的AI系统订单。在Anthropic的自有TPU算力系统中,TeraWulf 等三家企业供应基础设施,Fluidstack 则将负责现场部署服务。

Anthropic的AI理想与博通的新赛道

成立于2021年的Anthropic,由OpenAI前高管达里奥·阿莫迪(Dario Amodei)及其妹妹丹妮拉·阿莫迪(Daniela Amodei)创立。核心团队成员多来自Google DeepMind和OpenAI,包括GPT-2/3早期安全评估负责人。公司创立初衷源于对AI发展速度与安全监管脱节的担忧,其使命是构建“可靠、可解释、可操纵”的AI系统。

Anthropic独创的宪法AI框架通过RLAIF(基于AI反馈的强化学习)技术,使模型在生成内容前自动对照预设的AI宪法进行自我审查。该框架包含诚实、无害、公平等价值原则,显著降低有害输出风险。例如,其医疗诊断模型在置信度不足时会主动提示“请咨询专业医生”,而非冒险输出结论。

与OpenAI押注C端不同,Anthropic 80%收入来自企业客户,重点服务金融、医疗、法律等高敏感行业。其承诺不使用客户数据训练模型,并提供Slack、Notion等工具集成服务。2024年Claude系列模型市场份额达25%,2025年初已超52%,成为开发者首选。

与Anthropic的合作中,博通确认将提供基于TPU v7p的机架级AI系统,涵盖芯片封装、机架设计及系统集成服务,这一转型标志着博通正突破传统芯片供应的角色。

博通利用其先进封装技术,将谷歌的TPU IP转化为标准化产品,同时,其2023年收购VMware的经验,也有助于提供更全面的云基础设施解决方案。通过与Anthropic的合作,博通不仅开辟了新的收入赛道,更在TPU生态上实现了突破。此前,TPU生态完全由谷歌控制,如今博通可向第三方销售标准化系统,形成了“芯片+系统+服务”的全栈能力。

这一变化也引起了行业内的广泛关注,Meta等科技巨头已考虑在2027年将核心AI工作负载转向TPU v7p,若计划落地,博通将吸引更多企业级客户,加速打破AI芯片市场单一主导的格局。

谷歌第七代AI芯片TPU v7pIronwood

作为谷歌第七代AI芯片的TPU v7pIronwood,在2025年11月的Google Cloud Next大会上发布时,其核心参数就引发了行业的震动。

这款芯片在算力密度上实现了单芯片4614 TFLOPS的惊人表现,较前代提升了量级,FP8算力更使训练吞吐量翻倍。在能效比方面,它超越了NVIDIA B200两倍,显著降低了大规模部署的能耗与散热成本。同时,TPU v7p还支持9216颗液冷芯片集群,通过ICI网络实现Pod间的高效互联。作为首款专为AI推理设计的TPU,它精准匹配了生成式AI从训练为主转向推理规模化落地的需求。

在技术突破点上,TPU v7p提供了双模式配置,既有256计算引擎的推理Pod规格,也有9216计算引擎的训练Pod规格。其内存也进行了升级,HBM3E内存容量提升2倍,带宽提高2.7倍。此外,互连优化也是一大亮点,ICI链路带宽提升12%,延迟降低三分之一。

Anthropic的百亿级采购具有多重战略意义,首先体现在数据主权的掌控上。Claude系列模型涉及大量企业敏感数据,本地部署可避免第三方云平台处理的风险。例如,金融行业客户要求数据完全隔离,自主算力因此成为刚需。

其次,在成本结构优化方面,直接采购系统解决方案可规避云服务溢价。据测算,长期运营成本较租用TPU Pod可降低40%以上。

再者,技术栈的深度定制也是一大优势。掌握底层算力后,Anthropic可优化芯片驱动、通信协议及调度系统,使模型训练效率提升30%。

最后,这一举措还引发了生态级的变革,加速了AI公司“去云化”的进程。未来,OpenAI、xAI、Meta等企业可能效仿,推动AI芯片从“云内专属”走向“企业私有”。芯片、云服务、模型的三层关系将被重新定义,全球AI基础设施的权力版图面临重塑。

小结

当大型模型成为国家战略资产,算力控制权已上升至企业生死存亡的高度。Anthropic的采购决策不仅是商业选择,更是AI时代计算主权意识的集中体现。随着博通从芯片供应商升级为系统集成商,谷歌TPU生态的开放性增强,一场围绕算力、数据、技术的全方位竞争正在展开。这场变革或将决定谁能主导通用人工智能(AGI)的未来话语权。

声明:本文内容及配图由入驻作者撰写或者入驻合作网站授权转载。文章观点仅代表作者本人,不代表电子发烧友网立场。文章及其配图仅供工程师学习之用,如有内容侵权或者其他违规问题,请联系本站处理。

举报投诉

-

博通

+关注

关注

36文章

4352浏览量

109420 -

TPU

+关注

关注

0文章

176浏览量

21766

发布评论请先 登录

相关推荐

热点推荐

博通获OpenAI“百亿大单”,AI芯片业务收入大增

的在财报电话会议上表示,公司已获得第四个定制AI芯片业务的主要客户,该客户承诺了价值100亿美元的订单。尽管博通未公开客户身份,但多方信源指向人工智能领域的领跑者OpenAI。

高通与字节跳动达成AI芯片合作,数百万颗定制芯片将用于AI服务

近日,彭博社报道高通与字节跳动围绕AI ASIC芯片达成合作。字节跳动将向高通采购数百万颗定制芯片

微软与Anthropic深度绑定,Maia 200芯片每美元Token效率飙升30%

。微软与Anthropic围绕Maia 200的芯片供应谈判也浮出水面,一场关乎AI算力版图重塑的深层博弈正在加速展开。

车规级芯片缺料怎么办?2026年电子元器件采购的四大痛点与解决方案

品质保障:

原厂直供:每一颗芯片从华润微工厂直接到深智微仓库,无中间环节

完整溯源:提供原厂出货检验报告、批次追溯信息

AEC-Q100认证:车规级产品提供完整的认证文件,不影响整车厂

发表于 05-23 09:59

NXP K20P100M100SF2V2芯片:设计工程师的全面指南

NXP K20P100M100SF2V2芯片:设计工程师的全面指南 在电子设计领域,选择合适的芯片对于项目的成功至关重要。NXP的K20P100M100SF2V2

进迭时空发布新一代RISC-V AI CPU芯片,满足端侧大模型算力需求

FP8数据精度原生AI推理,还是首颗完整支持芯片级虚拟化的RISC-V产品。 硬件配置上,K3配备8颗高性能X

什么是TPU?万协通带你看懂AI算力的“变形金刚”

”——TPU(Tensor Processing Unit)。 今天,作为国产可重构TPU芯片的先行者,万协通将带你剥开晦涩的技术外壳,看懂这块决定

AI业界新闻:OpenAI官宣自研首颗芯片 黄仁勋时隔9年再次给马斯克“送货”

给大家带来一些AI业界新闻: OpenAI官宣自研首颗芯片 OpenAI宣布与博通合作自研AI芯片

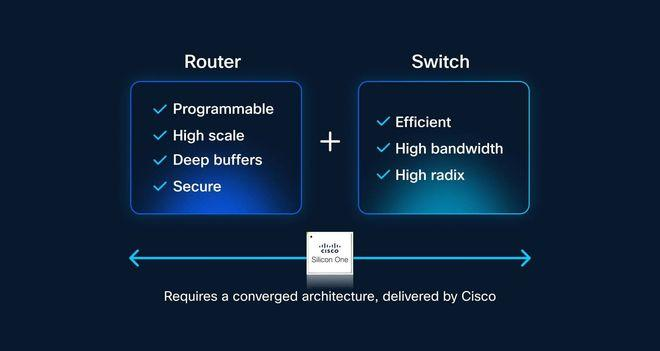

思科Cisco 8223:51.2Tbps P200芯片助力AI数据中心

P200芯片,为AI时代跨数据中心的高速互联需求提供了高效解决方案。 P200芯片具备每秒51.2太比特(Tbps)的以太网处理能力。

【「AI芯片:科技探索与AGI愿景」阅读体验】+AI芯片的需求和挑战

:

介绍了7家ASIC的新创公司:

Tachyum、Cerebras、SambaNova、Graphcore、Esperanto、Groq、Etched AI

还介绍了中国的AI芯片

发表于 09-12 16:07

Wi-Fi6 MCU旗舰产品登场,博通集成携手伙伴向万物智联场景迈进

在智能门锁领域,现场工作人员介绍,博通推出了采用Wi-Fi MCU旗舰芯片BK7259,适用于高级智能门锁;在现场展示的AI眼镜,AI眼镜内置了BK7258,是一

【书籍评测活动NO.64】AI芯片,从过去走向未来:《AI芯片:科技探索与AGI愿景》

问题请咨询工作人员(微信:elecfans_666)。

AI芯片,从过去走向未来

四年前,市面上仅有的一本AI芯片全书在世界范围内掀起一阵

发表于 07-28 13:54

RISC-V芯片出货超百亿颗!四大厂商重磅产品来袭,加速边缘AI终端落地

RISC-V基金会宣布,2024年基于RISC-V指令集的芯片出货量超过百亿颗,其中30%用于AI加速场景。本次盛会,知合计算、全志科技、

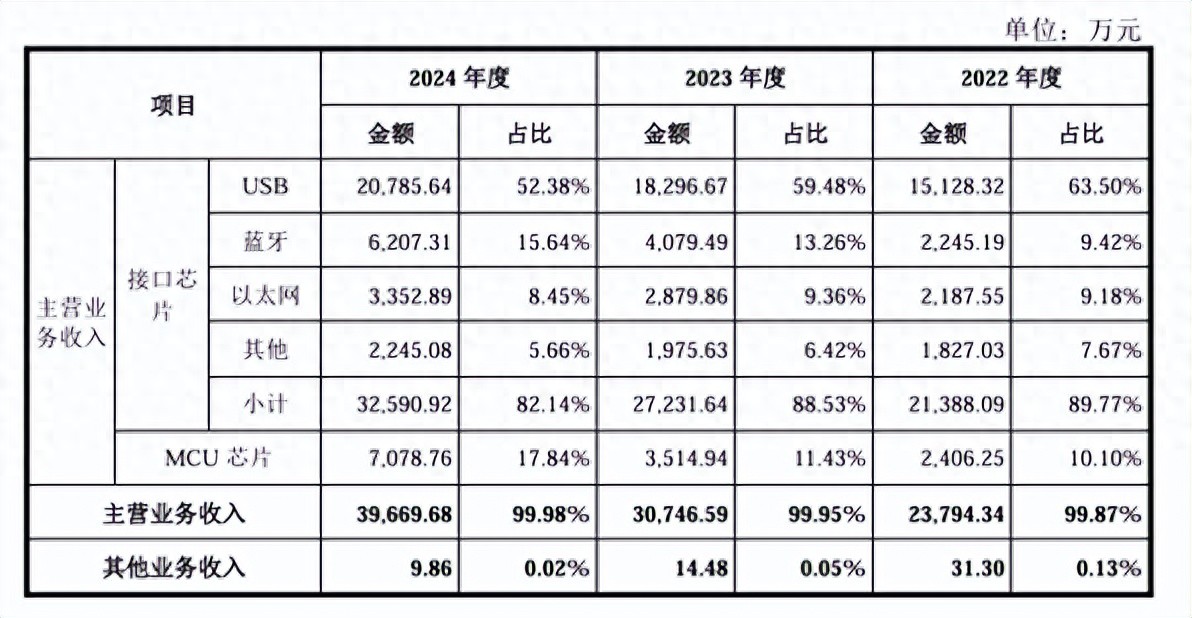

RISC-V芯片公司冲刺IPO:年销超亿颗,单芯片毛利68%

RISC-V芯片公司冲刺IPO:年销超亿颗,单芯片毛利68%,这家公司凭什么? 6月30日,南京沁恒微电子股份有限公司(简称"沁恒微")递交

AI芯片大单!Anthropic从博通采购100万颗TPU v7p芯片

AI芯片大单!Anthropic从博通采购100万颗TPU v7p芯片

评论