人类对于生物大脑的探索是永无止境的,模仿生物的人工智能是否可以帮助我们进行研究?最近,来自谷歌的研究人员提出了一种新的循环神经网络,它可以快速构建生物大脑的 3D 神经模型。谷歌称,新的方法可以「将连接组学提升一个数量级」。目前,该研究的论文已经发表在Nature 子刊《Nature Methods》上。

连接组学旨在综合描绘在神经系统中发现的神经网络结构,以更好地理解大脑的运作模式。这一过程需要对大脑组织进行纳米级的 3D 成像(通常使用电子显微镜),然后分析成像数据结果以追踪大脑的神经突触并识别单个突触连接。由于成像分辨率高,即使是一立方毫米的大脑组织也能产生 1000 多 TB 的数据!这些图像中的结构相当复杂、精细,因此大脑成像的主要瓶颈在于数据的自动解读,而非获取。

如今,谷歌与马克斯-普朗克神经生物学研究所的研究人员合作,在《Nature Methods》杂志上发表了一篇名为《High-Precision Automated Reconstruction of Neurons with Flood-Filling Networks》的论文。该论文介绍了一种新型的循环神经网络,该网络在自动解读连接组学数据的准确性方面比以往的深度学习技术提高了一个数量级。

基于泛洪算法网络(Flood-Filling Network)的 3D 图像分割

追踪大量电子显微镜数据中的神经突触是图像分割问题的一个实例。传统的算法将该过程至少分为两步:利用边缘检测器或机器学习分类器找到神经突触之间的边界,然后使用分水岭或图像分割等算法将未被边界分隔的图像像素组合在一起。2015 年,我们开始尝试一种基于循环神经网络的替代方法,将这两个步骤统一起来。该算法被嵌在特定的像素位置,然后使用循环卷积神经网络迭代地「填充」某一区域,该循环卷积神经网络用来预测哪些像素属于与种子相同的对象。自 2015 年以来,我们一直致力于将这种新方法应用于大规模的连接组学数据集,并严格量化其准确率。

在 2D 图像中分割物体的泛洪算法网络。黄点是当前焦点区域的中心;该算法在迭代检查更多图像区域的同时扩展分割区域(蓝色)。

通过预期运行长度测量准确率

我们与马克思·普朗克研究所的研究人员合作,设计了一种被称之为「预期运行长度」(ERL)的度量标准,它测量以下内容:给定大脑 3D 图像中随机神经元内的随机点,在出错前,我们能追踪神经元多远?这是一个典型的「平均故障间隔时间」问题,只不过在这里我们测量的是故障间隔的空间量而不是时间量。对于工程师来说,ERL 的吸引力在于它将线性物理路径长度与算法产生的个别错误的频率关联起来,并且可以直接计算。对于生物学家来说,吸引力在于 ERL 的特定数值与生物相关的量相关,例如神经系统不同部分中神经元的平均路径长度。

预期运行长度(蓝线)的进展带来了今天在《Nature Methods》上共享的结果。红线表示「合并率」的进展,合并率测量两个分离的神经突被错误地追踪为单个目标的频率;达到非常低的合并率对于实现手动识别和校正重建中剩余误差的有效策略至关重要。

图像分割过程

鸣禽连接组学

我们用 ERL 测量了一百万立方微米斑胸草雀大脑中一组基本真实神经元的进展,斑胸草雀大脑通过我们的合作伙伴使用肖特基场发射扫描电子显微镜而成像。实验结果发现我们的方法优于之前应用于同一数据集的其他深度学习方法。

谷歌提出的算法在鸣禽大脑中追踪单个神经突的 3D 过程。

谷歌研究人员正和马克思·普朗克研究所的同僚们通过这种自动化方法,辅以少量人力协助以解决一些疑难问题。他们现在正致力于研究鸣禽连接组以寻求新理解,如研究斑胸草雀如何唱歌,以及它们如何学会唱歌。

展望

谷歌研究人员表示,他们在未来将继续改进连接组重构技术,目标是实现突触级分辨率连接组的全自动化,并为马克思·普朗克研究所及其他机构的连接组项目作出贡献。为了帮助支持更大的研究团队开发连接组技术,他们开源了泛洪算法网络方法的 TensorFlow 代码(https://github.com/google/ffn/)以及用于 3D 数据集的 WebGL 可视化软件,以帮助人们理解和改进目前的方法。

-

谷歌

+关注

关注

27文章

6259浏览量

111963 -

神经网络

+关注

关注

42文章

4842浏览量

108160

原文标题:前 | 谷歌AI脑神经元绘制法登上Nature子刊:速度提升一个数量级

文章出处:【微信号:gh_ecbcc3b6eabf,微信公众号:人工智能和机器人研究院】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

嵌入式系统中的人工智能

自动驾驶中常提的卷积神经网络是个啥?

NMSIS神经网络库使用介绍

在Ubuntu20.04系统中训练神经网络模型的一些经验

人工智能工程师高频面试题汇总:循环神经网络篇(题目+答案)

液态神经网络(LNN):时间连续性与动态适应性的神经网络

【「AI芯片:科技探索与AGI愿景」阅读体验】+神经形态计算、类脑芯片

神经网络的并行计算与加速技术

利用超微型 Neuton ML 模型解锁 SoC 边缘人工智能

挖到宝了!人工智能综合实验箱,高校新工科的宝藏神器

挖到宝了!比邻星人工智能综合实验箱,高校新工科的宝藏神器!

以神经仿生重构AI逻辑,这家公司要做智能交互界的爆款制造机

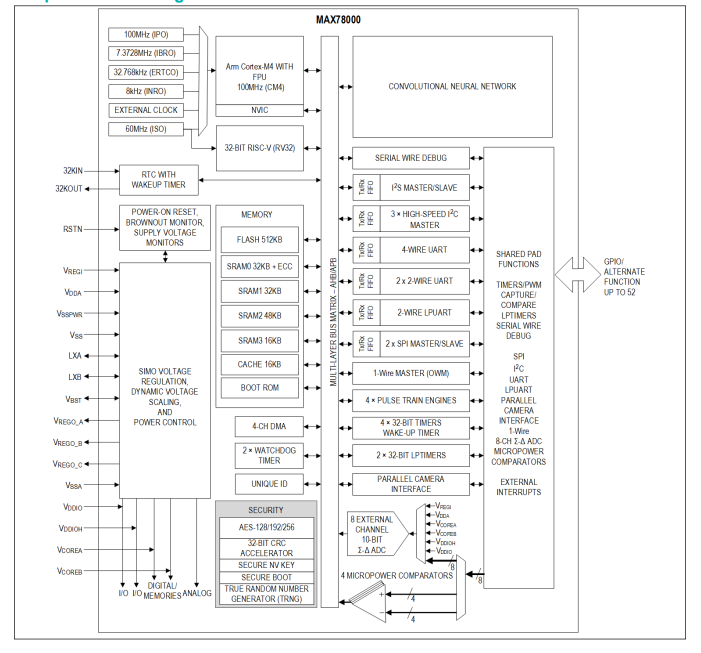

MAX78000采用超低功耗卷积神经网络加速度计的人工智能微控制器技术手册

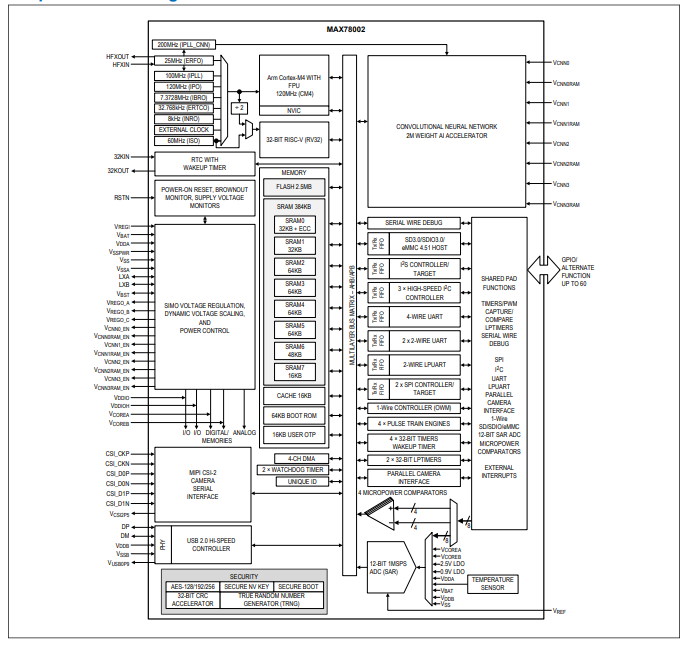

MAX78002带有低功耗卷积神经网络加速器的人工智能微控制器技术手册

谷歌新的循环神经网络技术是否对模仿生物的人工智能有帮助?

谷歌新的循环神经网络技术是否对模仿生物的人工智能有帮助?

评论