作者:算力魔方创始人/英特尔创新大使刘力

一,概述

在Chery Studio中部署个人的MCP助手可以帮助您高效地管理和自动化任务。本文将详细介绍从软件下载到最终配置的完整流程,确保您能够顺利完成部署并投入使用。

二,安装步骤

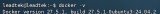

1. 环境准备:

操作系统:Windows 11

GPU:Intel® Iris® Xe Graphics

API Chat模型:DeepSeek-V3:0324

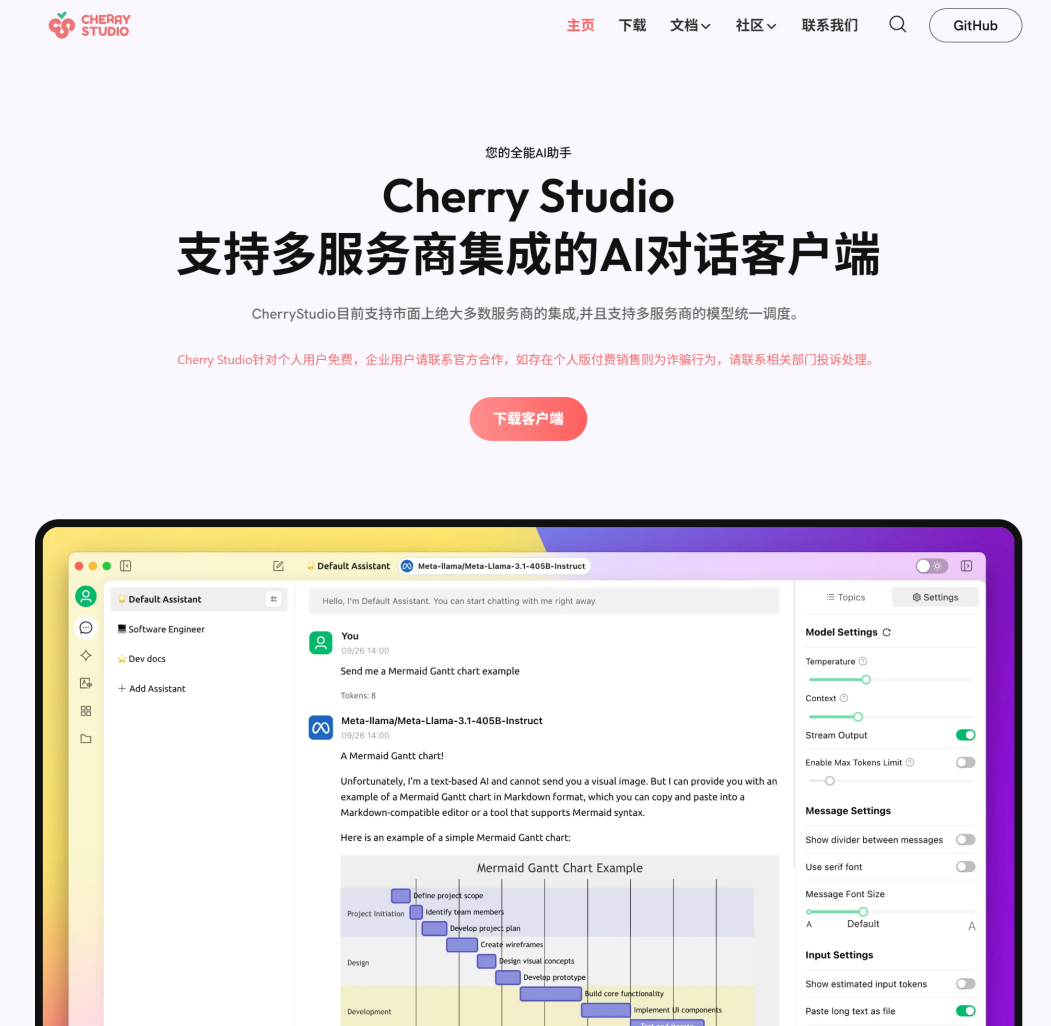

2. 官网下载软件:

访问Chery Studio的官方网站,找到MCP助手的下载页面。根据您的操作系统(Windows、macOS或Linux)选择对应的安装包,并下载至本地。

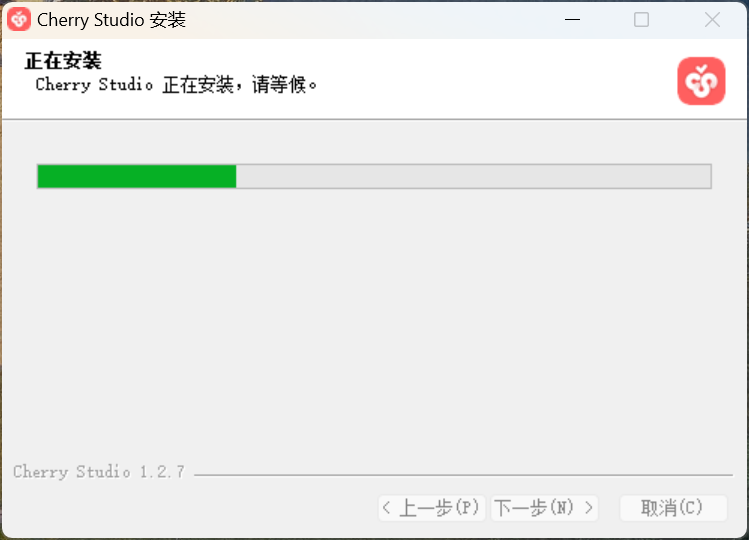

3. 系统下安装软件:

Windows:双击下载的`.exe`文件,按照安装向导完成安装。

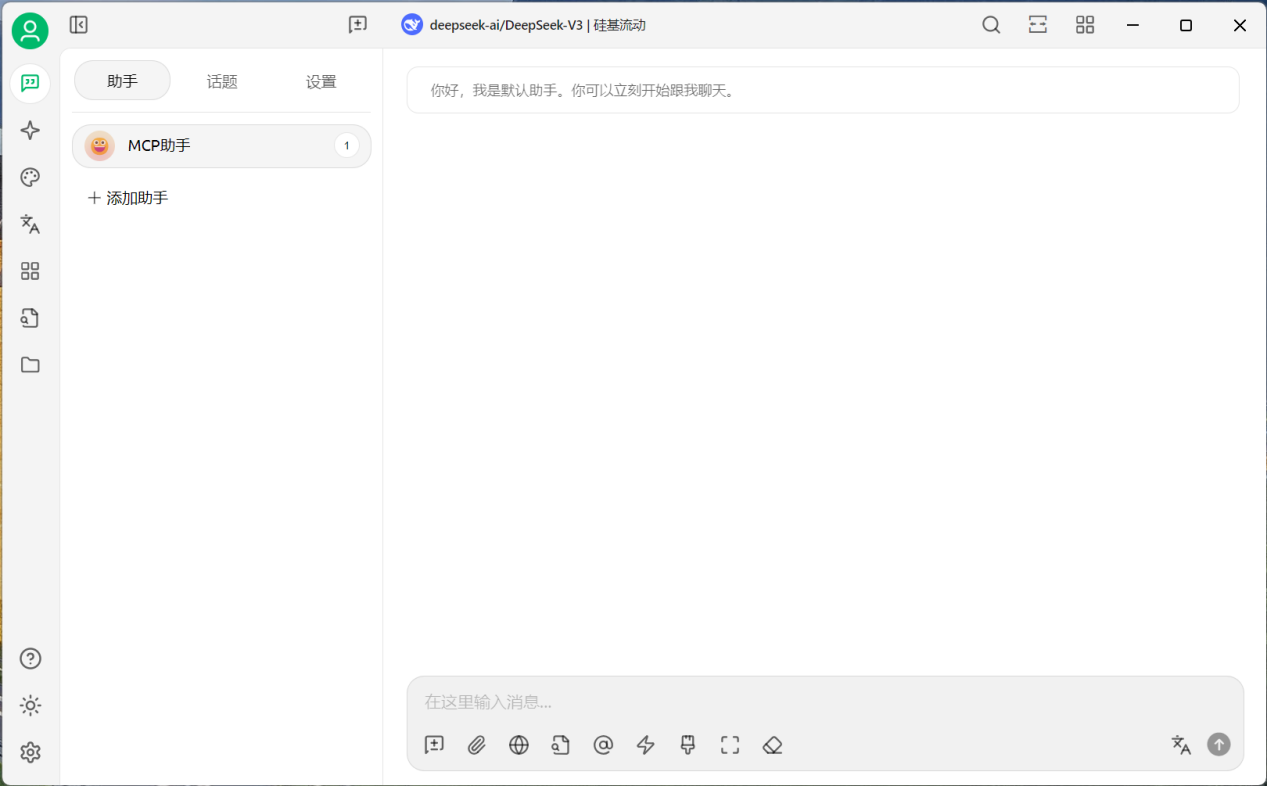

4. 运行软件:

安装完成后,您可以通过以下方式启动MCP助手:Windows/macOS:从桌面快捷方式或应用程序菜单中启动。

三,API配置

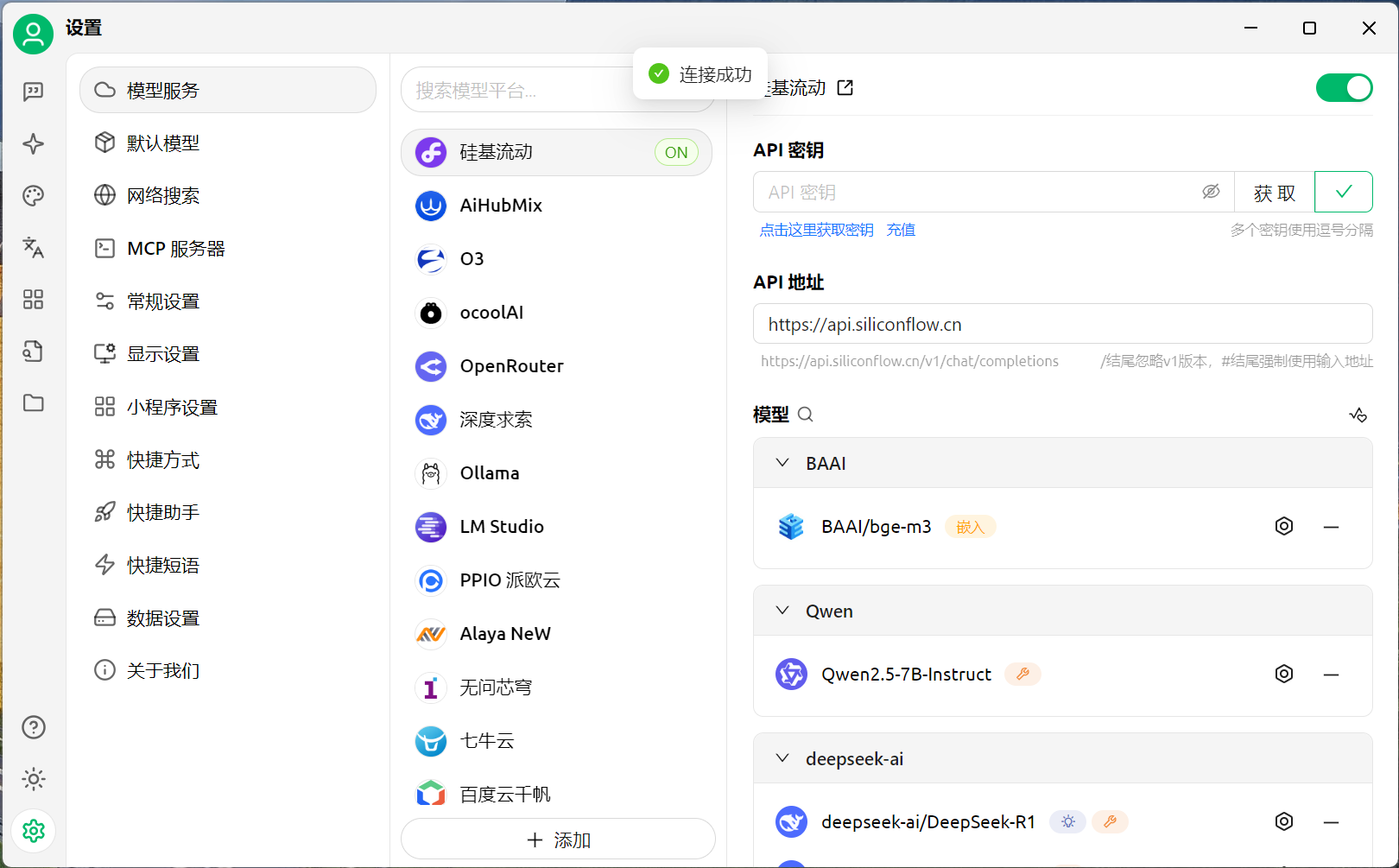

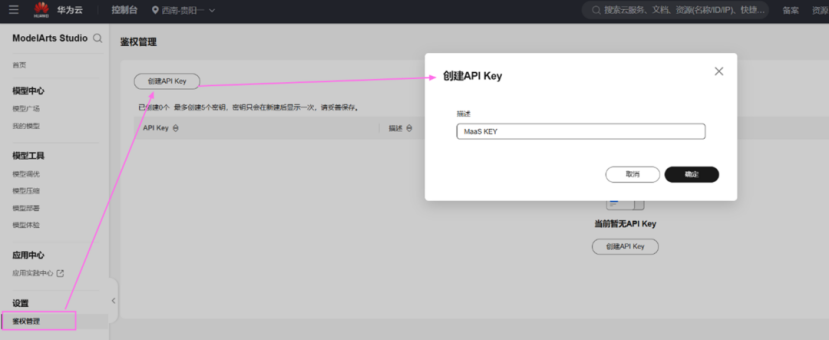

1. 设置API KEY:

打开MCP助手,进入“设置”或“API配置”页面,输入从Chery Studio获取的API KEY。确保密钥准确无误,并保存设置。

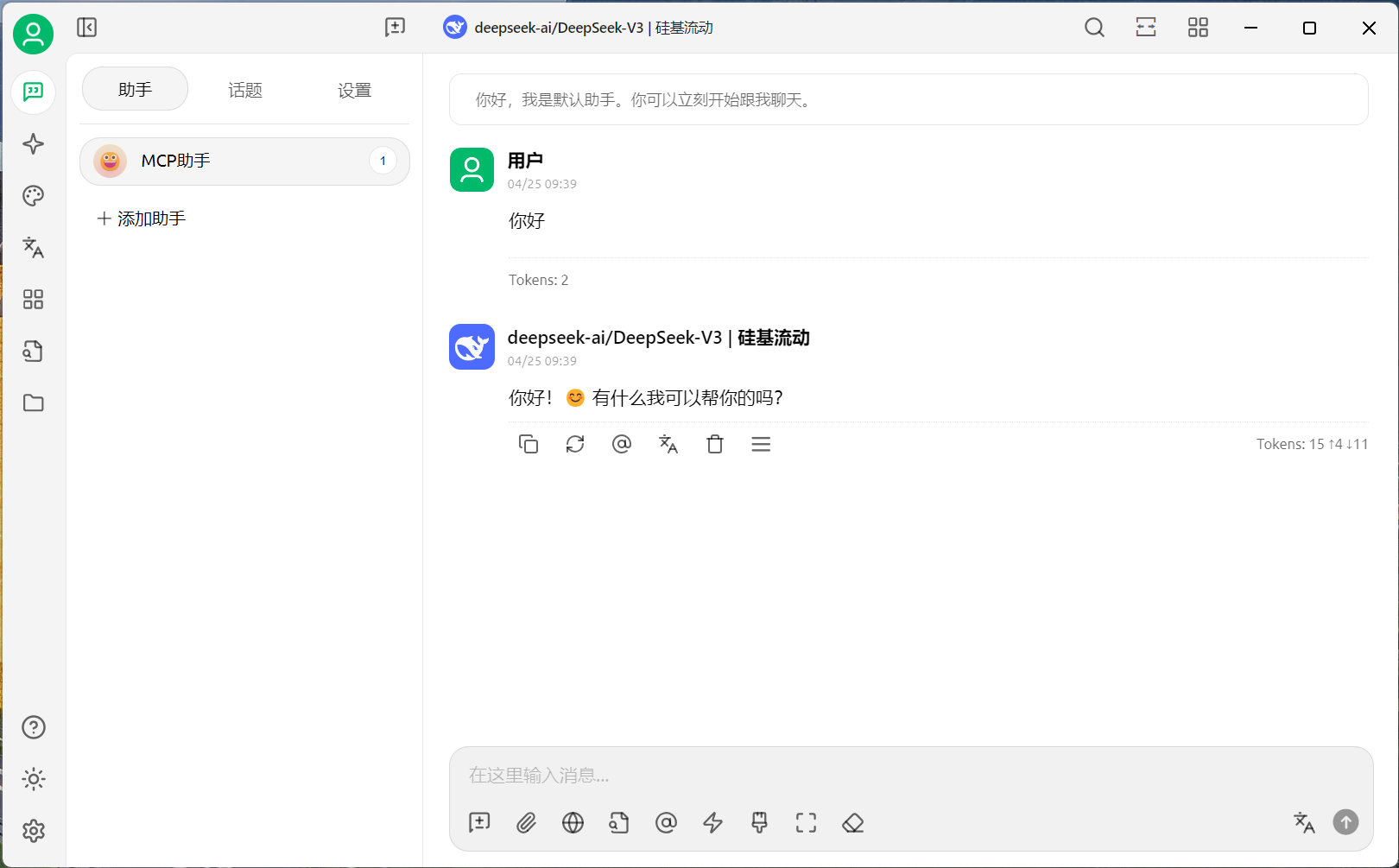

2. 测试API KEY的可行性:

在主界面,任意输入一个问题,若能直接返回问题答案则表示API调用成功。

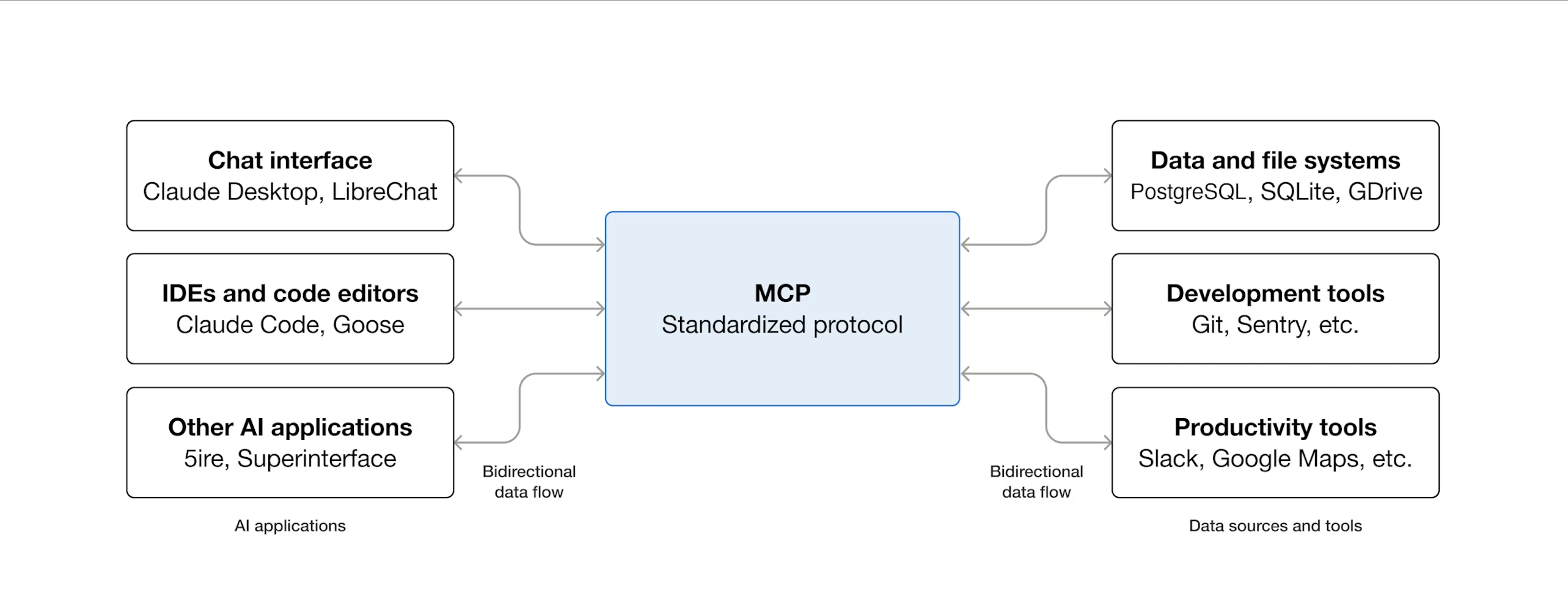

四,MCP Server配置

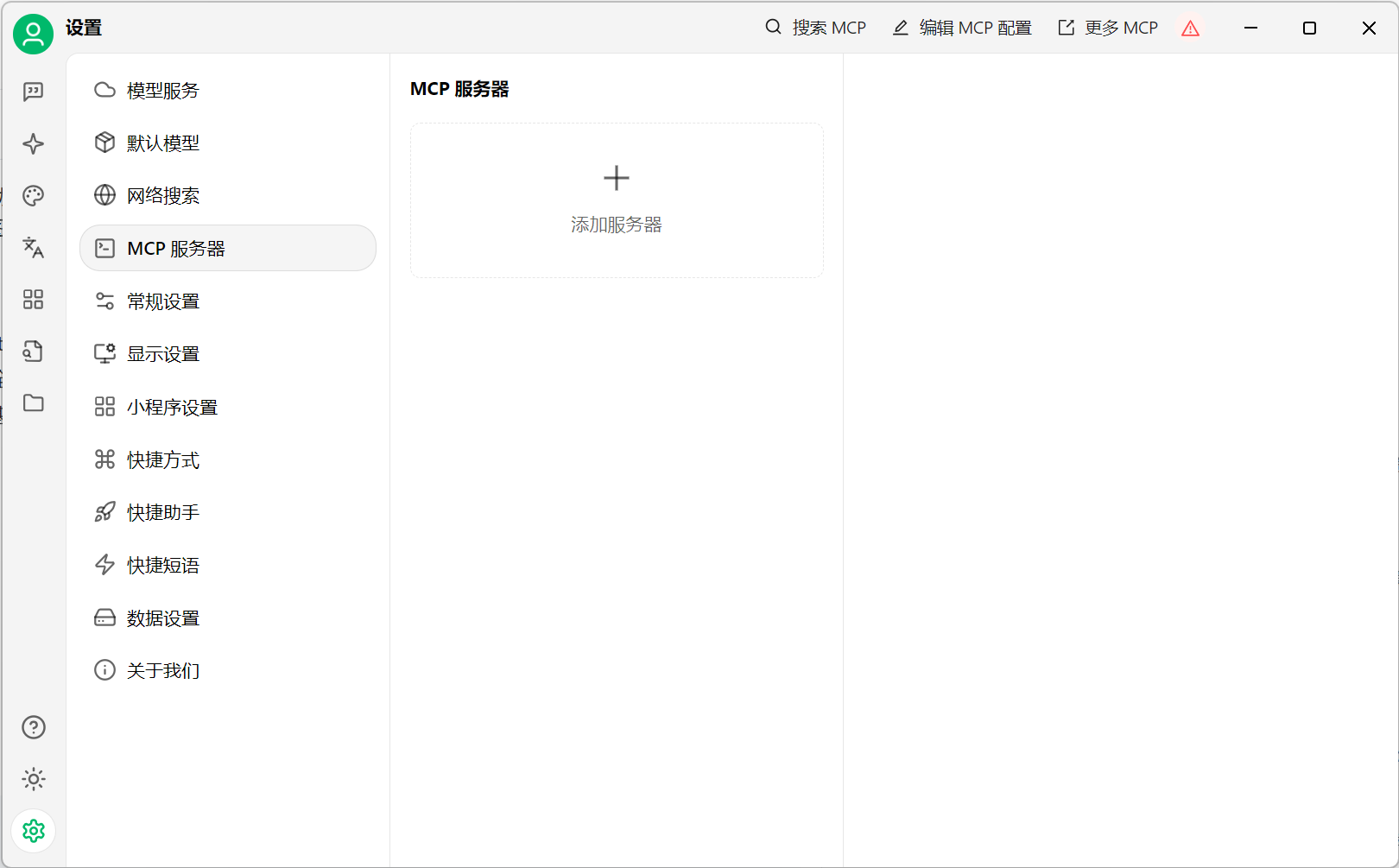

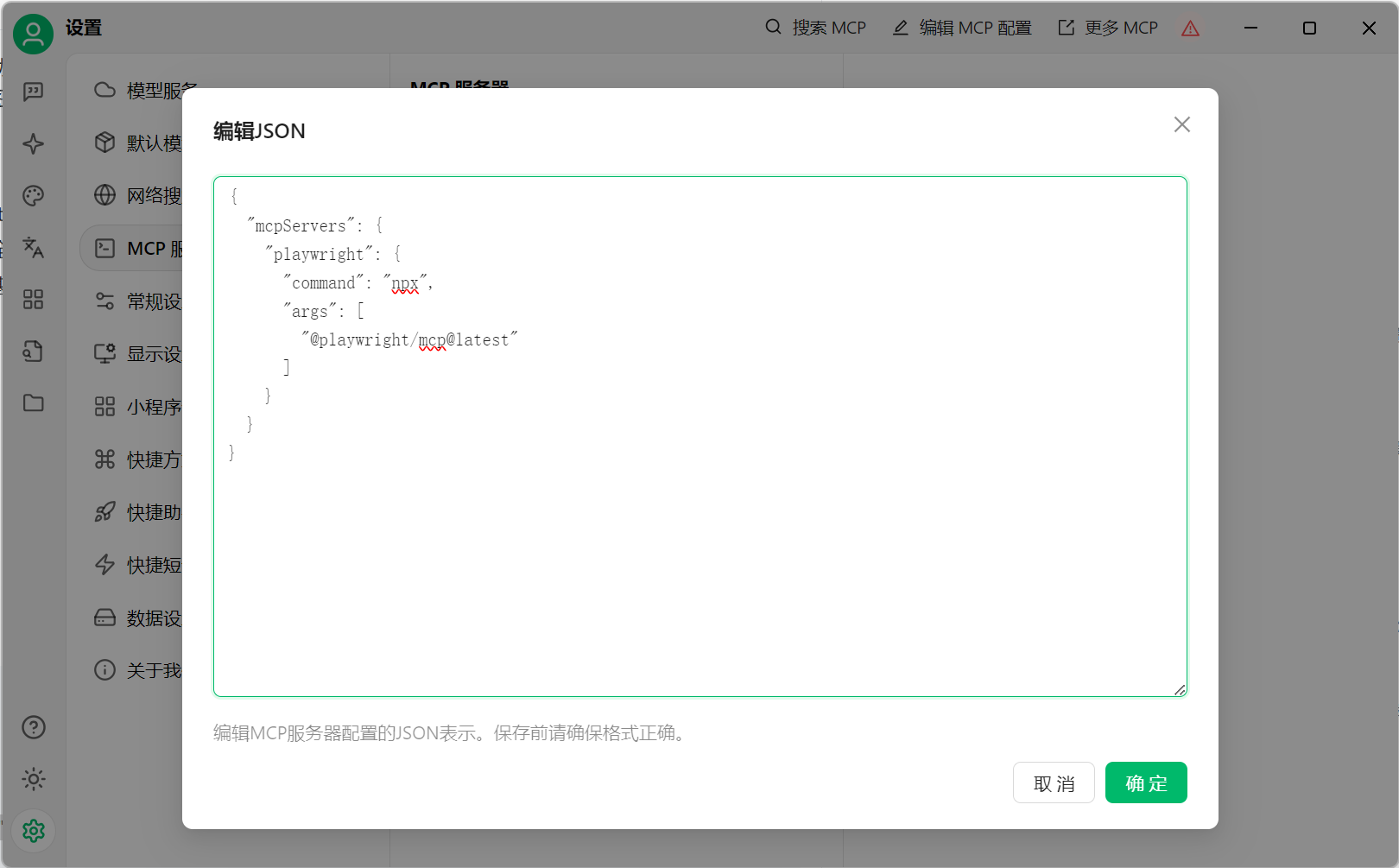

1. 配置MCP Server:

编辑MCP助手的配置文件(通常为`config.yaml`或`config.json`),设置以下关键参数:

保存文件后,重启MCP助手以使配置生效。

视频链接:https://mp.weixin.qq.com/s/zTt1YLhy0CjaEvmMY7Uxlw

五,调用自动化工具Playweight

1. 运行Playweight任务:

按照以上步骤操作,您即可在Chery Studio中成功部署个人的MCP助手,并利用其自动化功能提升工作效率。

如果你有更好的文章,欢迎投稿!

稿件接收邮箱:nami.liu@pasuntech.com

更多精彩内容请关注“算力魔方®”!

审核编辑 黄宇

-

MCP

+关注

关注

0文章

286浏览量

14910

发布评论请先 登录

如何在NVIDIA Jetson AGX Thor上通过Docker高效部署vLLM推理服务

最新MCP规范解读,看这篇就够了!

在Cherry Studio中快速使用markitdown MCP Server?

MaaS X Cherry Studio:基于DeepSeek API快速构建个人AI智能助手

如何在RAKsmart服务器上实现企业AI模型部署

通过Java和MCP创建Git AI仓库助手

Microchip推出MPLAB AI编码助手

如何在DevEco Studio中利用CodeGPT接入DeepSeek

瑞萨e2 studio中Reality AI组件的使用方法

dbForge Studio For SQL Server:用于有效开发的最佳SQL Server集成开发环境

三分钟带你接入OpenAI构建个人语音助手

华为云 Flexus 云服务器 X 实例之 Docker 环境下部署 JmalCloud 个人网盘

如何在Chery Studio部署个人的MCP助手?

如何在Chery Studio部署个人的MCP助手?

评论