2 月 6 日消息,字节跳动近日发布了一项重大成果 ——OmniHuman 多模态框架,其优势在于其强大的视频生成能力。用户只需提供一张任意尺寸和人物占比的单张图片,再结合一段输入音频,就能生成栩栩如生的人物视频。

与传统 AI 模型不同,OmniHuman-1 能够生成逼真的全身动画,并且可以精准地将手势和面部表情与语音或音乐同步,打破了以往只能生成面部或上半身动画的局限。

基于约 19000 小时的人类运动数据训练,OmniHuman-1 模型支持不同的体型和画面比例,能在内存限制内生成任意长度的视频,并适应不同输入信号,在真实性和准确性方面超越其他同类动画工具。值得一提的是,它还支持卡通角色、人工物体、动物以及复杂姿势的输入,确保生成的动作特征与每种风格的独特特点相匹配。

在实际应用场景中,OmniHuman 潜力巨大。在影视制作领域,创作者能轻松为虚拟角色打造全身动作戏份;虚拟直播里,主播动作更加自然,可增强直播的趣味性与吸引力;游戏世界中,数字人 NPC 的动作和表情更丰富,能提升玩家的沉浸感。

声明:本文内容及配图由入驻作者撰写或者入驻合作网站授权转载。文章观点仅代表作者本人,不代表电子发烧友网立场。文章及其配图仅供工程师学习之用,如有内容侵权或者其他违规问题,请联系本站处理。

举报投诉

-

AI

+关注

关注

91文章

41252浏览量

302656 -

人工智能

+关注

关注

1820文章

50355浏览量

267011 -

字节跳动

+关注

关注

0文章

353浏览量

10132

发布评论请先 登录

相关推荐

热点推荐

ADPD4000/ADPD4001:多模态传感器前端的卓越之选

ADPD4000/ADPD4001:多模态传感器前端的卓越之选 在当今电子设备日益智能化、多功能化的时代,多模态传感器前端的需求愈发迫切。ADPD4000/ADPD4001作为一款性能

海光DCU完成Qwen3.5多模态MoE模型全量适配

近日,海光DCU完成Qwen3.5-397B MoE旗舰多模态模型、Qwen3.5-35B-A3B MoE多模态模型全量适配、精度对齐与推理部署验证。本次适配依托FlagOS专属vLL

全球首个最大规模跨本体视触觉多模态数据集白虎-VTouch发布

全球首个最大规模跨本体视触觉多模态数据集——白虎-VTouch(Vision-Based Tactile Sensor),总规模超过60,000分钟。

格灵深瞳多模态大模型荣登InfoQ 2025中国技术力量年度榜单

灵感实验室联合LLaVA社区发布的多模态大模型LLaVA-OneVision-1.5,实现了训练数据、代码和模型权重的全链路开源,在多项公开多模态

涂鸦Omni AI Foundation V2.6发布:低代码+多模态,重塑AI硬件创新体验

硬件产品的落地。今天,我们非常高兴地宣布:面向多模态AI硬件的基座平台OmniAIFoundation正式发布V2.6版本。本次升级不仅显著提升了端到端多

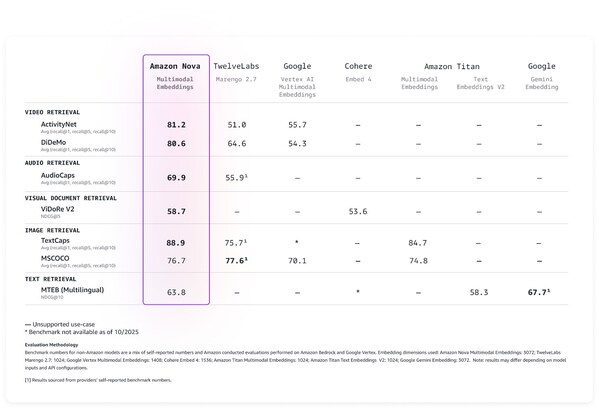

亚马逊云科技上线Amazon Nova多模态嵌入模型

Embeddings多模态嵌入模型现已在Amazon Bedrock上线,这是一款专为Agentic RAG与语义搜索应用打造的顶尖多模态嵌入模型。该模型是首个通过单一模型支持文本、

浅析多模态标注对大模型应用落地的重要性与标注实例

在人工智能迈向AGI通用智能的关键道路上,大模型正从单一的文本理解者,演进为能同时看、听、读、想的“多面手”。驱动这一进化的核心燃料,正是高质量的多模态数据,而将原始数据转化为“机器可读教材

商汤科技多模态通用智能战略思考

时间是最好的试金石,AI领域尤其如此。当行业热议大模型走向时,商汤早已锚定“多模态通用智能”——这是我们以深厚研究积累和实践反复验证的可行路径。

“端云+多模态”新范式:《移远通信AI大模型技术方案白皮书》正式发布

7月28日,移远通信联合智次方研究院正式发布《AI大模型技术方案白皮书》(以下简称“白皮书”)。这份白皮书系统梳理了AI大模型的技术特点、产业发展态势与多元应用场景,以及移远通信“端云+多模态”AI

润和软件发布StackRUNS异构分布式推理框架

当下,AI模型规模持续膨胀、多模态应用场景日益复杂,企业正面临异构算力资源碎片化带来的严峻挑战。为应对行业痛点,江苏润和软件股份有限公司(以下简称“润和软件”)正式发布自主研发的StackRUNS异构分布式推理

字节跳动发布OmniHuman 多模态框架

字节跳动发布OmniHuman 多模态框架

评论