一、Flexus 云服务器 X 实例介绍

云服务器,如同虚拟的超级计算机,是云计算技术的核心组成部分。它通过网络提供计算资源,包括处理器、内存、存储和操作系统等,用户可以根据需求灵活配置和扩展。云服务器具备高可用性、弹性伸缩和快速部署等特点,适用于各种规模的企业和开发者,无论是网站托管、数据分析还是应用开发,都能提供稳定、高效的支持。

华为云下一代云服务器 Flexus X 实例焕新上线,新产品搭配弹性伸缩服务 AS 及负载均衡服务 ELB,可以实现基于业务负载的快速弹缩,从容应对多变的市场业务压力,覆盖高科技、零售、金融、游戏等行业大多数通用工作负载场景。

Flexus X 实例通过和其他服务组合,具备计算、镜像安装、网络、存储、安全等能力,您可根据业务需要灵活配置各资源。

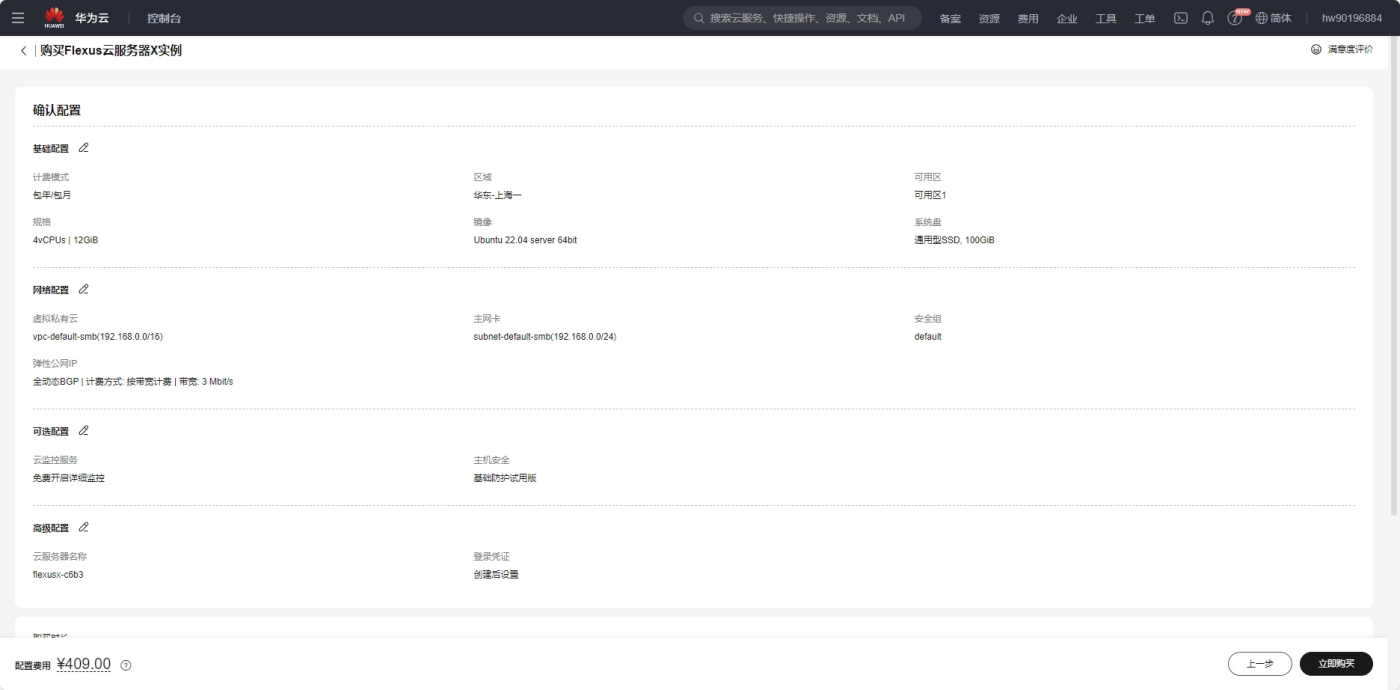

本次测评使用的规格是:4 核 12G-100G-3M 规格的 Flexus X 实例基础模式

二、Flexus 云服务器 X 实例配置

2.1 重置密码

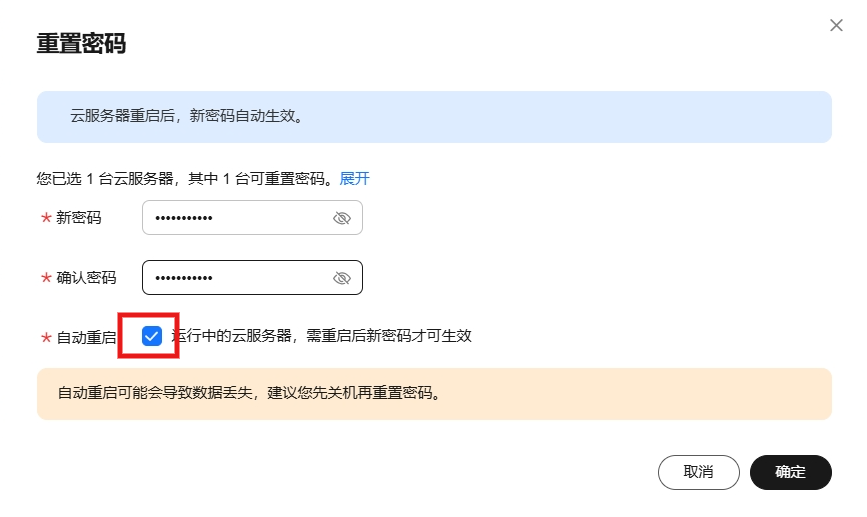

购买服务器的时候可以提前设置用户名和密码,因为我这里跳过了,所以购买完成后需要重置密码,会短信或站内消息通过你的云服务器信息,重点是公网 IP 地址和用户名,首先打开你的服务器控制台,选择重置密码

勾选自动重启,点击确定即可

2.2 服务器连接

华为云服务器提供了多种链接方式,如使用控制台提供的 VNC 方式登录、使用 Linux/Mac OS 系统主机登录 Linux 弹性云服务器(即 ssh root@192.168.48.78 命令)或者使用 Putty、Xshell 等工具登录 Linux 弹性云服务器。

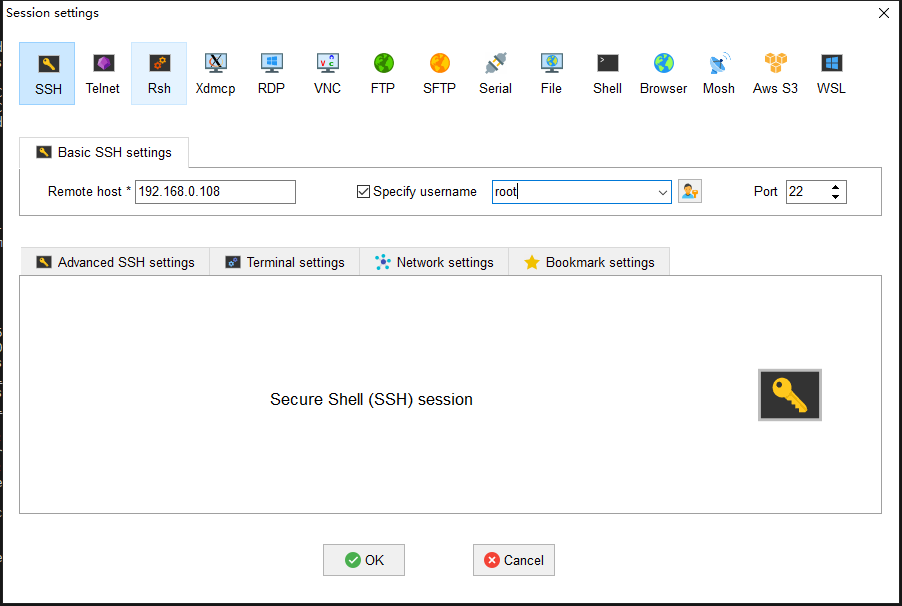

我个人习惯使用 MobaXterm这款软件,添加 SSH 连接,输出公网 IP、用户名和端口(默认 22),连接即可。

2.3 安全组配置

安全组是一个逻辑上的分组,为同一个 VPC 内的云服务器提供访问策略。用户可以在安全组中定义各种访问规则,当云服务器加入该安全组后,即受到这些访问规则的保护。

系统为每个网卡默认创建一个默认安全组,默认安全组的规则是对出方向上的数据报文全部放行,入方向访问受限。您可以使用默认安全组,也可以根据需要创建自定义的安全组。

主要需要填写优先级(默认填 1 即可)、协议端口(协议一般为 TCP 或 UDP,端口一般选择你项目需要暴露的端口即可),描述(选填,一般会填写此端口的用途以免忘记了),其他默认点击确定即可。安全组配置主要是暴露端口可以给外网访问。

如果还不清楚可以参考文档:安全组配置示例

总结

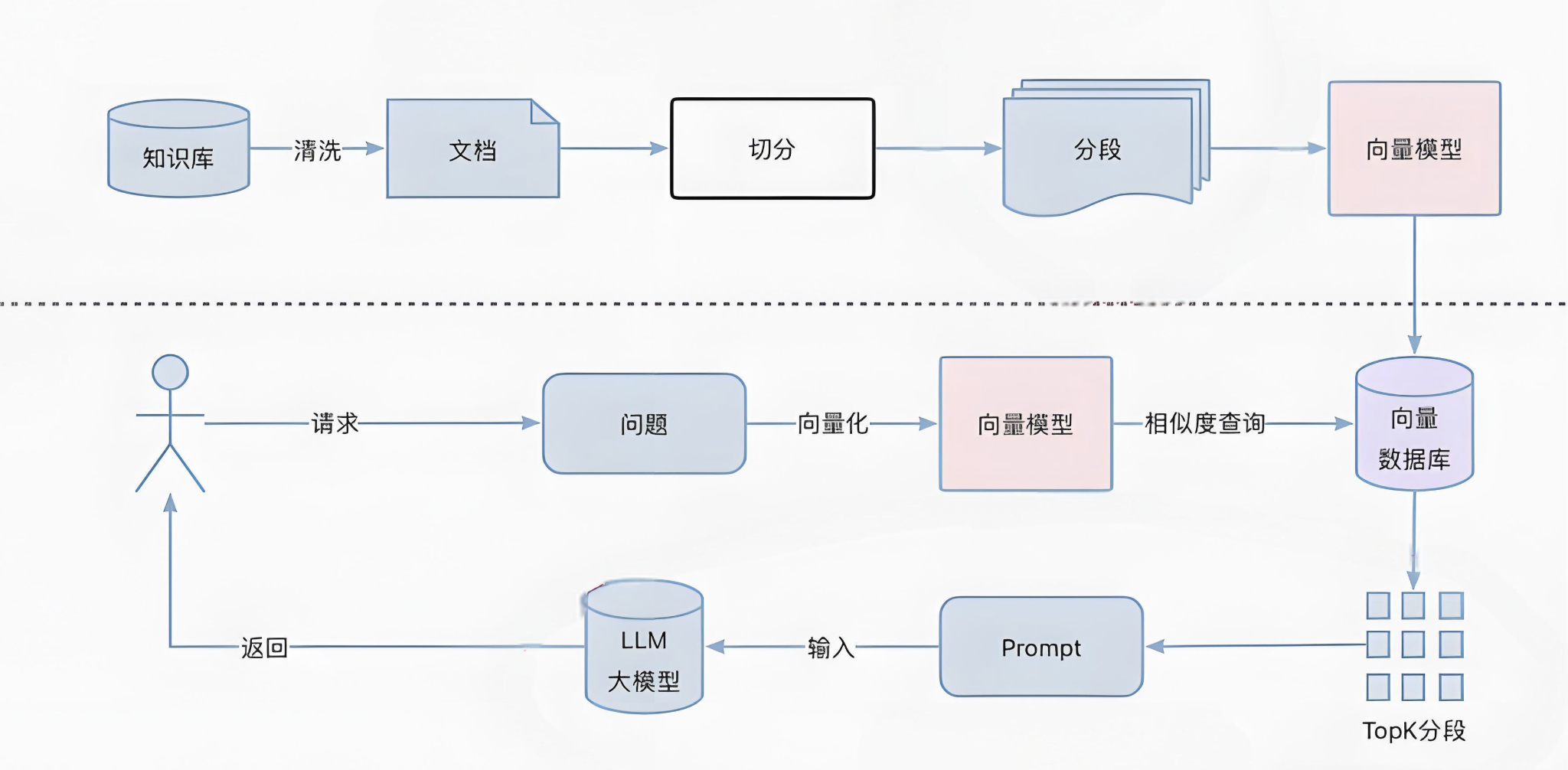

AnythingLLM 是一款多功能人工智能应用,旨在为用户提供一个统一的平台来处理多种类型的文档和模型。无论是在 Windows、MacOS,还是 Linux 系统上,用户都可以通过简单的“一键安装”来获取完整的工具套件。它支持包括 PDF、Word 文档等多种格式的文件处理,并允许用户连接各种自定义或开源的语言模型,如 GPT-4、Llama、Mistral 等,因此用户不再受到单一模型的约束。此外,AnythingLLM 能够完全在本地运行,只与用户明确连接的服务进行交互,这大大增强了数据的隐私保护。此次使用的 Flexus X 实例配置还是很高的 4 核 12G-100G-3M 规格的基础模式,尽管本地运行 ollama 模型,也能在推理过程中抗住压力,稳定输出,尽管输出缓慢,CPU 和内存占用也没有超过 60%,整体体验很好。

喜欢用 Docker 部署有趣项目?华为云服务器助你轻松实现!高性能、高可靠,支持一键部署 Docker 环境,快速启动你的创意项目。现在华为云服务器正进行 828 B2B 企业节,限时优惠,立即抢购,让你的项目飞速上线!

审核编辑 黄宇

-

云服务器

+关注

关注

0文章

840浏览量

14747 -

华为云

+关注

关注

3文章

2836浏览量

19372 -

LLM

+关注

关注

1文章

350浏览量

1394

发布评论请先 登录

HPM知识库 | [EtherCAT] 从站运行过程中报错(错误码:0x1A\\0x1B\\0x2C)的代码分析

![HPM<b class='flag-5'>知识库</b> | [EtherCAT] 从站运行过程中报错(错误码:0x1A\\0x1B\\0x2C)的代码分析](https://file1.elecfans.com/web2/M00/37/D7/pYYBAGI9l9uAOwALAAAmFmqVYdg094.png)

鸿蒙智能体开发知识库---创建知识库

设备维修总踩坑?故障知识库 + AI 诊断,新手也能修复杂机

【CIE全国RISC-V创新应用大赛】+ 一种基于LLM的可通过图像语音控制的元件库管理工具

工业物联网平台适合私有本地部署还是云端部署?

NVIDIA TensorRT LLM 1.0推理框架正式上线

DeepSeek模型如何在云服务器上部署?

本地部署openWebUI + ollama+DeepSeek 打造智能知识库并实现远程访问

米尔RK3576部署端侧多模态多轮对话,6TOPS算力驱动30亿参数LLM

零基础在智能硬件上克隆原神可莉实现桌面陪伴(提供人设提示词、知识库、固件下载)

如何在魔搭社区使用TensorRT-LLM加速优化Qwen3系列模型推理部署

使用NVIDIA Triton和TensorRT-LLM部署TTS应用的最佳实践

在Cherry Studio中快速使用markitdown MCP Server?

部署基于 LLM 的私有知识库系统 AnythingLLM

部署基于 LLM 的私有知识库系统 AnythingLLM

评论