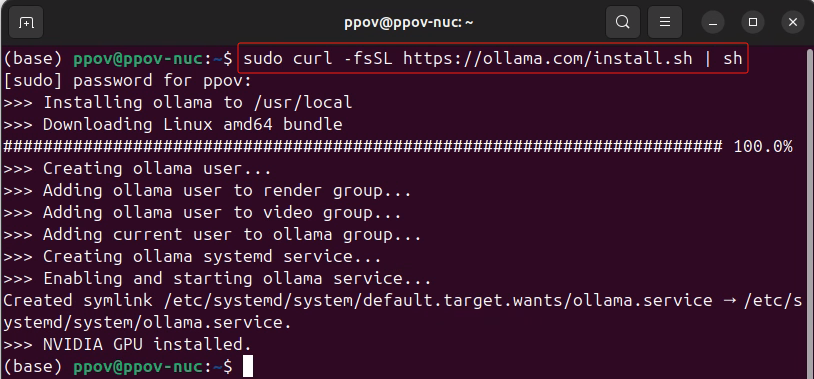

Ollama 是一个开源的大语言模型服务工具,它的核心目的是简化大语言模型(LLMs)的本地部署和运行过程,请参考《Gemma 2+Ollama在算力魔方上帮你在LeetCode解题》,一条命令完成Ollama的安装。

一,Llama3.2 Vision简介

Llama 3.2 Vision是一个多模态大型语言模型(LLMs)的集合,它包括预训练和指令调整的图像推理生成模型,有两种参数规模:11B(110亿参数)和90B(900亿参数)。Llama 3.2 Vision在视觉识别、图像推理、字幕以及回答有关图像的通用问题方面进行了优化,在常见的行业基准上优于许多可用的开源和封闭多模式模型。

二,在算力魔方4060版上完成部署

算力魔方®4060版是一款包含4060 8G显卡的迷你主机,运行:

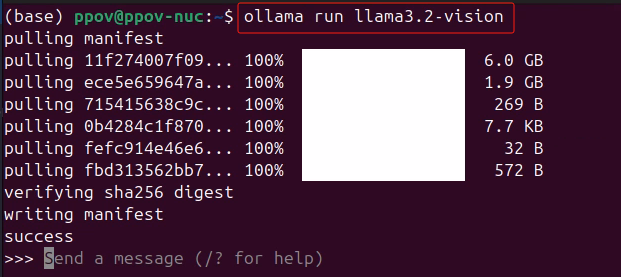

ollama run llama3.2-vision

完成Llama 3.2 Vision 11B模型下载和部署。

三,Llama 3.2实现图片识别

将图片输入Llama3.2-Vision,然后直接输入问题,即可获得图片信息,如下面视频所示:

视频若无加载,请移步至主页查看关联视频。

四,总结

在算力魔方®4060版上,用Ollama轻松搞定Llama 3.2 Vision模型本地部署。

更多精彩内容请关注“算力魔方®”!

审核编辑 黄宇

-

模型

+关注

关注

1文章

3844浏览量

52295 -

Vision

+关注

关注

1文章

205浏览量

19502

发布评论请先 登录

本地部署OpenClaw,只要500元的开发板?

技嘉与趋境科技联合部署AMaaS平台 推动本地大模型应用加速落地

从云端到边缘:联发科MT8371/MT8391平台实现7B大模型本地部署

【CIE全国RISC-V创新应用大赛】基于 K1 AI CPU 的大模型部署落地

工业物联网平台适合私有本地部署还是云端部署?

vision board部署模型到openmv的代码导致连接超时怎么解决?

本地部署openWebUI + ollama+DeepSeek 打造智能知识库并实现远程访问

宏集HMI-4G套装,轻松搞定“数据上云+异地远程运维”

用Ollama轻松搞定Llama 3.2 Vision模型本地部署

用Ollama轻松搞定Llama 3.2 Vision模型本地部署

评论