12 月 19 日,OpenAI宣布加紧内部安全防护工作,设立“安全顾问小组”以防范有害人工智能的潜在威胁。这一举措意味着技术团队之上增加新的“守护者”,为领导层提供专业意见,且拥有董事会的否决权。

OpenAI将针对每个模型在网络安全、说服力(如虚假信息)、模型自主性以及 CBRN(化学、生物、放射性和核威胁,如制造新病原体的可能性)等四个方面进行风险评级。

为了防止某些问题得不到充分讨论或处理,OpenAI设定了多种可能的缓解策略,例如模型拒绝教授如何制作凝固汽油或管式炸弹的传授。对于评级认定为“高风险”的模型,将禁止其发布;而若模型存在“关键风险”,则终止其后续研发。

然而,负责研发模型的人员并非最佳安全评估和建议者。为此,OpenAI正筹建一支“跨职能安全咨询小组”,涉足技术领域,审查研究人员报告,从更全面的视角提供建议,发掘此前未曾意识到的隐忧。

这个过程要求安全专家的意见同步反馈至董事会及领导层,领导层将权衡利弊并作出决定;尽管董事会享有最终决定权,但他们也可以随时撤回决定,防止潜在的安全隐患被忽略。

本次更新的重要焦点在于,OpenAI前任首席执行官Sam Altman因模型安全问题被董事会罢免。此次高层人事变动,导致两位主张谨慎做事的董事Ilya Sutskever和 Helen Toner离任。

然而,业界仍存担忧,若专家小组提出建议、CEO据此决策,眼下的 OpenAI董事会是否有足够力量制止此举?此外,OpenAI允诺引入独立第三方审计体现的透明度问题是否真正得到解决?

-

网络安全

+关注

关注

11文章

3516浏览量

63572 -

人工智能

+关注

关注

1820文章

50335浏览量

266976 -

OpenAI

+关注

关注

9文章

1250浏览量

10281

发布评论请先 登录

智慧城市如何应对视频应用系统安全威胁

《人工智能应用开发-中级(大模型)》认证证书含金量如何?怎么考?

人工智能时代,如何打造网络安全“新范式”

在物联网设备面临的多种安全威胁中,数据传输安全威胁和设备身份安全威胁有何本质区别?

四维图新亮相2025国际前瞻人工智能安全与治理大会

【艾为视角】保证大方向正确!利用人工智能解决一线实际问题

利用超微型 Neuton ML 模型解锁 SoC 边缘人工智能

“人工智能+”行动重磅发布!ElfBoard助力嵌入式教育智能化升级

挖到宝了!人工智能综合实验箱,高校新工科的宝藏神器

挖到宝了!比邻星人工智能综合实验箱,高校新工科的宝藏神器!

最新人工智能硬件培训AI 基础入门学习课程参考2025版(大模型篇)

芯盾时代引领人工智能安全治理新范式

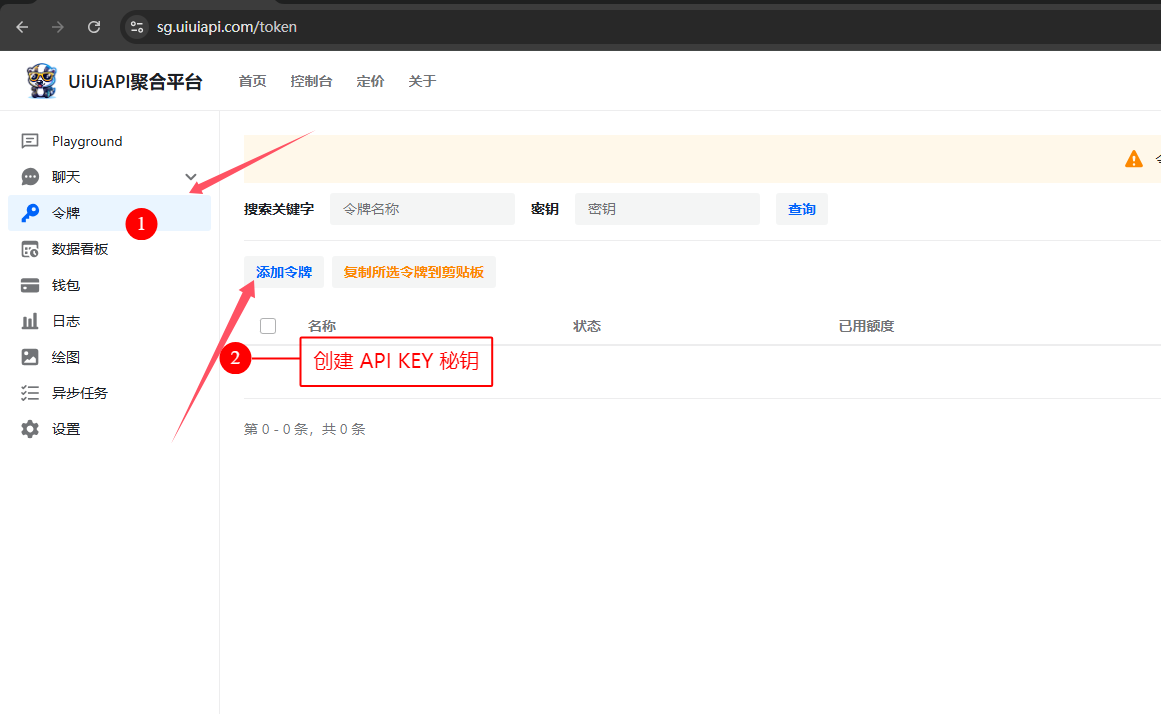

如何获取 OpenAI API Key?API 获取与代码调用示例 (详解教程)

OpenAI强化内部安全流程,应对有害人工智能威胁

OpenAI强化内部安全流程,应对有害人工智能威胁

评论