深度学习框架区分训练还是推理吗

深度学习框架是一个非常重要的技术,它们能够加速深度学习的开发与部署过程。在深度学习中,我们通常需要进行两个关键的任务,即训练和推理。训练是指使用训练数据训练神经网络模型,以便将来能够进行准确的预测。推理是指在训练完成后,使用已经训练好的模型进行新的预测。然而,深度学习框架是否区分训练和推理呢?

大多数深度学习框架是区分训练和推理的。这是因为,在训练和推理过程中,使用的是不同的算法和数据流程。具体而言,在训练过程中,我们需要计算神经网络模型中的梯度,并将其用于反向传播算法,以更新模型参数。这种计算通常需要大量的计算资源和时间。另外,在训练过程中,我们通常会使用大量的训练数据进行模型训练,这些训练数据需要在每一次迭代时传递给模型。这些数据也需要消耗大量的内存和处理能力。相反,在推理过程中,我们仅需要将输入数据传递给模型,进行预测即可。这种预测通常会快速执行,因为它通常不需要进行梯度计算和反向传播。

因此,大多数深度学习框架会在设计时考虑到这一点,可以提供训练和推理的不同接口,并且会自动选择适当的算法和数据处理流程。例如,在Python中,TensorFlow、PyTorch和Keras等深度学习框架都提供了不同的API来支持训练和推理。在这些框架中,我们可以使用相同的模型来进行训练和推理,但需要使用不同的API。通常,训练API会提供训练数据、模型以及训练参数,而推理API仅需提供输入数据和经过训练的模型即可。

此外,许多深度学习框架还提供了优化和加速训练和推理的选项。例如,TensorFlow和PyTorch都支持GPU加速训练和推理,这可以显著加速深度学习应用程序的执行时间。另外,许多深度学习框架还支持分布式训练和推理,因此可以在多个计算节点上同时运行算法。这些优化和加速选项可以帮助我们更高效地利用计算资源,并加速深度学习应用程序的执行时间。

总结:

在本文中,我们探讨了深度学习框架是否区分训练和推理。我们发现,在训练和推理过程中,使用的是不同的算法和数据流程,因此大多数深度学习框架都会提供不同的接口,以支持训练和推理。此外,这些框架还提供了优化和加速训练和推理的选项,这可以加速深度学习应用程序的执行时间。

-

神经网络

+关注

关注

42文章

4847浏览量

108478 -

深度学习

+关注

关注

73文章

5614浏览量

124804

发布评论请先 登录

深度学习为什么还是无法处理边缘场景?

HM博学谷狂野AI大模型第四期

机器学习和深度学习中需避免的 7 个常见错误与局限性

【团购】独家全套珍藏!龙哥LabVIEW视觉深度学习实战课(11大系列课程,共5000+分钟)

【团购】独家全套珍藏!龙哥LabVIEW视觉深度学习实战课程(11大系列课程,共5000+分钟)

在Ubuntu20.04系统中训练神经网络模型的一些经验

NVIDIA TensorRT LLM 1.0推理框架正式上线

摩尔线程发布Torch-MUSA v2.1.1版本

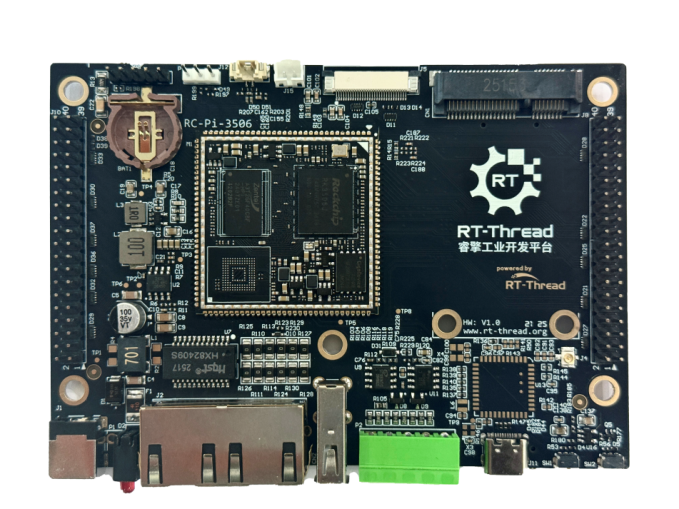

【机器视觉】睿擎平台支持NCNN AI 推理框架,轻松实现实时目标检测( 睿擎线下 Workshop 报名已开启)|产品动

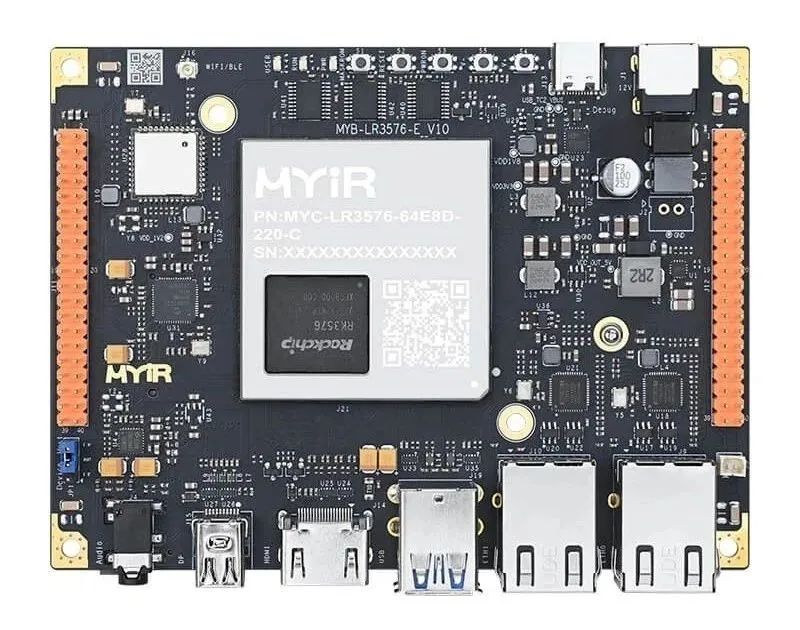

基于米尔瑞芯微RK3576开发板部署运行TinyMaix:超轻量级推理框架

如何在RK3576开发板上运行TinyMaix :超轻量级推理框架--基于米尔MYD-LR3576开发板

深度学习框架区分训练还是推理吗

深度学习框架区分训练还是推理吗

评论