电子发烧友网报道(文/李弯弯)不久前,IBM 研究院推出了一款AI处理器,名为人工智能单元(Artificial Intelligent Unit,AIU),这是IBM首个用于运行和训练深度学习模型的完整 SoC。IBM声称,其比通用CPU工作更快、更高效。

AIU:32个处理器核心、230亿个晶体管

这款AIU芯片是IBM研究院AI硬件中心投入五年开发出的结果,AI硬件中心于2019年启动,专注于开发下一代芯片与AI系统。该中心的目标是,计划未来每年将AI硬件效率提升2.5倍。到2029年,将AI模型的训练和运行速度拉高1000倍。

据IBM介绍,该芯片采用5nm制程工艺,共有32个处理器核心和230亿个晶体管,在设计易用性方面,与普通显卡相当,能够介入任何带有PCI插槽的计算机或服务器。AIU芯片,旨在支持多种格式并简化从图像识别到自然语言处理的人工智能工作流程。

AIU芯片与传统用于训练的GPU芯片有何不同?一直以来,深度学习模型依赖于CPU加GPU协处理器的组合进行训练与运行。GPU最初是为沉浸图形图像而开发,后来人们发现其在AI领域有着显著优势,因此GPU在AI训练领域占据了非常重要的位置。

IBM开发的AIU并非图形处理器,它是专为深度学习模型加速设计的,针对矩阵和矢量计算进行了优化。AIU能够解决高复杂计算问题,并以远超CPU的速度执行数据分析。

AIU芯片有何特点呢?过去这些年,AI与深度学习模型在各行各业中快速普及,同时深度学习的发展也给算力资源带来了巨大的压力。深度学习模型的体量越来越大,包含数十亿甚至数万亿个参数。而硬件效率的发展却似乎跟不上深度学习模型的增长速度。

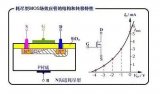

过去,计算一般集中在高精度64位与32位浮点运算层面。IBM认为,有些计算任务并不需要这样的精度,于是提出了降低传统计算精度的新术语——近似计算。

如何理解呢?IBM认为对于常见的深度学习任务,其实并不需要那么高的计算精度,就比如说人类大脑,即使没有高分辨率,也能够分辨出家人或者小猫。也就是说各种任务,其实都可以通过近似计算来处理。

在AIU芯片的设计中,近似计算发挥着重要作用。IBM研究人员设计的AIU芯片精度低于CPU,而这种较低精度也让新型AIU硬件加速器获得了更高的计算密度。IBM使用混合8位浮点(HFP)计算,而非AI训练中常见的32位或16点浮点计算。由于精度较低,因此该芯片的运算执行速度可达到FP16的2倍,同时继续保持类似的训练效能。

IBM在AI芯片技术上的不断升级

在去年2月的国际固态电路会议(ISSCC 2021)上,IBM也曾发布过一款性能优异的AI芯片,据IBM称它是当时全球首款高能效AI芯片,采用7nm制程工艺,可达到80%以上的训练利用率和60%以上的推理利用率,而通常情况下,GPU的利用率在30%以下。

有对比数据显示,IBM 7nm高能效AI芯片的性能和能效,不同程度地超过了IBM此前推出的14nm芯片、韩国科学院(KAIST)推出的65nm芯片、平头哥推出的12nm芯片含光800、NVIDIA推出的7nm芯片A100、联发科推出的7nm芯片。

IBM去年推出的这款7nm AI芯片支持fp8、fp16、fp32、int4、int2混合精度。在fp32和fp8精度下,这款芯片每秒浮点运算次数分别达到16TFLOPS和25.6TFLOPS,能效比为3.5TFLOPS/W和1.9TFLOPS。而被业界高度认可的NVIDIA A100 GPU在fp16精度下的能效比为0.78TFLOPS/W,低于IBM这款高能效AI芯片。

IBM在官网中称,这款AI芯片之所以能够兼顾能效和性能,是因为该芯片支持超低精度混合8位浮点格式((HFP8,hybrid FP8)。这是IBM于2019年发布的一种高度优化设计,允许AI芯片在低精度下完成训练任务和不同AI模型的推理任务,同时避免任何质量损失。

可以看到IBM此次发布的新款AIU与去年2月发布的7nm AI芯片,都采用了IBM此前提出的近似计算。从性能来看,去年推出的那款AI芯片一定程度上甚至超过了目前业界训练场景普遍使用的NVIDIA A100 GPU,而今年新推出的AIU无论是在制程工艺、晶体管数量上都有升级,可想而知性能水平将会更高。

AIU:32个处理器核心、230亿个晶体管

这款AIU芯片是IBM研究院AI硬件中心投入五年开发出的结果,AI硬件中心于2019年启动,专注于开发下一代芯片与AI系统。该中心的目标是,计划未来每年将AI硬件效率提升2.5倍。到2029年,将AI模型的训练和运行速度拉高1000倍。

据IBM介绍,该芯片采用5nm制程工艺,共有32个处理器核心和230亿个晶体管,在设计易用性方面,与普通显卡相当,能够介入任何带有PCI插槽的计算机或服务器。AIU芯片,旨在支持多种格式并简化从图像识别到自然语言处理的人工智能工作流程。

AIU芯片与传统用于训练的GPU芯片有何不同?一直以来,深度学习模型依赖于CPU加GPU协处理器的组合进行训练与运行。GPU最初是为沉浸图形图像而开发,后来人们发现其在AI领域有着显著优势,因此GPU在AI训练领域占据了非常重要的位置。

IBM开发的AIU并非图形处理器,它是专为深度学习模型加速设计的,针对矩阵和矢量计算进行了优化。AIU能够解决高复杂计算问题,并以远超CPU的速度执行数据分析。

AIU芯片有何特点呢?过去这些年,AI与深度学习模型在各行各业中快速普及,同时深度学习的发展也给算力资源带来了巨大的压力。深度学习模型的体量越来越大,包含数十亿甚至数万亿个参数。而硬件效率的发展却似乎跟不上深度学习模型的增长速度。

过去,计算一般集中在高精度64位与32位浮点运算层面。IBM认为,有些计算任务并不需要这样的精度,于是提出了降低传统计算精度的新术语——近似计算。

如何理解呢?IBM认为对于常见的深度学习任务,其实并不需要那么高的计算精度,就比如说人类大脑,即使没有高分辨率,也能够分辨出家人或者小猫。也就是说各种任务,其实都可以通过近似计算来处理。

在AIU芯片的设计中,近似计算发挥着重要作用。IBM研究人员设计的AIU芯片精度低于CPU,而这种较低精度也让新型AIU硬件加速器获得了更高的计算密度。IBM使用混合8位浮点(HFP)计算,而非AI训练中常见的32位或16点浮点计算。由于精度较低,因此该芯片的运算执行速度可达到FP16的2倍,同时继续保持类似的训练效能。

IBM在AI芯片技术上的不断升级

在去年2月的国际固态电路会议(ISSCC 2021)上,IBM也曾发布过一款性能优异的AI芯片,据IBM称它是当时全球首款高能效AI芯片,采用7nm制程工艺,可达到80%以上的训练利用率和60%以上的推理利用率,而通常情况下,GPU的利用率在30%以下。

有对比数据显示,IBM 7nm高能效AI芯片的性能和能效,不同程度地超过了IBM此前推出的14nm芯片、韩国科学院(KAIST)推出的65nm芯片、平头哥推出的12nm芯片含光800、NVIDIA推出的7nm芯片A100、联发科推出的7nm芯片。

IBM去年推出的这款7nm AI芯片支持fp8、fp16、fp32、int4、int2混合精度。在fp32和fp8精度下,这款芯片每秒浮点运算次数分别达到16TFLOPS和25.6TFLOPS,能效比为3.5TFLOPS/W和1.9TFLOPS。而被业界高度认可的NVIDIA A100 GPU在fp16精度下的能效比为0.78TFLOPS/W,低于IBM这款高能效AI芯片。

IBM在官网中称,这款AI芯片之所以能够兼顾能效和性能,是因为该芯片支持超低精度混合8位浮点格式((HFP8,hybrid FP8)。这是IBM于2019年发布的一种高度优化设计,允许AI芯片在低精度下完成训练任务和不同AI模型的推理任务,同时避免任何质量损失。

可以看到IBM此次发布的新款AIU与去年2月发布的7nm AI芯片,都采用了IBM此前提出的近似计算。从性能来看,去年推出的那款AI芯片一定程度上甚至超过了目前业界训练场景普遍使用的NVIDIA A100 GPU,而今年新推出的AIU无论是在制程工艺、晶体管数量上都有升级,可想而知性能水平将会更高。

声明:本文内容及配图由入驻作者撰写或者入驻合作网站授权转载。文章观点仅代表作者本人,不代表电子发烧友网立场。文章及其配图仅供工程师学习之用,如有内容侵权或者其他违规问题,请联系本站处理。

举报投诉

-

芯片

+关注

关注

463文章

54706浏览量

471502 -

IBM

+关注

关注

3文章

1891浏览量

77234

发布评论请先 登录

相关推荐

热点推荐

Onsemi双PNP偏置电阻晶体管:设计与性能剖析

Onsemi双PNP偏置电阻晶体管:设计与性能剖析 在电子设计领域,晶体管是不可或缺的基础元件。Onsemi推出的MUN5131DW1和NSBA123EDXV6双PNP偏置电阻晶体管,

onsemi 2SA2222SG PNP双极晶体管:性能与应用解析

的 2SA2222SG 双极晶体管,看看它有哪些独特的性能和应用场景。 文件下载: 2SA2222SG-D.PDF 一、产品特性 先进工艺 2SA2222SG 采用了 MBIT 工艺,

探索 onsemi 2SC6144SG NPN 双极晶体管:高性能与多用途的完美结合

特性 先进工艺 2SC6144SG 采用了 MBIT 工艺,这一先进工艺为晶体管带来了一系列优异的性能。 大电流

2SC6096 NPN双极晶体管:设计应用与性能解析

2SC6096 NPN双极晶体管:设计应用与性能解析 在电子电路设计中,晶体管是不可或缺的基础元件。今天我们要深入探讨的是ON Semiconductor推出的2SC6096 NPN双极晶体管

2SC6099 NPN双极晶体管:高效性能与广泛应用

,看看它有哪些特性和应用场景。 文件下载: 2SC6099-D.PDF 产品特性 先进工艺 2SC6099采用了FBET和MBIT工艺,这种先进的制造工艺为晶体管带来了诸多优势。它使得

电子工程师必备:MJE340晶体管深度解析

电子工程师必备:MJE340晶体管深度解析 在电子工程师的日常工作中,晶体管是不可或缺的基础元件之一。今天,我们就来深入探讨一款高性能的晶体管

高性能GaN HEMT晶体管CGHV40100:特性与应用深度解析

高性能GaN HEMT晶体管CGHV40100:特性与应用深度解析 在射频(RF)和微波应用领域,高性能晶体管的需求不断增长,Wolfspe

漏致势垒降低效应如何影响晶体管性能

随着智能手机、电脑等电子设备不断追求轻薄化,芯片中的晶体管尺寸已缩小至纳米级(如3nm、2nm)。但尺寸缩小的同时,一个名为“漏致势垒降低效应(DIBL)”的物理现象逐渐成为制约

【「AI芯片:科技探索与AGI愿景」阅读体验】+半导体芯片产业的前沿技术

为我们重点介绍了AI芯片在封装、工艺、材料等领域的技术创新。

一、摩尔定律

摩尔定律是计算机科学和电子工程领域的一条经验规律,指出集成电路上可容纳的晶体管数量每18-24个月会增加一倍,同时芯

发表于 09-15 14:50

【「AI芯片:科技探索与AGI愿景」阅读体验】+工艺创新将继续维持着摩尔神话

。那该如何延续摩尔神话呢?

工艺创新将是其途径之一,芯片中的晶体管结构正沿着摩尔定律指出的方向一代代演进,本段加速半导体的微型化和进一步集成,以满足AI技术及高性能计算飞速发展的需求。

发表于 09-06 10:37

今日看点丨蔚来自研全球首颗车规5nm芯片!;沃尔沃中国区启动裁员计划

低延时,快速响应。”此外,李斌还表示,这款芯片对全行业开放,谁想用都可以找我们,还可以降本。 据悉,神玑NX9031芯片和底层软件均实现自主设计,拥有超过500亿颗晶体管。

发表于 07-08 10:50

•2318次阅读

IBM全新AIU芯片:5nm工艺,230亿晶体管!深度学习处理性能强劲!

IBM全新AIU芯片:5nm工艺,230亿晶体管!深度学习处理性能强劲!

评论