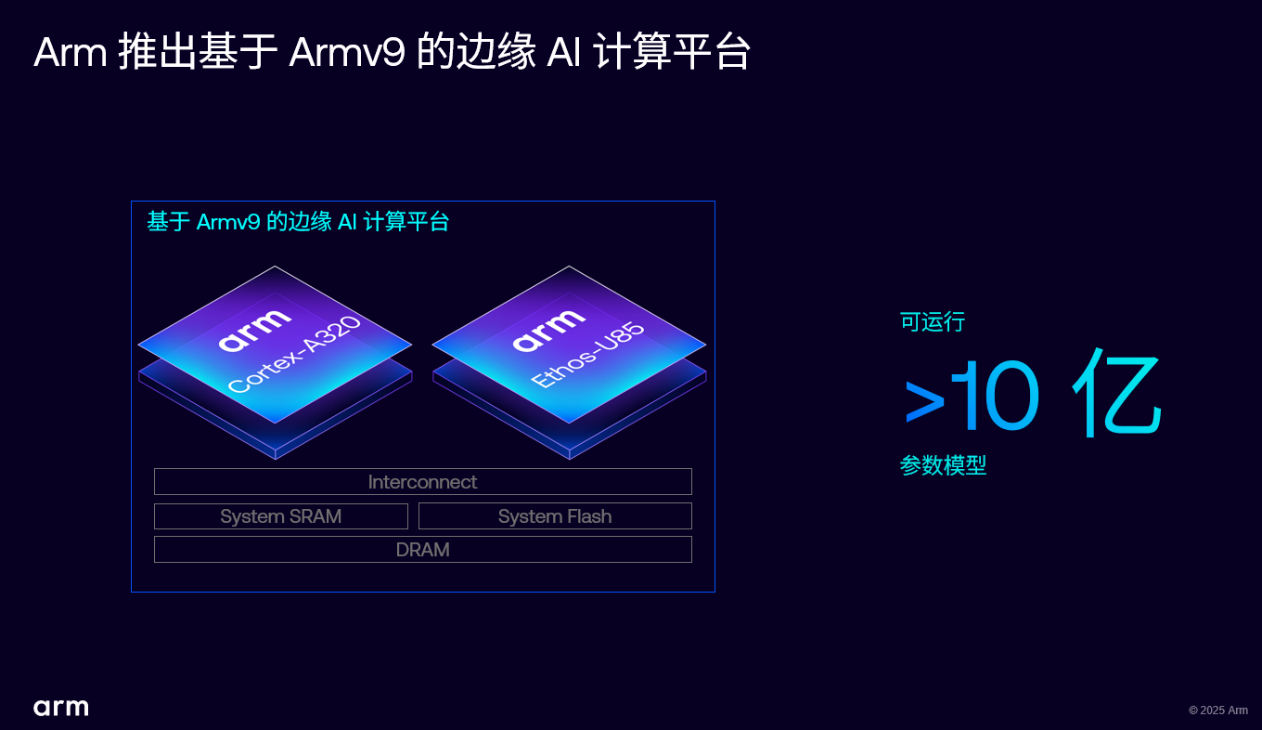

电子发烧友网报道(文/黄晶晶)当下,快速发展的 AI 正不断赋予边缘设备越来越先进的智能性,使边缘设备胜任越来越重要的任务。为应对边缘侧持续增长的 AI 需求,Arm 近日发布以全新基于 Armv9 架构的超高能效 CPU——Arm Cortex-A320 以及对 Transformer 网络具有原生支持的 Ethos-U85 AI 加速器为核心的边缘AI 计算平台,可支持运行超 10 亿参数的端侧 AI 模型。

全新超高能效 Arm Cortex-A320 CPU 引领边缘 AI 变革

据 Arm 物联网事业部业务拓展副总裁马健分享,此次全新推出的 Cortex-A320 是 Arm 首个基于 Armv9 架构的超高能效 CPU,为物联网应用专门优化,将彻底变革边缘 AI。在ML性能方面,Cortex-A320 相较于前代超高能效 CPU (Cortex-A35) 提升了高达 10 倍的 ML 计算能力。其能效较 Cortex-A520(Arm 的高能效 Armv9.2 CPU)提升了 50%,进一步降低了功耗。在标量计算性能方面,Cortex-A320 的性能比前代 Cortex-A35 提高了 30%,带来了更强的通用计算能力。

马健指出,随着对支持更大规模、多模态 AI 模型的硬件需求不断增长,系统的内存需求也在迅速提升。因此,具备更高内存访问性能的系统变得尤为必要,以满足更复杂的应用场景。相比 Cortex-M,Cortex-A 处理器支持更大的可寻址内存空间,并能够更灵活地管理多层次内存访问延迟。

同时,随着边缘 AI 负载变得越来越复杂,对更强大、更灵活的操作系统进行系统管理的需求也在增加。而传统的 Cortex-M 一般只能跑实时操作系统,但功能丰富的操作系统可以使得设备管理更加灵活。

Cortex-A320 具备支持多种操作系统的能力,无论是如 FreeRTOS 和 Zephyr 的实时操作系统 (RTOS),还是如 Linux 和 Android 的功能丰富的操作系统,都能提供高效支持。与此同时,凭借 Arm的 A处理器架构优势,Cortex-A320 可开箱即用地支持 Linux,并且能够轻松移植安卓及其他现有的功能丰富的操作系统。此外,Cortex-A320 最高可支持四核共享集群,可根据不同需求灵活扩展,满足各种应用场景的需求。

Cortex-A320 还为现有的物联网领域的 Cortex-A 产品提供了灵活的升级路径。无论是从 Cortex-A35 迁移,还是从全球出货量最高的基于 Armv8 架构的 Cortex-A 处理器 Cortex-A53 升级,Cortex-A320 都提供了理想的 Armv9 迁移方案,并带来了众多优势,包括更先进的安全性、广泛的 Armv9 软件生态的支持,以及更高的计算性能。

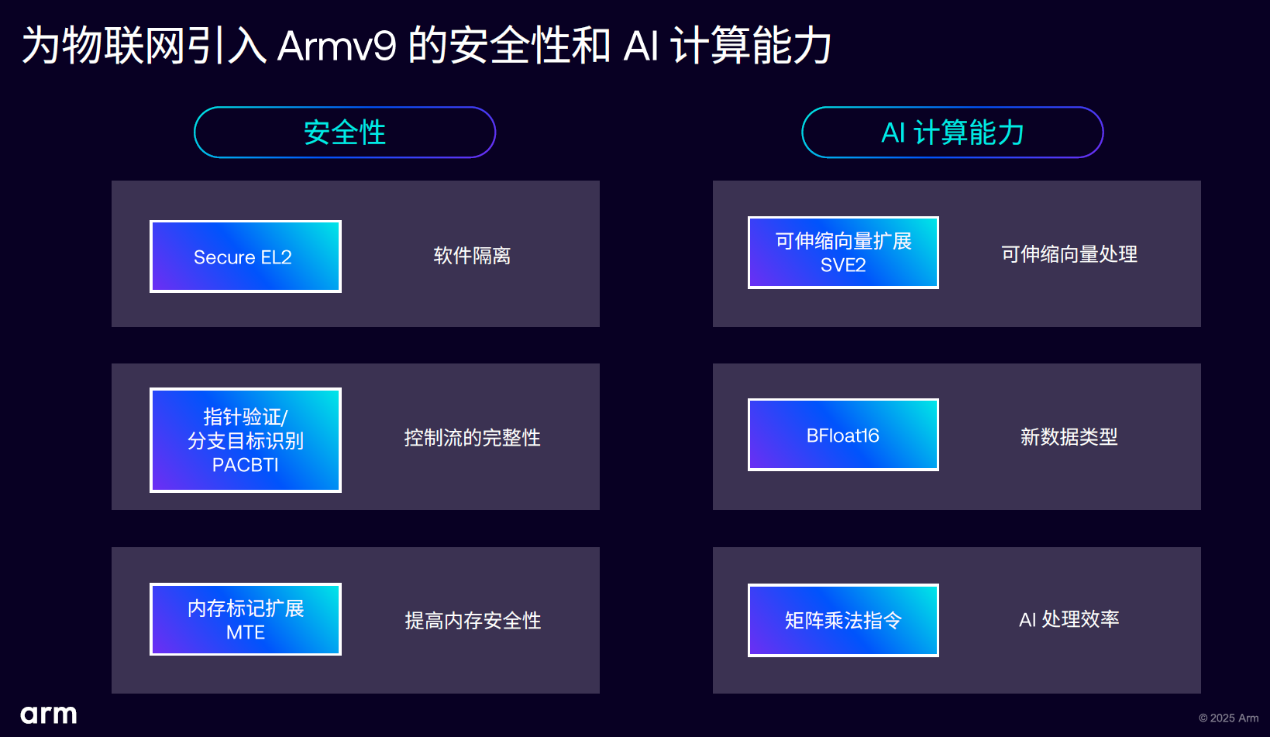

此外,随着边缘应用场景日趋复杂,以及设备端软件及数据价值日益凸显,安全性问题比以往任何时候都更为关键,Cortex-A320 充分利用了 Armv9 增强的安全性和AI 计算特性。在安全性方面,Secure EL2 增强了 TrustZone 内部的隔离性,支持更安全地运行软件容器。指针验证/分支目标识别 (PACBTI)可有效缓解跳转和返回编程中的指针安全隐患。内存标记扩展 (MTE)通过内存标记机制,使黑客更难利用漏洞进行攻击,提高整体系统安全性。

AI 计算能力增强方面,Armv9 具有增强的 Neon 和可伸缩向量扩展 (SVE2) 技术,提供更高效的 ML 计算能力。其还支持例如 BFloat16 等新数据类型,提高 AI 计算的精度和能效。不仅如此,新增的矩阵乘法指令能够优化 AI 和 ML 计算性能,加速神经网络推理和训练任务。

Cortex-A320 与 Ethos-U85 深度配合,相得益彰

Arm Cortex-A320 CPU 和 Ethos-U85 NPU 是此次发布的边缘 AI 计算平台的两大核心。该平台具备强大的计算能力,比去年的基于 Cortex-M85 搭配 Ethos-U85 的平台提升了8倍的 ML 计算性能,带来了显著的 AI 计算能力突破。

该边缘 AI 计算平台并不是 CPU 和 AI 加速器的简单堆叠,而是实现了深度配合,让 CPU 和 NPU 相得益彰。马健指出,去年 Arm 推出的集成了 Cortex-M85 和 Ethos-U85 的 Arm Corstone 物联网参考设计平台,显著提升了端侧 Transformer 网络的执行效率。随着此次边缘 AI 计算平台的发布,Ethos-U85 驱动程序已经完成更新,使得 Cortex-A320 能够直接驱动 Ethos-U85,无需额外搭载 Cortex-M。

Cortex-A320 可以为 Ethos-U85 提供更高的内存容量与带宽,让大模型在 Ethos-U85 上的执行如虎添翼;任何开发者们不希望在 Ethos-U85 上运行的 AI 操作,可以回退到 Cortex-A320,利用其 Neon/SVE2 引擎更灵活有效地在 CPU 上执行。例如,在连续图像检测任务中,通常会优先在 AI 加速器上运行,以提高能效。而对于单张图像的处理,在 CPU 上执行可能更高效。这使智能物联网与消费类电子生态系统能够在正确的时间,并在合适的地方运行最适合的工作负载。

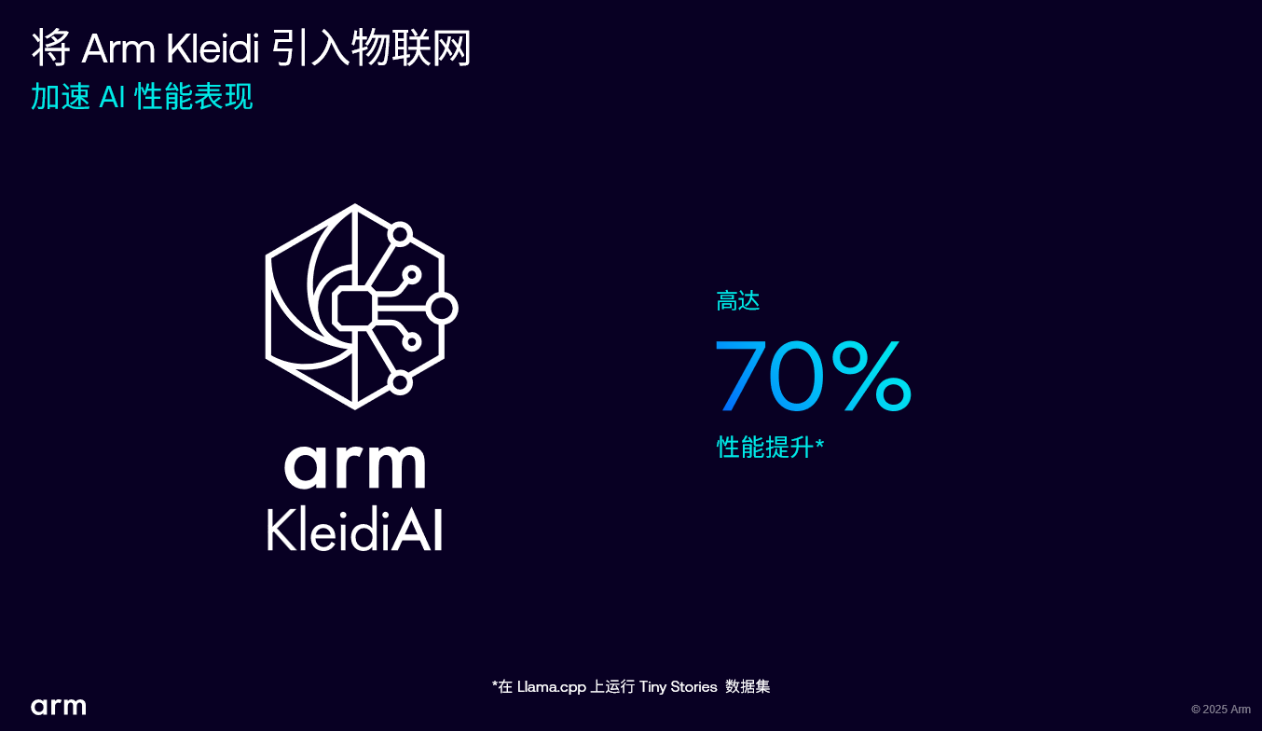

将 Arm Kleidi 扩展到物联网

边缘 AI 普及面临的最主要障碍之一是软件开发和部署的复杂性,这正是 Armv9 边缘 AI 计算平台软件生态系统发挥优势的关键所在。去年,Arm 推出了 Kleidi 软件库,并将其引入了智能手机和服务器市场,它包含优化 AI 负载在 Arm CPU 上执行的 KleidiAI 和加速机器视觉的 KleidiCV。如今,Arm 将 Kleidi 扩展到了物联网领域,以加速 AI 性能表现。

KleidiAI 是一套专为 AI 框架开发者设计的计算内核,让开发者可以无缝地在 Arm CPU 上获取最佳性能,适用于各类设备。它支持如 Neon 和 SVE2 等 Armv9 架构的关键特性,大幅提升了 AI 的计算效率。此外,KleidiAI 已经集成到多个主流 AI 框架,包括 Llama.cpp、ExecuTorch 和 LiteRT(通过 XNNPACK)它可以加速 Meta Llama 3 和 Phi-3 等主流AI 大模型,进一步释放 AI 计算性能。

更好地支持 Deepseek 等深度模型优化

谈及对AI推理应用模型的支持,马健表示:“在百模争霸的时代,模型的架构还在不断地改变,一些新的数据可以让模型变得更聪明或者有一些推理功能。深度的优化也已经开始热火朝天地进行起来了,DeepSeek 就是个非常好的例子。Deepseek 的 R1 模型已达到了 15 亿参数,跑在 Arm 全新的边缘 AI 计算平台上,理论上是绰绰有余的。”

此外,马健还表示,模型的大小有时候并不与 AI 加速器的 TOPS 直接相关,而是更多受到内存带宽和内存容量的限制。Arm 有一系列的 Cortex-A 处理器,从超高的性能到超高的能效。这一系列处理器可以有不同的内存配置。不同的内存配置可以适配不同大小的参数规模。

在AI时代,最重要的是更加贴近市场和应用,从整体上来思考产业发展的趋势和需求。Arm Cortex CPU 选择丰富,能够全面满足边缘 AI 应用场景的需求,比如 Cortex-X925 适用于非常高端的机器人领域,而Cortex- A320用在对能效有极致追求的边缘应用。此外,NPU 方面在不久的未来也将会有AI新产品加入。

由此可以看到,Arm 早已在边缘侧进行了前瞻性布局。此次发布的 Arm 边缘 AI 计算平台能高效执行复杂的 AI 任务,同时保证系统的安全性、可靠性和数据完整性。在 AI 推理时代,Arm 将继续引领行业发展。

-

ARM

+关注

关注

135文章

9589浏览量

393769

发布评论请先 登录

Supermicro推出紧凑型高能效系统:以边缘算力重构AI应用新范式

边缘AI算力临界点:深度解析176TOPS香橙派AI Station的产业价值

Arm解码边缘AI七大用例如何赋能现实生活

重磅合作!Quintauris 联手 SiFive,加速 RISC-V 在嵌入式与 AI 领域落地

AI赋能储能管理系统,通过AI模型提高能耗管理

如何在基于Arm架构的边缘AI设备上部署飞桨模型

芯原可扩展的高性能GPGPU-AI计算IP赋能汽车与边缘服务器AI解决方案

Arm 公司面向移动端市场的 Arm Lumex 深度解读

物联网工程师为什么要学Linux?

AI边缘计算网关_AI边缘智能网关赋能自助政务服务机_厦门计讯物联科技有限公司

Arm 推出 Armv9 边缘 AI 计算平台,以超高能效与先进 AI 能力赋能物联网革新

Arm 推出 Armv9 边缘 AI 计算平台,以超高能效与先进 AI 能力赋能物联网革新

评论