这家云计算巨头的计算机视觉和数据科学服务使用 NVIDIA Triton 推理服务器来加速 AI 预测。

作为一名狂热的自行车爱好者,Thomas Park 深知拥有多个变速档位对于平稳、快速骑行的重要性。

因此,当这位软件架构师为 Oracle Cloud Infrastructure(OCI)的视觉 AI 服务设计 AI 推理平台时,他选择了 NVIDIA Triton 推理服务器,因为它可以通过变换“档位”,来快速高效地处理几乎任何 AI 模型、框架、硬件和运行模式。

Park 表示:“NVIDIA AI推理平台为我们的全球云服务客户带来了巨大的灵活性,让他们可以构建和运行 AI 应用。”Park 是一位在苏黎世工作的计算机工程师,同时也是一名富有竞争力的自行车手,他曾先后就职于四家全球超大型云服务提供商。

具体而言,Triton 将 OCI 的总拥有成本降低了 10%、将迁移到 Triton 的 OCI 视觉和文档理解服务模型的预测吞吐量提高了 76%,并将推理延迟降低了 51%。Park 和一位同事在今年早些时候发布的一篇 Oracle 博客中指出,全球有超过 45 个区域数据中心在运行这些服务。

计算机视觉加速深入洞察

依靠 OCI 视觉 AI,客户可以进行各种物体检测和图像分类工作。例如,美国的一家运输公司利用它来自动检测经过的车轴数,以计算和结算过桥费,从而节省了忙碌的卡车司机在收费站的等待时间。

OCI AI 还通过 Oracle NetSuite 提供,Oracle NetSuite 是全球 37,000 多个企业组织使用的一套商业应用程序,它可以用于自动识别发票等工作。

在 Park 的努力下,Triton 如今也被其他 OCI 服务所采用。

能够识别 Triton 的数据服务

负责处理 Oracle 内外部用户机器学习事务的 OCI 数据科学服务产品管理总监 Tzvi Keisar 表示:“我们的 AI 平台能够识别 Triton,以造福于我们的客户。”

Keisar 提到:“想要使用 Triton 的客户不必担心配置问题,因为平台会自动完成配置,为他们启动一个 Triton 驱动的推理终端节点。”

Triton 包含在 NVIDIA AI Enterprise 中,该平台可提供企业所需的全方位的安全和支持,并且可以在 OCI Marketplace 上获得

一个庞大的 SaaS 平台

OCI 的数据科学服务是一个适用于 Oracle NetSuite 和 Oracle Fusion 应用程序的机器学习平台。

“这些商业应用套件规模庞大,有数以万计的客户也在我们的服务上构建他们的框架。”Keisar 说。

这些客户主要是来自于制造业、零售业、交通运输业等行业的企业用户。他们正在构建和使用几乎所有形态与规模的 AI 模型。

推理是该团队推出的首批服务之一,而 Triton 在推出后不久就进入了该团队的视线。

最佳的推理框架

“我们看到 Triton 作为一流的服务框架越来越受欢迎,于是开始试用。”Keisar 说,“我们发现它的性能非常出色,弥补了现有产品的不足,尤其是在多模型推理方面。它是目前功能最全面、最先进的推理框架。”

Triton 于 3 月在 OCI 上发布,已经吸引了 Oracle 许多内部团队的关注。他们希望将其用于需要同时运行多个 AI 模型以作出预测的推理工作。

他表示:“当用于部署在单个端点上的多个模型时,Triton 的表现和性能都非常好。”

加快未来发展

展望未来,复杂的大语言模型(LLM)激发了众多用户的想象力。为了能够在未来为这些模型上的推理提供更强大的助力,Keisar 的团队正在对 NVIDIA TensorRT-LLM 软件进行评估。

身为一名活跃的博主,Keisar 在其最新文章中详细介绍了在 NVIDIA A10 Tensor Core GPU 上运行具有高达 700 亿参数的 Llama 2 LLM 的量化技术。

他表示:“即使减低到四位参数,模型输出的质量仍然相当不错。在 NVIDIA GPU 上的部署使我们能够灵活地在延迟、吞吐量和成本之间找到良好的平衡点。”

审核编辑:刘清

-

NVIDIA

+关注

关注

14文章

5692浏览量

110118 -

计算机视觉

+关注

关注

9文章

1715浏览量

47723 -

LLM

+关注

关注

1文章

350浏览量

1394

原文标题:名不虚传:NVIDIA Triton 加速 Oracle Cloud 上的推理

文章出处:【微信号:NVIDIA-Enterprise,微信公众号:NVIDIA英伟达企业解决方案】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

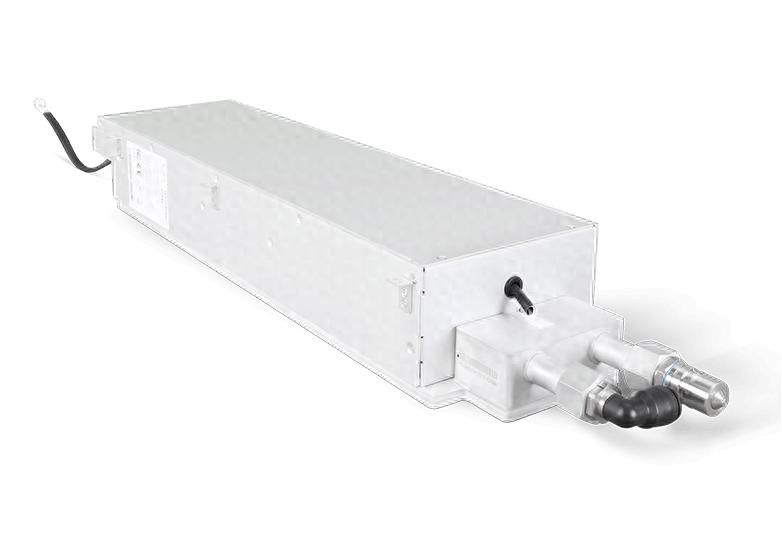

AI基建加速,服务器企业营收齐涨!液冷、高速交换机成布局重点

Supermicro率先发布NVIDIA BlueField-4 STX存储服务器,提升AI推理性能

使用NORDIC AI的好处

液冷散热时代:AI服务器如何重构磁元件设计

云加速是如何隐藏源服务器ip的

NVIDIA三台计算机解决方案如何协同助力机器人技术

信而泰×DeepSeek:AI推理引擎驱动网络智能诊断迈向 “自愈”时代

ai服务器是什么?与普通服务器有什么区别

NVIDIA计划打造全球首个工业AI云平台

使用NVIDIA Triton和TensorRT-LLM部署TTS应用的最佳实践

使用NVIDIA Triton推理服务器来加速AI预测

使用NVIDIA Triton推理服务器来加速AI预测

评论