人脑以高效著称,它以稀疏的表征方式存储和处理信息。在任何时刻,只有一小部分神经元处于活跃状态。神经科学家相信,他们可以将大脑启发的逻辑映射到运行AI模型的算法、数据结构和架构中,从而提供一个让AI降低功耗的配方。数据科学家是否愿意改变他们基于蛮力计算的AI实践,这一点尚未确定,因为这种方法似乎越来越难以为继。

正自筹资金起家的初创公司并不多见,更不用说这家公司在神经科学研究领域玩了18年的长线游戏之后,突然推出了一款商业软件产品。

更重要的是,这家初创公司的新产品直接向炙手可热的大语言模型(LLM)AI市场发出了挑战。

这家公司就是Numenta,它承诺其受神经科学启发的软件可以大幅降低在CPU上运行LLM的功耗。

持怀疑态度的人可能会认为这种策略是投机取巧。Numenta的CEO Subutai Ahmad认为,这种说法并不用准确。

Numenta将数十年的神经科学研究应用于商业产品的手段、动机和机遇都出现在AI领域。Numenta的研究人员特别注意到了AI科学家依靠蛮力计算来实现transformer的方式。

当然,神经科学和AI并非完全形同陌路。这两个学科在二十世纪五六十年代相互影响,后来逐渐分道扬镳。不过,Ahmad表示,神经科学和AI一直孤立地存在着,这点令人惊讶。

以ChatGPT为例。

尽管ChatGPT已是当红炸子鸡,但Ahmad认为,ChatGPT消耗的能源太多,最终将难以为继。他认为,只有应用神经科学的基本原理,开发者才能改变AI迈向死胡同轨迹。

了解Numenta

Numenta与其它大多数初创公司的区别在于,其联合创始人Jeff Hawkins、Donna Dubinsky和Dileep George的履历、经验和专业知识。

Hawkins在90年代是著名的Palm Pilot PDA的设计师。之后,他又在Handspring开创了名为Treo的智能手机。

Dubinsky曾在1980年代负责管理Apple的部分分销网络,又曾任Palm的CEO,后来与Hawkins共同创办了Handspring。

2005年,AI和神经科学研究员Dileep George与Hawkins和Dubinsky合作。

每位联合创始人都为Numenta带来了技术、创业和激情方面的独特面向,而Hawkins则因痴迷脑科学而闻名,他是Numenta的公众导师。他撰写了两本书,“On Intelligence”(2004年与Sandra Blakeslee合著)和“A Thousand Brains: A new theory of intelligence”(2021 年)。他在科学杂志上发表的许多论文经常被大量引用。

但具有讽刺意味的是,神经科学的进步主要局限于研究机构,对商业市场影响甚微。据Numenta的CEO Ahmad称,只有极少数实验室积极将神经科学应用于AI。“我们可能是唯一一家尝试这样做的公司。”

他说,Numenta很幸运能走到今天,但他认为ChatGPT是一个“巨大的功耗”。Ahmad坚信,Numenta基于神经科学的数据结构和算法能为LLM带来更高的效率。

Numenta的商业产品

Numenta上周推出的第一款产品是AI软件“NuPIC(Numenta Platform for Intelligent Computing)”。

NuPIC是为现有transformer设计的即插即用软件,可以在CPU上以“极高的吞吐量和低延迟”运行LLM,该公司称,“速度明显快于Nvidia A100 GPU”。

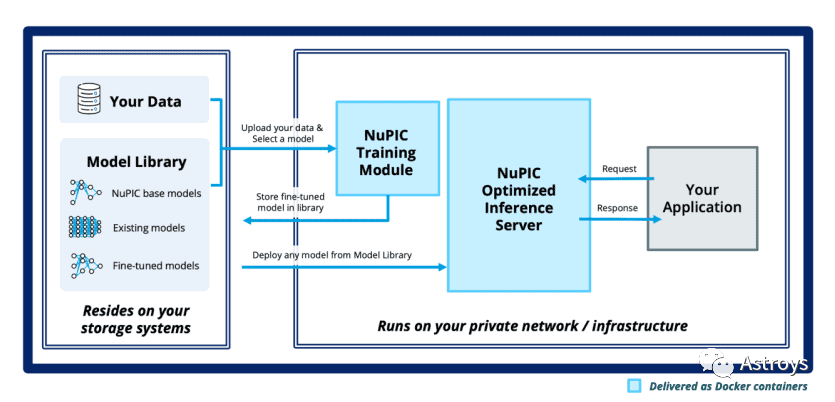

Ahmad解释说,NuPIC将作为“企业软件”授权给“希望将LLM纳入工作流程的企业”。他强调说,Numenta不提供云服务,因此这不是SaaS。NuPIC授权用户将在自己的基础设施中安装该软件,因此“数据和模型对他们来说是完全私有的”。

Numenta产品的关键之一是它可以“直接插入”现有的transformer。Ahmad说:“在外界看来,它并没有什么不同。因此,下图中的中间部分和界面看起来与AI世界已经知道的完全相同。你甚至可以把传统的transformer换成我们的transformer,整个东西仍然可以工作。”

Numenta声称,其基于神经科学的AI解决方案“能让客户实现10到100倍以上的性能提升”。这些数字似乎好得不像真的,但该公司并非凭空捏造。Numenta有与Intel合作完成的案例研究为证。

与Intel和Xilinx的合作

Intel今年在其Xeon Max系列和第四代Intel Xeon可扩展处理器上发布了x86指令集架构的新扩展,称为AMX(Advanced Matrix Extensions)。AMX设计用于矩阵,以加速AI工作负载的矩阵乘法。

Numenta的团队从去年开始与Intel合作,当时Intel正在开发AMX。Ahmad解释说,Intel正在“利用CPU并添加类似于GPU的指令来进行矩阵乘法运算。但它仍然是CPU,而这些CPU非常灵活”。

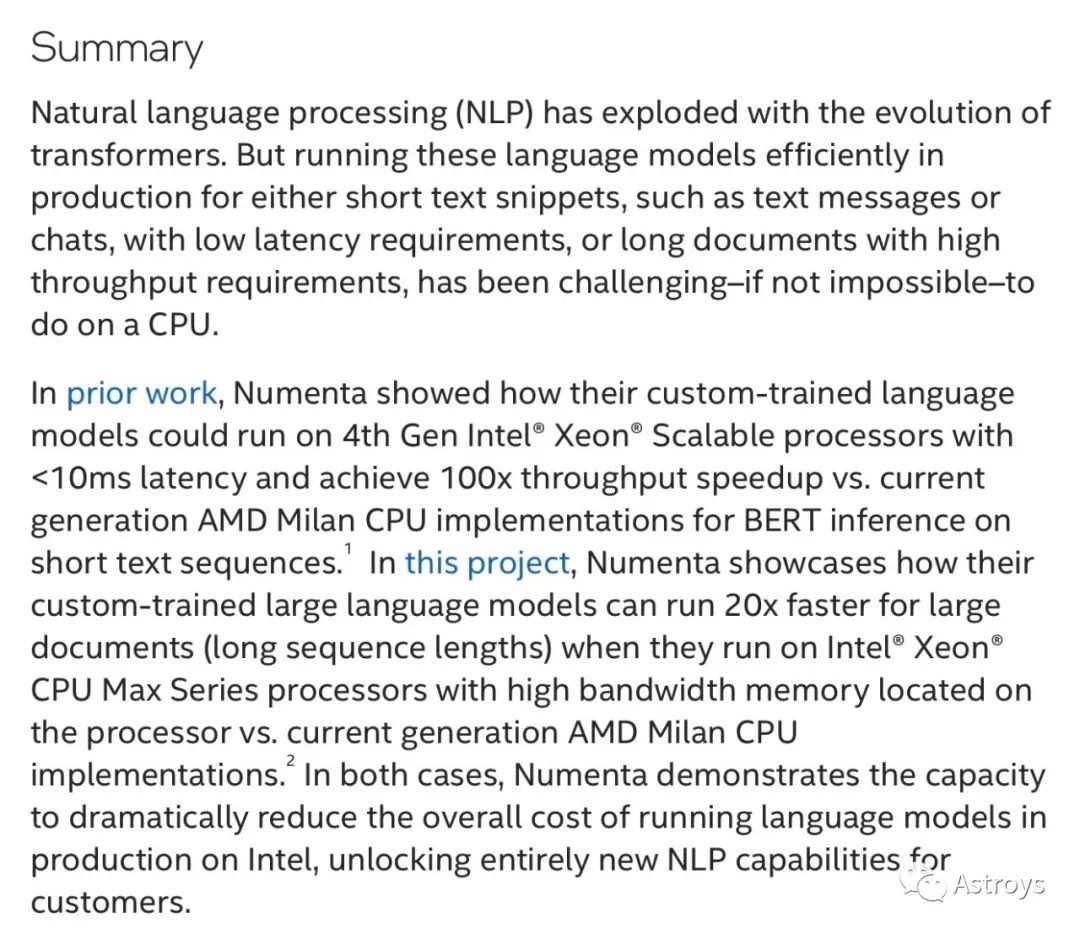

Ahmad说,这种灵活性使Numenta“可以将我们的算法移植到这些芯片上”。Intel的一份文件指出:“Numenta展示了他们定制训练的LLM在Intel Xeon CPU Max系列处理器上运行时,与当前一代AMD Milan CPU的实现相比,在处理器上配备高带宽内存的LLM在大型文档(长序列长度)上的运行速度要快20倍。”

Intel总结说,Numenta已经证明“有能力大幅降低在Intel上运行语言模型的总体成本,为客户释放全新的自然语言处理能力”。

Numenta的Ahmad则更进一步说:“我们可以让transformer运行得比Nvidia GPU更快。”

现在判断Numenta的软件是否真的是Nvidia GPU Killer还为时尚早。但在Ahmad看来,Numenta从神经科学中学到的基本原理让公司处于优势地位。“这并不是说我们有什么魔法能让速度提高100倍。我们所做的是减少计算量。这就是大脑的工作。这就是我们提高效率的方法。”

Numenta技术的应用范围包括计算机视觉、语音识别和机器人技术。

在语音识别领域,Numenta已经与Xilinx(已被AMD收购)开展了合作。Numenta演示了其大脑启发的稀疏算法如何辅助机器学习,该算法在Xilinx现成的FPGA和GSC(Google Speech Commands)数据集上运行。根据Numenta提交的案例研究,该公司展示了“利用稀疏性扩展深度学习模型的巨大优势”。

神经科学与AI

那么,究竟什么是神经科学,它与AI有何不同?

神经科学侧重于了解神经系统(大脑、脊髓和外周神经)的基本特性以及它们如何发挥作用。相比之下,AI的兴趣在于开发机器来完成通常与人类智能相关的任务。

正如Ahmad所解释的,在人工神经网络的早期,AI在很大程度上受到了神经科学的启发。Ahmad说:“20世纪40年代,Donald Hebb提出了神经元可以学习的最初想法,而且神经元可以学习模式。这启发了最早的人工神经元,当时被称为感知器(perceptron)。”

他补充说,神经科学还启发了“反向传播(backpropagation)”,这是深度学习的核心学习算法,一直沿用至今。

David Hunter Hubel和Torsten Wiesel共同获得了1981年诺贝尔奖,他们研究了视觉皮层的结构和功能。Ahmad解释说,他们极大地增强了人类对视觉系统如何按层次学习物体特征的理解,首先从边缘到角落,然后到形状,最后到物体。

Ahmad强调说:“这种对层次结构和特征检测的理解直接启发了卷积网络,这种核心架构甚至被用于当今的计算机视觉领域。”

直到Ahmad感兴趣的90年代初,神经科学家和深度学习研究人员之间的互动还很普遍。

不知从何时起,AI开始专注于GPU和计算。随着GPU速度越来越快,网络也越来越大。随着计算机越来越强大,数据科学家依赖的数据也越来越多。AI成了更强大和更多闪存的代名词。

Ahmad援引这一背景,认为当今的AI存在两个基本问题。其弱点在于“无法持续学习”,以及对“过多数据”的贪得无厌。

根据他的定义,真正的智能系统是“不断学习”的。他说,AI系统首先在实验室中接受训练,然后部署到现实世界中。但它们不会不断学习。

与人类不断渐进地学习不同,代码还不能真正地“学习”。Ahmad在最近的一篇文章中写道:“如果一个AI模型今天犯了一个错误,那么它将继续重复这个错误,直到使用新的数据对它进行重新训练。”

他说:“作为人类,我们通过四处走动来学习,我们了解世界的结构,甚至做出预测。”

想想AI模型是如何学会识别一种新车型的。

Ahmad说,人类只需要看到“一个例子。我会从另一个角度、一天中的不同时间或在下雨天都可以认出那辆车”。Ahmad说,深度学习系统没有真实的世界模型,“你必须向它们展示数以千计的各种图像”。“它必须记住这辆车的每一个可能的角度”。

神经形态(neuromorphic)计算与神经科学有何不同?Ahmad解释说,神经形态计算是“神经科学和AI这一更广泛领域的一个子集”。虽然神经形态工程的重点通常是构建新的、能效极高的硬件系统,但Ahmad说:“我们正在开发更多的软件和算法。我们将能够利用芯片行业正在进行的所有创新,包括CPU、GPU以及所有SIMD指令和架构。”

融资情况

Ahmad说,Numenta的资金主要来自董事会内部,其中包括Hawkins和Dubinsky,但也有一些外部投资者。

目前,Numenta规模仍然很小,只有20名员工。Ahmad补充说:“现在,Numenta正在走向商业化,我们将在明年的某个时候,很可能是今年晚些时候,进行一轮大规模融资。”

过去二十年来,神经科学家和数据科学家之间的分化很有启发性。硅谷通过一个非常男性化的方式实现了惊人的发展,更大更快的CPU和GPU永远是赢家。但如今,他们需要想办法从拼肌肉的死胡同过渡到基于效率的模式。

审核编辑:刘清

-

处理器

+关注

关注

68文章

20378浏览量

255619 -

GPU芯片

+关注

关注

1文章

308浏览量

6579 -

自然语言处理

+关注

关注

1文章

630浏览量

14756 -

ChatGPT

+关注

关注

31文章

1608浏览量

10433 -

LLM

+关注

关注

1文章

351浏览量

1412

原文标题:基于神经科学的Numenta能否挑战强大的Nvidia?

文章出处:【微信号:Astroys,微信公众号:Astroys】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

e络盟播客探讨人工智能、脑科学与以人为本创新的下一个前沿

应用案例 | 40倍镜下解析小鼠脑部神经元:深视智能sCMOS相机赋能膜片钳实验高效开展

柔性神经接口与设备是脑机接口的未来吗?

NMSIS神经网络库使用介绍

脉冲神经元模型的硬件实现

SNN加速器内部神经元数据连接方式

思必驰与上海交大联合实验室五篇论文入选NeurIPS 2025

国际类脑计算科学家Yulia Sandamirskaya教授加盟时识科技

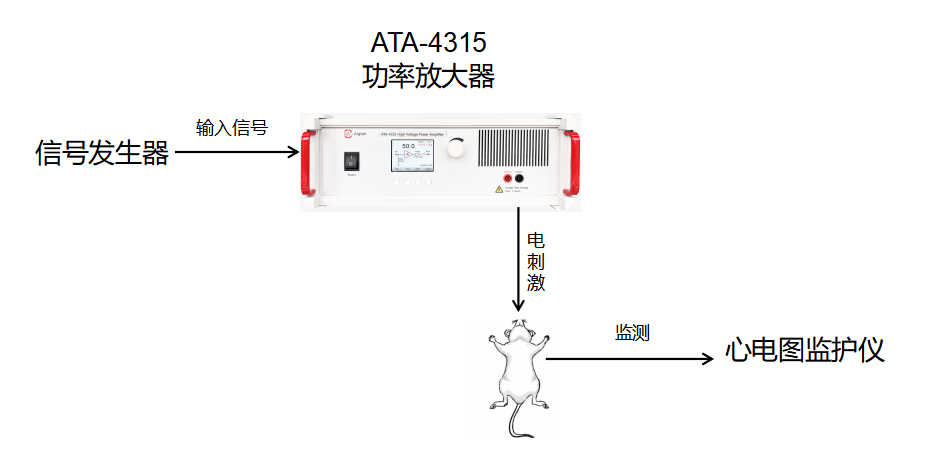

ATA-4315高压功率放大器:生物电刺激技术研究的高精度驱动核心

会议回顾 | 深视智能携新品sCMOS科学相机亮相中国神经科学学会第十八届全国学术会议

基于神经科学的Numenta介绍

基于神经科学的Numenta介绍

评论