01

简介

《在英特尔开发者套件上用OpenVINO加速YOLOv8-seg实例分割模型》介绍了在英特尔者开发套件上使用 OpenVINO开发套件部署并测评 YOLOv8-Seg 的实例分割模型,本文将介绍在英特尔开发者套件上使用 OpenVINO2023.0 加速 YOLOv8-Pose 姿态估计(Pose Estimation)模型。

请先下载本文的范例代码仓,并搭建好 YOLOv8 的OpenVINO 推理程序开发环境:

git clone

https://gitee.com/ppovnuc/yolov8_openvino.git

02

导出 YOLOv8-Pose 姿态估计 OpenVINO IR 模型

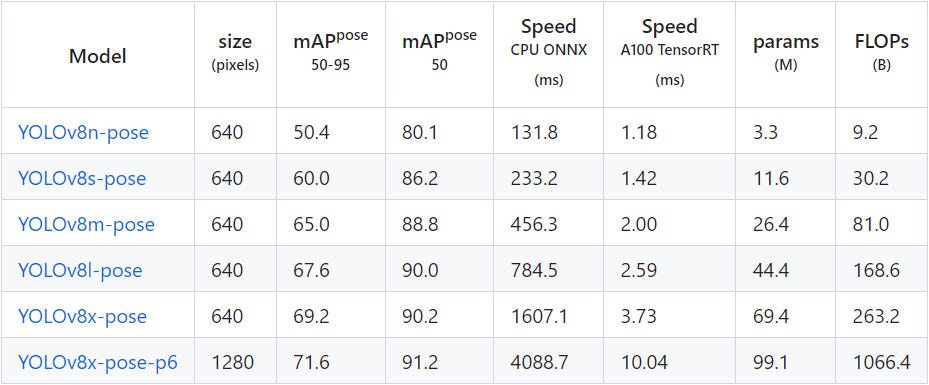

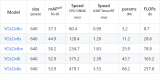

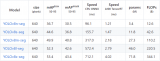

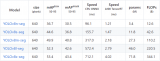

YOLOv8-Pose 的姿态估计模型有5种,在 COCOKeypoints 数据集完成训练,如下表所示。

COCOKeypoints 数据集请见:

http://cocodataset.org/

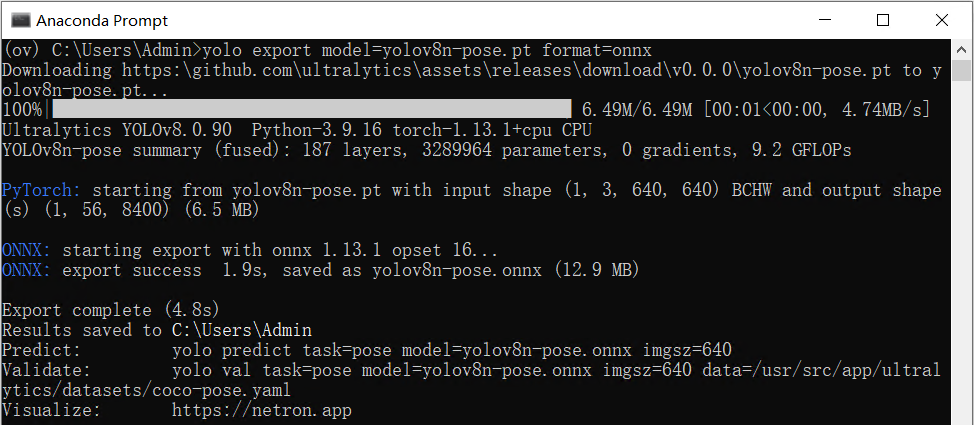

首先使用命令:

yolo export model=yolov8n-pose.pt format=onnx

向右滑动查看完整代码

完成 yolov8n-pose.onnx 模型导出,如下图所示:

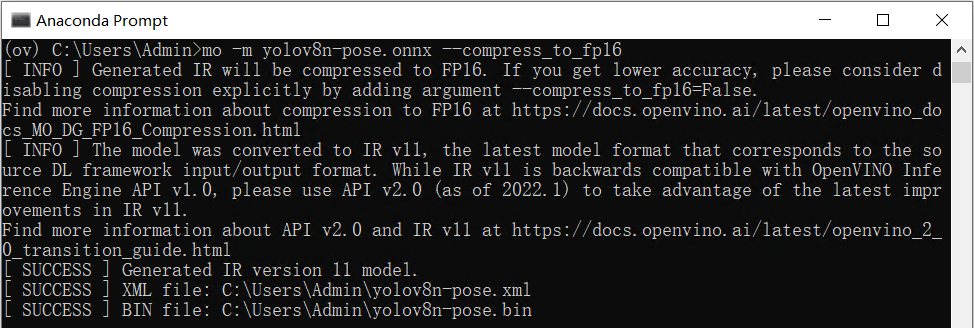

然后使用命令:

mo -m yolov8n-pose.onnx --compress_to_fp16

向右滑动查看完整代码

优化并导出 FP16 精度的 OpenVINO IR 格式模型,如下图所示:

03

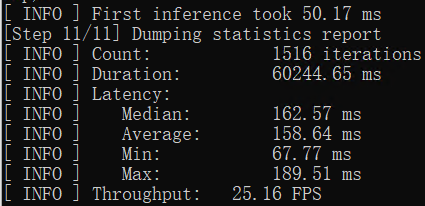

用 benchmark_app 测试 yolov8 姿态估计模型的推理计算性能

benchmark_app 是 OpenVINO工具套件自带的 AI 模型推理计算性能测试工具,可以指定在不同的计算设备上,在同步或异步模式下,测试出不带前后处理的纯 AI 模型推理计算性能。

使用命令:

benchmark_app -m yolov8n-pose.xml -d GPU

向右滑动查看完整代码

获得 yolov8n-pose.xml 模型在英特尔开发者套件的集成显卡上的异步推理计算性能,如下图所示:

04

使用 OpenVINO Python API编写 YOLOv8-Pose 姿态估计模型推理程序

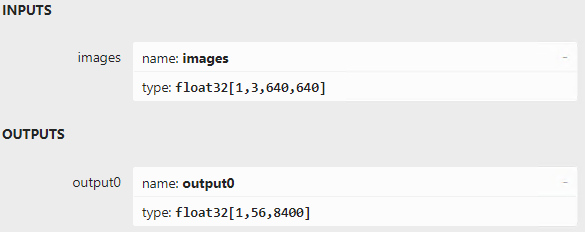

用 Netron 打开 yolov8n-seg.onnx 可以看到模型的输入和输出:

输入节点名字:“images”;数据:float32[1,3,640,640]

输出节点1的名字:“output0”;数据:float32 [1,56,8400],其中“8400”是指 YOLOv8 的3个检测头在 imgsz=640 时,有640/8=80,640/16=40,640/32=20,80x80+40x40+20x20=8400个输出单元格;“56”指 “Person” 类的中心坐标 cx,cy,w,h+“Person” 类的置信分数+“Person” 类的17个关键点([17,3]) = 56。

基于 OpenVINO Python API 的 YOLOv8 实例分割模型范例程序 yolov8_pose_ov_sync_infer_demo.py 的核心源代码,如下所示:

# 实例化Core对象

core = Core()

# 载入并编译模型

net = core.compile_model(f'{MODEL_NAME}.xml', device_name="GPU")

# 获得模型输出节点

output_node = net.outputs[0]

ir = net.create_infer_request()

cap = cv2.VideoCapture("store-aisle-detection.mp4")

while True:

start = time.time()

ret, frame = cap.read()

if not ret:

break

[height, width, _] = frame.shape

length = max((height, width))

image = np.zeros((length, length, 3), np.uint8)

image[0:height, 0:width] = frame

scale = length / 640

blob = cv2.dnn.blobFromImage(image, scalefactor=1 / 255, size=(640, 640), swapRB=True)

# 基于OpenVINO实现推理计算

outputs = ir.infer(blob)[output_node]

outputs = np.array([cv2.transpose(outputs[0])])

rows = outputs.shape[1]

# Postprocess

boxes = []

scores = []

preds_kpts = []

for i in range(rows):

classes_scores = outputs[0][i][4]

key_points = outputs[0][i][5:]

if classes_scores >= 0.5:

box = [

outputs[0][i][0] - (0.5 * outputs[0][i][2]), outputs[0][i][1] - (0.5 * outputs[0][i][3]),

outputs[0][i][2], outputs[0][i][3]]

boxes.append(box)

scores.append(classes_scores)

preds_kpts.append(key_points)

result_boxes = cv2.dnn.NMSBoxes(boxes, scores, 0.25, 0.45, 0.5)

detections = []

for i in range(len(result_boxes)):

index = result_boxes[i]

box = boxes[index]

pred_kpts = preds_kpts[index]

detection = {

'class_id': 0,

'class_name': 'person',

'confidence': scores[index],

'box': box,

'scale': scale}

detections.append(detection)

print(box[0] * scale, box[1] * scale, scale)

draw_bounding_box(frame, 0, scores[index], round(box[0] * scale), round(box[1] * scale),

round((box[0] + box[2]) * scale), round((box[1] + box[3]) * scale))

draw_key_points(frame, pred_kpts, 0.2, scale)

向右滑动查看完整代码

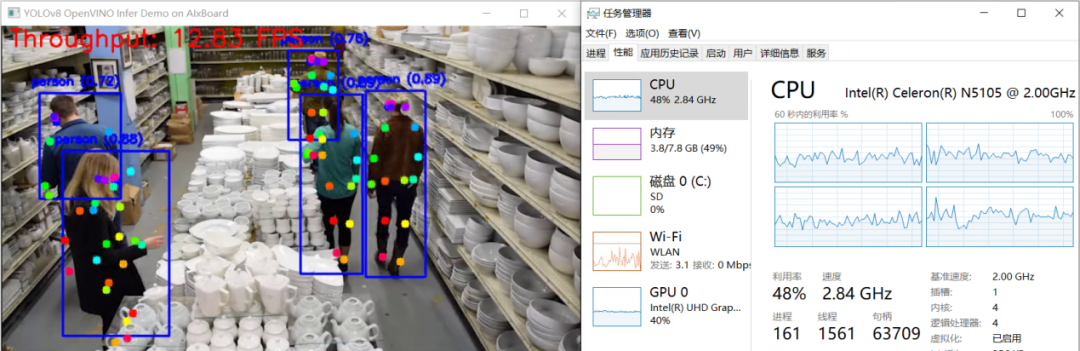

运行结果,如下图所示:

05

结论

英特尔开发者套件借助 N5105 处理器的集成显卡(24个执行单元)和 OpenVINO2023.0 ,可以在 YOLOv8-Pose 的姿态估计模型上获得相当不错的性能。通过异步处理和 AsyncInferQueue ,还能进一步提升计算设备的利用率,提高 AI 推理程序的吞吐量。

-

英特尔

+关注

关注

61文章

10275浏览量

179244 -

AI

+关注

关注

89文章

38085浏览量

296320

原文标题:在英特尔开发者套件上用OpenVINO™ 2023.0加速YOLOv8-Pose姿态估计模型 | 开发者实战

文章出处:【微信号:英特尔物联网,微信公众号:英特尔物联网】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

基于C#和OpenVINO™在英特尔独立显卡上部署PP-TinyPose模型

请问OpenVINO™工具套件英特尔®Distribution是否与Windows® 10物联网企业版兼容?

SDK3.0中yolov8-pose用onnx转bmodel自动killed如何解决?

用OpenVINO™ C++ API编写YOLOv8-Seg实例分割模型推理程序

使用英特尔开发者套件搭建RTMP流媒体服务器

基于OpenVINO在英特尔开发套件上实现眼部追踪

【转载】英特尔开发套件“哪吒”快速部署YoloV8 on Java | 开发者实战

在英特尔开发者套件上用OpenVINO™ 2023.0加速YOLOv8-Pose姿态估计模型

在英特尔开发者套件上用OpenVINO™ 2023.0加速YOLOv8-Pose姿态估计模型

评论