白皮书《Transformer-LS:用于语言和视觉处理的高效 Transformer》中提出了“长-短 Transformer” (Transformer-LS),这是一种高效的 Transformer 架构,用于为语言和视觉任务模拟中具有线性复杂度的长序列。

鉴于 Transformer 的模型在自然语言处理 (NLP) 和计算机视觉领域已经取得了巨大的成功。这种模型可受益于自注意力模块,后者既可捕获词元间的相邻相关性和长距离相关性,同时又能在现代硬件上高效扩展。

然而,自注意力机制所消耗的时间和内存与输入长度呈二次方关系,使其处理长序列的成本非常高昂。许多语言和视觉任务能够从长序列建模中获益。在 NLP 中,文档级任务需要处理较长的文章,而语言模型的性能往往随序列长度而增加。

在计算机视觉里,大量任务涉及高分辨率图像。而这些图像在使用 Transformer 模型处理前,会被转换成图像块的长序列。因此,设计一种能泛化到各种不同领域的长序列建模的高效注意力机制至关重要。

一直以来,业界提出了各种方法来减少完全注意力机制的二次方成本。但是,在语言和视觉领域都有良好应用的高效注意力机制尚未得到深入研究。一类方法使用滑动窗口和随机稀疏模式等预定义模式对注意力矩阵进行稀疏化处理。

这类方法使用强大的归纳偏置来改善计算性能和模型性能,但它们会限制自注意力层的能力,因为每个特定分词器只能处理一个词元子集。

另一类方法使用 low-rank 投影为输入序列构成低分辨率表示,但这类方法只能对特定的 NLP 任务有效。与稀疏注意力不同,这类方法允许每个分词器处理整个输入序列。但是,由于缺少高保真度词元级信息,对于需要细粒度局部信息的任务(包括语言领域和视觉领域的标准基准测试)而言,这类方法的性能有时并不优于完全注意力或稀释注意力机制。

尽管高效 Transformer 的发展相当迅速,一些提出的架构只适用于双向模型。基于 Transformer 的自回归模型已经在语言建模 、图像合成 和文本转图像合成领域取得了巨大的成功。这些领域都涉及长文本或高分辨率图像。

因此,有必要设计一种同时适用于自回归模型和双向模型的高效 Transformer。

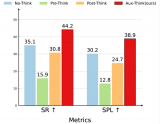

在白皮书《Transformer-LS:用于语言和视觉处理的高效 Transformer》中,研究把局部窗口注意力和新颖的长距离注意力统一成单个高效注意力机制。展示这两种注意力机制的互补效应,能在多种语言和视觉任务中为自回归模型和双向模型带来优异的效果。

原文标题:白皮书 | 《Transformer-LS:用于语言和视觉处理的高效Transformer》

文章出处:【微信公众号:NVIDIA英伟达】欢迎添加关注!文章转载请注明出处。

-

计算机视觉

+关注

关注

9文章

1716浏览量

47729 -

Transformer

+关注

关注

0文章

156浏览量

6962

原文标题:白皮书 | 《Transformer-LS:用于语言和视觉处理的高效Transformer》

文章出处:【微信号:NVIDIA_China,微信公众号:NVIDIA英伟达】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

人工智能多模态与视觉大模型开发实战 - 2026必会

面向视觉语言导航的任务驱动式地图学习框架MapDream介绍

机器视觉网卡:工业视觉系统的高速传输基石

低成本改造实录:如何让MODBUS TCP与PROFIBUS在铝厂握手言和

用于语言和视觉处理的高效 Transformer能在多种语言和视觉任务中带来优异效果

用于语言和视觉处理的高效 Transformer能在多种语言和视觉任务中带来优异效果

评论