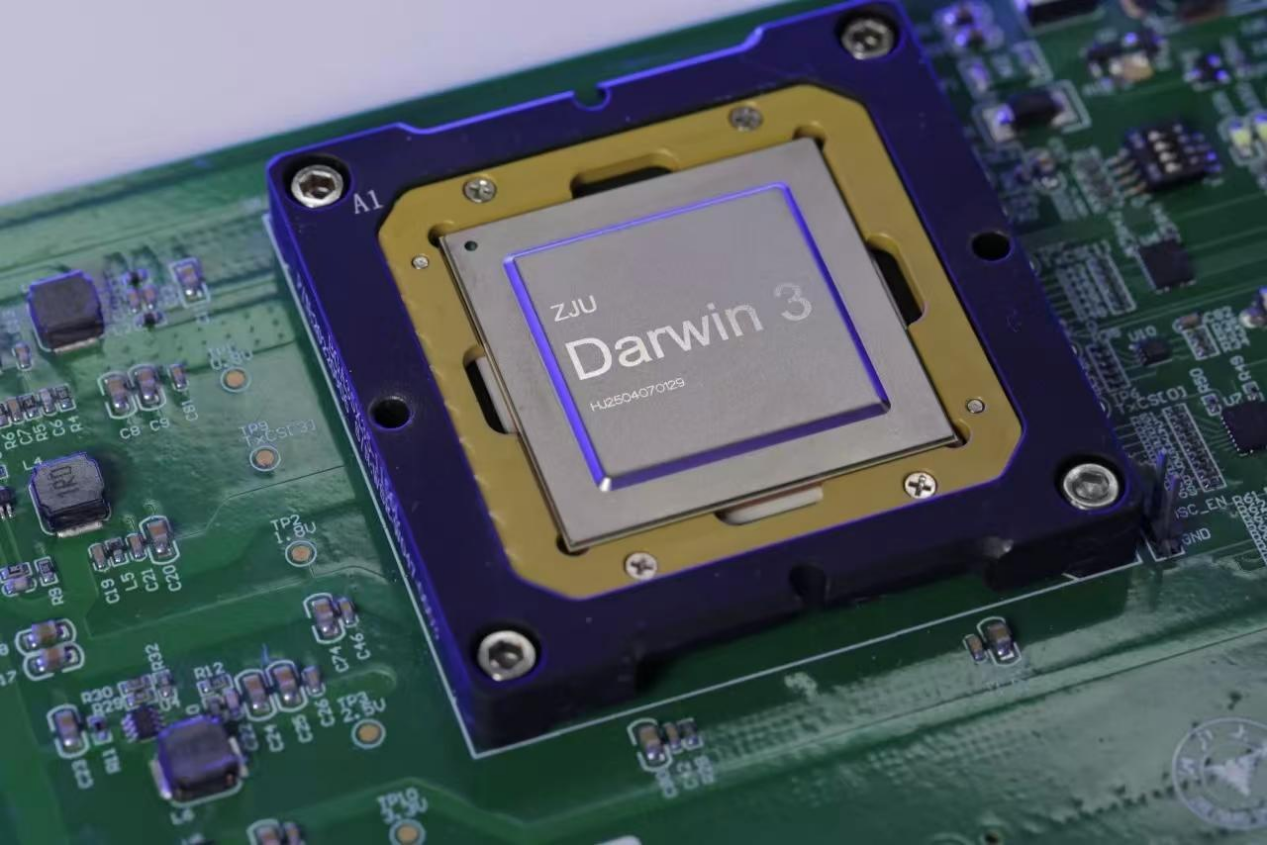

超算难胜大脑,何不依照神经结构打造芯片?

伴随着第四次工业革命的到来,人工智能和机器学习成了半导体行业热捧的技术。从训练和推理的角度来看,这些技术用到的数据量已经足够庞大,但AI芯片依然很难做到像大脑一样思考。

以目前世界排名第二的超算IBM Summit为例,其运算速率已达200 PFLOPS,但大脑的运算性能仍然是它的5倍。研究人员开始反思为何不仿制一个大脑结构的芯片,依照人体神经元网络结构打造的神经形态芯片也因此出炉。

大脑中的神经元可以通过无数个突触实现互通,从而快速处理大脑信息,进行记忆、推理和计算。基于冯诺依曼结构的AI芯片依然需要在多个部件之间进行信息传输,造成处理速度瓶颈,这也是为何近年来业内仍在发展互联技术的原因。

而神经形态芯片基于人脑的架构,采用了脉冲神经网络(SNN),不仅显著提升了处理速度,更是可以同步进行多项操作,同时进行数据输入和输出,且功耗与当前的AI芯片相比大大降低。

嗅觉识别

2017年11月,英特尔发布了自己的神经形态芯片Loihi。这一60mm2大小的芯片基于14nm工艺制造,采用了128个“神经核”的设计,囊括了13万神经元。英特尔称其设计基于专为SNN算法优化的架构,每个神经元都可以数千个神经元相互通信。Loihi支持的SNN运算,不需要在传统的卷积神经网络下进行训练。

Loihi芯片 / Intel

去年3月17日,英特尔研究院和美国康奈尔大学研究人员联合发表了一篇论文,展示了一种基于哺乳动物嗅觉系统的神经算法,即便存在明显干扰和遮盖的情况下,英特尔的神经形态芯片Loihi依然可以学习和识别危险甲苯和一氧化碳等化学品。此外,由于神经形态芯片的优势,Loihi仅需单一样本就可以识别气味,不像过去的深度学习一样需要大量的训练样本。

在与不少学术机构合作的过程中,研究人员同样发现Loihi具备超低功耗的特性。在运行一个实时深度学习测试中,Loihi的功耗要比一片GPU低109倍,与专用的IoT推理硬件相比低5倍。更棒的是,即便将深度学习网络的规模扩展50倍,Loihi不仅能够保持同样的实时性能表现,其功耗占用也只有30%而已,而IoT硬件的功耗已经高至6倍,且无法再满足实时处理了。

视觉识别

今年1月,澳大利亚斯威本大学、电子科大和中国科学院联合发表了一篇论文,该团队声称打造出了性能最强大的光学神经形态处理器。领导这项研究工作的David Moss教授声称,该芯片基于光微梳打造,可以实现10 TOPS的运算性能。

该芯片可以生成25万像素的图像卷积,对于人脸识别之类的应用已经绰绰有余。在测试中,他们在该芯片上用10个输出神经元依次组成一个光学卷积神经网络,在识别手写数字图像上准确率可达88%。同样的方法也可以扩展到更复杂的网络上,比如用于自动驾驶和实时视频识别等等。

TrueNorth芯片 / IBM

同样在用神经形态技术进行视觉识别的还有IBM,其TrueNorth芯片包含了100万个神经元和2.56亿个突触。这个4096个内核的芯片基于三星的28nm工艺制造,支持多对象检测和分类,正常工作情况下的功耗却只有60至70mW。

视觉传感器也开始应用神经形态技术,以Prophesee为例,这家公司基于自己神经形态技术,在去年与索尼联合发布了基于事件的工业级视觉传感器。该公司也在今年7月获得了创新工场、小米和韦豪创芯的投资。

结语

从以上案例可以看出,神经形态芯片和人脑结构一样,在处理庞大的多样化数据上上有着不小的优势。而传统AI和机器学习场景中,许多都需要需要大数据支持而且无法完成直接替代,这些应用往往也与人类感知器官相关。

除了嗅觉和视觉外,也有像荷兰初创公司Innatera这样专注于音频和健康的神经形态芯片公司。可以说神经形态芯片在发挥传感应用的全部性能上,具备着现有AI芯片难以媲美的优势。

不过这项技术在硬件和软件上尚未成熟,目前大型的神经形态芯片还没有出现,而且已有的一些算法也很可能难以兼容。凭借其低功耗和小体积的优势,神经形态芯片最对口的使用场景也许还是移动设备和AIoT。

伴随着第四次工业革命的到来,人工智能和机器学习成了半导体行业热捧的技术。从训练和推理的角度来看,这些技术用到的数据量已经足够庞大,但AI芯片依然很难做到像大脑一样思考。

以目前世界排名第二的超算IBM Summit为例,其运算速率已达200 PFLOPS,但大脑的运算性能仍然是它的5倍。研究人员开始反思为何不仿制一个大脑结构的芯片,依照人体神经元网络结构打造的神经形态芯片也因此出炉。

大脑中的神经元可以通过无数个突触实现互通,从而快速处理大脑信息,进行记忆、推理和计算。基于冯诺依曼结构的AI芯片依然需要在多个部件之间进行信息传输,造成处理速度瓶颈,这也是为何近年来业内仍在发展互联技术的原因。

而神经形态芯片基于人脑的架构,采用了脉冲神经网络(SNN),不仅显著提升了处理速度,更是可以同步进行多项操作,同时进行数据输入和输出,且功耗与当前的AI芯片相比大大降低。

嗅觉识别

2017年11月,英特尔发布了自己的神经形态芯片Loihi。这一60mm2大小的芯片基于14nm工艺制造,采用了128个“神经核”的设计,囊括了13万神经元。英特尔称其设计基于专为SNN算法优化的架构,每个神经元都可以数千个神经元相互通信。Loihi支持的SNN运算,不需要在传统的卷积神经网络下进行训练。

Loihi芯片 / Intel

去年3月17日,英特尔研究院和美国康奈尔大学研究人员联合发表了一篇论文,展示了一种基于哺乳动物嗅觉系统的神经算法,即便存在明显干扰和遮盖的情况下,英特尔的神经形态芯片Loihi依然可以学习和识别危险甲苯和一氧化碳等化学品。此外,由于神经形态芯片的优势,Loihi仅需单一样本就可以识别气味,不像过去的深度学习一样需要大量的训练样本。

在与不少学术机构合作的过程中,研究人员同样发现Loihi具备超低功耗的特性。在运行一个实时深度学习测试中,Loihi的功耗要比一片GPU低109倍,与专用的IoT推理硬件相比低5倍。更棒的是,即便将深度学习网络的规模扩展50倍,Loihi不仅能够保持同样的实时性能表现,其功耗占用也只有30%而已,而IoT硬件的功耗已经高至6倍,且无法再满足实时处理了。

视觉识别

今年1月,澳大利亚斯威本大学、电子科大和中国科学院联合发表了一篇论文,该团队声称打造出了性能最强大的光学神经形态处理器。领导这项研究工作的David Moss教授声称,该芯片基于光微梳打造,可以实现10 TOPS的运算性能。

该芯片可以生成25万像素的图像卷积,对于人脸识别之类的应用已经绰绰有余。在测试中,他们在该芯片上用10个输出神经元依次组成一个光学卷积神经网络,在识别手写数字图像上准确率可达88%。同样的方法也可以扩展到更复杂的网络上,比如用于自动驾驶和实时视频识别等等。

TrueNorth芯片 / IBM

同样在用神经形态技术进行视觉识别的还有IBM,其TrueNorth芯片包含了100万个神经元和2.56亿个突触。这个4096个内核的芯片基于三星的28nm工艺制造,支持多对象检测和分类,正常工作情况下的功耗却只有60至70mW。

视觉传感器也开始应用神经形态技术,以Prophesee为例,这家公司基于自己神经形态技术,在去年与索尼联合发布了基于事件的工业级视觉传感器。该公司也在今年7月获得了创新工场、小米和韦豪创芯的投资。

结语

从以上案例可以看出,神经形态芯片和人脑结构一样,在处理庞大的多样化数据上上有着不小的优势。而传统AI和机器学习场景中,许多都需要需要大数据支持而且无法完成直接替代,这些应用往往也与人类感知器官相关。

除了嗅觉和视觉外,也有像荷兰初创公司Innatera这样专注于音频和健康的神经形态芯片公司。可以说神经形态芯片在发挥传感应用的全部性能上,具备着现有AI芯片难以媲美的优势。

不过这项技术在硬件和软件上尚未成熟,目前大型的神经形态芯片还没有出现,而且已有的一些算法也很可能难以兼容。凭借其低功耗和小体积的优势,神经形态芯片最对口的使用场景也许还是移动设备和AIoT。

声明:本文内容及配图由入驻作者撰写或者入驻合作网站授权转载。文章观点仅代表作者本人,不代表电子发烧友网立场。文章及其配图仅供工程师学习之用,如有内容侵权或者其他违规问题,请联系本站处理。

举报投诉

-

AI

+关注

关注

91文章

41141浏览量

302609 -

人工智能

+关注

关注

1820文章

50330浏览量

266967 -

神经形态芯片

+关注

关注

0文章

21浏览量

14056

发布评论请先 登录

相关推荐

热点推荐

中科曙光scaleX万卡超集群重塑超大规模算力基础设施

在“人工智能+”行动深入推进的当下,算力基础设施已成为国家战略竞争力的核心,而超大规模集群的运维管控难题却日益凸显。中科曙光scaleX万卡超集群打造的智能管理体系,正以“能管住-管得稳-用得好”的进阶逻辑,重塑超大规模

昆仑芯科技参与发布超节点智算应用“北京方案”

9月26日,2025人工智能计算大会(AICC 2025)在京举行,昆仑芯作为国产 AI 芯片领域的代表,与30多家企业与机构携手,在北京市科委中关村管委会、北京市发展改革委的共同见证下,发布了《基于超节点创新联合体,打造行业智

液态神经网络(LNN):时间连续性与动态适应性的神经网络

1.算法简介液态神经网络(LiquidNeuralNetworks,LNN)是一种新型的神经网络架构,其设计理念借鉴自生物神经系统,特别是秀丽隐杆线虫的神经

【「AI芯片:科技探索与AGI愿景」阅读体验】+神经形态计算、类脑芯片

功耗和并行处理信息能力。

类脑芯片的理论基础是神经形态计算,即借鉴生物神经系统信息的处理模式和结构,以人脑为蓝本、旨在构建能够像人脑一样学习、感知及决策的计算系统。

实现

发表于 09-17 16:43

【「AI芯片:科技探索与AGI愿景」阅读体验】+化学或生物方法实现AI

)大脑的能效远高于目前的AI芯片

都知道计算机算的快,但是能取代大脑吗?肯定是不行的。大脑在处理复杂信息方面的能力是远超计算机的。是不可替代

发表于 09-15 17:29

【「AI芯片:科技探索与AGI愿景」阅读体验】+AI的未来:提升算力还是智力

持续发展体现在:

1、收益递减

大模型的基础的需要极大的算力,这首先源于昂贵的高性能AI芯片,然后是宝贵的电力、水等与环境相关的资源。

收益递减体现在:

①模型大小

②训练数据量

③训练算法的优化

2

发表于 09-14 14:04

【「AI芯片:科技探索与AGI愿景」阅读体验】+可期之变:从AI硬件到AI湿件

通常情况下,半导体芯片的制造过程是经过光刻、蒸发、扩散、离子注入等物理方法来实现晶体管等元器件的生成和互连。芯片是被封装在一个带有大量引脚、不断耗电和发热的方形硬壳中,这与大脑的结构沿

发表于 09-06 19:12

广电计量打造AI高算力芯片检测一站式解决方案

在人工智能蓬勃发展的时代,AI高算力芯片作为智能世界的“最强大脑”,正驱动着自动驾驶、智能安防、大数据分析等众多前沿领域的飞速前进。据弗若斯特沙利文预测,中国的AI芯片市场规模在202

新一代神经拟态类脑计算机“悟空”发布,神经元数量超20亿

拟态芯片的类脑计算机,神经元数量接近猕猴大脑规模,典型运行状态下功耗仅约2000瓦。传统计算机处理人脑任务需高达100兆瓦功耗,相比之下“悟空”低功耗优势显著。 硬件上,“悟空”由15台刀片式

算能发布超节点服务器,128颗BM1690芯片组成

电子发烧友网综合报道 在2025世界人工智能大会上,算能最新发布了一款超节点服务器,可提供多达8T显存空间以及巨大的FP8算力,形成一台强大“智算服务器”单机设备。据工作人员介绍,这是

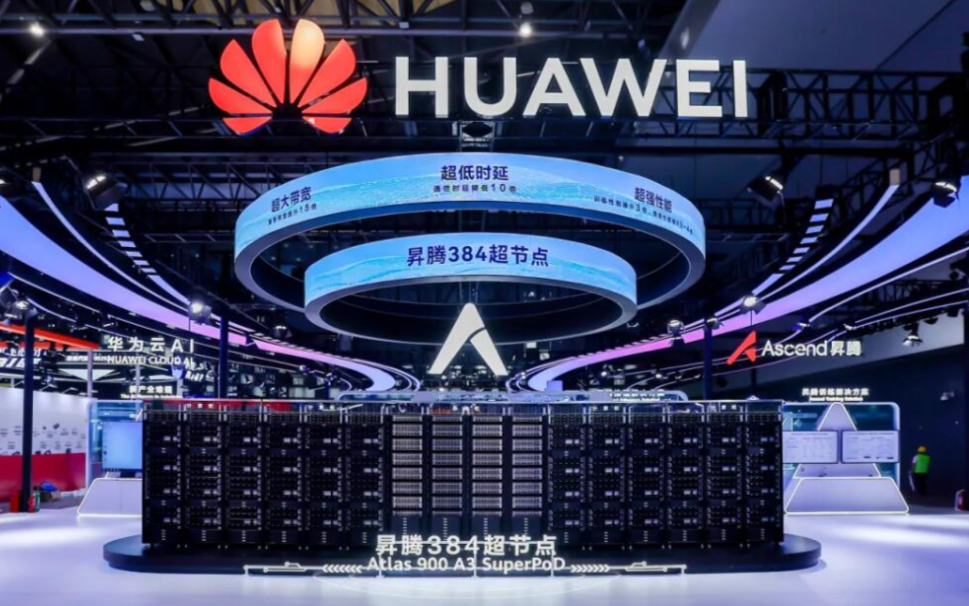

重磅!华为昇腾384超节点真机登场,中兴携厂商首秀GPU超节点实力

作为中国自主的算力核弹,华为昇腾384超节点真机首次亮相。中兴通讯、上海仪电、曦智科技、壁仞科技联合打造的光互联芯片及超节点应用创新方案荣获

高达2070TFLOPS算力|腾视科技基于NVIDIA Jetson Thor系列模组,重磅推出全栈AI边缘智算大脑解决方案

探索物理AI的无限可能。无论是硬件厂商、软件开发者,还是各行业的应用企业,让我们携手共进,利用腾视科技先进的全栈AI边缘智算大脑解决方案,推动机器人技术在更多领域的创新应用,共同打造物理AI的美好未来。

高达2070TFLOPS算力腾视科技基于NVIDIA Jetson Thor系列模组,重磅推出全栈AI边缘智算大脑解决方案

探索物理AI的无限可能。无论是硬件厂商、软件开发者,还是各行业的应用企业,让我们携手共进,利用腾视科技先进的全栈AI边缘智算大脑解决方案,推动机器人技术在更多领域的创新应用,共同打造物理AI的美好未来。

超算难胜大脑,何不依照神经结构打造芯片?

超算难胜大脑,何不依照神经结构打造芯片?

评论