1. NN模型如下

神经网络整体架构内容可参考之前的云笔记《06_神经网络整体架构》

http://note.youdao.com/noteshare?id=2c27bbf6625d75e4173d9fcbeea5e8c1&sub=7F4BC70112524F9289531EC6AE435E14

其中,

n是指的样本数

Mnist数据集 784是28×28×1 灰度图 channel = 1

wb是指的权重参数

输出的是10分类的得分值,也可以接softmax分类器

out是L2层和输出层之间的关系

256 128 10是指的神经元数量

2. 构造参数

函数构造

3. Code

1. 网络模型架构搭建

导入相应数据

import numpy as npimport tensorflow as tfimport matplotlib.pyplot as pltimport input_datamnist = input_data.read_data_sets('data/', one_hot=True)network topologies

# 网络拓扑 network topologies# layer中神经元数量n_hidden_1 =256n_hidden_2 =128# 输入数据的像素点 28x28x1n_input =784# 10分类n_classes =10input and output

x = tf.placeholder("float",[None,n_input])y = tf.placeholder("float",[None,n_classes])network parameters

# network parameters# 方差stddev =0.1# random_normal 高斯初始化weights ={'w1': tf.Variable(tf.random_normal([n_input,n_hidden_1],stddev=stddev)),'w2': tf.Variable(tf.random_normal([n_hidden_1,n_hidden_2],stddev=stddev)),'out': tf.Variable(tf.random_normal([n_hidden_2,n_classes],stddev=stddev))}# 对于 b 零值初始化也可以biases ={'b1': tf.Variable(tf.random_normal([n_hidden_1])),'b2': tf.Variable(tf.random_normal([n_hidden_2])),'out': tf.Variable(tf.random_normal([n_classes]))}print("Network Ready")output

NetworkReady可以看到网络模型架构搭建成功

2.训练网络模型

定义前向传播函数

# 定义前向传播函数def multilayer_perceptron(_X, _weights, _biases):# 之所以加 sigmoid 是因为每一个 hidden layer 都有一个非线性函数layer_1 = tf.nn.sigmoid(tf.add(tf.matmul(_X, _weights['w1']), _biases['b1']))layer_2 = tf.nn.sigmoid(tf.add(tf.matmul(layer_1, _weights['w2']), _biases['b2']))return(tf.matmul(layer_2, _weights['out'])+ _biases['out'])反向传播

(1)将前向传播预测值

# predictionpred = multilayer_perceptron(x, weights, biases)(2)定义损失函数

# 首先定义损失函数 softmax_cross_entropy_with_logits 交叉熵函数# 交叉熵函数的输入有 pred : 网络的预测值 (前向传播的结果)# y : 实际的label值# 将两参数的一系列的比较结果,除以 batch 求平均之后的 loss 返回给 cost 损失值cost = tf.reduce_mean(tf.nn.softmax_cross_entropy_with_logits(pred, y))(3)梯度下降最优化

optm = tf.train.GradientDescentOptimizer(learning_rate =0.001).minimize(cost)(4)精确值

具体解释详见上一篇笔记《06_迭代完成逻辑回归模型》

corr = tf.equal(tf.argmax(pred,1), tf.argmax(y,1))accr = tf.reduce_mean(tf.cast(corr,"float"))(5)初始化

# initializerinit = tf.global_variables_initializer()print("Function ready")output

Function ready可以看出传播中的参数和优化模型搭建成功

3. Train and Test

training_epochs =20# 每次 iteration 的样本batch_size =100# 每四个 epoch 打印一次结果display_step =4# lanch the graphsess = tf.Session()sess.run(init)# optimizefor epoch in range(training_epochs):# 初始,平均 loss = 0avg_cost =0total_batch =int(mnist.train.num_examples/batch_size)# iterationfor i in range(total_batch):# 通过 next_batch 返回相应的 batch_xs,batch_ysbatch_xs, batch_ys = mnist.train.next_batch(batch_size)feeds ={x: batch_xs, y: batch_ys}sess.run(optm, feed_dict = feeds)avg_cost += sess.run(cost, feed_dict = feeds)avg_cost = avg_cost / total_batch# displayif(epoch+1)% display_step ==0:print("Epoch: %03d/%03d cost: %.9f "%(epoch, training_epochs, avg_cost))feeds ={x: batch_xs, y: batch_ys}train_acc = sess.run(accr, feed_dict = feeds)print("train accuracy: %.3f"%(train_acc))feeds ={x: mnist.test.images, y: mnist.test.labels}test_acc = sess.run(accr, feed_dict = feeds)print("test accuracy: %.3f"%(test_acc))print("optimization finished")output

Epoch:003/020 cost:2.273774184train accuracy:0.250test accuracy:0.197Epoch:007/020 cost:2.240329206train accuracy:0.270test accuracy:0.311Epoch:011/020 cost:2.203503076train accuracy:0.370test accuracy:0.404Epoch:015/020 cost:2.161286944train accuracy:0.490test accuracy:0.492Epoch:019/020 cost:2.111541148train accuracy:0.410test accuracy:0.534optimization finished20个batch每个batch 100个样本,每隔4个batch打印一次

处理器:Intel Core i5-6200U CPU @ 2.30GHz 2.04GHz

04 epoch:train+test, cost_time: 25’40”

08 epoch:train+test, cost_time: 50’29”

12 epoch:train+test, cost_time: 74’42”

16 epoch:train+test, cost_time: 98’63”

20 epoch:train+test, cost_time: 121’49”

-

函数

+关注

关注

3文章

4422浏览量

67864 -

神经元

+关注

关注

1文章

369浏览量

19196

发布评论请先 登录

为什么 VisionFive V1 板上的 JH7100 中并存 NVDLA 引擎和神经网络引擎?

自动驾驶中常提的卷积神经网络是个啥?

CNN卷积神经网络设计原理及在MCU200T上仿真测试

NMSIS神经网络库使用介绍

在Ubuntu20.04系统中训练神经网络模型的一些经验

CICC2033神经网络部署相关操作

液态神经网络(LNN):时间连续性与动态适应性的神经网络

神经网络的并行计算与加速技术

无刷电机小波神经网络转子位置检测方法的研究

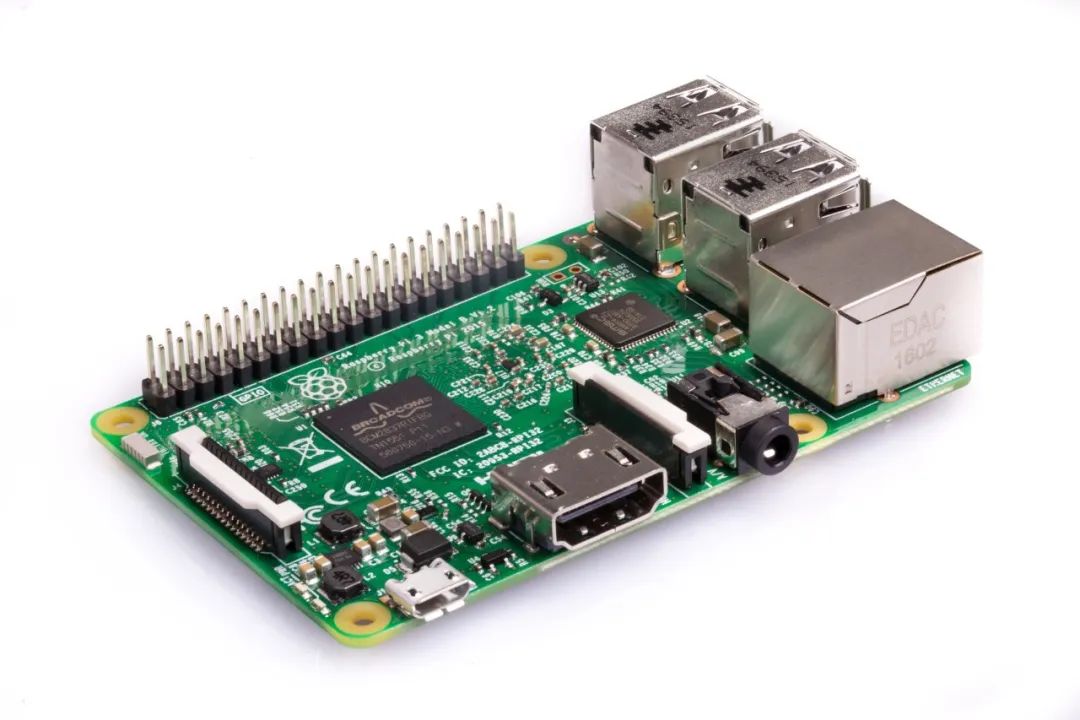

低功耗+AI识别:基于树莓派的 LoRa 神经网络安防系统!

简单神经网络train&test程序,python源码

简单神经网络train&test程序,python源码

评论