本次作为迎来“CASE”时代的汽车趋势和技术课题的第三次,我们将介绍面向实际应用和实证实验突飞猛进的自动驾驶和掌控自动驾驶“认知”的识别引擎概要。

开发和实证实验取得进展的自动驾驶功能

自动驾驶功能愈来愈得到了实际应用。2021年7月举办的东京奥运会和残奥会具有里程碑意义。除了已决定在选手村内的移动(循环线路)中引入自动驾驶车辆(4级)外,在羽田机场周围和沿海副中心区域计划进行各种与自动驾驶相关的实证实验。

自动驾驶分为几个级别,目前广泛使用美国汽车工程师协会(SAE)作为“SAE J3016”规定的6级(表1)。(在日本,政府发布的“官民ITS构想和路标图2019”中总结了相同的定义)

检测前方障碍物予以辅助制动等所谓的ADAS(先进驾驶辅助系统),一般属于1级。此外,自适应巡航控制和自动车道保持的同步操作等2级功能也已得到实际应用。虽然已经出现配备3级功能的市售车,但由于法律完善的问题,这种车辆尚未在日本国内销售。

| 驾驶员的作用 | 功能 | 功能示例 | |

|---|---|---|---|

| SAE级 0 | 驾驶员始终进行驾驶操作,但当辅助功能工作时,则可以将脚从踏板上挪开,或将手从方向盘上松开。 | 仅进行警示和临时辅助。 | 自动紧急制动、盲点警示、车道偏离警示等 |

| SAE级 1 | 加减速或转向辅助 | 车道保持或自适应巡航控制 | |

| SAE级 2 | 加减速和转向辅助 | 车道保持与自适应巡航控制的同步操作 | |

| SAE级 3 | 无需驾驶员进行介入(唯独3级在系统要求时进行介入)。 | 限定条件下的自动驾驶,在没有满足所有条件的状态下不能工作 | 交通堵塞时的自动跟随行驶等 |

| SAE级 4 | 特定区域内的无人驾驶出租车等 | ||

| SAE级 5 | 所有条件下的自动驾驶 | 不分区域的无人驾驶出租车等 |

传感器的主角是摄像头、雷达和LiDAR(激光雷达)

ADAS和自动驾驶主要通过(A)认知、(B)判断、(C)操作这三个功能来实现(驾驶员进行驾驶也相同)。

其中,(A)识别是由传感器和识别引擎(识别处理器)进行的,除了对车辆前方的行人、自行车、迎面车、停放车辆、障碍物、车道、标志、交通灯等进行识别外,还对在车后和车侧行驶的超越车辆、相邻车道上的并行车辆等进行适当识别,并将该信息提供给后续的判断功能。

作为传感器,使用摄像头、雷达、LiDAR等。

摄像头

摄像头包括单眼摄像头、根据视差获取深度信息的立体摄像头(双眼)、将立体摄像头与不同焦距的单眼摄像头组合而成的三眼摄像头。按大致记载的顺序感测精度提高,但成本也会随之上升。

即使使用单眼摄像头,如果自身的车辆在移动,也可以根据某一帧及其后续帧的视差来弄清至行人或物体的距离。因此,低成本的单眼摄像头现在仍被广泛使用。

图1 借助摄像头拍摄到的障碍物检测图像

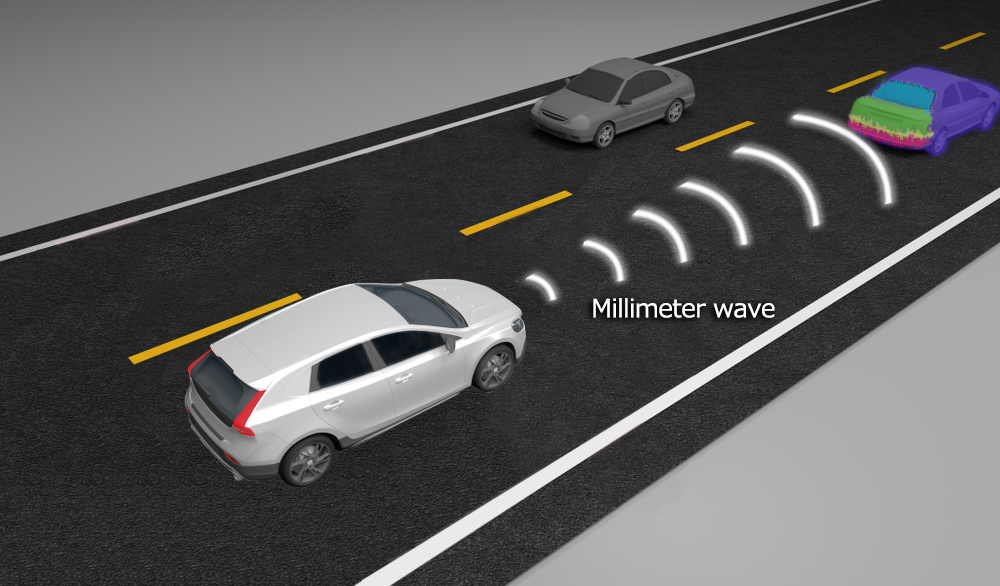

雷达(RADAR : RAdio Detection And Ranging)

LiDAR是一项辐射毫米波或微波,根据其反射来感测周围的人、物体的距离和位置的技术。几年前,人们曾预测24GHz雷达将成为主流,但由于受电波频段分配的制约,频段窄至200MHz,所以人们将重点放在了可以使用4GHz左右的频段也可以实现天线模块小型化的77GHz频段上。最近,还出现了使用低成本CMOS工艺的解决方案,毫无疑问,它将成为未来的主流。

图2 借助雷达拍摄到的障碍物检测图像

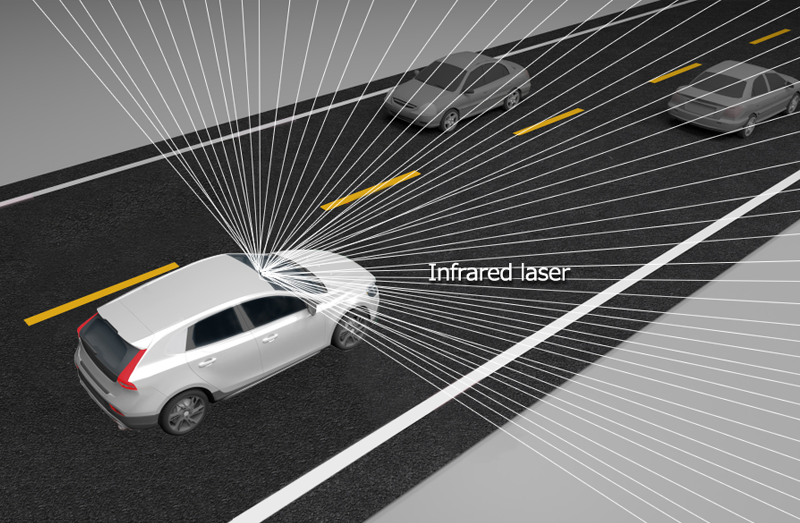

LiDAR (Light Detection and Ranging 或 Laser Imaging Detection and Ranging)

LiDAR是一种使用红外激光取代电波的雷达。虽然它由于波长比电波短,能够获得高分辨率,但它也面临着易受雨和雾等气象条件影响的课题。

图3 借助LiDAR拍摄到的障碍物检测图像

由于各自的感测方式都有其优缺点 (表2),因而也采用将两种以上的技术融合(fusion) 起来的“传感器融合”方式。譬如,据说一辆拥有超过2级的先进功能的豪华车,在车前、车侧和车后总共配备了8个摄像头和5个雷达。

| 摄像头 | 雷达 | LiDAR | |

|---|---|---|---|

| 分辨率 | 〇 | △ | 〇 |

| 距离分辨率 | △ | 〇 | 〇 |

| 恶劣天气 | △ | 〇 | △ |

| 夜间 | △ | 〇 | 〇 |

| 其他 | 由于图像可由人来确认,易于评估,成本低 | 77GHz频段成为主流 | 截至到现在成本依然很高 |

由图像处理加速器和推断器构成的识别引擎

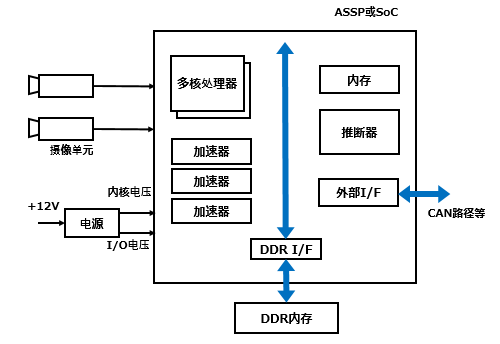

识别引擎或图像识别处理器根据来自摄像头等传感器的信息(图像信息)识别前方和周围状况。虽然已出现专用的ASSP和SoC,但也可使用通用的FPGA和GPU。特别是可以重写内部逻辑电路的FPGA,适合于在试制中进行算法验证。

识别引擎由以高性能处理器内核为中心的各种图像处理加速器构成(图4)。譬如,包括进行图像旋转、放大或缩小的仿射变换加速器,白线识别所需的边缘检测加速器,获取图像亮度分布的直方图加速器等。

为确保安全,识别处理必须在系统规定的时间内完成,且必须将该识别结果传递给后续的判断系统。因此,各自的处理是并行执行的,而不是依序执行的。

连接到识别引擎的内存系统的性能也很重要,通常使用DDR2或DDR4等高速内存。

图4.识别引擎的概略方框图

此外,近年来也安装了深度学习(deep learning)的推断器。目的是通过与传统的匹配手法相结合来提高识别精度。

在不同的国家或地区、气象条件、道路状况下,将车辆行驶时收集到的大量摄像图像和雷达图像提供给高性能的深度学习系统(云等)以构建神经网络模型,并作为推断器安装到识别引擎上。但是,由于高精确的推断器需要大量的电路逻辑,关键是如何实现轻量化,包括减少位数和裁剪 (pruning) 等措施。

保证在高温下运行,抑制发热是关键

在安装由摄像单元、识别引擎等构成的系统(ECU:电子控制单元)时应予注意的是温度。因高速处理大量数据而导致功率增大,零部件发热使得整个ECU(电子控制单元)趋于高温化。此外,该ECU一般安装在靠近室内后视镜的背面,用于前方监控。特别是在炎热的夏天,车辆内部会成为高温,ECU即使从该状态启动也必须正常工作。

需要选定温度特性优异、且在“电源电路的基础知识(4)”中介绍的AEC (Automotive Electronics Council) 定义的0级和1级等工作温度范围广的零部件。

为了抑制温度升高,降低ECU本身的功耗也很重要。如果想提高识别引擎的性能,相应地还需要更多的逻辑,功耗也会增大,所以需要选定一个均衡的解决方案。此外,在选定用于外围电路的无源零部件、摄像头(图像传感器)和DDR内存时,还必须考虑功耗。

(2) 低电压/大电流电源电路不可或缺

还需要注意电源。随着识别引擎过程节点的微细化,内核电压已经降至1.0V左右。假设功耗为10W,则需要准备输出为1.0V/10A的电源电路。如果额定电压降低,则允许电压范围也会变窄,因此需要一个没有变动的稳定的电源电路。

还需要注意安装表面的电磁干扰。如果干扰叠加在摄像图像或雷达图像上,可能会导致识别错误。需要适当选择开关电源(DC/DC转换器)的开关频率,并设法使得电流随着开关操作切换的回路(热回路)面积最小化。此外,在安装包括图像传感器在内的传感器输出的配线和模拟前端时,还需要使它们不易受外部噪波的影响。

另外,驾驶员负责驾驶至2级,但3级以上则由系统控制驾驶,因此,为了即使在电路和电源等发生故障(缺陷)的情况下也能保持安全性,必须进行诸如使电力系统冗余化(双重化)等方面的应对。

深度学习的进一步活用将促进自动驾驶

虽然需要解决法律完善和社会共识的问题,但毫无疑问,3级或4级等自动驾驶功能在不久的将来将被投入实际应用。为了实现这个目标,除了进一步提升模式匹配等传统技术外,深度学习肯定将是关键技术之一。找元器件现货上唯样商城

另一方面,从电子产品的角度来看,兼顾识别引擎和感测系统的高性能化和低功耗化则将成为一个课题。如果提高性能,通常会导致功耗增加,发热增大,电池的消耗也会加快。如何使性能和功率取得平衡似乎是未来的关键。

迎来“CASE”时代的汽车趋势和技术课题(3)~自动驾驶和识别引擎~ - 松下电器机电(中国)有限公司 官方网站 (panasonic.cn)

Related product information

6轴车载惯性传感器(6in1传感器)

审核编辑 黄宇

-

雷达

+关注

关注

52文章

3420浏览量

124679 -

ecu

+关注

关注

14文章

999浏览量

57545 -

adas

+关注

关注

311文章

2356浏览量

212198 -

Case

+关注

关注

0文章

28浏览量

13864 -

自动驾驶

+关注

关注

795文章

15043浏览量

181906

发布评论请先 登录

迎来“CASE”时代的汽车趋势和技术课题(3) ~自动驾驶和识别引擎~

迎来“CASE”时代的汽车趋势和技术课题(3) ~自动驾驶和识别引擎~

评论