MediaPipe介绍

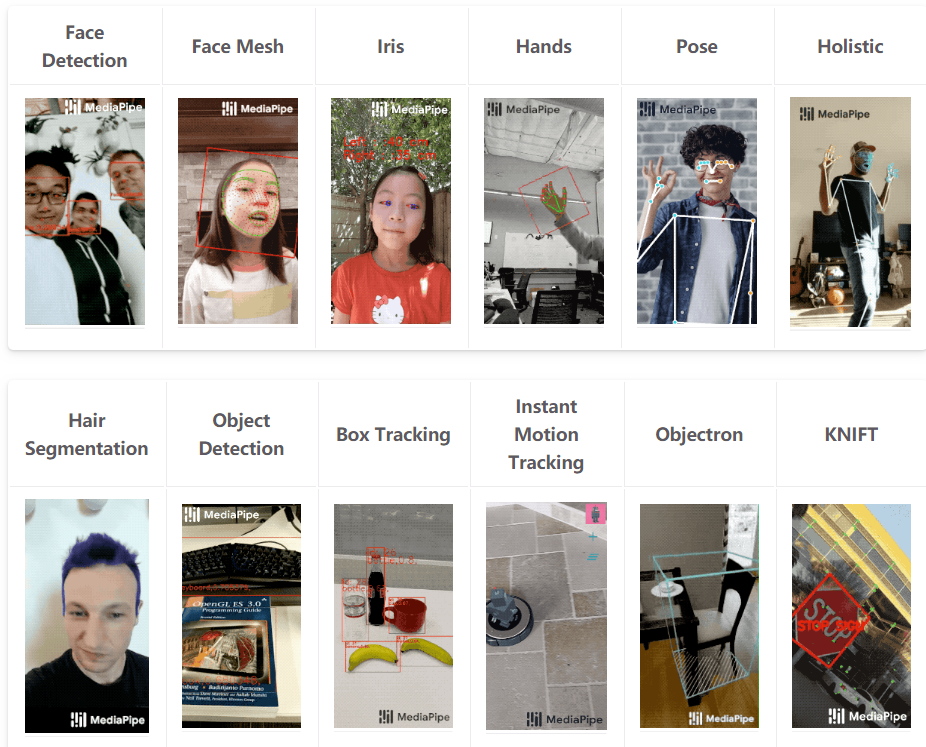

这个是真的,首先需要从Google在2020年发布的mediapipe开发包说起,这个开发包集成了人脸、眼睛、虹膜、手势、姿态等各种landmark检测与跟踪算法。

https://google.github.io/mediapipe/

请看下图比较详细

是个不折不扣的现实增强的宝藏工具包,特别实用!支持的平台跟语言也非常的丰富,图示如下:

只说一遍,感觉要逆天了,依赖库只有一个就是opencv,python版本的安装特别简单,直接运行下面的命令行:

pip install mediapipe

手势landmark检测

直接运行官方提供的Python演示程序,需要稍微修改一下,因为版本更新了,演示程序有点问题,改完之后执行运行视频测试,完美get到手势landmark关键点:

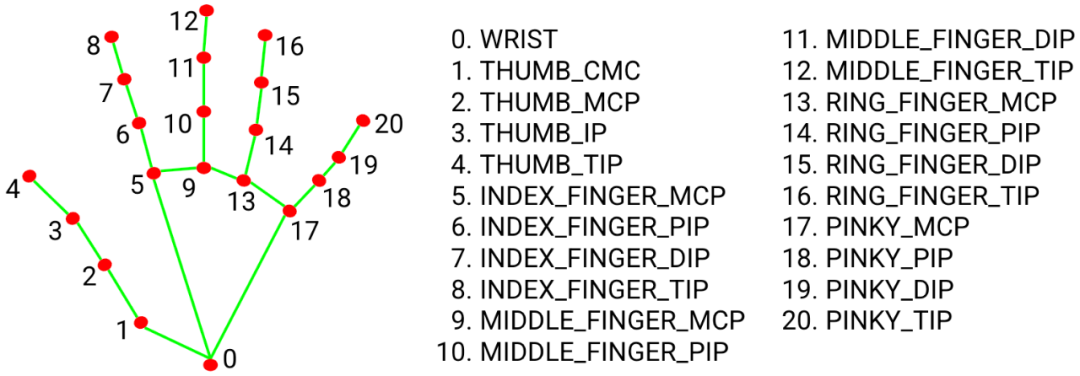

手势landmark的关键点编号与解释如下:

修改后的代码如下:

importcv2

importmediapipeasmp

mp_drawing=mp.solutions.drawing_utils

mp_hands=mp.solutions.hands

#Forwebcaminput:

cap=cv2.VideoCapture(0)

withmp_hands.Hands(

min_detection_confidence=0.5,

min_tracking_confidence=0.5)ashands:

whilecap.isOpened():

success,image=cap.read()

ifnotsuccess:

print("Ignoringemptycameraframe.")

#Ifloadingavideo,use'break'insteadof'continue'.

continue

#Toimproveperformance,optionallymarktheimageasnotwriteableto

#passbyreference.

image.flags.writeable=False

image=cv2.cvtColor(image,cv2.COLOR_BGR2RGB)

results=hands.process(image)

#Drawthehandannotationsontheimage.

image.flags.writeable=True

image=cv2.cvtColor(image,cv2.COLOR_RGB2BGR)

ifresults.multi_hand_landmarks:

forhand_landmarksinresults.multi_hand_landmarks:

mp_drawing.draw_landmarks(

image,

hand_landmarks,

mp_hands.HAND_CONNECTIONS)

cv2.imwrite('D:/result.png',cv2.flip(image,1))

#Fliptheimagehorizontallyforaselfie-viewdisplay.

cv2.imshow('MediaPipeHands',cv2.flip(image,1))

ifcv2.waitKey(5)&0xFF==27:

break

cap.release()

手势识别

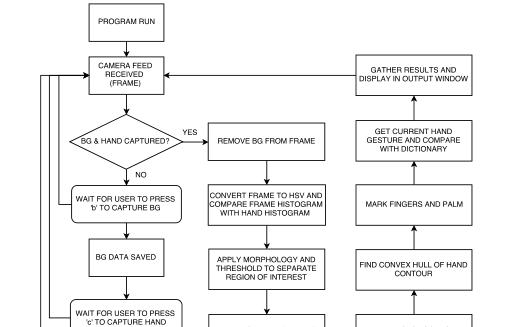

基于最简单的图象分类,收集了几百张图象,做了一个简单的迁移学习,实现了三种手势分类,运行请看视频:

-

手势识别

+关注

关注

8文章

232浏览量

49291 -

跟踪算法

+关注

关注

0文章

41浏览量

13251 -

OpenCV

+关注

关注

33文章

652浏览量

45076

原文标题:MediaPipe + OpenCV五分钟搞定手势识别

文章出处:【微信号:CVSCHOOL,微信公众号:OpenCV学堂】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

如何用OpenCV进行手势识别--基于米尔全志T527开发板

基于毫米波雷达的手势识别算法

红外手势识别方案 红外手势感应模块 红外识别红外手势识别

【UT4418申请】手势识别系统

【NanoPi Duo开发板试用申请】基于nanopi的手势识别

手势识别控制器制作

五分钟读懂WiFi基础知识

手势识别系统的程序和资料说明

opencv 轮廓放大_OpenCV开发笔记(六十六):红胖子8分钟带你总结形态学操作-膨胀、腐蚀、开运算、闭运算、梯

手势识别技术及其应用

零成本钢铁侠手套!树莓派+OpenCV 秒变手势遥控器!

MediaPipe + OpenCV五分钟搞定手势识别

MediaPipe + OpenCV五分钟搞定手势识别

评论