点击蓝字 ╳ 关注我们

巴延兴

深圳开鸿数字产业发展有限公司

资深OS框架开发工程师

一、简介

二、目录

├── frameworks #框架代码

│ ├── js

│ │ ├── player

│ ├── native

│ │ ├── player #native实现

│ └── videodisplaymanager #显示管理

│ ├── include

│ └── src

├── interfaces

│ ├── inner_api #内部接口

│ │ └── native

│ └── kits #外部JS接口

├── sa_profile #服务配置文件

└── services

├── engine #engine代码

│ └── gstreamer

├── etc #服务配置文件

├── include #头文件

└── services

├── sa_media #media服务

│ ├── client #media客户端

│ ├── ipc #media ipc调用

│ └── server #media服务端

├── factory #engine工厂

└── player #player服务

├── client #player客户端

├── ipc #player ipc调用

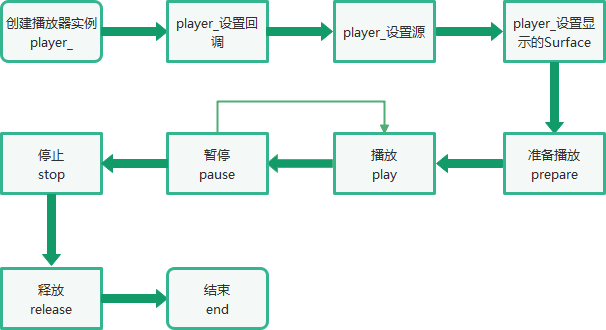

└──server#player服务端三、播放的总体流程

四、Native接口使用

void PlayerDemo::RunCase(const string &path)

{

player_ = OHOS::CreatePlayer();

if (player_ == nullptr) {

cout << "player_ is null" << endl;

return;

}

RegisterTable();

std::shared_ptr cb = std::make_shared();

cb->SetBufferingOut(SelectBufferingOut());

int32_t ret = player_->SetPlayerCallback(cb);

if (ret != 0) {

cout << "SetPlayerCallback fail" << endl;

}

if (SelectSource(path) != 0) {

cout << "SetSource fail" << endl;

return;

}

sptr producerSurface = nullptr;

producerSurface = GetVideoSurface();

if (producerSurface != nullptr) {

ret = player_->SetVideoSurface(producerSurface);

if (ret != 0) {

cout << "SetVideoSurface fail" << endl;

}

}

SetVideoScaleType();

if (SelectRendererMode() != 0) {

cout << "set renderer info fail" << endl;

}

ret = player_->PrepareAsync();

if (ret != 0) {

cout << "PrepareAsync fail" << endl;

return;

}

cout << "Enter your step:" << endl;

DoNext();

}void PlayerDemo::DoNext()

{

std::string cmd;

while (std::cin, cmd)) {

auto iter = playerTable_.find(cmd);

if (iter != playerTable_.end()) {

auto func = iter->second;

if (func() != 0) {

cout << "Operation error" << endl;

}

if (cmd.find("stop") != std::npos && dataSrc_ != nullptr) {

dataSrc_->Reset();

}

continue;

} else if (cmd.find("quit") != std::npos || cmd == "q") {

break;

} else {

DoCmd(cmd);

continue;

}

}

}

void PlayerDemo::RegisterTable()

{

(void)playerTable_.emplace("prepare", std::bind(&Player::Prepare, player_));

(void)playerTable_.emplace("prepareasync", std::bind(&Player::PrepareAsync, player_));

(void)playerTable_.emplace("", std::bind(&Player::Play, player_)); // ENTER -> play

(void)playerTable_.emplace("play", std::bind(&Player::Play, player_));

(void)playerTable_.emplace("pause", std::bind(&Player::Pause, player_));

(void)playerTable_.emplace("stop", std::bind(&Player::Stop, player_));

(void)playerTable_.emplace("reset", std::bind(&Player::Reset, player_));

(void)playerTable_.emplace("release", std::bind(&Player::Release, player_));

(void)playerTable_.emplace("isplaying", std::bind(&PlayerDemo::GetPlaying, this));

(void)playerTable_.emplace("isloop", std::bind(&PlayerDemo::GetLooping, this));

(void)playerTable_.emplace("speed", std::bind(&PlayerDemo::GetPlaybackSpeed, this));

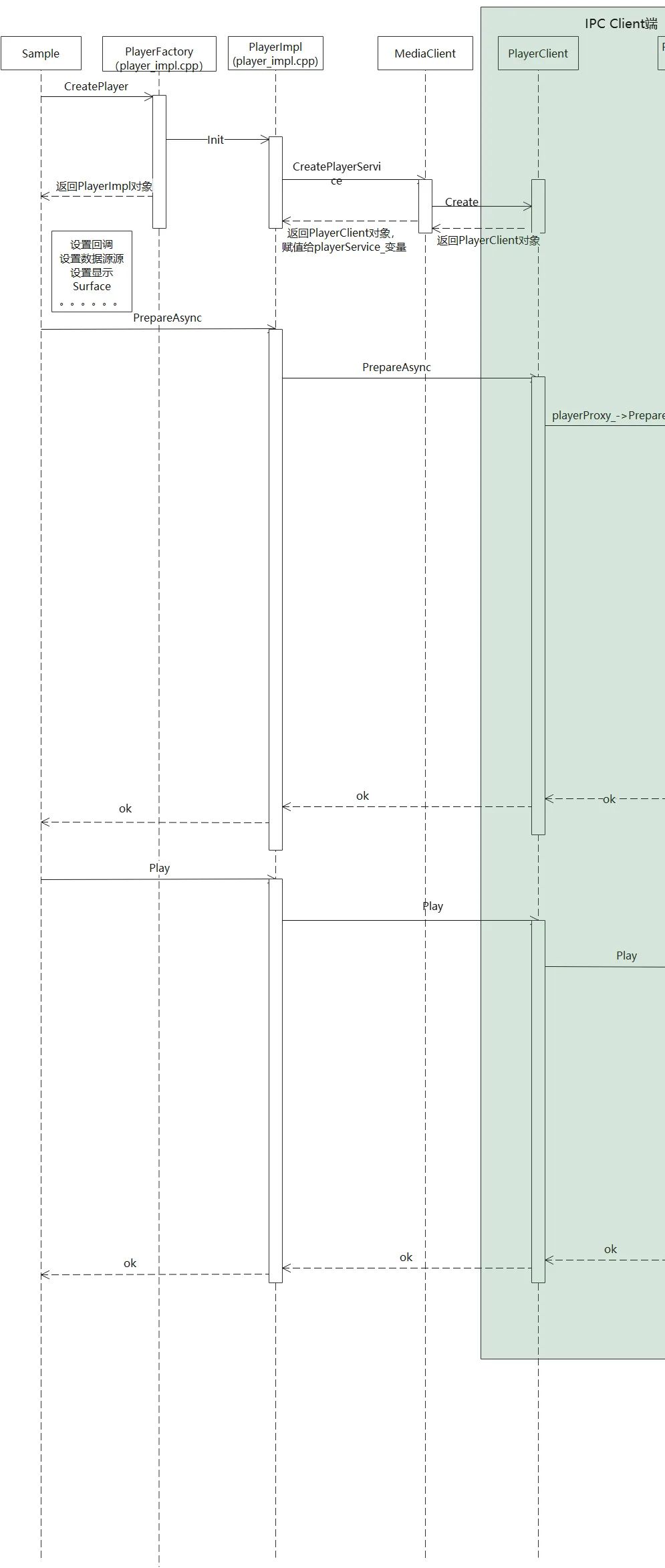

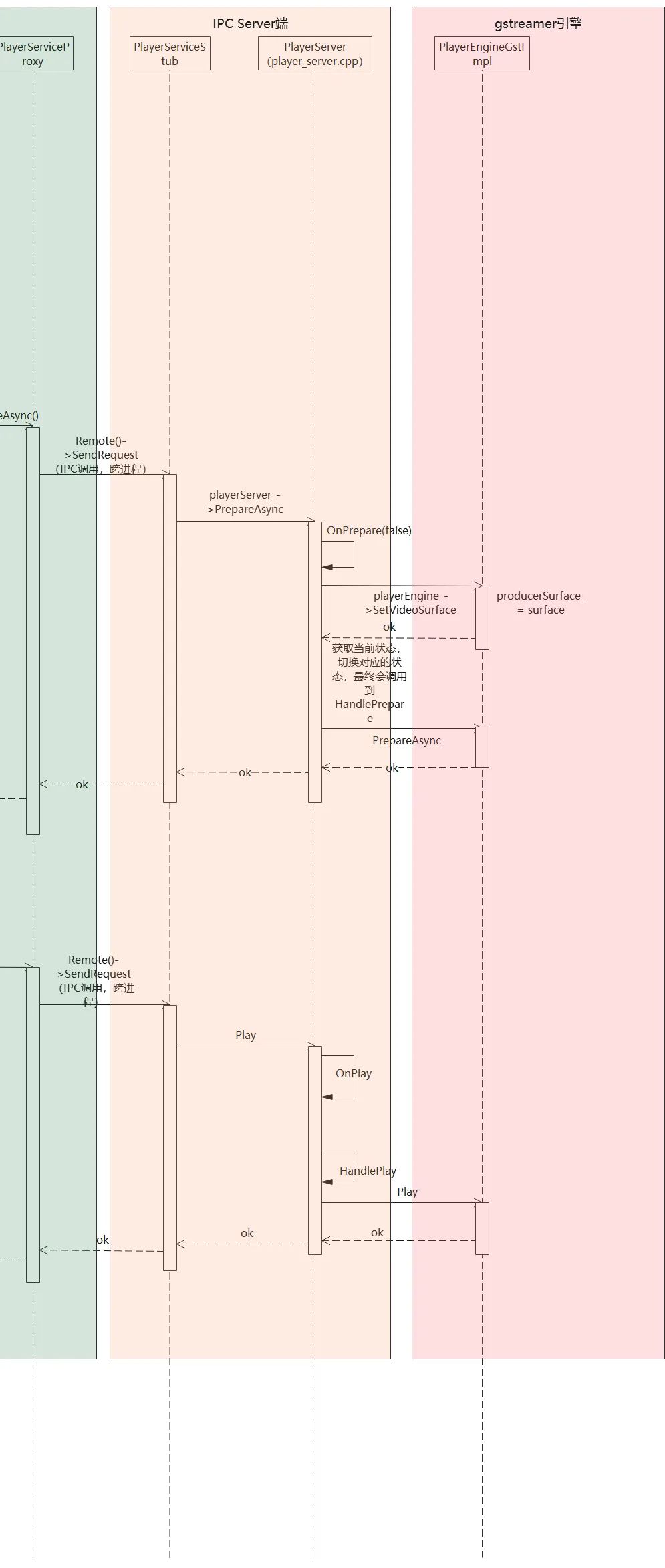

}五、调用流程

左右滑动查看更多

int32_t PlayerImpl::Init()

{

playerService_ = MediaServiceFactory::GetInstance().CreatePlayerService();

CHECK_AND_RETURN_RET_LOG(playerService_ != nullptr, MSERR_UNKNOWN, "failed to create player service");

return MSERR_OK;

}std::shared_ptr MediaClient::CreatePlayerService()

{

std::lock_guard lock(mutex_);

if (!IsAlived()) {

MEDIA_LOGE("media service does not exist.");

return nullptr;

}

sptr object = mediaProxy_->GetSubSystemAbility(

IStandardMediaService::MEDIA_PLAYER, listenerStub_->AsObject());

CHECK_AND_RETURN_RET_LOG(object != nullptr, nullptr, "player proxy object is nullptr.");

sptr playerProxy = iface_cast(object);

CHECK_AND_RETURN_RET_LOG(playerProxy != nullptr, nullptr, "player proxy is nullptr.");

std::shared_ptr player = PlayerClient::Create(playerProxy);

CHECK_AND_RETURN_RET_LOG(player != nullptr, nullptr, "failed to create player client.");

playerClientList_.push_back(player);

return player;

}int32_t PlayerImpl::Play()

{

CHECK_AND_RETURN_RET_LOG(playerService_ != nullptr, MSERR_INVALID_OPERATION, "player service does not exist..");

MEDIA_LOGW("KPI-TRACE: PlayerImpl Play in");

return playerService_->Play();

}

int32_t PlayerImpl::Prepare()

{

CHECK_AND_RETURN_RET_LOG(playerService_ != nullptr, MSERR_INVALID_OPERATION, "player service does not exist..");

MEDIA_LOGW("KPI-TRACE: PlayerImpl Prepare in");

return playerService_->Prepare();

}

int32_t PlayerImpl::PrepareAsync()

{

CHECK_AND_RETURN_RET_LOG(playerService_ != nullptr, MSERR_INVALID_OPERATION, "player service does not exist..");

MEDIA_LOGW("KPI-TRACE: PlayerImpl PrepareAsync in");

return playerService_->PrepareAsync();

}int32_t PlayerClient::Play()

{

std::lock_guard lock(mutex_);

CHECK_AND_RETURN_RET_LOG(playerProxy_ != nullptr, MSERR_NO_MEMORY, "player service does not exist..");

return playerProxy_->Play();

}int32_t PlayerServiceProxy::Play()

{

MessageParcel data;

MessageParcel reply;

MessageOption option;

if (!data.WriteInterfaceToken(PlayerServiceProxy::GetDescriptor())) {

MEDIA_LOGE("Failed to write descriptor");

return MSERR_UNKNOWN;

}

int error = Remote()->SendRequest(PLAY, data, reply, option);

if (error != MSERR_OK) {

MEDIA_LOGE("Play failed, error: %{public}d", error);

return error;

}

return reply.ReadInt32();

}int32_t PlayerServiceStub::Play()

{

MediaTrace Trace("binder::Play");

CHECK_AND_RETURN_RET_LOG(playerServer_ != nullptr, MSERR_NO_MEMORY, "player server is nullptr");

return playerServer_->Play();

}std::shared_ptr PlayerServer::Create()

{

std::shared_ptr server = std::make_shared();

CHECK_AND_RETURN_RET_LOG(server != nullptr, nullptr, "failed to new PlayerServer");

(void)server->Init();

return server;

}int32_t PlayerServer::Play()

{

std::lock_guard lock(mutex_);

if (lastOpStatus_ == PLAYER_PREPARED || lastOpStatus_ == PLAYER_PLAYBACK_COMPLETE ||

lastOpStatus_ == PLAYER_PAUSED) {

return OnPlay();

} else {

MEDIA_LOGE("Can not Play, currentState is %{public}s", GetStatusDescription(lastOpStatus_).c_str());

return MSERR_INVALID_OPERATION;

}

}

int32_t PlayerServer::OnPlay()

{

auto playingTask = std::make_shared>([this]() {

MediaTrace::TraceBegin("PlayerServer::Play", FAKE_POINTER(this));

auto currState = std::static_pointer_cast(GetCurrState());

(void)currState->Play();

});

int ret = taskMgr_.LaunchTask(playingTask, PlayerServerTaskType::STATE_CHANGE);

CHECK_AND_RETURN_RET_LOG(ret == MSERR_OK, ret, "Play failed");

lastOpStatus_ = PLAYER_STARTED;

return MSERR_OK;

}int32_t PlayerServer::Play()

{

return server_.HandlePlay();

}int32_t PlayerServer::HandlePlay()

{

int32_t ret = playerEngine_->Play();

CHECK_AND_RETURN_RET_LOG(ret == MSERR_OK, MSERR_INVALID_OPERATION, "Engine Play Failed!");

return MSERR_OK;

}六、总结

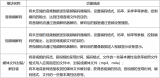

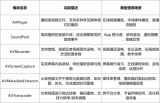

(1)提供给应用调用的Native接口,这个实际上通过OHOS::CreatePlayer()调用返回PlayerImpl实例。

(2)PlayerClient,这部分通过IPC的proxy调用,向远程服务发起调用请求。

(3)PlayerServer,这部分是播放服务的实现端,提供给Client端调用。

(4)Gstreamer,这部分是提供给PlayerServer调用,真正实现媒体播放的功能。

原文标题:OpenHarmony 3.2 Beta多媒体系列——音视频播放框架

文章出处:【微信公众号:OpenAtom OpenHarmony】欢迎添加关注!文章转载请注明出处。

声明:本文内容及配图由入驻作者撰写或者入驻合作网站授权转载。文章观点仅代表作者本人,不代表电子发烧友网立场。文章及其配图仅供工程师学习之用,如有内容侵权或者其他违规问题,请联系本站处理。

举报投诉

-

鸿蒙

+关注

关注

60文章

3031浏览量

46187 -

OpenHarmony

+关注

关注

33文章

3977浏览量

21368

原文标题:OpenHarmony 3.2 Beta多媒体系列——音视频播放框架

文章出处:【微信号:gh_e4f28cfa3159,微信公众号:OpenAtom OpenHarmony】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

相关推荐

热点推荐

拆解HDMI 4K@30Hz音视频分离器(环出同轴/光纤),一文看透它的“里子”

随着家庭影院系统和多设备娱乐中心的普及,HDMI音视频分离器成为连接多个高清源(如游戏机、蓝光播放器、电脑)与显示/音响设备的关键枢纽。本次拆解的HDMI4K@30Hz音视频分离器(支持

C++实战FFmpeg音视频编码实战屏幕录像机视频课程-基于QT5和ffmpeg sdk

技术已从单纯的“播放与录制”进化为连接物理世界与数字智能的核心纽带。尽管Qt框架已迭代至Qt6,且各类高级封装库层出不穷,但QT5与FFmpeg的组合,依然是音视频开发领域不可撼动的“黄金搭档”。这

BK7259 Datasheet、原理图、sdk与技术交流,多媒体音视频wifi+蓝牙soc芯片

BK7259规格书,原理图和开发资料,高度集成本地算力,h.264音视频编解码,高分驱屏,助力ai,多媒体,ipc等应用全面发展

BK7259是一款高度集成的单频2.4 GHz

发表于 04-15 10:45

2026年高清音视频切换器方案选型分析

随着消费电子行业升级迭代,8K超清设备、多信号源办公、专业音视频场景快速普及,切换器作为核心信号管理配件,应用覆盖家庭影院、办公会议、工业安防、多媒体教学等多个领域,客户对方案的兼容性、稳定性、定制

发表于 04-11 17:54

MAX4079:完整的音视频后端解决方案

MAX4079:完整的音视频后端解决方案 一、引言 在当今的电子设备中,音视频处理是一个关键的环节。无论是卫星接收器、有线电视接收器,还是家庭影院系统、DVD 播放器等,都需要高效可靠的音视频

从 “卡脖子” 到 “自主可控”,音视频分布式系统国产化实践之路

持续升级,导致国内音视频领域面临核心器件供应不稳定、技术迭代受限、信息安全存在隐患等多重挑战。在此背景下,国内领先的音视频技术企业主动突破,率先完成全系列分布式产品的国产化替代升级,为国内音视

基于FFmpeg解封装WMV和M4V格式

开源鸿蒙具备多格式音视频播放能力,其播放器需依次完成解协议、解封装、解码、渲染四大核心步骤,方可将音视频内容完整呈现给用户;其中,解封装作为衔接协议解析与

HT1001EK音视频编码器——高清传输.稳定无忧,全场景音视频解决方案

参数,老师、行政人员都能操作。支持音频分离和独立输入,线上课程录播、会议发言都清晰,1080P高清画面+低延时传输,拼接屏、投影机都能适配。而且兼容RTSP协议,VLC播放器直接拉流,不管是教室、会议室还是远程培训,一台设备就能搞定所有音视频传输需求。”

发表于 12-30 15:26

音视频编解码封装解封装部件介绍

是否有探索开源鸿蒙音视频编解码技术的欲望?是否对开源鸿蒙音视频编解码格式支持有诉求?别急——今天这份开源鸿蒙AVCodec Kit介绍文章,就是解答疑惑的指南!参考这份指南,可以使用开源鸿蒙的音视频编解码能力,进行应用开发;也可

音视频开发全栈解析

Media Kit 让开发者可以调用系统的音视频能力,涵盖播放、录制、录屏、元数据提取与转码六大核心功能模块,支撑系统应用与第三方应用在视频播放、内容创作、教学录屏、直播互动等典型场景

一款面向便携式多媒体应用的高品质立体声数模转换器 (DAC) 芯片

便携式多媒体播放器(Portable Media Player),简称PMP,是集音视频播放、图片浏览与数据存储功能于一体的手持设备。

花椒直播首次开源推流器组件 为鸿蒙开发者提供高性能推流解决方案

器。该工具基于花椒直播自主通用多媒体框架HJMedia打造而来,采用创新的通用多媒体框架设计,以高度模块化、可扩展的插件化架构,极大提升了音视频

千视电子受邀亮相2025音视频产业链研讨会,引领全链路音视频IP化新趋势

2025年8月22日,由中国电子音响行业协会和湖南省工业和信息化厅联合主办的“2025音视频产业链发展研讨暨对接会”在长沙举行。活动汇聚音视频产业链上下游企业,以及长沙市相关政府领导与行业

泰芯半导体推出星闪音视频无线SOC芯片TXW828

在短距离无线通信技术加速迭代的浪潮中,珠海泰芯半导体有限公司全球首先发布支持星闪(NearLink)标准的音视频无线SOC芯片——TXW828。这款集WiFi/蓝牙BLE/星闪三模融合音视频无线芯片

乐鑫ESP-RTC实时音视频通信方案

ESP-RTC乐鑫科技推出ESP-RTC(Real-TimeCommunication)音视频通信方案,能够实现稳定流畅、超低延时的语音和视频实时通信。ESP-RTC以乐鑫

OpenHarmony 3.2 Beta多媒体系列——音视频播放框架

OpenHarmony 3.2 Beta多媒体系列——音视频播放框架

评论