一家硅谷初创公司声称他们重塑了神经网络数学计算,开发出一种互补型边缘AI芯片。该芯片已经向客户发售样品,它并没有使用通常的大型乘法累加单元阵列。据这家公司称,该芯片的计算性能相当于4 TOPS,每瓦功耗可达55 TOPS/W。在低于20mW(以30fps运行YOLOv3测试)的功耗下,它可以达到数据中心级别的AI推理能力。

位于加州圣何塞的Perceive公司之前一直处于超级隐身模式。作为从Xperi独立出来的子公司,Perceive两年前正式成立,一直由其母公司出资支持。该团队有41人,Xperi内部也有一个类似规模的团队为该芯片开发应用。其创始CEO Steve Teig也是Xperi的CTO。他曾是Tabula的创始人兼CTO,Tabula是五年前倒闭的一家3D可编程逻辑初创公司;在此之前,他曾任Cadence CTO。

Teig解释道,他们最初的想法是将Xperi的传统图像和音频处理知识与机器学习相结合。 Xperi拥有DTS、IMAX Enhanced和HD Radio等品牌,其技术组合包括广泛应用于数码相机中处理红眼问题和图像稳定功能的图像处理软件,以及用于蓝光光盘播放器的音频处理软件。

“我们从一张白纸开始,用信息论来思考:神经网络到底做了什么样的计算?是否有一种不同的方式来实现这种计算,以改变边缘计算能做的事情?” Teig说。“经过几年的努力,我们发现了它,然后我们决定……我们应该设计一款芯片来体现那些想法。”

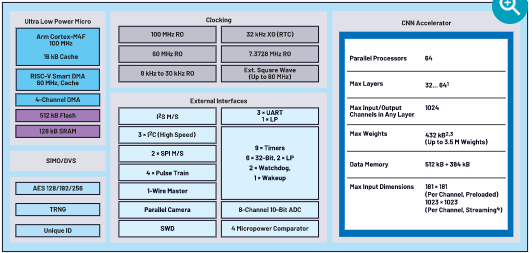

Teig向Xperi董事会提出,成立一家新公司来开发这种芯片,在功率预算仅为20mW的边缘设备上进行有意义的AI推理。最终,这款名为Ergo的7x7mm芯片可以在没有外部RAM的情况下提供4 TOPS的计算性能(Teig解释道,实际上其性能相当于4 TOPS的GPU)。Ergo支持多种类型的神经网络,包括卷积网络(CNN)和递归网络(RNN),这与市场上针对CNN量身定制的许多解决方案形成了鲜明对比。Ergo甚至可以同时运行多个异构网络。

Teig说:“唯一限制我们可以运行多少个神经网络的因素是能够集成多少内存。”Perceive已演示了以6000或7000万个参数同时运行YOLOv3或M2Det,加上具有数百万个参数的ResNet 28,再加上进行语音和音频处理的LSTM或RNN。在具体应用中,这可能对应于同时进行图像和音频推理。

Perceive还声称Ergo芯片具有55 TOPS / W的超高能效。这个数字比一些竞争对手所声称的能效高出一个数量级。Perceiver的数据显示,它在以每秒30帧的速度运行YOLOv3(这是一个具有6400万个参数的大型网络)时功耗只要20mW。

Perceive声称其Ergo芯片的效率高达55 TOPS / W,以30fps的速度运行YOLOv3,功耗仅20mW。

这种高能效源于采用了一些激进的电源门控和时钟门控技术,它们充分利用了神经网络处理的确定性属性。与其它类型的代码不同,它没有分支,因此在编译时时序是已知的。Perceive因而可以精确地知道需要开启什么以及何时开启。

Teig说:“在电池供电的情况下,这种芯片可以断电,零毫瓦,还有微瓦级的运动传感器或模拟麦克风来检测可能感兴趣的东西。我们可以一觉醒来,就加载好一个庞大的数据中心级别的神经网络,并在大约50毫秒内运行它,包括解密。因此,我们只占用大约两帧视频的容量。”

但精心的硬件设计只是工作的一部分。

信息论

Teig说:“我们提出了一种不同的方式来表达所进行的计算本身及随之而来的算法,并以一种新的方式来表达网络本身,这才是我们的优势所在。”

Perceive以信息论为出发点(信息论是一个科学分支,它包括将信号与噪声区分开的数学方法),并使用其概念来研究从噪声中提取信号所需的计算量。Teig以一个目标检测网络为例进行了说明。

“你将数百万个像素交给网络,只是想知道,这张照片中是否有一只狗?”Teig说。“图片中除了狗的信号,其它所有东西都是噪音。信息论可以使之量化,即你要知道多少才能确定图片中有一只狗,这真的可以通过数学方法使之精确确定。”

正如Teig所描述的那样,主流神经网络能够根据看到的许多狗的图片来进行归纳,因为它们至少可以发现噪声中的一些信号,但这是以经验法得到的,而不是严格的数学方法。这意味着信号会携带噪声,从而使主流神经网络变得非常庞大,并使它们容易受到对抗性例子和其它技巧的影响。

“在确定哪些部分需要保留、哪些部分只是噪音时,你越能用数学方法处理,就越能做好归纳工作,因而其它方面的开销也就越少。” Teig说道。“我可以断言,即使是目前的神经网络也是从噪声中提取信号,它们没有以更加严谨的方式进行处理,因此承担了额外开销。”

这种信息论观点是Perceive机器学习策略的基础,这代表着一种新的神经网络处理方式。

“实际上,这是从信息理论视角体现机器学习与芯片完美结合的最佳案例。”Teig声称。

芯片架构

以Teig担任Tabula CTO的背景,你可能会认为这是一个基于可编程逻辑的硬件,然而事实并非如此。

“十年来,我一直深受可编程逻辑的影响,如何构建丰富的互连体系结构以实现高性能的并行计算,因为FPGA上很多运算都是大规模并行的,而且在FPGA上计算和内存之间的交互也非常密集。”Teig说。“这无疑影响了我在Perceive的工作,但是我们所拥有的并不是可编程逻辑本身。我们受到的是这种思维方式的影响,但架构本身是围绕神经网络的。”

Perceive的神经网络结构具有可扩展性,初始芯片Ergo具有四个计算集,每个集都有自己的内存。尽管具体的细节仍在保密中,但Teig透露这些集群与其它AI加速器存在很大差异,其它AI加速器通常使用乘法累加单元(MAC)阵列来计算向量和矩阵的点积。

“我们没有那样做。”Teig说:“我们没有采用MAC阵列。但结果是……我们的能效是市场上其它同类产品的20至100倍,原因是其他人都在做同一件事,而我们却没有。我们采用全新的方法演绎网络,才使我们能够实现如此高的效率。再加上机器学习技术,它可以发现网络的这种表示形式,以及训练网络使其兼容芯片想要看到的内容。”

图像和音频

Ergo可以支持两个摄像头,并包括一个图像处理单元,该单元可以作为预处理器来处理鱼眼镜头图像扭曲修正、伽玛校正、白平衡和裁剪之类的事情。

“这不是什么花哨的功能,但是用硬件实现预处理显然很有用,我们就在硬件上这么做了。” Teig说道。“而且我们也有等效的音频,例如,我们可以使用多个立体声麦克风实现波束成形。”

我们还提供一个带有DSP模块的Synopsis ARC微处理器,也可用于预处理;另外还提供一个Synopsis的安全模块。

“我们还做了一件事,就是对所有内容进行绝对加密,以便在IoT环境中维持一定程度的安全。我们对网络进行加密,对微处理器上运行的代码进行加密,对接口进行加密,对所有内容加密。”Teig说。

该芯片为图像和音频外部的传感器提供合适I / O,并支持外部闪存和/或微处理器,可进行空中升级,用来更新芯片上加载的神经网络,或根据需要加载不同的网络。

Ergo可提供样品并随附参考板,预计在2020年第二季度实现量产。

责任编辑:tzh

-

芯片

+关注

关注

447文章

47788浏览量

409104 -

神经网络

+关注

关注

42文章

4572浏览量

98744 -

AI

+关注

关注

87文章

26443浏览量

264041

发布评论请先 登录

相关推荐

用STM32CubeMX导入神经网络,aiRun的indata应该定义成什么格式呢?

NanoEdge AI的技术原理、应用场景及优势

不可错过!人工神经网络算法、PID算法、Python人工智能学习等资料包分享(附源代码)

《 AI加速器架构设计与实现》+第一章卷积神经网络观后感

人工神经网络和bp神经网络的区别

卷积神经网络模型搭建

卷积神经网络和深度神经网络的优缺点 卷积神经网络和深度神经网络的区别

卷积神经网络的基本原理 卷积神经网络发展 卷积神经网络三大特点

卷积神经网络计算公式

卷积神经网络的应用 卷积神经网络通常用来处理什么

卷积神经网络原理:卷积神经网络模型和卷积神经网络算法

什么是神经网络?为什么说神经网络很重要?神经网络如何工作?

三个最流行神经网络

Perceive公司开发的互补型边缘AI芯片,重塑了神经网络数学计算

Perceive公司开发的互补型边缘AI芯片,重塑了神经网络数学计算

评论