援引自 mPLUG-Owl,这三个工作的主要区别如图 1 所示,总体而言,模型结构和训练策略方面大同....

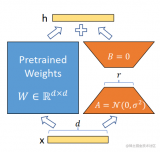

在推理时,将左右两部分的结果加到一起即可,h=Wx+BAx=(W+BA)x,所以,只要将训练完成的矩....

通过我们的VPGTrans框架可以根据需求为各种新的大语言模型灵活添加视觉模块。比如我们在LLaMA....

以ChatGPT为代表的大语言模型(Large Language Models, LLM)在机器翻译....

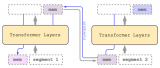

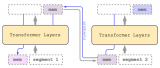

CoLT5达到64K,GPT-4达到32K长度,而RMT在实验结果中长度加到4096个分段20480....

为优化LLM为“小模型/少数据/好效果”,提供了一种新思路:”一步步蒸馏”(Distilling s....

区别于现有多模态大模型针对视频输入的处理方法,即首先文本化视频内容再接入大模型利用大模型自然语言理解....

缩放定律的一个重要作用就是预测模型的性能,但是随着规模的扩大,模型的能力在不同的任务上并不总表现出相....

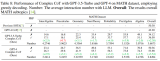

结果表明,GP-T-4+PHP 在多个数据集上取得了 SOTA 结果,包括 SVAMP (91.9%....

如果经过多任务微调,编码器-解码器掩码模型最好【这参数量都翻倍了,很难说不是参数量加倍导致的】。换个....

这项工作是对齐研究方法的第三个支柱的一部分:希望使对齐研究工作本身自动化。这种方法的一个有前途的方面....

添加关键字过滤器是增强检索结果的一种方法。但这也带来了一系列挑战。我们需要手动或通过 NLP 关键字....

基于开源多模态模型 OpenFlamingo,作者使用公开数据集创建了各种视觉指令数据,包括视觉问答....

大型语言模型LLM(Large Language Model)具有很强的通用知识理解以及较强的逻辑推....

因此,对于ChatGPT的评测方面,不止需要关注给定下游任务的性能评测,同时还需要考虑到使用大模型过....

近来NLP领域由于语言模型的发展取得了颠覆性的进展,扩大语言模型的规模带来了一系列的性能提升,然而单....

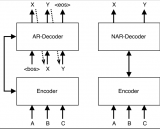

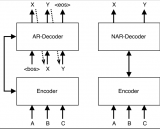

虽然GPT模型在自然语言处理领域中表现出色,但是它们仍然存在一些问题。例如,GPT模型的自回归设计导....

从信息论的角度来看,具有保持信息多样性能力的随机dropping方法比没有这种能力的能保存更多的信息....

神经网络在训练的时候,采用的随机梯度下降算法,一定程度上等效于物种的基因突变,本质是有一定方向的随机....

通用计算机的诞生对社会生产力的提升意义重大。学习写代码比学习开发逻辑电路要简单太多了。普通人经过一段....

复旦大学自然语言处理实验室,自2019年起,自研了PDF处理工具DocAI,针对非扫描件PDF,具有....

Instruct-UIE 统一了信息抽取任务训练方法,可以融合不同类型任务以及不同的标注规范,统一进....

另一方面,根据Moors等人[8],人类的感觉和行动倾向是情绪的两个重要组成部分,并在很大程度上为目....

随着大规模预训练语言模型(LLM)能力的不断提升,in-context learning(ICL)逐....

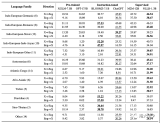

基础 LLM 基本信息表,GPT-style 表示 decoder-only 的自回归语言模型,T5....

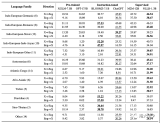

同样的,使用这些低资源语言的研究人员在ML和NLP社区中的代表性同样不足。例如,虽然我们可以观察到隶....

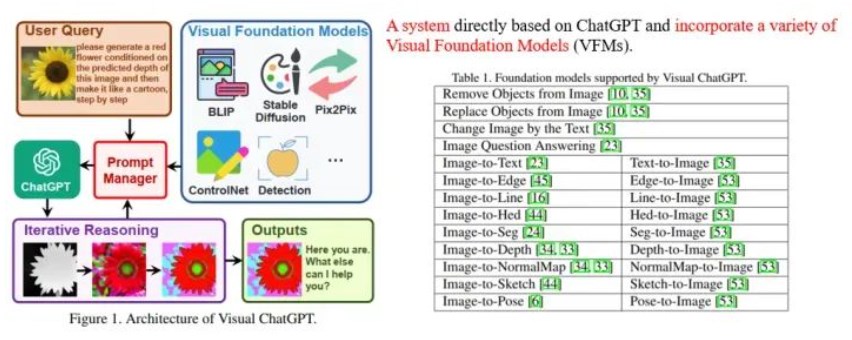

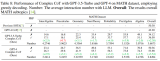

Visual ChatGPT 是一种智能交互系统,它将不同的视觉基础模型与 ChatGPT 相结合,....

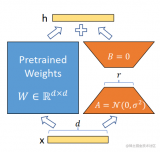

在本文中,我们将展示如何使用 大语言模型低秩适配 (Low-Rank Adaptation of L....

提出了一个简单有效的视觉语言模型架构,BridgeTower,通过在顶层单模态层和每个跨模态层之间建....

在本文中,我们将对该模型进行分享和介绍。与firefly-1b4相比,firefly-2b6的代码生....