虽然与以千兆赫速度运行的现代微处理器相比,人脑的运行速度只有几赫兹,简直就像蜗牛一样,但毋庸置疑的是,人类大脑是迄今为止已知的最伟大的计算设备。人类大脑的强大之处在于,能够同时进行每秒十亿次的计算,这种并行性使得它能够轻松地解决传统计算机尚未解决的问题,比如驾驶、行走、交谈等等。而更不可思议的是,这每秒十亿次的计算背后,大脑所需要的能量来源可能仅为一碗稀饭。相比之下,一台超级计算机所需要的电力要超过一座大城市的电力消耗,远远多于大脑几个数量级。这就是为什么计算机科学家,一心想要使用神经网络作为计算工具,以模拟人类大脑的计算性能。但说起来容易做起来难。虽然通过普通芯片也可以编入类似于神经网络的程序,但这需要大量的计算和能量消耗。

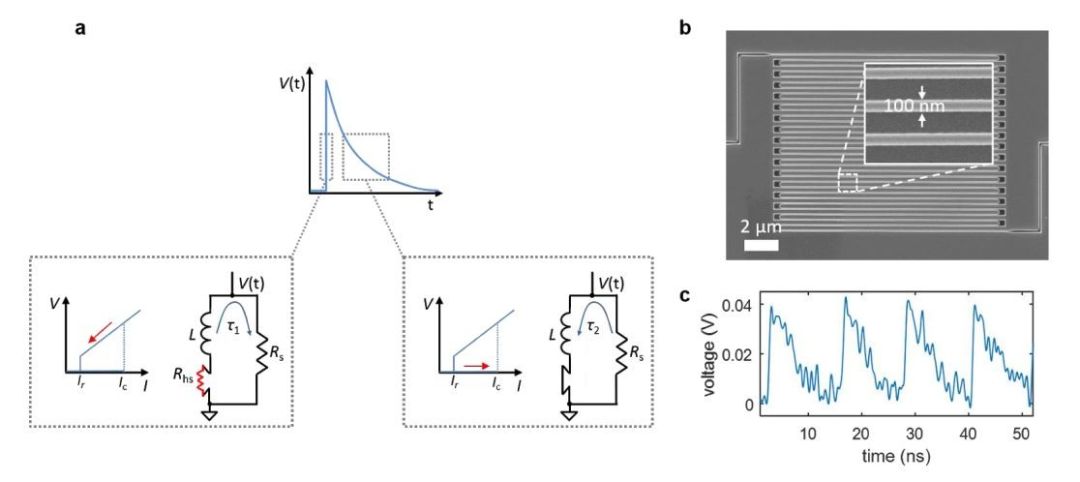

于是,计算机科学家尝试创建人工神经元,并将它们连接成类似大脑的网络。不过一直以来,并没有人提出一个设计能够接近大脑的计算性能和运行效率。近日,麻省理工学院的 Emily Toomey 和他的同事设计了一个由纳米线组成的超导神经元,在很多方面都更加接近一个真实的神经元。研究成果以预印本的形式发表在 arxiv.org 网站上。研究人员表示,他们的设备与大脑的能量效率相匹配(至少在理论上是这样),并且是新一代超导神经网络的基石,该超导神经网络的效率将远远高于传统的计算设备。首先,我们了解一些背景知识。神经元以电脉冲或动作电位的形式编码信息,这些电脉冲或动作电位沿着神经纤维传播,神经元之间通过突触的结构进行彼此分隔和信号传递。一个神经元可以通过突触影响其它神经元,传递的神经信号可以激活或抑制下游神经元。事实上,突触的存在可以使神经元之间像逻辑门一样工作,对多个输入信号产生一个输出响应。在生物神经元中,的确有许多重要的特性,比如除非输入信号超过某个阈值水平,否则信号不会激活,而且在经过一段时间(称为不应期)之前,它们不能被再次激活;此外,突起沿轴突移动的时间也很重要,因为它编码了突起已经移动的距离。因此,人工神经元必须能够尽可能多地复制这些生物特征,而这也需要一些更复杂的电路设计。Toomey 和他的同事指出,超导纳米线具有一种特殊的非线性特性,使得它们可以像神经元一样工作。这种特性的产生是因为当流过纳米线的电流超过某个阈值时,纳米线的超导性就会崩溃,此时电阻突然增大,产生了一个类似于神经元动作电位的电压脉冲。用这种电压脉冲来调制另一根超导纳米线产生的另一个脉冲,使得对生物神经元的模拟更加真实,相当于创造了一个具有许多生物神经元特性的简单超导电路。研究人员也已经证明超导神经元具有触发阈值、不应期,以及可以根据电路特性进行调整的传播时间等特性。

图 | 超导纳米线中的松弛振荡,是纳米线神经元中脉冲形成的基础(来源:arxiv.prg)至关重要的是,这种超导神经元还可以用来触发或抑制其它神经元。这种“分列”属性是创建神经网络的关键,也是其它超导神经元设计从未实现的。Toomey 和同事的计算表明,由于超导电路耗电量很小,这种超导神经网络可以与生物神经网络的效率相媲美。神经网络中每秒使用 1 瓦特能量可以执行的突触运行数量,是衡量计算性能的指标。Toomey 表示,他们提出的神经网络应该能够达到每秒每瓦特 10^14 个突触运行,与人类大脑大致相当。“从功率和速度的角度来看,纳米线神经元可能是一项极具竞争力的技术。”他们说。当然,纳米线神经元也存在一些局限。与大脑相比,超导神经元最大的差距就是只能连接少数其它神经元,相比之下,人类大脑中的每个神经元都与成千上万的神经元相连。而且,目前 Toomey 等人的超导神经网络还只是一个设计。尽管如此,模拟结果还是很有希望的。研究人员表示,目前的分析表明,纳米线神经元是低功耗人工神经网络发展的一个有希望的候选对象,而且潜力是巨大的。研究人员认为,超导神经网络可能成为全新计算机硬件的基础,这些芯片可以通过超导互连连接在一起,也就没有散热的问题。“其结果将是一个大规模的神经形态处理器,它可以被训练成一个脉冲神经网络(spiking neural network),执行模式识别之类的任务或用于模拟大型生物仿真网络的脉冲动力学。”无论如何,这是一项有趣的工作,尽管在兴奋之前还需要进行概念验证演示。

-

网络

+关注

关注

14文章

7251浏览量

87437 -

神经元

+关注

关注

1文章

284浏览量

18319

发布评论请先 登录

相关推荐

英特尔发布新一代神经拟态系统Hala Point,11.5亿神经元,12倍性能提升

科研团队研发自适应神经连接光子处理器

人工神经网络相关资料

不可错过!人工神经网络算法、PID算法、Python人工智能学习等资料包分享(附源代码)

基于神经元时序编码的全新ANN-SNN转换方法

研发的新型超导神经元,在很多方面都更加接近一个真实的神经元

研发的新型超导神经元,在很多方面都更加接近一个真实的神经元

评论