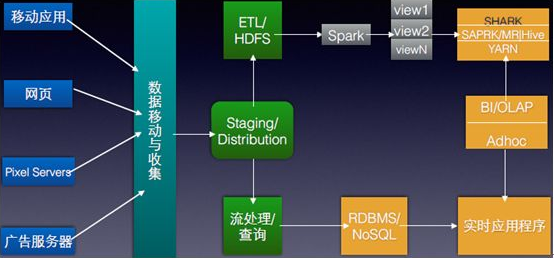

Spark是一个基于内存计算的开源的集群计算系统,目的是让数据分析更加快速。Spark非常小巧玲珑,由加州伯克利大学AMP实验室的Matei为主的小团队所开发。使用的语言是Scala,项目的core部分的代码只有63个Scala文件,非常短小精悍。

声明:本文内容及配图由入驻作者撰写或者入驻合作网站授权转载。文章观点仅代表作者本人,不代表电子发烧友网立场。文章及其配图仅供工程师学习之用,如有内容侵权或者其他违规问题,请联系本站处理。

举报投诉

-

intel

+关注

关注

19文章

3452浏览量

184772 -

代码

+关注

关注

30文章

4555浏览量

66750 -

机器学习

+关注

关注

66文章

8122浏览量

130553

发布评论请先 登录

相关推荐

分布式软件系统

分布式软件系统分布式软件系统(Distributed Software Systems)是支持分布式处理的软件系统,是在由通信网络互联的多处理机体系结构上执行任务的系统。它包括

发表于 07-22 14:53

hadoop和spark的区别

,即便如此二者各自存在的目的是不同的。Hadoop是一个分布式的数据基础设施,它是将庞大的数据集分派到由若干台计算机组成的集群中的多个节点进行存储。Spark是一个专门用来对那些分布式存储的大数据进行

发表于 11-30 15:51

spark集群使用hanlp进行分布式分词操作说明

本篇分享一个使用hanlp分词的操作小案例,即在spark集群中使用hanlp完成分布式分词的操作,文章整理自【qq_33872191】的博客,感谢分享!以下为全文: 分两步:第一步:实现

发表于 01-21 10:45

【学习打卡】OpenHarmony的分布式任务调度

、同步、注册、调用)机制。分布式任务调度程序是能够跨多个服务器启动调度作业或工作负载的软件解决方案,整个过程是不需要人来值守的。举个例子,我们可以在一台或多台机器上安装分布式调度器,用

发表于 07-18 17:06

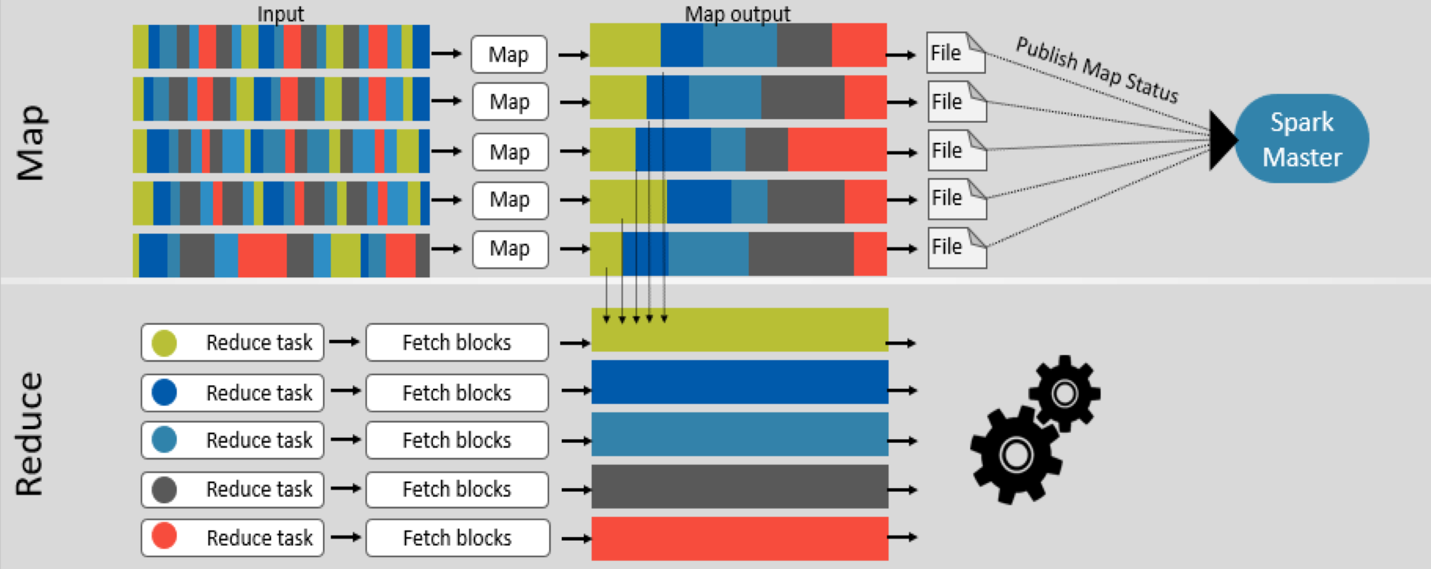

如何使用Apache Spark 2.0

,Spark 2.0现在比以往更易使用。在这部分,我将介绍如何使用Apache Spark 2.0。并将重点关注DataFrames作为新Dataset API的无类型版本。 到

发表于 09-28 19:00

•0次下载

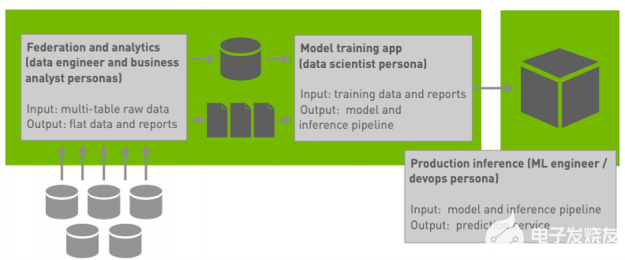

机器学习实例:Spark与Python结合设计

Apache Spark是处理和使用大数据最广泛的框架之一,Python是数据分析、机器学习等领域最广泛使用的编程语言之一。如果想要获得更棒的机器

发表于 07-01 10:15

•2629次阅读

Apache Spark 3.2有哪些新特性

在单节点机器或集群上执行数据工程、数据科学和机器学习的最广泛使用的引擎。 Spark 3.2 继续以使 Spark 更加统一、简单、快速和可

一文详细了解APACHE SPARK开源框架

Apache Spark 是一个开源框架,适用于跨集群计算机并行处理大数据任务。它是在全球广泛应用的分布式处理框架之一。

利用Apache Spark和RAPIDS Apache加速Spark实践

在第三期文章中,我们详细介绍了如何充分利用 Apache Spark 和 Apache RAPIDS 加速器 Spark 。 大多数团队

Apache Spark上的分布式机器学习的介绍

Apache Spark上的分布式机器学习的介绍

评论