无人驾驶感知系统的依靠

本文是无人驾驶技术系列的第三篇,着重介绍基于计算机视觉的无人驾驶感知系统。在现有的无人驾驶系统中,LiDAR是当仁不让的感知主角。但是由于LiDAR的成本高等因素,业界有许多是否可以使用成本较低的摄像头去承担更多感知任务的讨论。本文探索了基于计算机视觉的无人驾驶感知方案。首先,验证一个方案是否可行需要一个标准的测试方法,我们介绍了广泛被使用的无人驾驶视觉感知数据集KITTI。然后,我们讨论了在无人驾驶场景中使用到的具体计算机视觉技术,包括Optical Flow和立体视觉、物体的识别和跟踪以及视觉里程计算法。

无人驾驶的感知

在无人驾驶技术中,感知是最基础的部分,没有对车辆周围三维环境的定量感知,就有如人没有了眼睛,无人驾驶的决策系统就无法正常工作。为了安全与准确的感知,无人驾驶系统使用了多种传感器,其中可视为广义“视觉”的有超声波雷达、毫米波雷达、激光雷达(LiDAR)和摄像头等。超声波雷达由于反应速度和分辨率的问题主要用于倒车雷达,毫米波雷达和激光雷达承担了主要的中长距测距和环境感知,而摄像头主要用于交通信号灯和其他物体的识别。

LiDAR由于出色的精度和速度,一直是无人驾驶感知系统中的主角,是厘米级的高精度定位中不可或缺的部分。但是正如本系列第一篇文章《光学雷达在无人驾驶技术中的应用》分析,LiDAR存在成本昂贵、空气中的悬浮物影响精度等问题,毫米波雷达虽然相比LiDAR可以适应较恶劣的天气和灰尘,但也需要防止其他通讯设备和雷达间的电磁波干扰。

传统计算机视觉领域的主要研究方向是基于可见光的摄像头的视觉问题,从摄像头采集的二维图像推断三维物理世界的信息。那么最常见、成本较低的摄像头能不能承担更多的感知任务呢?在本文中,我们将探索基于计算机视觉的无人驾驶感知方案。首先,要验证一个方案是否可行,我们需要一个标准的测试方法。本文将介绍由德国卡尔斯鲁厄技术研究院(KIT)和丰田芝加哥技术研究院(TTIC)共同开发的KITTI数据集。在有了标准的数据集之后,研究人员可以开发基于视觉的无人驾驶感知算法,并使用数据集对算法进行验证。我们将介绍计算机视觉在无人驾驶感知方面的前沿研究,包括光流(Optical Flow)和立体视觉、物体的检测和跟踪以及视觉里程计算法。

KITTI数据集

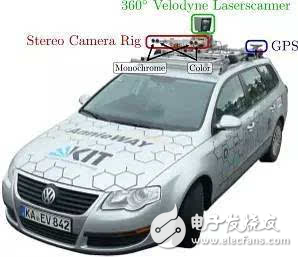

KITTI数据集是由KIT和TTIC在2012年开始的一个合作项目,网站在http://www.cvlibs.net/datasets/kitti/,这个项目的主要目的是建立一个具有挑战性的、来自真实世界的测试集。他们使用的数据采集车配备了:

一对140万像素的彩色摄像头Point Grey Flea2(FL2-14S3C-C),采集频率10赫兹。

一对140万像素的黑白摄像头Point Grey Flea2(FL2-14S3M-C),采集频率10赫兹。

一个激光雷达Velodne HDL-64E。

一个GPS/IMU定位系统OXTSRT 3003。

图1 数据采集车

图1这辆车在卡尔斯鲁厄的高速公路和城区的多种交通环境下收集了数据,用激光雷达提供的数据作为ground truth,建立了面向多个测试任务的数据集:

Stereo/Optical Flow数据集:如图2,数据集由图片对组成。一个Stereo图片对是两个摄像头在不同的位置同时拍摄的,Optical Flow图片对是同一个摄像头在相邻时间点拍摄

非常好我支持^.^

(0) 0%

不好我反对

(0) 0%