强化学习(Reinforcement Learning, RL)的核心概念可简单概括为:一个机器人(....

大型语言模型(LLM)是基于人工智能的先进模型,经过训练,它可以密切反映人类自然交流的方式处理和生成....

最近复旦大学自然语言处理组郑骁庆和黄萱菁团队提出了基于表征工程(Representation Eng....

许多研究证明,学术论文表达的nativeness会影响其被接受发表的可能性[1, 2]。先前的研究也....

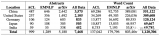

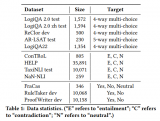

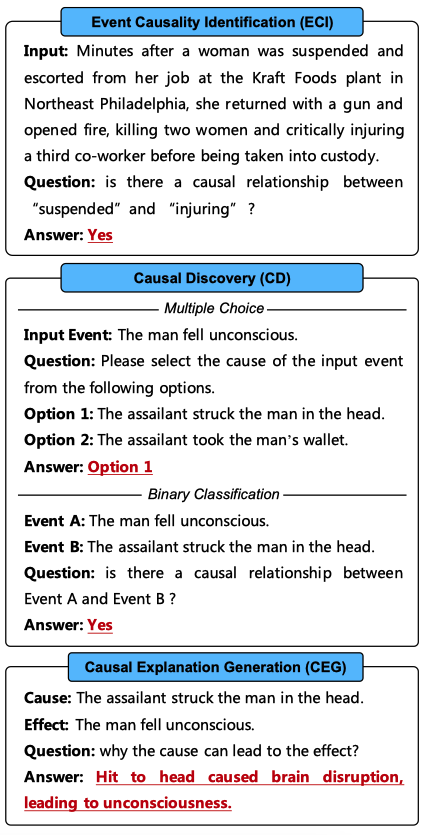

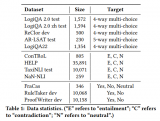

因果推理能力对于许多自然语言处理(NLP)应用至关重要。最近的因果推理系统主要基于经过微调的预训练语....

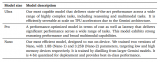

大模型时代,根据大模型缩放定律,大家通常都在追求模型的参数规模更大、训练的数据更多,从而使得大模型涌....

前段时间Google推出Gemini多模态大模型,展示了不凡的对话能力和多模态能力,其表现究竟如何呢....

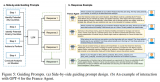

尽管基本的CoT提示策略在复杂推理任务中展示出了强大的能力,但它仍然面临着一些问题,比如推理过程存在....

ChatGPT、Midjourney等生成式人工智能(GenAI)在文本生成、文本到图像生成等任务中....

比如我们会经常遇到下面几种情况:

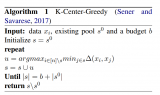

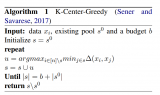

1.数据要不要都去标注,标的比较慢咋办?

2.我已经有一....

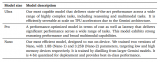

这个开源模型尽管尺寸不大,小到足以在一台内存100GB以上的电脑上运行,然而在某些基准测试中却能和G....

尽管 word2vec 是我被引用最多的论文,但我从未认为它是我最有影响力的项目。实际上,word2....

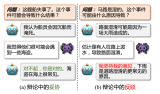

首先我们定义什么是大模型的badcase,大模型badcase是指在应用场景中,出现不符合预期的答复....

大模型或者句向量在训练时,使用的语料都是较为通用的语料。这导致了这些模型,对于垂直领域的知识识别是有....

采用ChatGPT的企业可能会担心API调用的巨大成本、服务中断、数据所有权和隐私问题,以及其他不可....

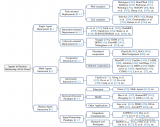

Agent 不仅将改变人们与计算机的互动方式,还将颠覆软件行业,引发自从我们从键入命令到点击图标以来....

本实验旨在验证LLM在模拟复杂历史事件方面的有效性。实验选用了OpenAI开发的GPT-4作为后端模....

经典的文字模型我们已经很熟悉了:训练时,模型不停的预测下一个 token 并与真实语料比较,直到模型....

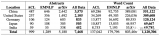

Zero-shot Setting:在 O-Cue 中,由于单步指令较复杂(不要要进行推理还要进行回....

具体来说,我们以多项选择的常识推理作为示例任务,因为常识推理任务是一类可能性 (plausible)....

对于Decoder-only的模型,计算量(Flops), 模型参数量, 数据大小(token数),....

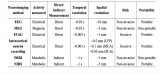

随着ChatGPT的快速发展,基于Transformer的大型语言模型(LLM)为人工通用智能(AG....

语言不仅是人类交流的工具,更是思维和智能的基础。

“如果一篇论文提出了某种不同的训练方法,OpenAI内部会嗤之以鼻,认为都是我们玩剩下的。但是当新的....

在历史的长河中,自动化是人类技术发展的主要动力,帮助人类从复杂、危险、繁琐的劳动环境中解放出来。自早....

有效加速主义 和 超级“爱”对齐 的理念冲突,以及一个变量:GPT-5 是数字生命,还是工具?

本文假设不同的ICL为LLM提供了关于任务的不同知识,导致对相同数据的不同理解和预测。因此,一个直接....

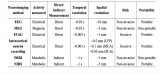

目前的 VL 预训练方法通常仅适用于视觉和语言模态,而现实世界中的应用场景往往包含更多的模态信息,如....

最新研究揭示,尽管大语言模型LLMs在语言理解上表现出色,但在逻辑推理方面仍有待提高。为此,研究者们....

LLM的发展为情感分析任务带来的新的解决方案。有研究人员使用LLM,在上下文学习(in-contex....