常遇到两类朋友。一类是会爬虫但不知道如何进一步做数据分析的,一类是平常用Excel做分析但不太会用Python分析的。如果和你很像,那下面这篇系统长文会很适合你,建议先收藏。

Excel是数据分析中最常用的工具,本文通过Python与excel的功能对比介绍如何使用Python通过函数式编程完成excel中的数据处理及分析工作。从1787页的pandas官网文档中总结出最常用的36个函数,通过这些函数介绍如何通过Python完成数据生成和导入、数据清洗、预处理、数据分类、数据筛选、分类汇总、透视等最常见的操作。

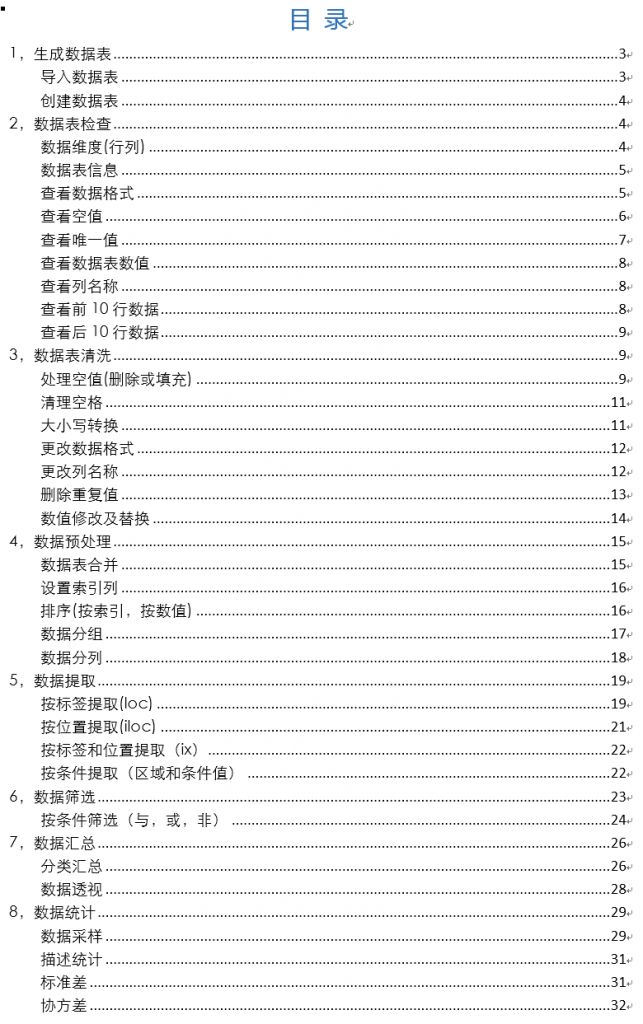

文章内容共分为9个部分目录如下:

目录

01 生成数据表

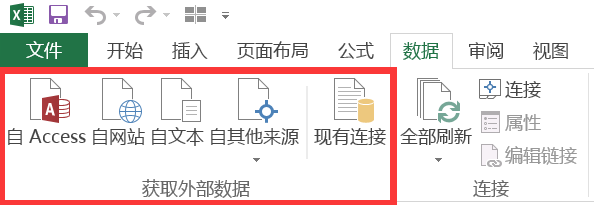

第一部分是生成数据表,常见的生成方法有两种,第一种是导入外部数据,第二种是直接写入数据。Excel中的文件菜单中提供了获取外部数据的功能,支持数据库和文本文件和页面的多种数据源导入。

获取外部数据

python支持从多种类型的数据导入。在开始使用python进行数据导入前需要先导入pandas库,为了方便起见,我们也同时导入numpy库。

1importnumpyasnp2importpandasaspd

导入数据表

下面分别是从excel和csv格式文件导入数据并创建数据表的方法。代码是最简模式,里面有很多可选参数设置,例如列名称,索引列,数据格式等等。感兴趣的朋友可以参考pandas的官方文档。

1df=pd.DataFrame(pd.read_csv('name.csv',header=1))2df=pd.DataFrame(pd.read_excel('name.xlsx'))

创建数据表

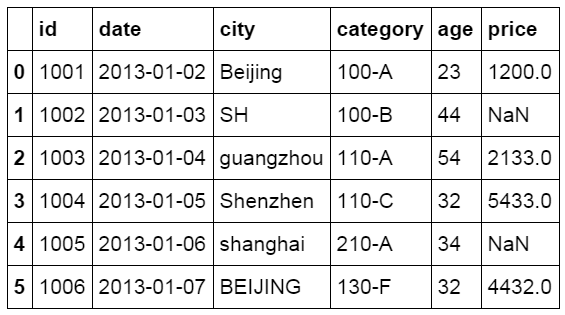

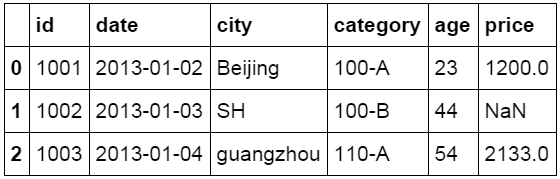

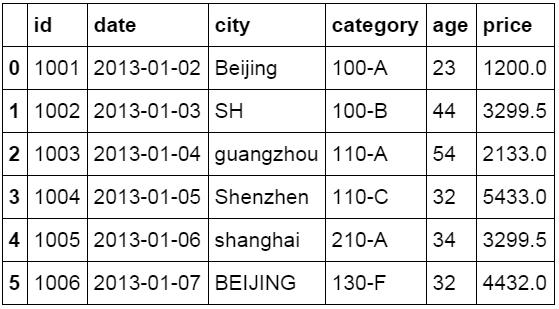

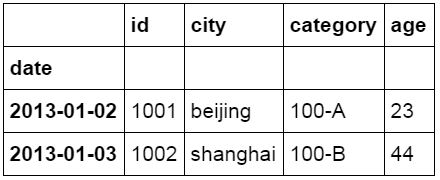

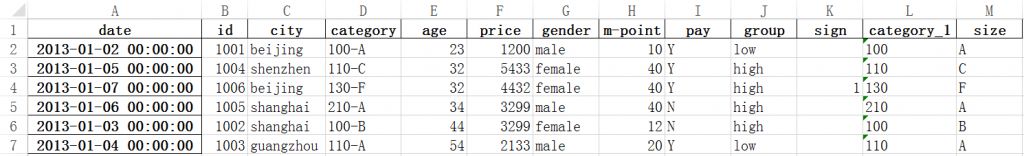

另一种方法是通过直接写入数据来生成数据表,excel中直接在单元格中输入数据就可以,python中通过下面的代码来实现。生成数据表的函数是pandas库中的DateFrame函数,数据表一共有6行数据,每行有6个字段。在数据中我们特意设置了一些NA值和有问题的字段,例如包含空格等。后面将在数据清洗步骤进行处理。后面我们将统一以DataFrame的简称df来命名数据表。

1df=pd.DataFrame({"id":[1001,1002,1003,1004,1005,1006],2"date":pd.date_range('20130102',periods=6),3"city":['Beijing','SH','guangzhou','Shenzhen','shanghai','BEIJING'],4"age":[23,44,54,32,34,32],5"category":['100-A','100-B','110-A','110-C','210-A','130-F'],6"price":[1200,np.nan,2133,5433,np.nan,4432]},7columns=['id','date','city','category','age','price'])

这是刚刚创建的数据表,我们没有设置索引列,price字段中包含有NA值,city字段中还包含了一些脏数据。

df

02 数据表检查

第二部分是对数据表进行检查,python中处理的数据量通常会比较大,比如我们之前的文章中介绍的纽约出租车数据和Citibike的骑行数据,数据量都在千万级,我们无法一目了然的了解数据表的整体情况,必须要通过一些方法来获得数据表的关键信息。数据表检查的另一个目的是了解数据的概况,例如整个数据表的大小,所占空间,数据格式,是否有空值和重复项和具体的数据内容。为后面的清洗和预处理做好准备。

数据维度(行列)

Excel中可以通过CTRL+向下的光标键,和CTRL+向右的光标键来查看行号和列号。Python中使用shape函数来查看数据表的维度,也就是行数和列数,函数返回的结果(6,6)表示数据表有6行,6列。下面是具体的代码。

1#查看数据表的维度2df.shape3(6,6)

数据表信息

使用info函数查看数据表的整体信息,这里返回的信息比较多,包括数据维度,列名称,数据格式和所占空间等信息。

1#数据表信息 2df.info() 3 4

查看数据格式

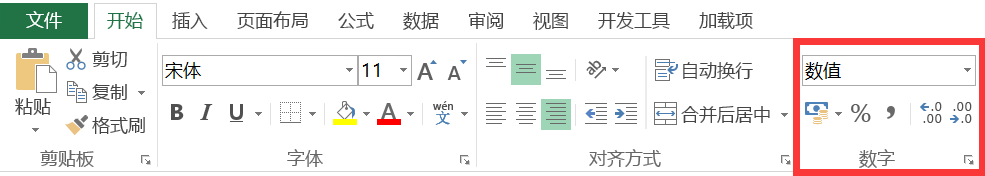

Excel中通过选中单元格并查看开始菜单中的数值类型来判断数据的格式。Python中使用dtypes函数来返回数据格式。

Dtypes是一个查看数据格式的函数,可以一次性查看数据表中所有数据的格式,也可以指定一列来单独查看。

1#查看数据表各列格式 2df.dtypes 3 4idint64 5datedatetime64[ns] 6cityobject 7categoryobject 8ageint64 9pricefloat6410dtype:object1112#查看单列格式13df['B'].dtype1415dtype('int64')

查看空值

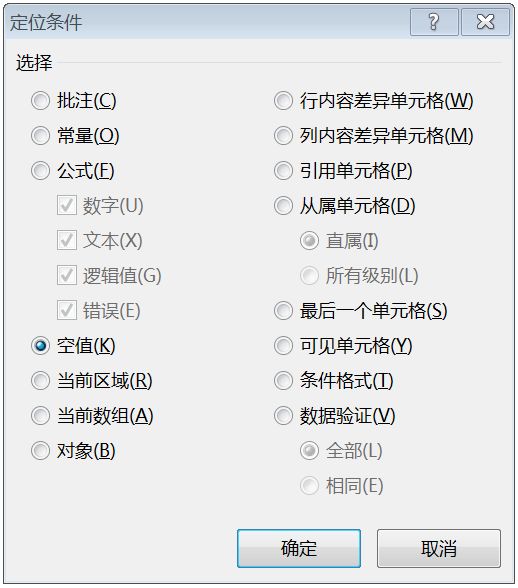

Excel中查看空值的方法是使用“定位条件”功能对数据表中的空值进行定位。“定位条件”在“开始”目录下的“查找和选择”目录中。

查看空值

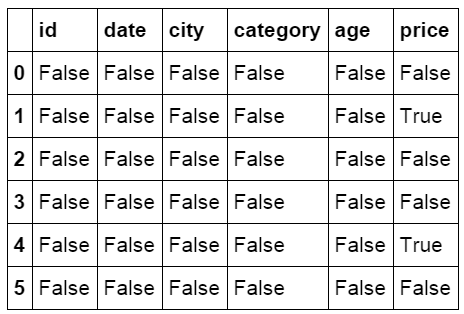

Isnull是Python中检验空值的函数,返回的结果是逻辑值,包含空值返回True,不包含则返回False。可以对整个数据表进行检查,也可以单独对某一列进行空值检查。

1#检查数据空值2df.isnull()

df_isnull1#检查特定列空值 2df['price'].isnull() 3 40False 51True 62False 73False 84True 95False10Name:price,dtype:bool

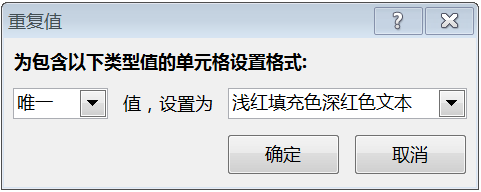

查看唯一值

Excel中查看唯一值的方法是使用“条件格式”对唯一值进行颜色标记。Python中使用unique函数查看唯一值。

查看唯一值

Unique是查看唯一值的函数,只能对数据表中的特定列进行检查。下面是代码,返回的结果是该列中的唯一值。类似与Excel中删除重复项后的结果。

1#查看city列中的唯一值2df['city'].unique()34array(['Beijing','SH','guangzhou','Shenzhen','shanghai','BEIJING'],dtype=object)

查看数据表数值

Python中的Values函数用来查看数据表中的数值。以数组的形式返回,不包含表头信息。

1#查看数据表的值 2df.values 3 4array([[1001,Timestamp('2013-01-0200:00:00'),'Beijing','100-A',23, 51200.0], 6[1002,Timestamp('2013-01-0300:00:00'),'SH','100-B',44,nan], 7[1003,Timestamp('2013-01-0400:00:00'),'guangzhou','110-A',54, 82133.0], 9[1004,Timestamp('2013-01-0500:00:00'),'Shenzhen','110-C',32,105433.0],11[1005,Timestamp('2013-01-0600:00:00'),'shanghai','210-A',34,12nan],13[1006,Timestamp('2013-01-0700:00:00'),'BEIJING','130-F',32,144432.0]],dtype=object)

查看列名称

Colums函数用来单独查看数据表中的列名称。

1#查看列名称2df.columns34Index(['id','date','city','category','age','price'],dtype='object')

查看前 10 行数据

Head函数用来查看数据表中的前N行数据,默认head()显示前10行数据,可以自己设置参数值来确定查看的行数。下面的代码中设置查看前3行的数据。

1`#查看前3行数据``df.head(``3``)`

df_head(3)

查看后 10 行数据

Tail行数与head函数相反,用来查看数据表中后N行的数据,默认tail()显示后10行数据,可以自己设置参数值来确定查看的行数。下面的代码中设置查看后3行的数据。

1`#查看最后3行``df.tail(``3``)`

df_tail(3)

03 数据表清洗

第三部分是对数据表中的问题进行清洗。主要内容包括对空值,大小写问题,数据格式和重复值的处理。这里不包含对数据间的逻辑验证。

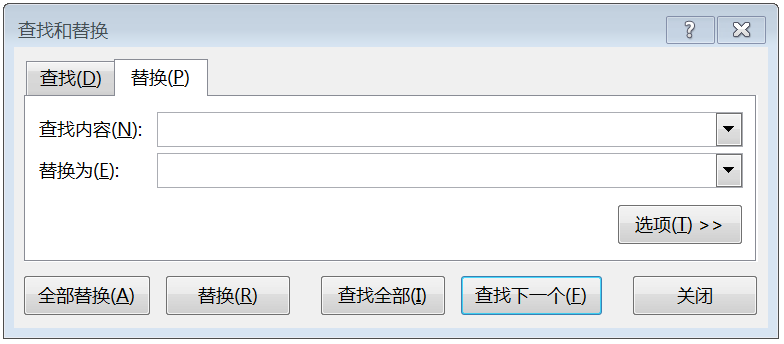

处理空值(删除或填充)

我们在创建数据表的时候在price字段中故意设置了几个NA值。对于空值的处理方式有很多种,可以直接删除包含空值的数据,也可以对空值进行填充,比如用0填充或者用均值填充。还可以根据不同字段的逻辑对空值进行推算。

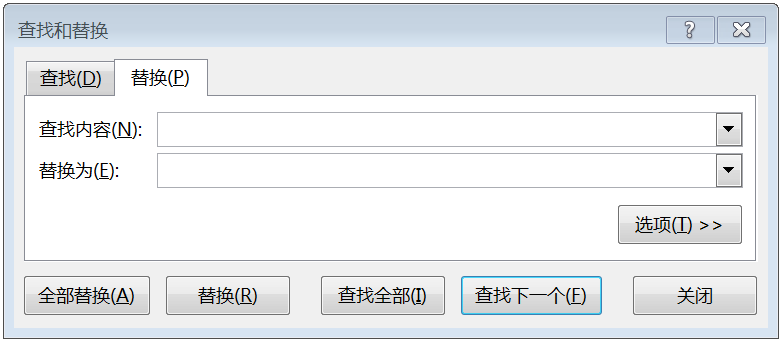

Excel中可以通过“查找和替换”功能对空值进行处理,将空值统一替换为0或均值。也可以通过“定位”空值来实现。

查找和替换空值

Python中处理空值的方法比较灵活,可以使用Dropna函数用来删除数据表中包含空值的数据,也可以使用fillna函数对空值进行填充。下面的代码和结果中可以看到使用dropna函数后,包含NA值的两个字段已经不见了。返回的是一个不包含空值的数据表。

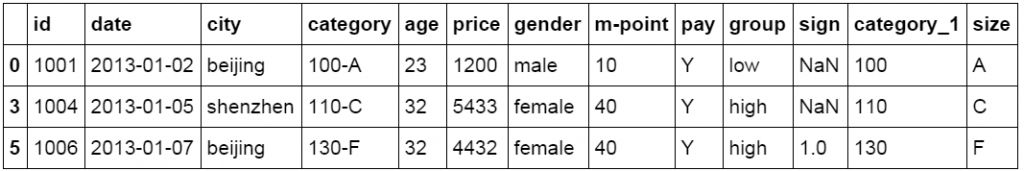

1#删除数据表中含有空值的行2df.dropna(how='any')

df_dropna

除此之外也可以使用数字对空值进行填充,下面的代码使用fillna函数对空值字段填充数字0。

1#使用数字0填充数据表中空值2df.fillna(value=0)

我们选择填充的方式来处理空值,使用 price 列的均值来填充 NA 字段,同样使用 fillna 函数,在要填充的数值中使用 mean 函数先计算 price 列当前的均值,然后使用这个均值对 NA 进行填充。可以看到两个空值字段显示为3299.5

1#使用price均值对NA进行填充 2df['price'].fillna(df['price'].mean()) 3 401200.0 513299.5 622133.0 735433.0 843299.5 954432.010Name:price,dtype:float64

df_nan

清理空格

除了空值,字符中的空格也是数据清洗中一个常见的问题,下面是清除字符中空格的代码。

1#清除city字段中的字符空格2df['city']=df['city'].map(str.strip)

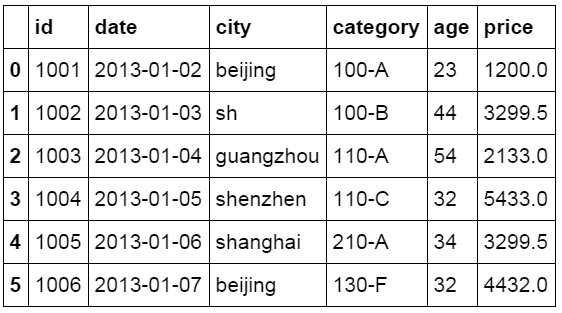

大小写转换

在英文字段中,字母的大小写不统一也是一个常见的问题。Excel中有UPPER,LOWER等函数,python中也有同名函数用来解决大小写的问题。在数据表的city列中就存在这样的问题。我们将city列的所有字母转换为小写。下面是具体的代码和结果。

1#city列大小写转换2df['city']=df['city'].str.lower()

lower

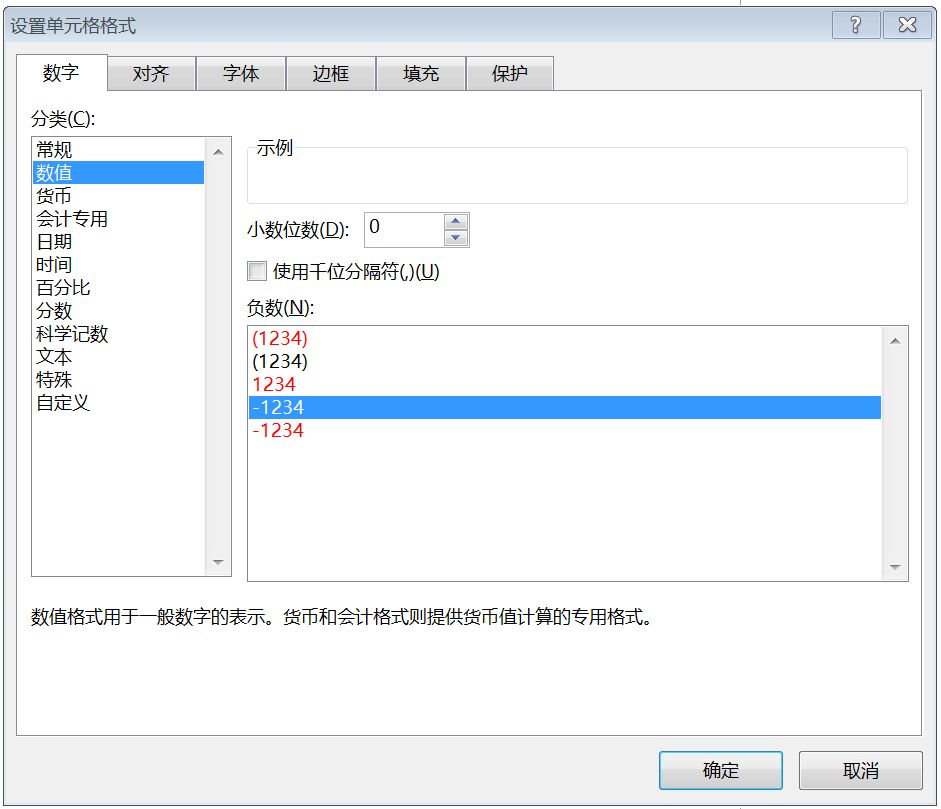

更改数据格式

Excel中通过“设置单元格格式”功能可以修改数据格式。Python中通过astype函数用来修改数据格式。

设置单元格格式

Python中dtype是查看数据格式的函数,与之对应的是astype函数,用来更改数据格式。下面的代码中将price字段的值修改为int格式。

1#更改数据格式 2df['price'].astype('int') 3 401200 513299 622133 735433 843299 95443210Name:price,dtype:int32

更改列名称

Rename是更改列名称的函数,我们将来数据表中的category列更改为category-size。下面是具体的代码和更改后的结果。

1#更改列名称2df.rename(columns={'category':'category-size'})

df_rename

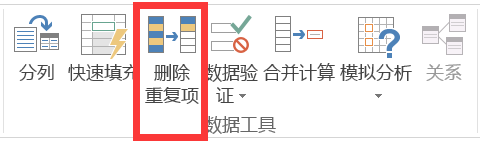

删除重复值

很多数据表中还包含重复值的问题,Excel的数据目录下有“删除重复项”的功能,可以用来删除数据表中的重复值。默认Excel会保留最先出现的数据,删除后面重复出现的数据。

删除重复项

Python中使用drop_duplicates函数删除重复值。我们以数据表中的city列为例,city字段中存在重复值。默认情况下drop_duplicates()将删除后出现的重复值(与excel逻辑一致)。增加keep=’last’参数后将删除最先出现的重复值,保留最后的值。下面是具体的代码和比较结果。

原始的city列中beijing存在重复,分别在第一位和最后一位。

1df['city']20beijing31sh42guangzhou53shenzhen64shanghai75beijing8Name:city,dtype:object

使用默认的drop_duplicates()函数删除重复值,从结果中可以看到第一位的beijing被保留,最后出现的beijing被删除。

1#删除后出现的重复值2df['city'].drop_duplicates()30beijing41sh52guangzhou63shenzhen74shanghai8Name:city,dtype:object

设置keep=’last‘’参数后,与之前删除重复值的结果相反,第一位出现的beijing被删除,保留了最后一位出现的beijing。

1#删除先出现的重复值2df['city'].drop_duplicates(keep='last')31sh42guangzhou53shenzhen64shanghai75beijing8Name:city,dtype:objec

数值修改及替换

数据清洗中最后一个问题是数值修改或替换,Excel中使用“查找和替换”功能就可以实现数值的替换。

查找和替换空值

Python中使用replace函数实现数据替换。数据表中city字段上海存在两种写法,分别为shanghai和SH。我们使用replace函数对SH进行替换。

1#数据替换2df['city'].replace('sh','shanghai')30beijing41shanghai52guangzhou63shenzhen74shanghai85beijing9Name:city,dtype:object

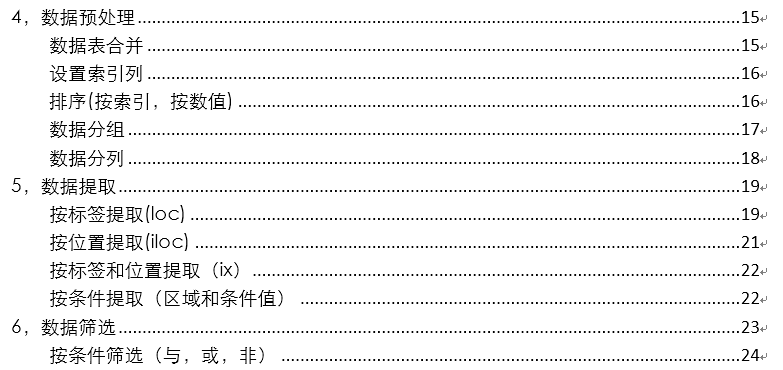

本篇文章这是系列的第二篇,介绍第4-6部分的内容,数据表生成,数据表查看,和数据清洗。

4-6 目录

04 数据预处理

第四部分是数据的预处理,对清洗完的数据进行整理以便后期的统计和分析工作。主要包括数据表的合并,排序,数值分列,数据分组及标记等工作。

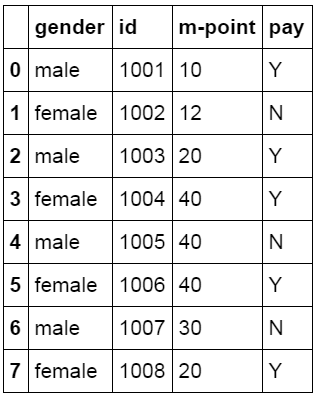

数据表合并

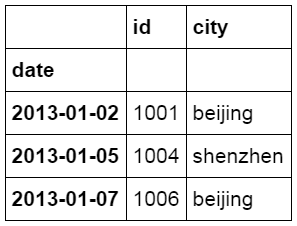

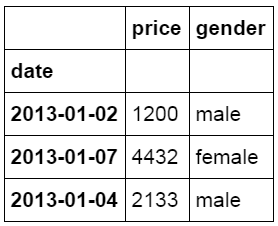

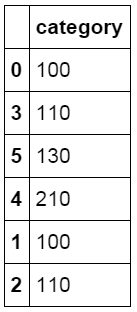

首先是对不同的数据表进行合并,我们这里创建一个新的数据表df1,并将df和df1两个数据表进行合并。在Excel中没有直接完成数据表合并的功能,可以通过VLOOKUP函数分步实现。在python中可以通过merge函数一次性实现。下面建立df1数据表,用于和df数据表进行合并。

1#创建df1数据表2df1=pd.DataFrame({"id":[1001,1002,1003,1004,1005,1006,1007,1008],3"gender":['male','female','male','female','male','female','male','female'],4"pay":['Y','N','Y','Y','N','Y','N','Y',],5"m-point":[10,12,20,40,40,40,30,20]})

df1

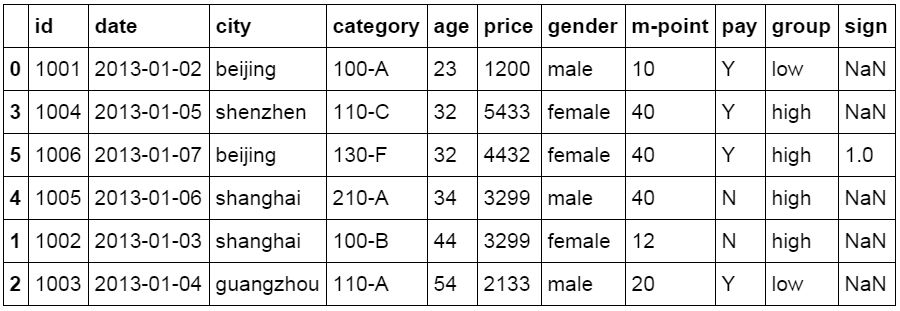

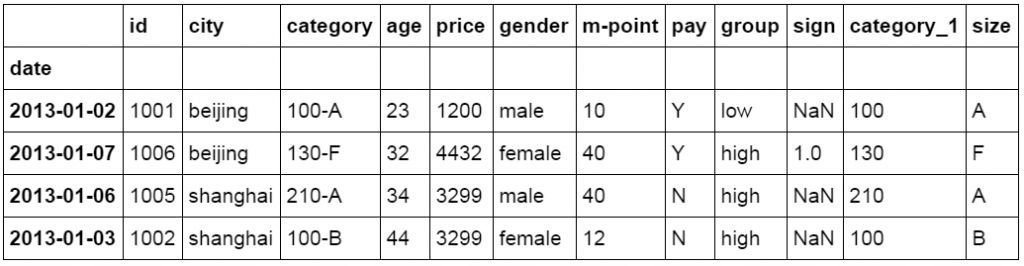

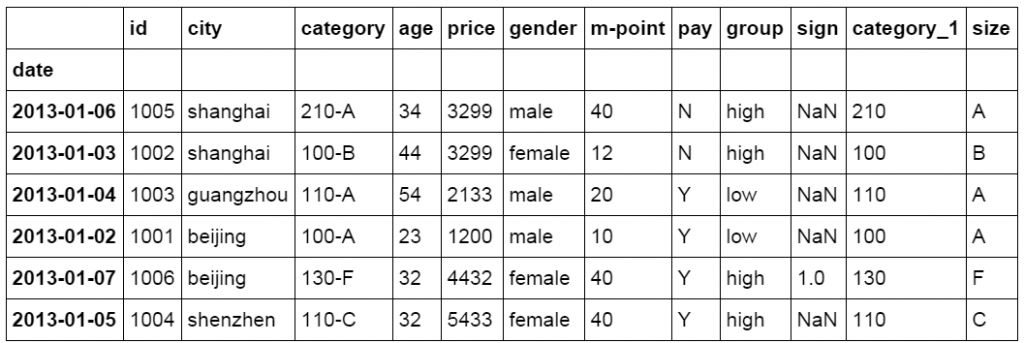

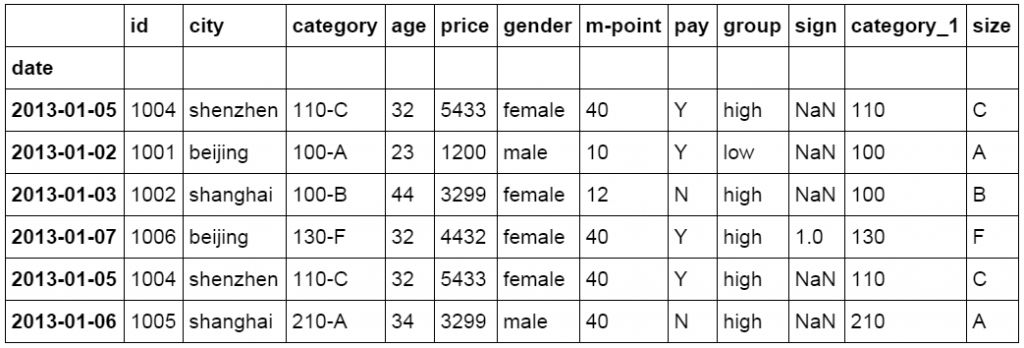

使用merge函数对两个数据表进行合并,合并的方式为inner,将两个数据表中共有的数据匹配到一起生成新的数据表。并命名为df_inner。

1#数据表匹配合并,inner模式2df_inner=pd.merge(df,df1,how='inner')

df_inner

除了inner方式以外,合并的方式还有left,right和outer方式。这几种方式的差别在我其他的文章中有详细的说明和对比。

1#其他数据表匹配模式2df_left=pd.merge(df,df1,how='left')3df_right=pd.merge(df,df1,how='right')4df_outer=pd.merge(df,df1,how='outer')

设置索引列

完成数据表的合并后,我们对df_inner数据表设置索引列,索引列的功能很多,可以进行数据提取,汇总,也可以进行数据筛选等。设置索引的函数为set_index。

1#设置索引列2df_inner.set_index('id')

df_inner_set_index

排序(按索引,按数值)

Excel中可以通过数据目录下的排序按钮直接对数据表进行排序,比较简单。Python中需要使用ort_values函数和sort_index函数完成排序。

排序

在python中,既可以按索引对数据表进行排序,也可以看制定列的数值进行排序。首先我们按age列中用户的年龄对数据表进行排序。使用的函数为sort_values。

1#按特定列的值排序2df_inner.sort_values(by=['age'])

sort_values

Sort_index函数用来将数据表按索引列的值进行排序。

1#按索引列排序2df_inner.sort_index()

sort_index

数据分组

Excel中可以通过VLOOKUP函数进行近似匹配来完成对数值的分组,或者使用“数据透视表”来完成分组。相应的python中使用where函数完成数据分组。

Where函数用来对数据进行判断和分组,下面的代码中我们对price列的值进行判断,将符合条件的分为一组,不符合条件的分为另一组,并使用group字段进行标记。

1#如果price列的值>3000,group列显示high,否则显示low2df_inner['group']=np.where(df_inner['price']>3000,'high','low')

where

除了where函数以外,还可以对多个字段的值进行判断后对数据进行分组,下面的代码中对city列等于beijing并且price列大于等于4000的数据标记为1。

1#对复合多个条件的数据进行分组标记2df_inner.loc[(df_inner['city']=='beijing')&(df_inner['price']>=4000),'sign']=1

sign

数据分列

与数据分组相反的是对数值进行分列,Excel中的数据目录下提供“分列”功能。在python中使用split函数实现分列。

数据分列

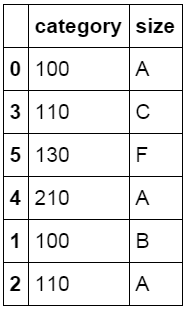

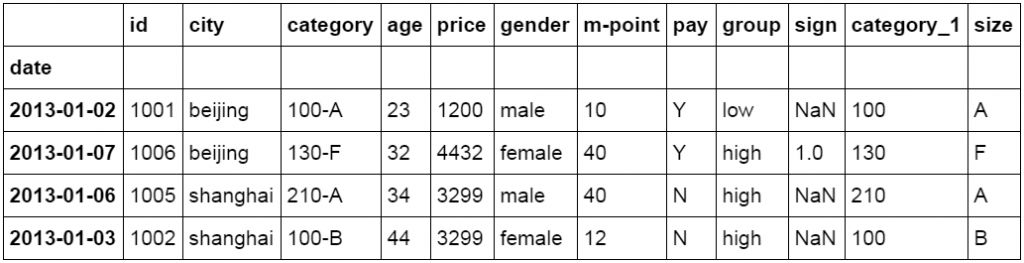

在数据表中category列中的数据包含有两个信息,前面的数字为类别id,后面的字母为size值。中间以连字符进行连接。我们使用split函数对这个字段进行拆分,并将拆分后的数据表匹配回原数据表中。

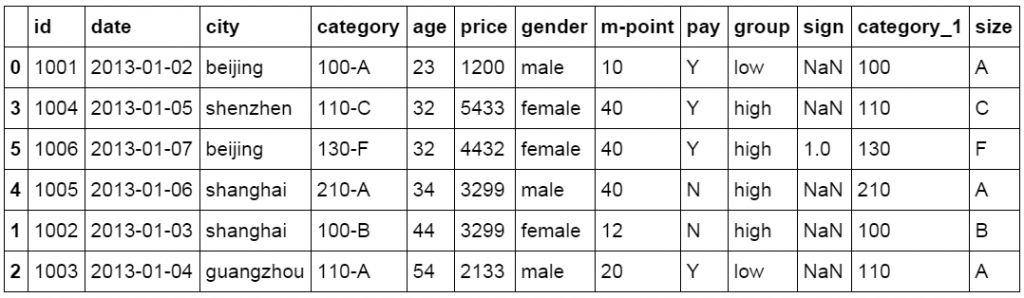

1#对category字段的值依次进行分列,并创建数据表,索引值为df_inner的索引列,列名称为category和size2pd.DataFrame((x.split('-')forxindf_inner['category']),index=df_inner.index,columns=['category','size']) split1#将完成分列后的数据表与原 df_inner 数据表进行匹配2df_inner=pd.merge(df_inner,split,right_index=True, left_index=True)

split1#将完成分列后的数据表与原 df_inner 数据表进行匹配2df_inner=pd.merge(df_inner,split,right_index=True, left_index=True)

merge_1

05 数据提取

第五部分是数据提取,也是数据分析中最常见的一个工作。这部分主要使用三个函数,loc,iloc和ix,loc函数按标签值进行提取,iloc按位置进行提取,ix可以同时按标签和位置进行提取。下面介绍每一种函数的使用方法。

按标签提取(loc)

Loc函数按数据表的索引标签进行提取,下面的代码中提取了索引列为3的单条数据。

1#按索引提取单行的数值 2df_inner.loc[3] 3id1004 4date2013-01-0500:00:00 5cityshenzhen 6category110-C 7age32 8price5433 9genderfemale10m-point4011payY12grouphigh13signNaN14category_111015sizeC16Name:3,dtype:object

使用冒号可以限定提取数据的范围,冒号前面为开始的标签值,后面为结束的标签值。下面提取了0到5的数据行。

1#按索引提取区域行数值2df_inner.loc[0:5]

df_inner_loc1

Reset_index函数用于恢复索引,这里我们重新将date字段的日期设置为数据表的索引,并按日期进行数据提取。

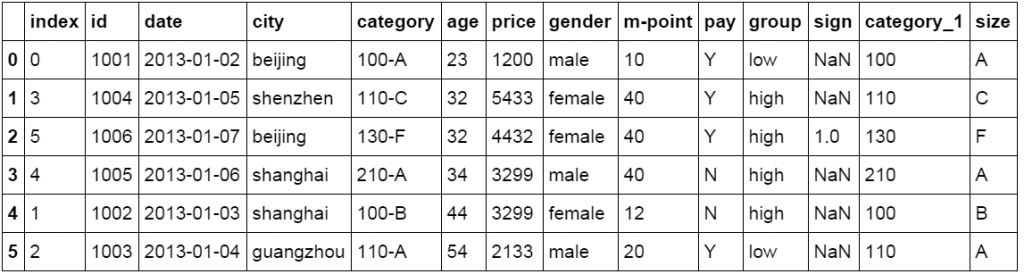

1#重设索引2df_inner.reset_index()

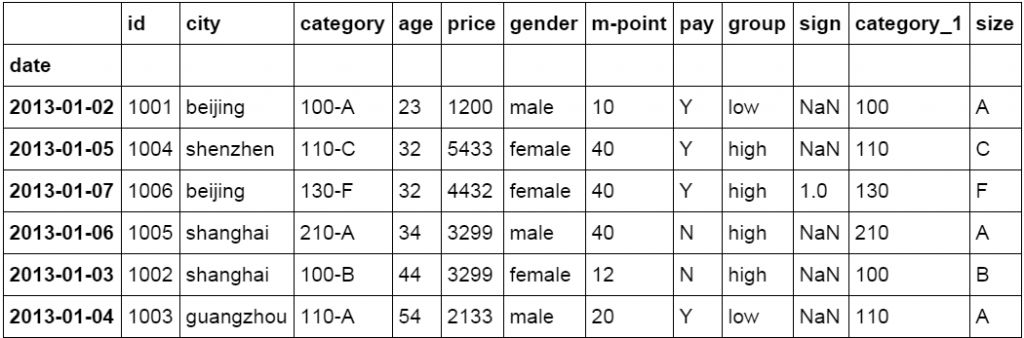

reset_index1#设置日期为索引2df_inner=df_inner.set_index('date')

set_index_date

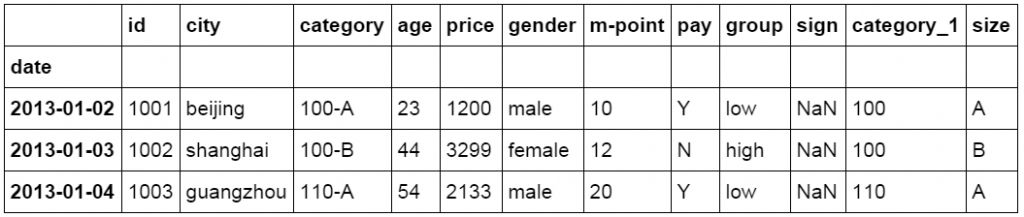

使用冒号限定提取数据的范围,冒号前面为空表示从0开始。提取所有2013年1月4日以前的数据。

1#提取4日之前的所有数据2df_inner[:'2013-01-04']

按提起提取

按位置提取(iloc)

使用iloc函数按位置对数据表中的数据进行提取,这里冒号前后的数字不再是索引的标签名称,而是数据所在的位置,从0开始。

1#使用iloc按位置区域提取数据2df_inner.iloc[:3,:2]

iloc1

iloc函数除了可以按区域提取数据,还可以按位置逐条提取,前面方括号中的0,2,5表示数据所在行的位置,后面方括号中的数表示所在列的位置。

1#使用iloc按位置单独提取数据2df_inner.iloc[[0,2,5],[4,5]]

iloc2

按标签和位置提取(ix)

ix是loc和iloc的混合,既能按索引标签提取,也能按位置进行数据提取。下面代码中行的位置按索引日期设置,列按位置设置。

1#使用ix按索引标签和位置混合提取数据2df_inner.ix[:'2013-01-03',:4]

ix

按条件提取(区域和条件值)

除了按标签和位置提起数据以外,还可以按具体的条件进行数据。下面使用loc和isin两个函数配合使用,按指定条件对数据进行提取。

使用isin函数对city中的值是否为beijing进行判断。

1#判断city列的值是否为beijing 2df_inner['city'].isin(['beijing']) 3 4date 52013-01-02True 62013-01-05False 72013-01-07True 82013-01-06False 92013-01-03False102013-01-04False11Name:city,dtype:bool

将isin函数嵌套到loc的数据提取函数中,将判断结果为Ture数据提取出来。这里我们把判断条件改为city值是否为beijing和shanghai。如果是就把这条数据提取出来。

1#先判断city列里是否包含beijing和shanghai,然后将复合条件的数据提取出来。2df_inner.loc[df_inner['city'].isin(['beijing','shanghai'])]

loc 按筛选条件提取

数值提取还可以完成类似数据分列的工作,从合并的数值中提取出制定的数值。

1category=df_inner['category'] 20100-A 33110-C 45130-F 54210-A 61100-B 72110-A 8Name:category,dtype:object 910#提取前三个字符,并生成数据表11pd.DataFrame(category.str[:3]) category_str

category_str

06 数据筛选

第六部分为数据筛选,使用与,或,非三个条件配合大于,小于和等于对数据进行筛选,并进行计数和求和。与excel中的筛选功能和countifs和sumifs功能相似。

按条件筛选(与,或,非)

Excel数据目录下提供了“筛选”功能,用于对数据表按不同的条件进行筛选。Python中使用loc函数配合筛选条件来完成筛选功能。配合sum和count函数还能实现excel中sumif和countif函数的功能。

筛选

使用“与”条件进行筛选,条件是年龄大于25岁,并且城市为beijing。筛选后只有一条数据符合要求。

1#使用“与”条件进行筛选2df_inner.loc[(df_inner['age']>25)&(df_inner['city']=='beijing'),['id','city','age','category','gender']]

与

使用“或”条件进行筛选,年龄大于25岁或城市为beijing。筛选后有6条数据符合要求。

1#使用“或”条件筛选2df_inner.loc[(df_inner['age']>25)|(df_inner['city']=='beijing'),['id','city','age','category','gender']].sort3(['age'])

或

在前面的代码后增加price字段以及sum函数,按筛选后的结果将price字段值进行求和,相当于excel中sumifs的功能。

1#对筛选后的数据按price字段进行求和2df_inner.loc[(df_inner['age']>25)|(df_inner['city']=='beijing'),3['id','city','age','category','gender','price']].sort(['age']).price.sum()4519796

使用“非”条件进行筛选,城市不等于beijing。符合条件的数据有4条。将筛选结果按id列进行排序。

1#使用“非”条件进行筛选2df_inner.loc[(df_inner['city']!='beijing'),['id','city','age','category','gender']].sort(['id'])

非

在前面的代码后面增加city列,并使用count函数进行计数。相当于excel中的countifs函数的功能。

1#对筛选后的数据按city列进行计数2df_inner.loc[(df_inner['city']!='beijing'),['id','city','age','category','gender']].sort(['id']).city.count()34

还有一种筛选的方式是用query函数。下面是具体的代码和筛选结果。

1#使用query函数进行筛选2df_inner.query('city==["beijing","shanghai"]')

query

在前面的代码后增加price字段和sum函数。对筛选后的price字段进行求和,相当于excel中的sumifs函数的功能。

1#对筛选后的结果按price进行求和2df_inner.query('city==["beijing","shanghai"]').price.sum()312230

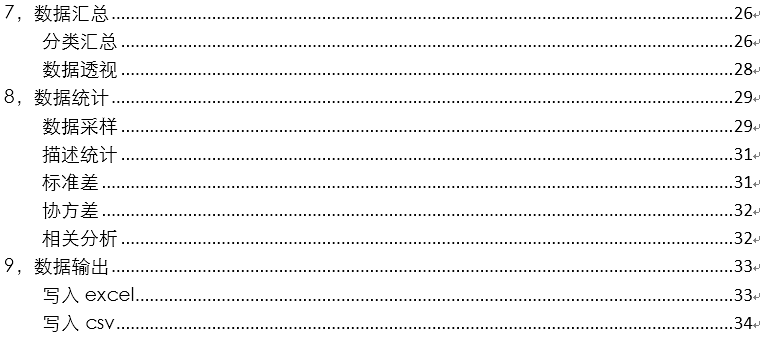

这是第三篇,介绍第7-9部分的内容,数据汇总,数据统计,和数据输出。

7-9 目录

07 数据汇总

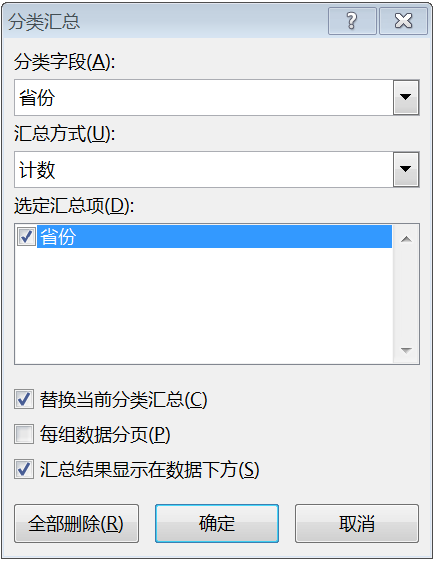

第七部分是对数据进行分类汇总,Excel中使用分类汇总和数据透视可以按特定维度对数据进行汇总,python中使用的主要函数是groupby和pivot_table。下面分别介绍这两个函数的使用方法。

分类汇总

Excel的数据目录下提供了“分类汇总”功能,可以按指定的字段和汇总方式对数据表进行汇总。Python中通过Groupby函数完成相应的操作,并可以支持多级分类汇总。

分类汇总 1

Groupby是进行分类汇总的函数,使用方法很简单,制定要分组的列名称就可以,也可以同时制定多个列名称,groupby按列名称出现的顺序进行分组。同时要制定分组后的汇总方式,常见的是计数和求和两种。

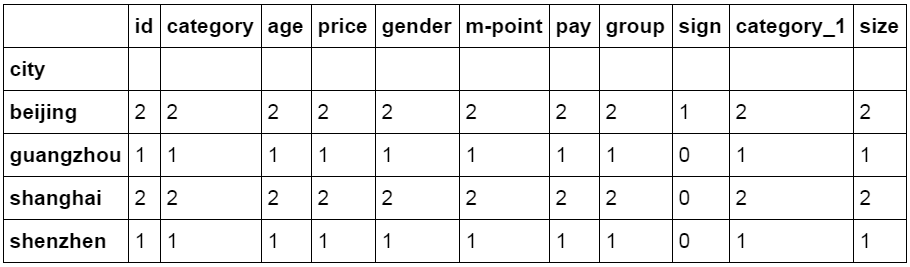

1#对所有列进行计数汇总2df_inner.groupby('city').count()

groupby

可以在groupby中设置列名称来对特定的列进行汇总。下面的代码中按城市对id字段进行汇总计数。

1#对特定的ID列进行计数汇总2df_inner.groupby('city')['id'].count()3city4beijing25guangzhou16shanghai27shenzhen18Name:id,dtype:int64

在前面的基础上增加第二个列名称,分布对city和size两个字段进行计数汇总。

1#对两个字段进行汇总计数 2df_inner.groupby(['city','size'])['id'].count() 3citysize 4beijingA1 5F1 6guangzhouA1 7shanghaiA1 8B1 9shenzhenC110Name:id,dtype:int64

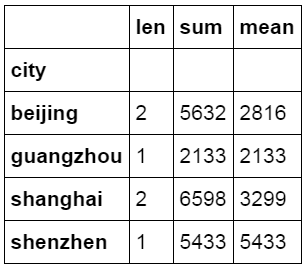

除了计数和求和外,还可以对汇总后的数据同时按多个维度进行计算,下面的代码中按城市对price字段进行汇总,并分别计算price的数量,总金额和平均金额。

1#对city字段进行汇总并计算price的合计和均值。2df_inner.groupby('city')['price'].agg([len,np.sum,np.mean])

groupby1

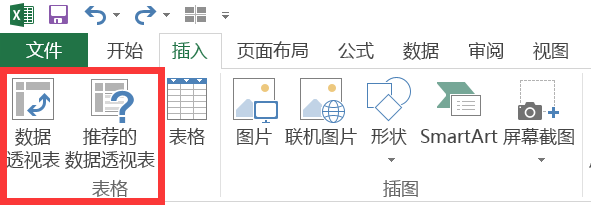

数据透视

Excel中的插入目录下提供“数据透视表”功能对数据表按特定维度进行汇总。Python中也提供了数据透视表功能。通过pivot_table函数实现同样的效果。

数据透视

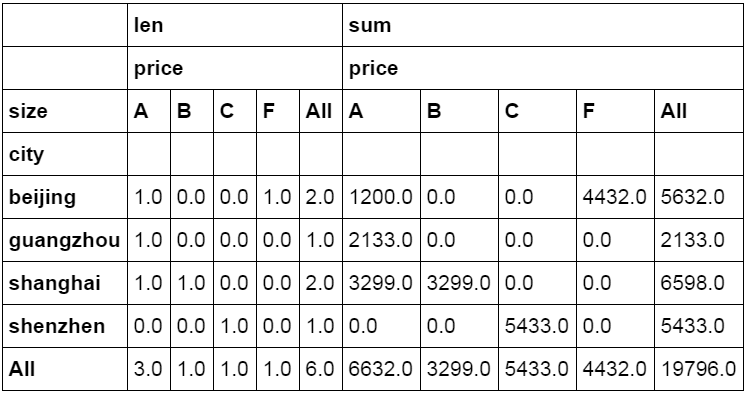

数据透视表也是常用的一种数据分类汇总方式,并且功能上比groupby要强大一些。下面的代码中设定city为行字段,size为列字段,price为值字段。分别计算price的数量和金额并且按行与列进行汇总。

1#数据透视表2pd.pivot_table(df_inner,index=["city"],values=["price"],columns=["size"],aggfunc=[len,np.sum],fill_value=0,margins=True)

pivot_table

08 数据统计

第九部分为数据统计,这里主要介绍数据采样,标准差,协方差和相关系数的使用方法。

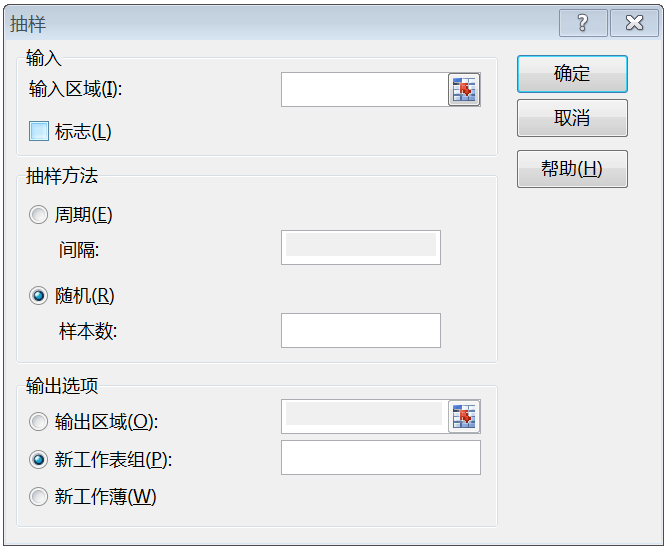

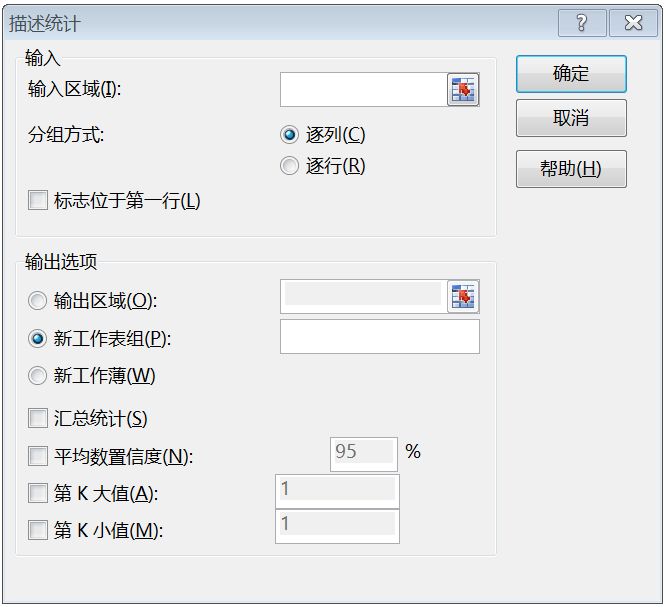

数据采样

Excel的数据分析功能中提供了数据抽样的功能,如下图所示。Python通过sample函数完成数据采样。

数据抽样

Sample是进行数据采样的函数,设置n的数量就可以了。函数自动返回参与的结果。

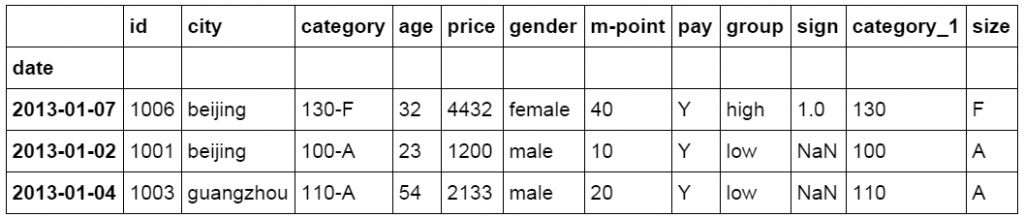

1#简单的数据采样2df_inner.sample(n=3)

简单随机采样

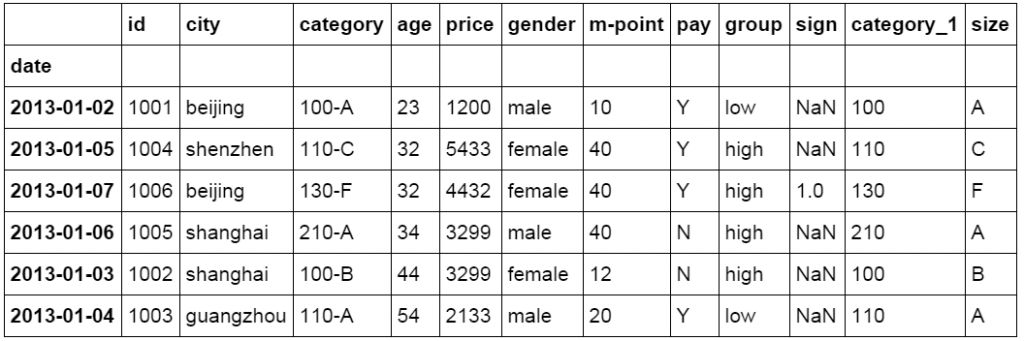

Weights参数是采样的权重,通过设置不同的权重可以更改采样的结果,权重高的数据将更有希望被选中。这里手动设置6条数据的权重值。将前面4个设置为0,后面两个分别设置为0.5。

1#手动设置采样权重2weights=[0,0,0,0,0.5,0.5]3df_inner.sample(n=2,weights=weights)

手动设置采样权重 1

从采样结果中可以看出,后两条权重高的数据被选中。

手动设置采样权重 2

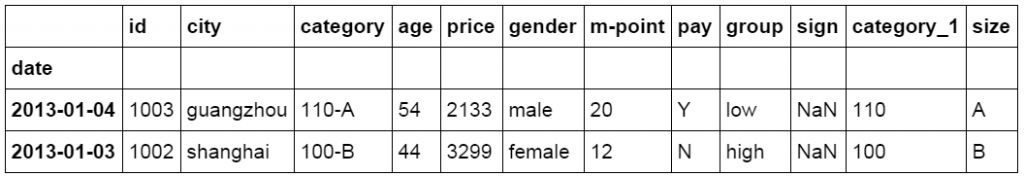

Sample函数中还有一个参数replace,用来设置采样后是否放回。

1#采样后不放回2df_inner.sample(n=6,replace=False)

采样后不放回1#采样后放回2df_inner.sample(n=6,replace=True)

采样后放回

描述统计

Excel中的数据分析中提供了描述统计的功能。Python中可以通过Describe对数据进行描述统计。

描述统计

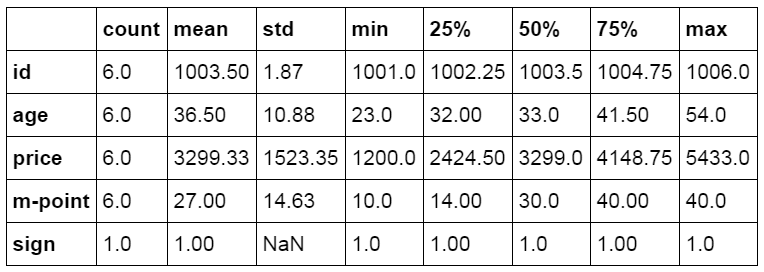

Describe函数是进行描述统计的函数,自动生成数据的数量,均值,标准差等数据。下面的代码中对数据表进行描述统计,并使用round函数设置结果显示的小数位。并对结果数据进行转置。

1#数据表描述性统计2df_inner.describe().round(2).T

describe

标准差Python中的Std函数用来接算特定数据列的标准差。

1#标准差2df_inner['price'].std()31523.3516556155596

协方差Excel中的数据分析功能中提供协方差的计算,python中通过cov函数计算两个字段或数据表中各字段间的协方差。

协方差

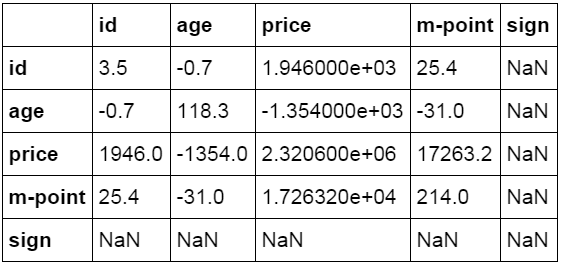

Cov函数用来计算两个字段间的协方差,可以只对特定字段进行计算,也可以对整个数据表中各个列之间进行计算。

1#两个字段间的协方差2df_inner['price'].cov(df_inner['m-point'])317263.200000000001

cov

相关分析Excel的数据分析功能中提供了相关系数的计算功能,python中则通过corr函数完成相关分析的操作,并返回相关系数。

相关系数

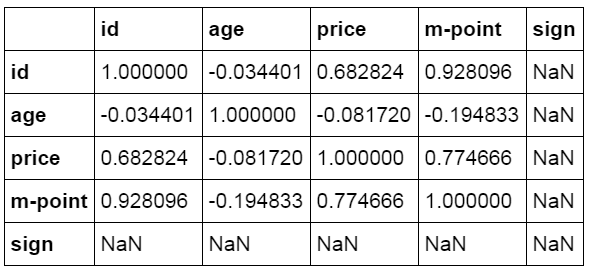

Corr函数用来计算数据间的相关系数,可以单独对特定数据进行计算,也可以对整个数据表中各个列进行计算。相关系数在-1到1之间,接近1为正相关,接近-1为负相关,0为不相关。

1#相关性分析2df_inner['price'].corr(df_inner['m-point'])30.7746655561708526445#数据表相关性分析6df_inner.corr()

corr

09 数据输出

第九部分是数据输出,处理和分析完的数据可以输出为xlsx格式和csv格式。

写入 excel

1#输出到excel格式2df_inner.to_excel('excel_to_python.xlsx',sheet_name='bluewhale_cc')

excel

写入 csv

1#输出到CSV格式2df_inner.to_csv('excel_to_python.csv')

在数据处理的过程中,大部分基础工作是重复和机械的,对于这部分基础工作,我们可以使用自定义函数进行自动化。以下简单介绍对数据表信息获取自动化处理。

1#创建数据表 2df=pd.DataFrame({"id":[1001,1002,1003,1004,1005,1006], 3"date":pd.date_range('20130102',periods=6), 4"city":['Beijing','SH','guangzhou','Shenzhen','shanghai','BEIJING'], 5"age":[23,44,54,32,34,32], 6"category":['100-A','100-B','110-A','110-C','210-A','130-F'], 7"price":[1200,np.nan,2133,5433,np.nan,4432]}, 8columns=['id','date','city','category','age','price']) 910#创建自定义函数11deftable_info(x):12shape=x.shape13types=x.dtypes14colums=x.columns15print("数据维度(行,列):",shape)16print("数据格式:",types)17print("列名称:",colums)1819#调用自定义函数获取df数据表信息并输出结果20table_info(df)2122数据维度(行,列):23(6,6)24数据格式:25idint6426datedatetime64[ns]27cityobject28categoryobject29ageint6430pricefloat6431dtype:object32列名称:33Index(['id','date','city','category','age','price'],dtype='object')

以上就是用Python做数据分析的基本内容。

-

函数

+关注

关注

3文章

3863浏览量

61304 -

数据处理

+关注

关注

0文章

506浏览量

28246 -

python

+关注

关注

51文章

4669浏览量

83457

发布评论请先 登录

相关推荐

Microsoft Excel 2000中文版介绍

常用10款数据分析编程语言

怎么有效学习Python数据分析?

关于《Python编程入门系列教程》说明及教程汇总

成为Python数据分析师,需要掌握哪些技能

成为Python数据分析师,需要掌握哪些技能

基于MatrixVB光电实验数据处理

如何使用Python通过函数式编程完成excel中的数据处理及分析工作

如何使用Python通过函数式编程完成excel中的数据处理及分析工作

评论