有几十个工程师挤在美国德州奥斯汀(Austin)近郊重划区的咖啡店与美容院之间,探索运算技术的新方向──这是一家名为Mythic的新创公司,目标是将神经网络映射至NOR快闪存储器阵列,以或许可节省两个数量等级功耗的方式来运算与储存资料。

如果他们成功了,这家新创公司就可跳过来自诸如英特尔(Intel)或是其他IP供应商、以及众多富裕中国新创公司的数位处理器与核心;这些处理器的目标都是进驻下一代保全摄影机、无人机、工厂设备等试图搭上人工智慧(AI)热潮的嵌入式系统,甚至是未来的自动驾驶车辆。

「我们从研究所的时候就知道,混合讯号处理很适合这类应用;」与同事Mike Henry在密西根大学(University of Michigan)一起创立Mythic的David Fick表示:「你需要利用其可调阈值电压来储存很大的资料量与快闪存储器──每个晶体管都非常具吸引力。」

Mythic所开发的快闪存储器阵列,基本上可免除将资料从外部存储器移出移入的需要,因此大幅节省功耗;Fick表示,他的指导教授David Blaauw与Dennis Sylvester「已经展开一些快闪存储器研究,我们也拥有一些专长技术,因此能很轻易地加速启动一个项目。」

不过要在存储器中执行类比处理器这种有数十年历史的老概念是件棘手任务,Fick表示:「你必须考量很多类比效应──不匹配(mismath)、噪声、温度,而且存储器单元也有很多类似的显著效应;」不同于配备经过妥善定义之存储器、处理与储存子系统的数位计算机,机器学习使用的类比计算机基本上是一个整合性的庞大工程。

「你需要同时一起设计所有的东西,因此需要了解重叠领域的人,例如了解彼此领域的元件端设计与神经网络设计工程师;」Fick解释:「我们在这方面已经远胜于其他人,因为我们拥有一个可以完成整个任务的超强团队。」

确实,这家公司才刚完成B轮融资、获得一笔高达5,000万美元的资金,有部分原因是他们拥有一个总监等级(director-level)专家组成的多元团队,包括来自德州仪器(TI)的类比专家、Microchip的快闪存储器设计总监,以及Netronome的实体设计专家。

Mythic也藉由实现一系列的原型投片逐步展现其技术进展赢得投资者青睐,Fick在学校里的VLSI设计表现就赢得不少声誉;他表示:「当你以研究所学生身份设计芯片,包括存储器、合成、设计规则检查变异(DRC variations)…等所有的步骤都得自己动手;而如果你是直接进入业界,你可能永远看不到整个设计流程,所以很多从学校独立的新创公司会更容易成功量产。」

这家公司的两个创办人从小就是「科技宅男」(geek);Fick在高中时的第一份工作就是网页开发工程师,念研究所时则进入AMD、IBM与Intel等多家大公司当实习生。Henry则是为了好玩,很爱参加各种快速写程序竞赛。

大大小小的竞争对手以及需要克服的软件障碍

这些日子以来,Mythic的二人组遇到大大小小的竞争对手,至少有40家老牌与新创IP供应商或芯片业者,纷纷表示准备推出或是正在规划某种形式的客户端AI加速器芯片;这些竞争对手还包括中国几家财力雄厚的新创公司,例如地平线(Horizon Robotics)就是其中最具潜力的一家,已经用较传统的数位架构推出低功耗客户端AI加速器。

还有一家美国新创公司Syntiant,跟Mythic一样在开发利用快闪存储器的存储器内处理器(processor-in-memory)架构,该公司的团队成员包括几位Broadcom前任工程经理,并获得了Intel Capital的支持。此外IBM Research也正在研究以电阻式RAM (ReRAM)为基础的机器学习加速器,但Fick认为该公司采用了错误的方法。

他表示:「他们正在尝试以完美的存储器来让所有事情变得简单,但我们是透过共同设计所有东西取得领先…就算他们找到了理想存储器,总是会有一种不太完美的存储器可以支援更低功耗或是更快速度。」

创新的平行存储器在历史上总因为太难编程而失败,新兴的存储器内处理器芯片肯定也会面临相同的问题,因为机器学习本身需要全新的、仍在发展的编程模型。Mythic的工具虽名为开发平台,但扮演的角色象是编译器,能为其芯片将TensorFlow数据库内描述的神经网络转换为机器语言。

Fick表示,该开发平台采用PCI Express与芯片连结,能提供「如何从芯片取得额外性能的提示,以及一些常见应用的最佳化网络范例。」想要使用TensorFlow以外其他框架的客户,显然会需要使用ONNX格式来转译其任务;ONNX (Open Neural Network Exchange)是少数几种用来转译几个不同AI软件架构的新兴工具之一。

而Fick也充分体认到他的客户所面临之软件障碍:「为了进入这个领域,你需要聘请几个深度学习科学家,但这类专家因为非常短缺、费用也非常昂贵 …建立资料集与神经网络并进行训练非常耗时、代价也很高…这些都是冒险进军且投资此领域的限制。」

好消息是,与竞争对手方案相较,Mythic芯片的存储器阵列应该能处理更多样化的卷积(convolutional)或归递(recurrent)神经网络,而且其性能的提升可望实现在功耗受限制的边缘系统执行更复杂模型。

Mythic有几个重量级合作伙伴,例如洛克希德马丁(Lockheed Martin)希望未来的无人机能使用该公司芯片,富士通(Fujitus)则是该公司的快闪存储器供应商。到目前为止,有两种应用似乎超出其能力范围,一个是预算只有几美元的智慧音箱,与Mythic的目标应用相较太过需要控制成本;另一个是自动驾驶车辆,因为需要车用等级规格,是该公司目前无法负担的。

这家新创公司预计在今年底推出40奈米制程芯片,这个节点可支援嵌入式快闪存储器单元设计,也符合低成本目标。Fick指出,其快闪存储器单元已通过28奈米制程质量认证,这会是该公司的下一步;在那之后,晶圆代工业者正在开发嵌入式MRAN与ReRAM单元。

Fick表示:「没有任何理由能阻止我们前进最小节点,我们能从制程微缩中受益;」而如果Mythic成功了,并不会是因为摩尔定律(Moore’s Law)或是那些数位处理器使他们受到欢迎,而会是因为他们将运算技术推往一个全新的方向。

-

神经网络

+关注

关注

42文章

4558浏览量

98607 -

快闪存储器

+关注

关注

0文章

15浏览量

11134

发布评论请先 登录

相关推荐

FPGA在深度学习应用中或将取代GPU

详解深度学习、神经网络与卷积神经网络的应用

《 AI加速器架构设计与实现》+第一章卷积神经网络观后感

STM32F7系统架构和存储器映射

人工神经网络和bp神经网络的区别

cnn卷积神经网络模型 卷积神经网络预测模型 生成卷积神经网络模型

卷积神经网络和深度神经网络的优缺点 卷积神经网络和深度神经网络的区别

卷积神经网络是什么?卷积神经网络的工作原理和应用

卷积神经网络算法代码matlab

卷积神经网络的基本原理 卷积神经网络发展 卷积神经网络三大特点

卷积神经网络原理:卷积神经网络模型和卷积神经网络算法

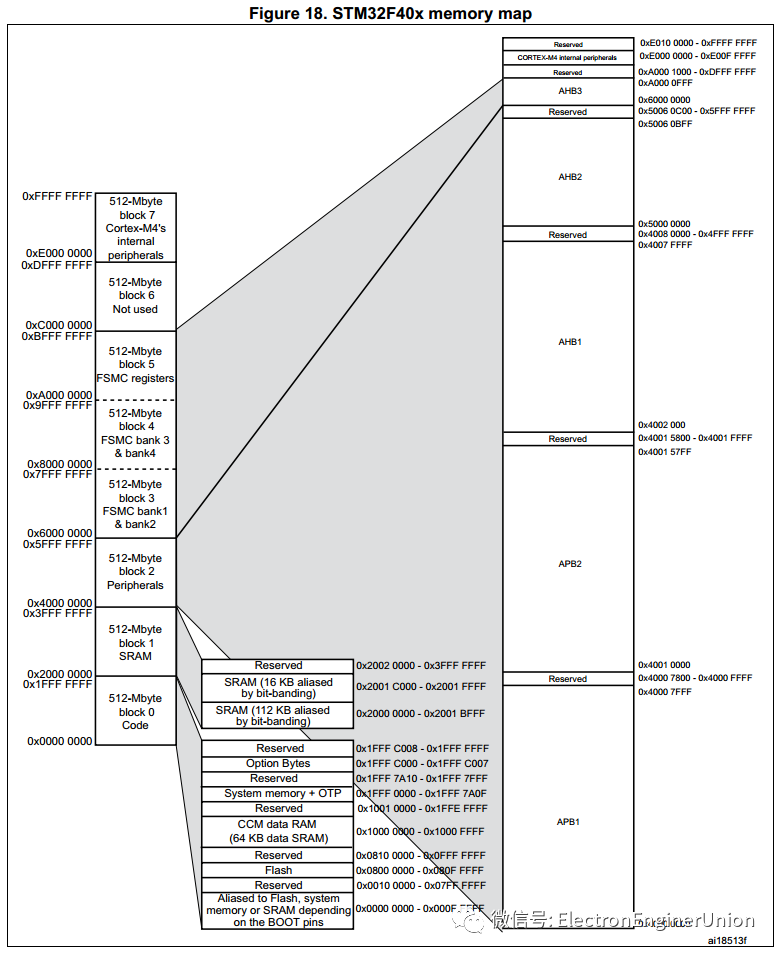

STM32F4存储器映射分析

三个最流行神经网络

将神经网络映射至NOR快闪存储器阵列?国外研究人员正在研究中

将神经网络映射至NOR快闪存储器阵列?国外研究人员正在研究中

评论