思科、Dell Technologies、HPE、浪潮、联想、Supermicro纷纷在今夏推出新系统

NVIDIA和多家全球领先的服务器制造商于今日发布多款内置NVIDIA A100的系统。这些系统具有多种不同的设计和配置,可应对AI、数据科学和科学计算领域最复杂的挑战。

继上月NVIDIA Ampere架构和NVIDIA A100 GPU发布之后,全球顶尖供应商预计将发布超过50款内置A100的服务器,其中包括华硕、Atos、思科、Dell Technologies、富士通、技嘉科技、HPE、浪潮、联想、One Stop Systems、Quanta/QCT和Supermicro。

这些服务器的上市时间各不相同,预计今年夏天将有30款系统上市,到年底将再有20多款系统上市。

NVIDIA副总裁兼加速计算总经理Ian Buck表示:“领先的服务器制造商正在以前所未有的速度将NVIDIA A100 GPU引入到他们的产品中。我们的合作伙伴推出了种类丰富的NVIDIA A100服务器产品,使客户可以作出最佳的选择来加速他们的数据中心,实现高利用率和低总拥有成本。”

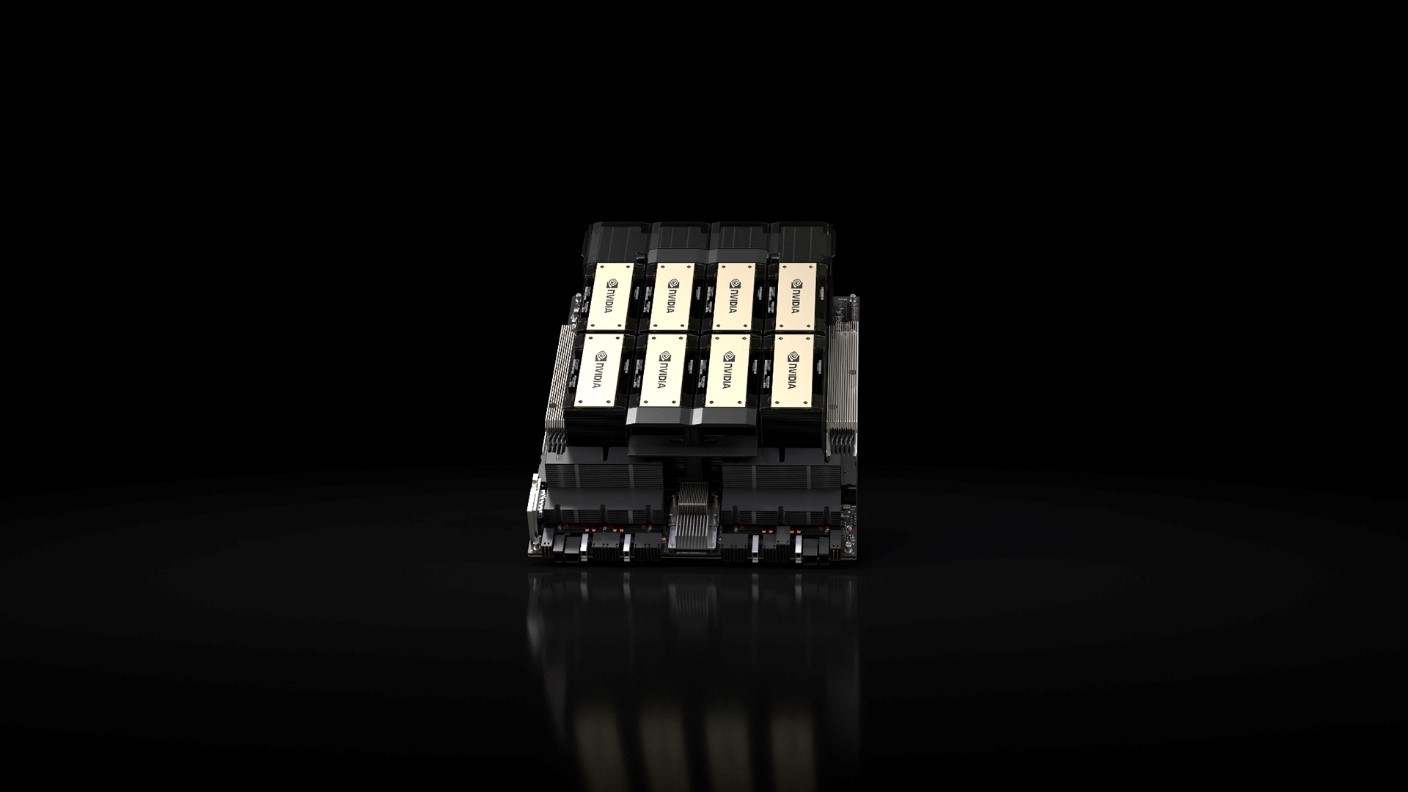

A100是首款基于NVIDIA Ampere架构的GPU,其性能比前代产品提高了多达20倍,是NVIDIA迄今为止性能提升幅度最大的GPU。A100采用多项突破性的技术,比如全新多实例GPU技术可将单个A100分割成最多七个独立的GPU来处理各种计算任务;第三代NVIDIA NVLink技术能将多个GPU组合成一个巨型GPU;全新结构化稀疏功能将GPU的性能提高一倍。

为了补充完善上月发布的四卡和八卡NVIDIA HGX A100配置,NVIDIA还发布了PCIe版本的A100。新增的PCIe版本A100使服务器制造商能够为客户提供丰富的产品组合——从内置单个A100 GPU的系统到内置10个或10个以上GPU的服务器等。这些系统可以为各种计算密集型任务加速,包括用于新药研发的分子动力学模拟、建立更好的按揭贷款审批财务模型等。

以下服务器制造商将为客户提供内置NVIDIA A100的系统:

华硕将推出ESC4000A-E10。每台ESC4000A-E10服务器可配置4个A100 PCIe GPU。

Atos将推出其BullSequana X2415系统,配置有4个NVIDIA A100 Tensor Core GPU。

思科的Cisco Unified Computing System服务器和超融合架构系统Cisco HyperFlex将支持NVIDIA A100 Tensor Core GPU。

Dell Technologies的PowerEdge服务器和解决方案将支持NVIDIA A100 Tensor Core GPU,为从边缘到核心到云的工作负载提供加速,正如它在各种产品中支持其他NVIDIA GPU加速器、软件和技术一样。

富士通将在其PRIMERGY服务器系列中引入A100 GPU。

技嘉科技将发布的G481-HA0、G492-Z50和G492-Z51服务器支持多达10个A100 PCIe GPU,G292-Z40服务器支持多达8个A100 PCIe GPU。

HPE的HPE ProLiant DL380 Gen10服务器将支持A100 PCIe GPU,HPE Apollo 6500 Gen10系统也将依靠A100 PCIe GPU加速HPC和AI工作负载。

浪潮发布了八款内置NVIDIA A100的系统,包括使用A100 PCIe GPU的NF5468M5、NF5468M6和NF5468A5,使用八路NVLink的NF5488M5-D、NF5488A5、NF5488M6和NF5688M6,以及使用十六路NVLink的NF5888M6。

联想的部分系统(包括联想ThinkSystem SR670 AI-ready服务器)将支持A100 PCIe GPU。联想将在今年秋天扩大整个ThinkSystem和ThinkAgile产品系列的供应。

One Stop Systems将为其OSS 4UV Gen 4 PCIe扩展系统提供多达8个NVIDIA A100 PCIe GPU,使AI和HPC客户可以横向扩展他们的Gen 4服务器。

Quanta/QCT将提供多款QuantaGrid服务器系统,支持多达八个NVIDIA A100 PCIe GPU,其中包括D52BV-2U、D43KQ-2U和D52G-4U等。

Supermicro的4U A+ GPU系统将支持多达8个NVIDIA A100 PCIe GPU和2个附加高性能PCI-E 4.0扩展插槽。此外,该系统还支持其他1U、2U和4U GPU服务器。

NVIDIA正在扩展NGC-Ready认证系统产品组合。系统供应商可直接与NVIDIA合作,为内置A100的服务器取得NGC-Ready认证。NGC-Ready认证能够向客户保证,经过认证的系统具有运行AI工作负载所需的性能。

NGC-Ready系统使用来自NVIDIA NGC注册中心的GPU优化AI软件进行测试。该软件可用于数据中心、云端和边缘内置NVIDIA GPU的系统。

NVIDIA A100优化软件现已上市

NVIDIA A100由NVIDIA Ampere优化软件提供支持:包括CUDA 11;50多个CUDA-X库的新版本;多模式对话式AI服务框架NVIDIA Jarvis;深度推荐应用框架 NVIDIA Merlin;RAPIDS开源数据科学软件库套件;NVIDIA HPC SDK,其中内含编译器、库和软件工具,可最大程度地提高开发者的工作效率以及HPC应用的性能和可移植性。

-

NVIDIA

+关注

关注

14文章

4582浏览量

101682 -

服务器

+关注

关注

12文章

8099浏览量

82485 -

数据科学

+关注

关注

0文章

163浏览量

9981

原文标题:ISC 2020 | 全球顶尖系统制造商发布内置NVIDIA A100的服务器,为AI、数据科学和科学计算加速

文章出处:【微信号:NVIDIA_China,微信公众号:NVIDIA英伟达】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

相关推荐

使用NVIDIA Triton推理服务器来加速AI预测

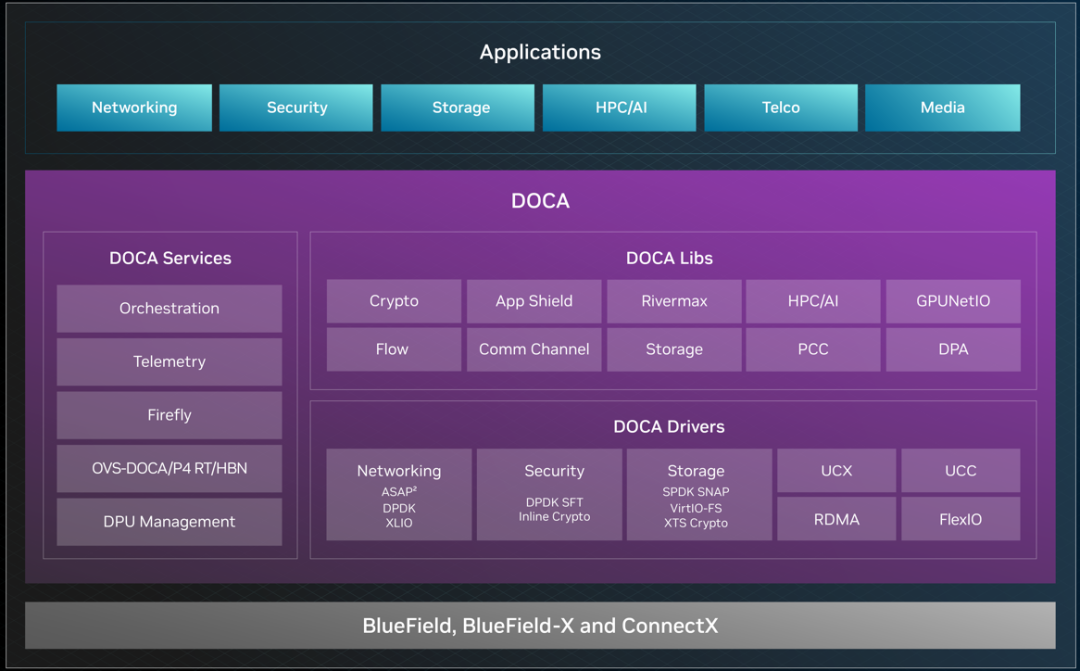

NVIDIA DOCA 2.5 长期支持版本发布

对英伟达A100芯片算力服务收费价格上调100%,这家企业的硬气来自哪里?

NVIDIA 为全球领先的 AI 计算平台 Hopper 再添新动力

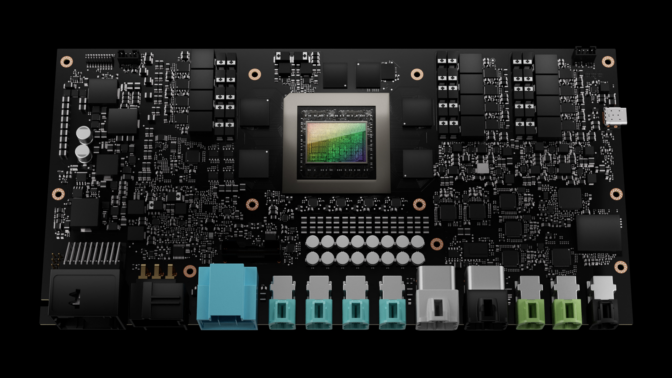

领先的电子制造商选择 NVIDIA DRIVE Hyperion 9,内置 DRIVE Thor 和新一代传感器架构

全球领先系统制造商推出 NVIDIA AI 就绪型服务器,为企业大幅提升生成式 AI 性能

SIGGRAPH 2023 | NVIDIA 与全球数据中心系统制造商大力推动 AI 与工业数字化的发展

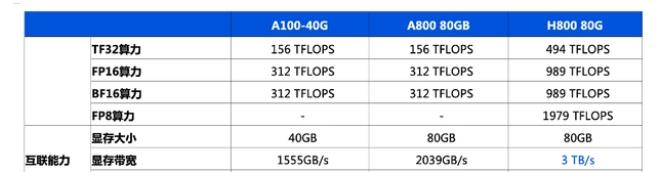

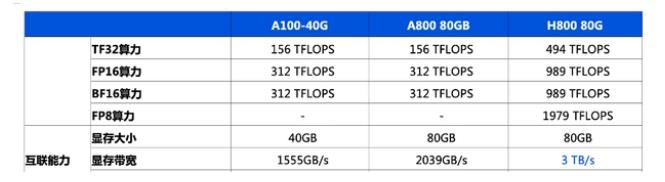

英伟达h800和a100的区别

英伟达h800和a100参数对比

英伟达A100的简介

英伟达a100和h100哪个强?

COMPUTEX2023 | 全球领先的电子制造商采用 NVIDIA 生成式 AI 和 Omniverse 实现先进工厂的数字化

COMPUTEX2023 | NVIDIA MGX 为系统制造商提供模块化架构,以满足全球数据中心多样化加速计算需求

NVIDIA和多家全球领先的服务器制造商发布多款内置NVIDIA A100的系统

NVIDIA和多家全球领先的服务器制造商发布多款内置NVIDIA A100的系统

评论