对于Windows 10最新版中仍然存在XP时代遗留的任务栏上下文菜单bug,微软方面表示,这并不是什么重要Bug,所以会放在新年后解决。

当然了,微软已经开发了针对上述错误的修复程序,并且该公司已通过Windows Insider程序将更改交付给Windows 10 20H1用户,不过想要大规模推送还要在等等。

尽管最初在Windows 10 April 2018 Update(version 1803)中已经有测试人员报告了类似的问题,但导致任务栏上下文菜单显示异常的bug仍然存在于Windows 10 November 2019 Update(version 1909)中。

不少用户反馈的问题表现在:右键单击系统任务栏中的图标后,任务栏会遮挡上下文菜单的一部分,从而无法单击最下方的选项。如果上下文菜单底部的选项为“退出”,这意味着任务栏下方显示的上下文菜单无法通过正常的鼠标操作退出应用程序。

有微软社区论坛的Windows用户表示,这个错误/功能肯定不是什么新玩意,它至少在Windows XP时代就存在了。

责任编辑:wv

声明:本文内容及配图由入驻作者撰写或者入驻合作网站授权转载。文章观点仅代表作者本人,不代表电子发烧友网立场。文章及其配图仅供工程师学习之用,如有内容侵权或者其他违规问题,请联系本站处理。

举报投诉

-

微软

+关注

关注

4文章

6218浏览量

103063 -

Windows10

+关注

关注

1文章

121浏览量

34064

发布评论请先 登录

相关推荐

微软英特尔联手修复Windows 10 BUG,开启升级通道体验Wi-Fi

早在数年前,微软员工便已发现Intelligent Sound Technology(SST)驱动程序存在问题,使得部分Windows 10设备在安装后出现蓝屏现象。为此,微软曾对这些

微软为Windows 10 22H2发布可选KB5035941功能更新

3 月 27 日,Microsoft 宣布推出针对 Windows 10 22H2 的可选功能更新(KB5035941),其重点包括丰富的锁屏小部件和Windows Spotlight墙纸功能,同时

微软发布Windows 11 Build 26085预览版,修复关机、休眠等多类BUG

微软在此份版本文档上表示:“安装此最新的Windows Hardware Lab Kit可助您验证已开发的驱动程序和系统是否适配Windows 10

TC397收到EVAL_6EDL7141_TRAP_1SH 3上下文管理EVAL_6EDL7141_TRAP_1SH错误怎么解决?

我收到EVAL_6EDL7141_TRAP_1SH 3 类(TIN4-Free 上下文列表下溢)上下文管理EVAL_6EDL7141_TRAP_1SH错误。 请告诉我解决这个问题的办法。

发表于 03-06 08:00

ISR的上下文保存和恢复是如何完成的?

函数:ifxCPU_enableInterrupts ();如果我让更高优先级的 ISR 中断优先级较低的 ISR,那么 ISR 的上下文保存和恢复是如何完成的?

发表于 01-22 06:28

FreeRTOS系列技术文章:上下文切换

嵌入式实时操作系统(RTOS)中的上下文切换是指保存和恢复任务的状态,以使调度程序能够切换到另一个任务,从而促进多任务处理。

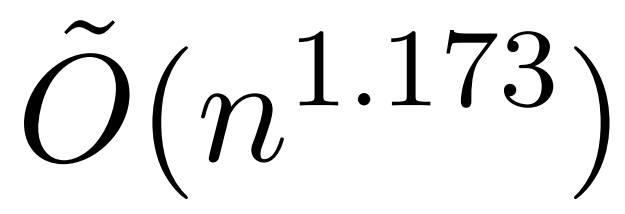

全新近似注意力机制HyperAttention:对长上下文友好、LLM推理提速50%

已经成功应用于自然语言处理、计算机视觉和时间序列预测等领域的各种学习任务。虽然取得了成功,但这些模型仍面临着严重的可扩展性限制,原因是对其注意力层的精确计算导致了二次(在序列长度上)运行时和内存复杂性。这对将 Transformer 模型扩展到更长的上下文长度带来了根本

Linux技术:什么是cpu上下文切换

过多的上下文切换会消耗 CPU 的时间来保存和恢复寄存器、程序计数器、内核栈和虚拟内存等数据,从而导致系统性能显着下降。 既然上下文切换对系统性能的影响如此之大,那么我们如何检查它呢?好了,你可以使用 vmstat 工具来查询你系统的上

发表于 09-01 09:31

•230次阅读

首篇!Point-In-Context:探索用于3D点云理解的上下文学习

随着基于广泛数据训练的大模型兴起,上下文学习(In-Context Learning)已成为一种新的学习范式,在自然语言处理(NLP)和计算机视觉(CV)任务中表现出了巨大的潜力。

谷歌新作SPAE:GPT等大语言模型可以通过上下文学习解决视觉任务

这篇论文揭示了 PaLM 或 GPT 在通过上下文学习解决视觉任务方面的能力,并提出了新方法 SPAE(Semantic Pyramid AutoEncoder)。这种新方法使得 LLM 能够执行图像生成任务,而无需进行任何参数

我们能否扩展现有的预训练 LLM 的上下文窗口

在大家不断升级迭代自家大模型的时候,LLM(大语言模型)对上下文窗口的处理能力,也成为一个重要评估指标。 比如 OpenAI 的 gpt-3.5-turbo 提供 16k token

下载量超300w的ChatGLM-6B再升级:8-32k上下文,推理提速42%

基于 FlashAttention 技术,项目团队将基座模型的上下文长度(Context Length)由 ChatGLM-6B 的 2K 扩展到了 32K,并在对话阶段使用 8K 的上下文长度训练

切换k8s上下文有多快

use-context 命令就会很低效。 今天介绍3个工具会让你在多k8s集群环境中工作的很轻松。我将从以下几个方面来评估工具实用性: 速度 如果你有多个k8s集群可选择,你切换k8s上下文有多快?你还记得所有的集群上下文? 灵活性 工具是否具备高级特性比如支持多con

嵌入式开源实现上下文快速切换 - cpost应用

cpost借鉴的Android的handler机制,通过在mainloop中跑一个任务,然后在其他地方,可以是中断,也可以是模块逻辑中,直接抛出需要执行的函数,使其脱离调用处的上下文,运行在mainloop中。cpost还支持延迟处理,可以指定函数在抛出后多久执行使用

发表于 05-08 11:20

•232次阅读

微软表示将在明年修复Windows10任务栏上下文菜单bug

微软表示将在明年修复Windows10任务栏上下文菜单bug

评论