NVIDIA GPU曾于去年12月和今年7月两度树立了数据中心神经网络训练的性能标杆。今天发布的行业基准测试结果显示,NVIDIA也引领着数据中心内部与外部AI网络的趋势。

NVIDIA Turing GPU和Xavier芯片系统在首个独立AI推理基准测试 ——MLPerf Inference 0.5中取得第一名。由于推理一直是AI市场中最大、同时也是最具竞争力的领域,业内此前一直希望能够有一套客观的推理性能测试指标。

在参与此次测试的十二家公司中,只有NVIDIA AI平台提交了MLPerf的全部五项推理测试成绩(MLPerf是一个于2018年5月成立的行业基准测试小组)。这证明了NVIDIA CUDA-X AI和TensorRT软件的成熟程度。它们让用户能够更加轻松地将所有的NVIDIA GPU应用于数据中心、边缘等领域。

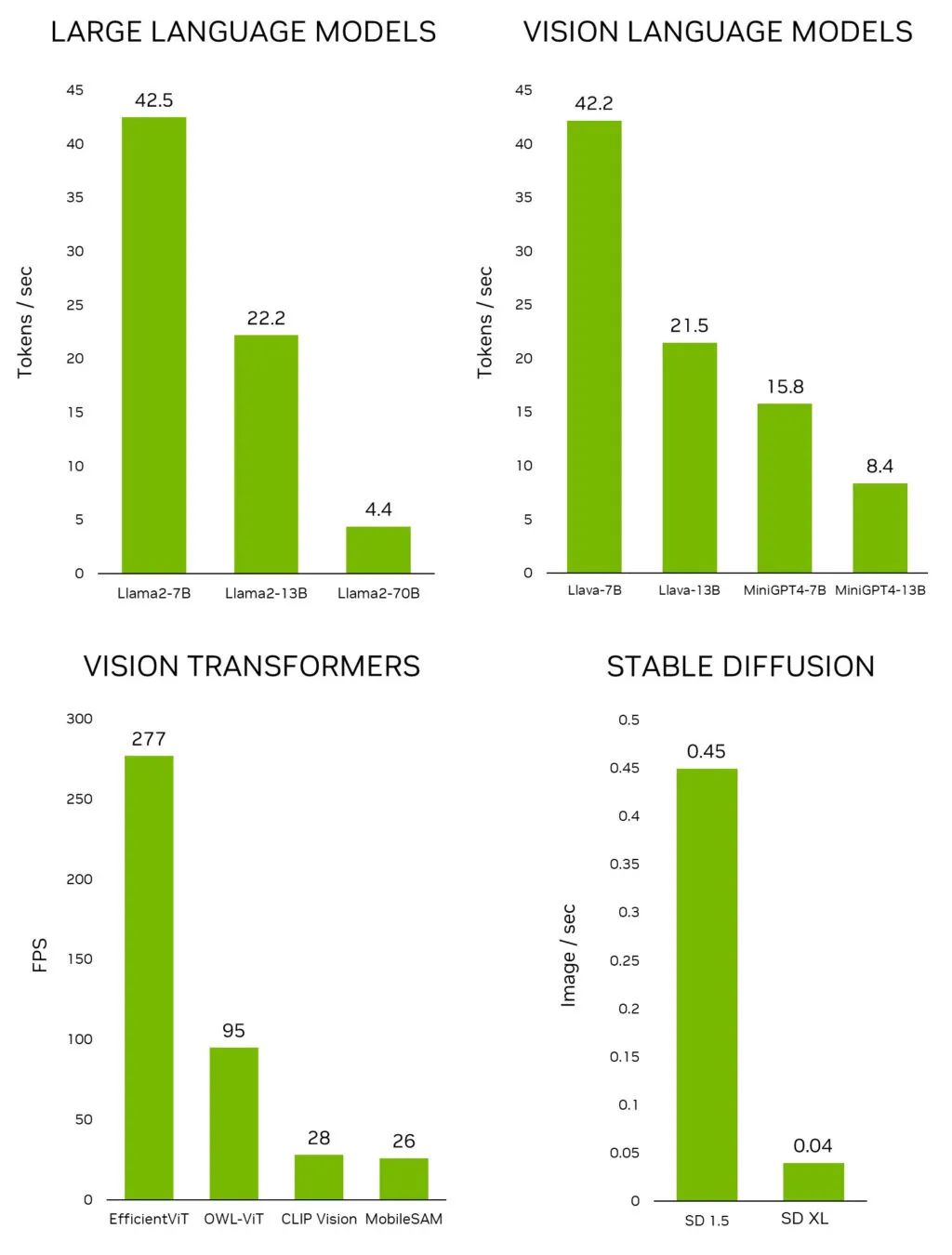

MLPerf定义了五项推理基准,涵盖了三个现有的人工智能应用:图像分类、目标检测和翻译。每项基准分为四个场景:与数据中心应用关联性最高的服务器和离线场景,以及用于满足边缘设备地芯片系统需求的单流和多流场景。

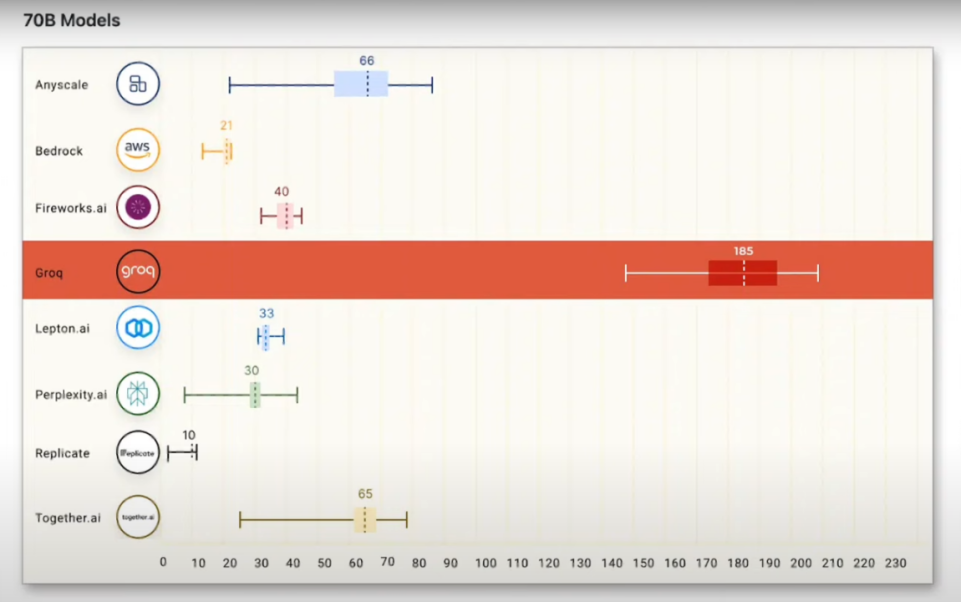

图1:NVIDIA在两个数据中心场景(离线和服务器)的全部五项基准测试中均排在第一位,Turing GPU被评为市面上单处理器性能最高的GPU。

图2:NVIDIA Turing在MLPerf数据中心场景中的成绩超过了其他市面上的处理器。

离线场景中具有代表性的场景有图像标记等,该场景下所有数据可在本地使用;而服务器场景代表性场景有在线翻译服务等,此场景下会突然或间歇性随机出现数据和请求工作。

Xavier在两个边缘场景(单流和多流)中被评为市面上性能最佳的边缘和移动芯片系统。

工业检测相机主要被用来在快速移动的生产线上发现不合格品,这是一种典型的单流任务。多流场景则是测试芯片能够处理多少个数据源 —— 该性能对于一辆可能需要使用6台以上摄像机的自动驾驶汽车而言,是一项关键的能力。

图3:NVIDIA Xavier在MLPerf边缘场景中成为市面上最佳的边缘和移动芯片系统。

该结果显示了NVIDIA CUDA和TensorRT软件的性能。它们为用户提供了一个通用平台,使用户可以在多个产品和应用中取得领先结果,而这正是NVIDIA所独有的能力。

在数据中心场景中,NVIDIA的两款GPU还出现了相互竞争的场面。NVIDIA TITAN RTX展示了Turing级 GPU的巨大潜力,尤其是在各种要求苛刻的任务中,比如运行用于语言翻译的GNMT模型等。

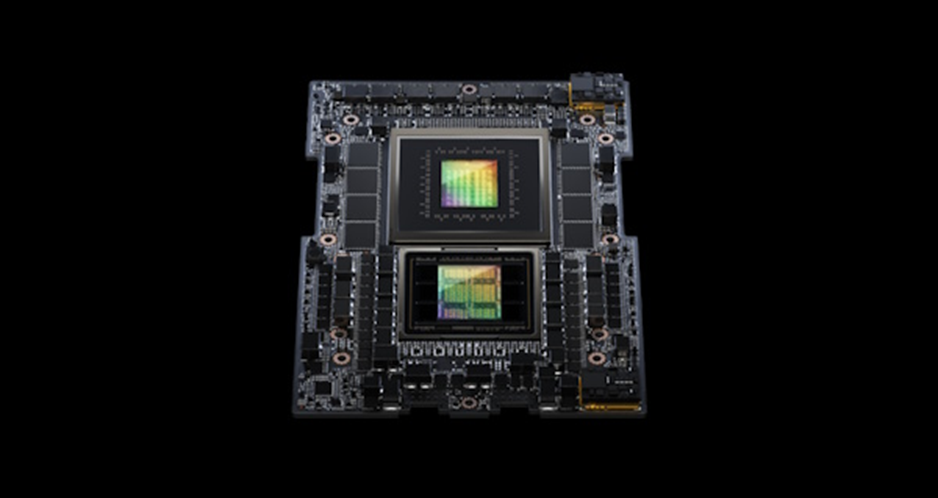

功能丰富、应用广泛的NVIDIA T4 Tensor Core GPU在多个场景取得了优秀的成绩。这个功耗仅为70瓦的GPU能够轻松安装到任何带有PCIe槽的服务器中,使用户能够根据需要扩展其计算力,进而大幅扩展其推理工作。

MLPerf已经获得行业和学术界的广泛支持。其成员包括Arm、Facebook、Futurewei、通用汽车、Google、哈佛大学、Intel、MediaTek、微软、NVIDIA及Xilinx。值得一提的是,相比于之前的两次训练比赛,此次基准测试吸引了更多的参与者。

NVIDIA此次共采用了三款产品,共计四种配置参加此次测试,并提交了全部20个场景中的19个场景的成绩,以此表明公司对这项工作的支持。NVIDIA的合作伙伴Dell EMC,以及NVIDIA的客户阿里巴巴同样使用NVIDIA GPU提交了成绩。相比于其他参与者,NVIDIA与合作伙伴和客户一同向用户全面地展示了NVIDIA产品组合的潜力。

全新的视角与产品

推理指的是在实时生产系统中,通过运行AI模型,从大量数据中筛选出可执行洞察的过程。这是一项仍处于发展中的新兴技术,而NVIDIA也在该领域中不断前进,未曾停止脚步。今天,NVIDIA发布了用于MLPerf测试的Xavier芯片系统低功耗版本——Jetson Xavier NX,其最大功率仅为15瓦,却具有最高21 TOPS的性能。它将为那些对性能要求高、但功率有限的新一代机器人、无人机和其他自主设备提供驱动力。

除了新的硬件之外,NVIDIA还发布了在MLPerf基准测试中所使用的最新TensorRT 6优化,并在GitHub上以开源方式为用户提供该软件。用户可以在MLPerf 开发者博客中了解更多关于这些优化的信息。NVIDIA不断地对该软件进行升级,使用户可以从日益增加的AI自动化与性能中获益。

让推理变得更简单

今天的MLPerf测试还说明了一个结论,那就是推理很困难。例如,在实际工作负载中,由于推理还需要大量预处理和后处理步骤,那么在实际工作负载中其对推理性能的需求甚至比基准测试更高。NVIDIA创始人兼首席执行官黄仁勋在去年GTC大会的主题演讲中就曾将这种复杂性概括为一个词:PLASTER。他表示,现代AI推理对可编程性(Programmability)、延迟性(Latency)、准确性(Accuracy)、模型大小(Accuracy)、吞吐量(Throughput)、能效(Energy efficiency)和学习率(Rate of Learning)的要求很高。

这就是为何用户越来越喜欢使用高性能的NVIDIA GPU和软件来处理各种要求苛刻的推理工作,其中就包括:BMW、Capital One、思科、Expedia、John Deere、微软、PayPal、Pinterest、宝洁、Postmates、Shazam、Snap、Shopify、Twitter、Verizon和沃尔玛等极具远见的公司。

本周,全球最大的邮政服务系统——美国邮政,也加入了此行列,使用NVIDIA GPU进行AI训练和推理。

硬盘制造商希捷希望通过在NVIDIA GPU上运行的AI推理将生产量提高10%。该公司预计,通过提高效率和质量,其将获得高达300%的投资回报。

Pinterest依靠NVIDIA GPU训练和评估其识别模型并对其1750亿条Pin贴文执行实时推理。

Snap使用NVIDIA T4加速器在谷歌云平台上执行推理。相比于仅采用了CPU的系统,这提高了其广告的效果,同时降低了成本。

Twitter发言人就这一趋势表示:“GPU的使用不仅大大缩短了训练时间,还让我们在推理时能够实时了解直播视频,让我们可以在自己的平台上了解各媒体。”

AI会话:关于推理

未来,会话式AI将带来大量的机会以及技术方面的挑战。NVIDIA在这一领域同样是当之无愧的领导者。NVIDIA已经为会话式AI服务提供了经过优化的参照设计,比如自动语音识别、文本-语言转换和自然语言理解等。NVIDIA们的BERT、GNMT和Jasper等AI模型开源优化帮助开发者实现顶尖推理性能。NVIDIA的客户和合作伙伴中包括有会话式AI领域的一流公司,比如Kensho、微软、Nuance、Optum等。

最后要补充的是,MLPerf小组已经开始致力于改进其当前的0.5推理测试。NVIDIA将努力在基准测试中继续发挥领导作用。

声明:本文内容及配图由入驻作者撰写或者入驻合作网站授权转载。文章观点仅代表作者本人,不代表电子发烧友网立场。文章及其配图仅供工程师学习之用,如有内容侵权或者其他违规问题,请联系本站处理。

举报投诉

-

gpu

+关注

关注

27文章

4403浏览量

126569 -

人工智能

+关注

关注

1775文章

43716浏览量

230494 -

推理

+关注

关注

0文章

8浏览量

7214

发布评论请先 登录

相关推荐

NVIDIA携手初创公司引领气候AI创新

在应对气候变化这一全球性挑战时,AI与可持续计算正成为关键工具。NVIDIA初创加速计划的成员公司Tomorrow.io、ClimaSens和north.io,均专注于极端天气预测领域

英伟达要小心了!爆火的Groq芯片能翻盘吗?AI推理速度「吊打」英伟达?

随着科技的飞速发展,人工智能公司Groq挑战了英伟达的王者地位,其AI芯片不仅展现出卓越的实力,还拥有巨大的潜力。Groq设计了一种独特的推理代币经济学模式,该模式背后牵动着众多因素,却也引发了深度

使用NVIDIA Triton推理服务器来加速AI预测

这家云计算巨头的计算机视觉和数据科学服务使用 NVIDIA Triton 推理服务器来加速 AI 预测。

生成式AI带来的机遇与挑战

David Brown指出,生成式AI的发展带来了极其广袤的市场,通过与NVIDIA等合作伙伴的携手合作,以及自研的Amazon Graviton和Amazon Trainium系列定制芯片,亚马逊云科技正在努力为客户提供更好的

HarmonyOS:使用MindSpore Lite引擎进行模型推理

场景介绍

MindSpore Lite 是一款 AI 引擎,它提供了面向不同硬件设备 AI 模型推理的功能,目前已经在图像分类、目标识别、人脸识别、文字识别等应用中广泛使用。

本文介绍

发表于 12-14 11:41

NVIDIA 通过企业级生成式 AI 微服务为聊天机器人、AI 助手和摘要工具带来商业智能

Cadence、Dropbox、SAP、ServiceNow 率先使用 NVIDIA NeMo Retriever 优化语义检索,实现准确的 AI 推理 NVIDIA 今日宣布推出一项

NVIDIA 通过企业级生成式 AI 微服务 为聊天机器人、AI 助手和摘要工具带来商业智能

Cadence、Dropbox、SAP、ServiceNow 率先使用 NVIDIA NeMo Retriever 优化语义检索,实现准确的 AI 推理 亚马逊云科技 re:Invent

发表于 11-29 14:37

•129次阅读

利用 NVIDIA Jetson 实现生成式 AI

近日,NVIDIA 发布了 Jetson 生成式 AI 实验室(Jetson Generative AI Lab),使开发者能够通过 NVIDIA Jetson 边缘设备在现实世界中探

周四研讨会预告 | 注册报名 NVIDIA AI Inference Day - 大模型推理线上研讨会

由 CSDN 举办的 NVIDIA AI Inference Day - 大模型推理线上研讨会,将帮助您了解 NVIDIA 开源大型语言模型(LLM)

NVIDIA Grace Hopper超级芯片横扫MLPerf推理基准测试

Hopper超级芯片首次亮相 MLPerf 行业基准测试,其运行了所有数据中心推理测试,进一步扩大了NVIDIA H100 Tensor Core GPU的领先优势。 总体测试结果表明,NVIDIA

发表于 09-13 09:45

•155次阅读

NVIDIA Grace Hopper 超级芯片横扫 MLPerf 推理基准测试

超级芯片 首次亮相 MLPerf 行业基准测试,其运行了所有数据中心推理测试,进一步扩大了 NVIDIA H100 Tensor Core GPU 的领先优势。 总体测试结果表明,NVIDIA

生成式AI时代要来了吗 NVIDIA生成式AI获新突破

这些性能强大的新系统将利用 NVIDIA Omniverse 平台加速高计算密集度的复杂应用,包括 AI 训练和推理、3D 设计和可视化、视频处理、工业数字化等。

发表于 08-23 14:20

•234次阅读

Ai 部署的临界考虑电子指南

虽然GPU解决方案对训练,AI部署需要更多。

预计到2020年代中期,人工智能行业将增长到200亿美元,其中大部分增长是人工智能推理。英特尔Xeon可扩展处理器约占运行AI推理的处理器

发表于 08-04 07:25

NVIDIA NeMo 如何支持对话式 AI 任务的训练与推理?

,开发和运行可落地的语音人工智能服务仍然是一项复杂而艰巨的任务,通常需要面临实时性、可理解性、自然性、低资源、鲁棒性等挑战。 本期分享我们邀请到了 NVIDIA 的解决方案架构师丁文 ,分享如何使用 NVIDIA NeMo 进

NVIDIA 如何应对会话式AI带来的推理挑战?

NVIDIA 如何应对会话式AI带来的推理挑战?

评论